任务说明¶

- 任务主题:论文作者统计,统计所有论文作者出现评率Top10的姓名;

- 任务内容:论文作者的统计、使用 Pandas 读取数据并使用字符串操作;

- 任务成果:学习 Pandas 的字符串操作;

@DateWhale

" Stay hungry Stay young"

一、数据读取

1.1导入相关包

# 导入所需的package

import seaborn as sns #用于画图

from bs4 import BeautifulSoup #用于爬取arxiv的数据

import re #用于正则表达式,匹配字符串的模式

import requests #用于网络连接,发送网络请求,使用域名获取对应信息

import json #读取数据,我们的数据为json格式的

import pandas as pd #数据处理,数据分析

import matplotlib.pyplot as plt #画图工具

1.2读取文件

然后,定义一个函数,专门用于读取文件,其实task1就应该定义来着,不过当时太懒- -,果然还是函数更有利于后续修改呀:

def readFile(path,columns=['id','submitter','authors','title','comments','journal-ref','doi','reeport-no','categories','license','abstract','versions','update_date','author_parsed'],count=None):

"""

定义本函数用于读取文件,在后续工作中也使用这个函数,比较简便

参数分别为:

文件路径、

读取的列名称(固定值为全部读取)

读取的行数

"""

data=[]

with open(path,'r')as f:

#enumerate函数将可读取的数据对象转化成有序的各个元祖,储存在一个列表中

for i,line in enumerate(f):

if i==count:

break

d=json.loads(line)

#下面这一行操作是为了筛选出需要的那些键值对

d={col:d[col]for col in columns}

data.append(d)

data=pd.DataFrame(data)#转化为dataframe模式

return data

path="D:\\arxiv-metadata-oai-snapshot.json"

data=readFile(path,['id', 'authors', 'categories', 'authors_parsed'],100000)#只能读取10万个,否则电脑跑不动- -

二、数据统计

需要完成的任务:

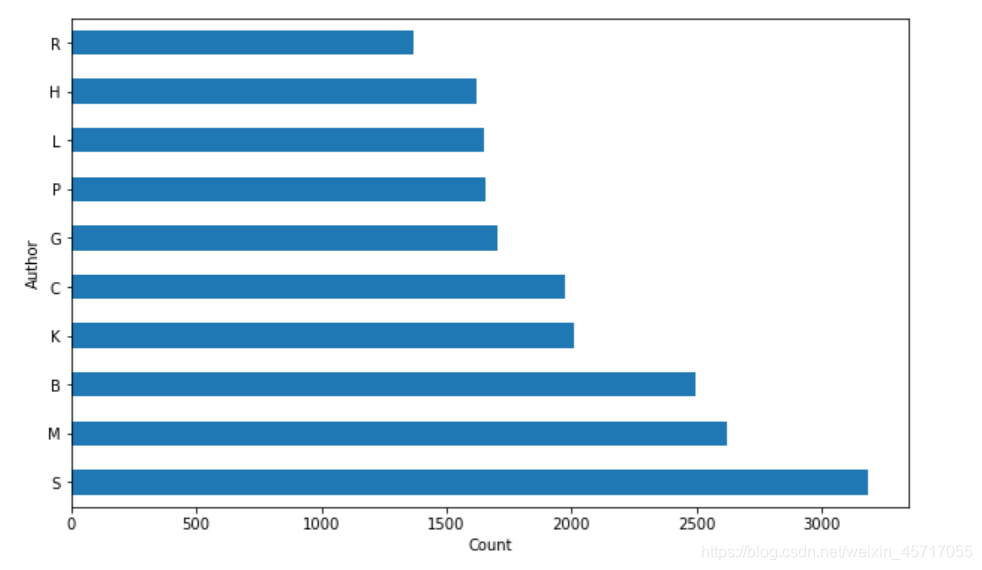

- 统计所有作者姓名出现频率的Top10;

- 统计所有作者姓(姓名最后一个单词)的出现频率的Top10;

- 统计所有作者姓第一个字符的频率;

2.1把作者单独取出为一个列表

#这里将series中的各个作者加和并和[]求和返回一个列表(好厉害的语法,好想看一下底层实现)

all_authors=sum(data['authors_parsed'],[])

print(all_authors)

现在所有的作者已经被存入这个列表中,现在完成姓名频率的统计

现在每个作者是以列表的形式存储的,要将他们取出并连接进一个列表中,因此用以下语句实现:

author_names=[''.join(x) for x in all_authors]

author_names=pd.Series(author_names)

2.2 数据的展示

接下来就是画图环节,采用matplotlib包实现。

代码如下:

其中,value_counts是用来计算每个个体出现的频率,返回一个新的dataframe

# 根据作者频率绘制直方图

#定义图的尺寸

plt.figure(figsize=(10, 6))

author_names[0].value_counts().head(10).plot(kind='barh')

# 修改图配置

names = author_names[0].value_counts().index.values[:10]

#上面一行获取了出现前10的行标签对应的值

plt.yticks(range(0, len(names)), names)

#上面一行对y轴的

plt.ylabel('Author')

plt.xlabel('Count')

输出如下:

接下来,我们统计姓名中的姓出现的top10:

代码类似,如下:

authors_lastnames = [x[0] for x in all_authors]

authors_lastnames = pd.DataFrame(authors_lastnames)

plt.figure(figsize=(10, 6))

authors_lastnames[0].value_counts().head(10).plot(kind='barh')

names = authors_lastnames[0].value_counts().index.values[:10]

plt.yticks(range(0, len(names)), names)

plt.ylabel('Author')

plt.xlabel('Count')

都是华人姓名,太强了!

接下来统计作者姓第一个字符的频率:

代码只需要改这么一行即可:

authors_lastnames = [x[0][0] for x in all_authors]

至此任务完成,本次任务并不难,下次希望先独立尝试,然后再看官方的教程!

858

858

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?