数据挖掘,计算机网络、操作系统刷题笔记48

2022找工作是学历、能力和运气的超强结合体,遇到寒冬,大厂不招人,可能很多算法学生都得去找开发,测开

测开的话,你就得学数据库,sql,oracle,尤其sql要学,当然,像很多金融企业、安全机构啥的,他们必须要用oracle数据库

这oracle比sql安全,强大多了,所以你需要学习,最重要的,你要是考网络警察公务员,这玩意你不会就别去报名了,耽误时间!

与此同时,既然要考网警之数据分析应用岗,那必然要考数据挖掘基础知识,今天开始咱们就对数据挖掘方面的东西好生讲讲

刷题系列文章

【1】Oracle数据库:刷题错题本,数据库的各种概念

【2】操作系统,计算机网络,数据库刷题笔记2

【3】数据库、计算机网络,操作系统刷题笔记3

【4】数据库、计算机网络,操作系统刷题笔记4

【5】数据库、计算机网络,操作系统刷题笔记5

【6】数据库、计算机网络,操作系统刷题笔记6

【7】数据库、计算机网络,操作系统刷题笔记7

【8】数据库、计算机网络,操作系统刷题笔记8

【9】操作系统,计算机网络,数据库刷题笔记9

【10】操作系统,计算机网络,数据库刷题笔记10

【11】操作系统,计算机网络,数据库刷题笔记11

【12】操作系统,计算机网络,数据库刷题笔记12

【13】操作系统,计算机网络,数据库刷题笔记13

【14】操作系统,计算机网络,数据库刷题笔记14

【15】计算机网络、操作系统刷题笔记15

【16】数据库,计算机网络、操作系统刷题笔记16

【17】数据库,计算机网络、操作系统刷题笔记17

【18】数据库,计算机网络、操作系统刷题笔记18

【19】数据库,计算机网络、操作系统刷题笔记19

【20】数据库,计算机网络、操作系统刷题笔记20

【21】数据库,计算机网络、操作系统刷题笔记21

【22】数据库,计算机网络、操作系统刷题笔记22

【23】数据库,计算机网络、操作系统刷题笔记23

【24】数据库,计算机网络、操作系统刷题笔记24

【25】数据库,计算机网络、操作系统刷题笔记25

【26】数据库,计算机网络、操作系统刷题笔记26

【27】数据库,计算机网络、操作系统刷题笔记27

【28】数据库,计算机网络、操作系统刷题笔记28

【29】数据库,计算机网络、操作系统刷题笔记29

【30】数据库,计算机网络、操作系统刷题笔记30

【31】数据库,计算机网络、操作系统刷题笔记31

【32】数据库,计算机网络、操作系统刷题笔记32

【33】数据库,计算机网络、操作系统刷题笔记33

【34】数据库,计算机网络、操作系统刷题笔记34

【35】数据挖掘,计算机网络、操作系统刷题笔记35

【36】数据挖掘,计算机网络、操作系统刷题笔记36

【37】数据挖掘,计算机网络、操作系统刷题笔记37

【38】数据挖掘,计算机网络、操作系统刷题笔记38

【39】数据挖掘,计算机网络、操作系统刷题笔记39

【40】数据挖掘,计算机网络、操作系统刷题笔记40

【41】数据挖掘,计算机网络、操作系统刷题笔记41

【42】数据挖掘,计算机网络、操作系统刷题笔记42

【43】数据挖掘,计算机网络、操作系统刷题笔记43

【44】数据挖掘,计算机网络、操作系统刷题笔记44

【45】数据挖掘,计算机网络、操作系统刷题笔记45

【46】数据挖掘,计算机网络、操作系统刷题笔记46

【47】数据挖掘,计算机网络、操作系统刷题笔记47

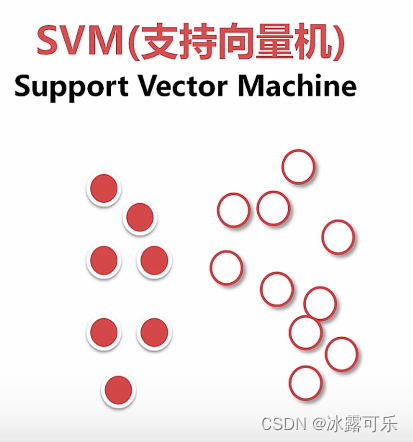

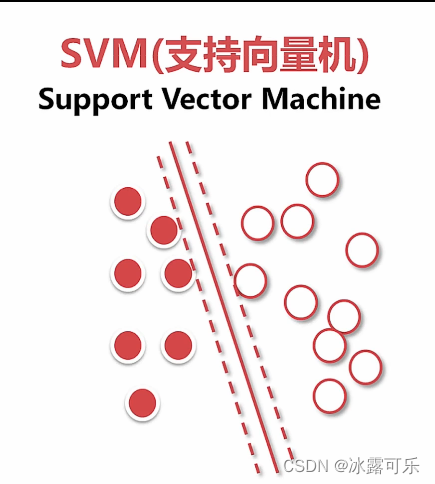

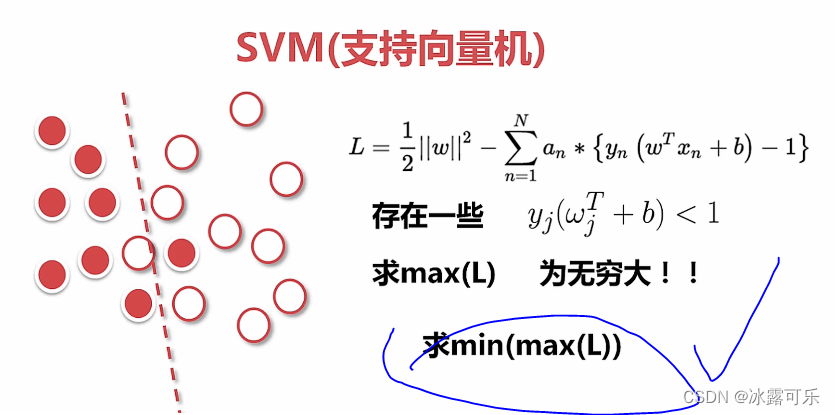

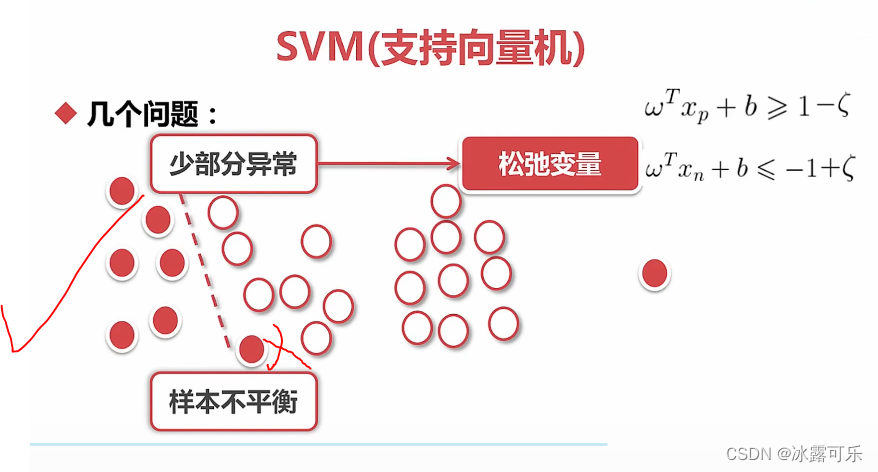

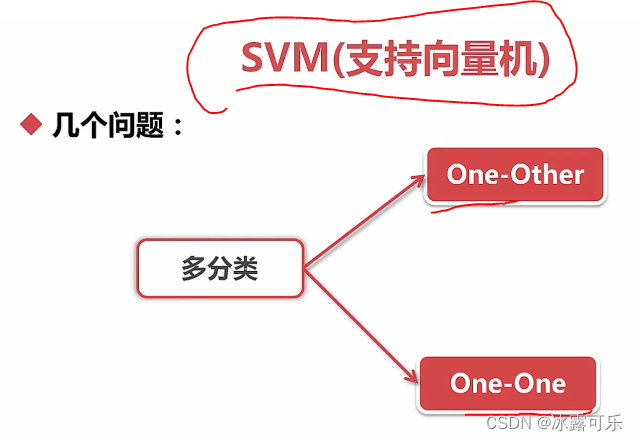

数据挖掘分析应用:支持向量机SVM

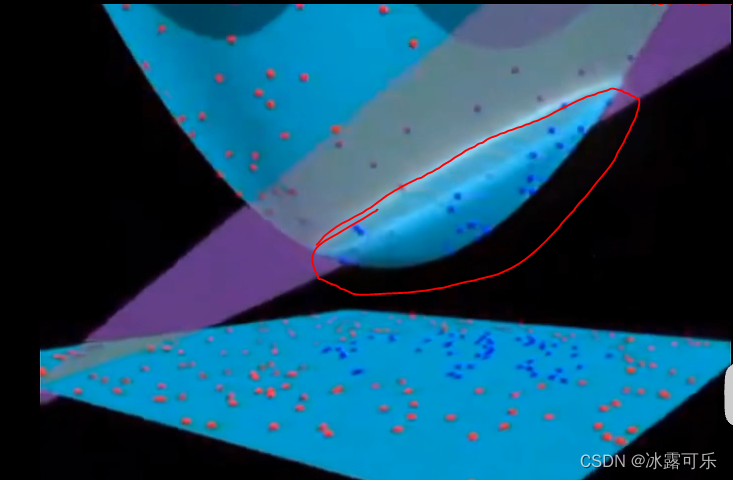

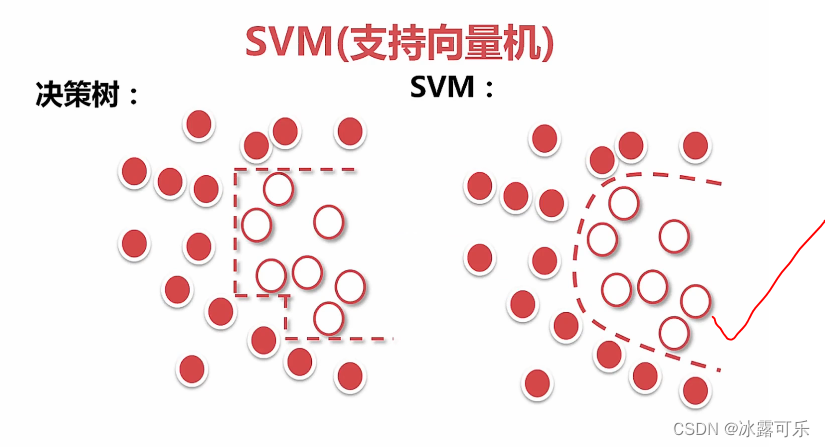

用二维空间说明这个事

用一条线,将其分开

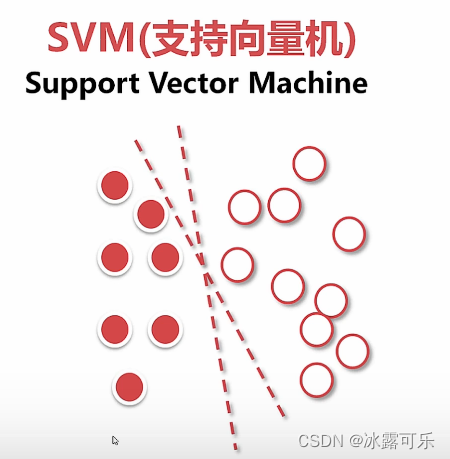

哪个线最好呢??

最好找,俩样本所有点,距离这个线的距离之和最大,即可

那只需要找边沿那几个点——他们叫支持向量点

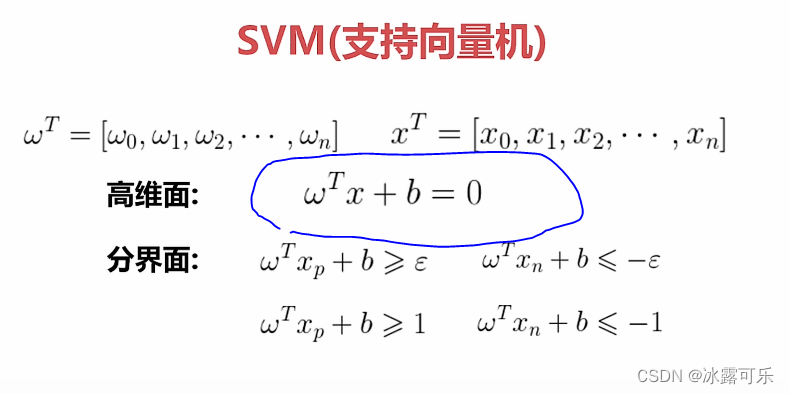

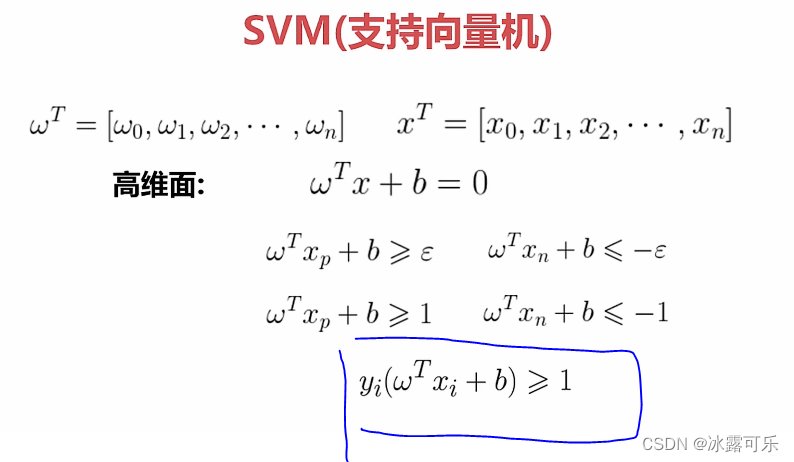

实现是超平面

虚线是支持向量线

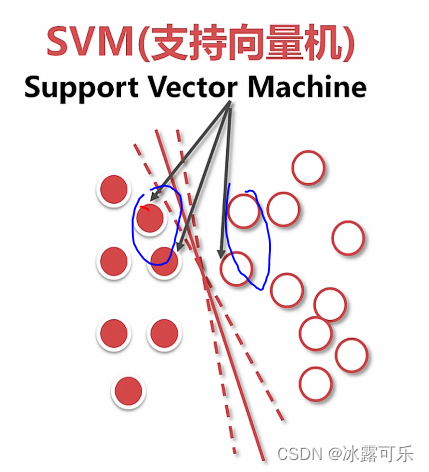

俩距离作为yikesir

距离咋求?点到面的距离

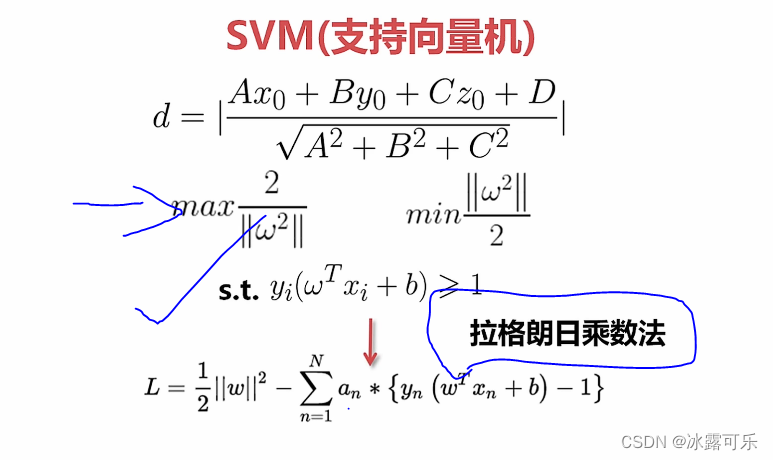

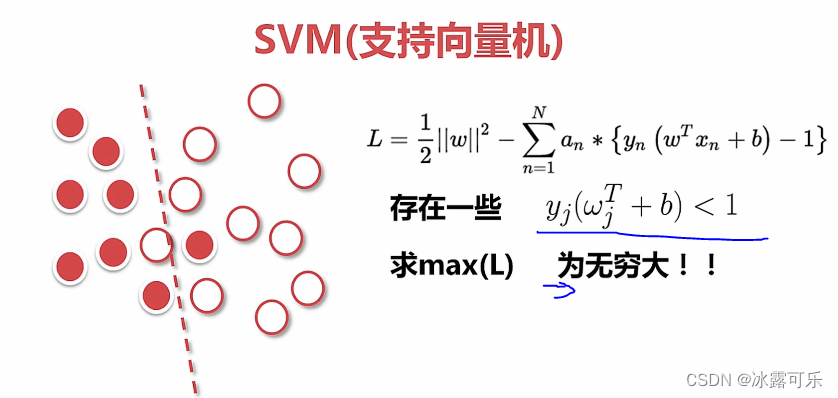

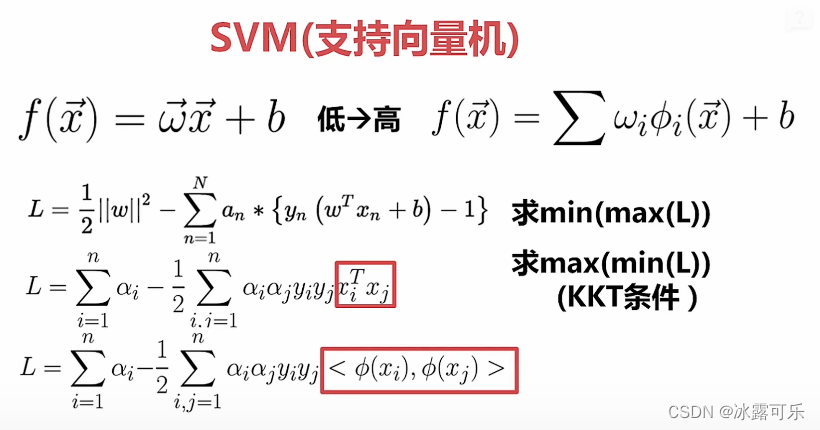

反正目标就是最大化2/||w||^2

通过办法转化求解w

再约束一波

取最大值中,拿到一个最小结果

即可

不需要超大

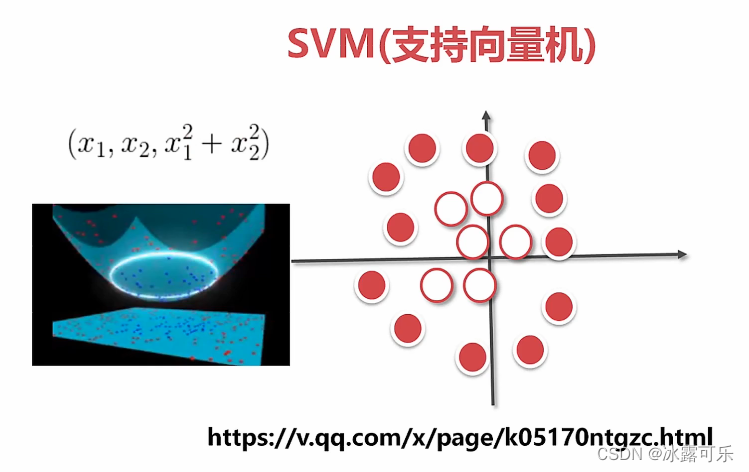

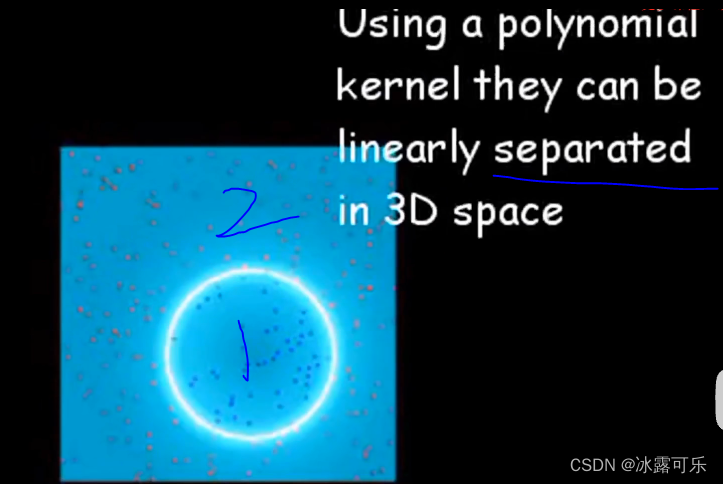

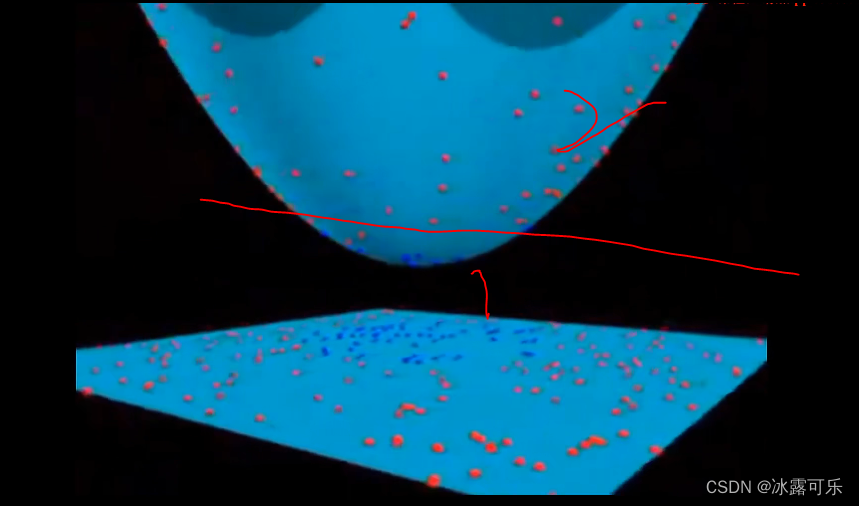

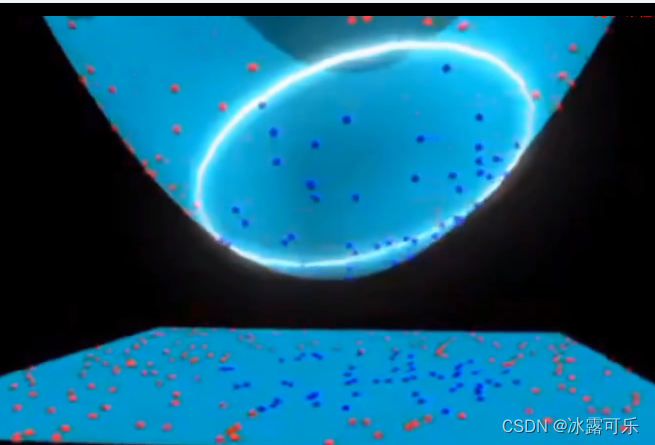

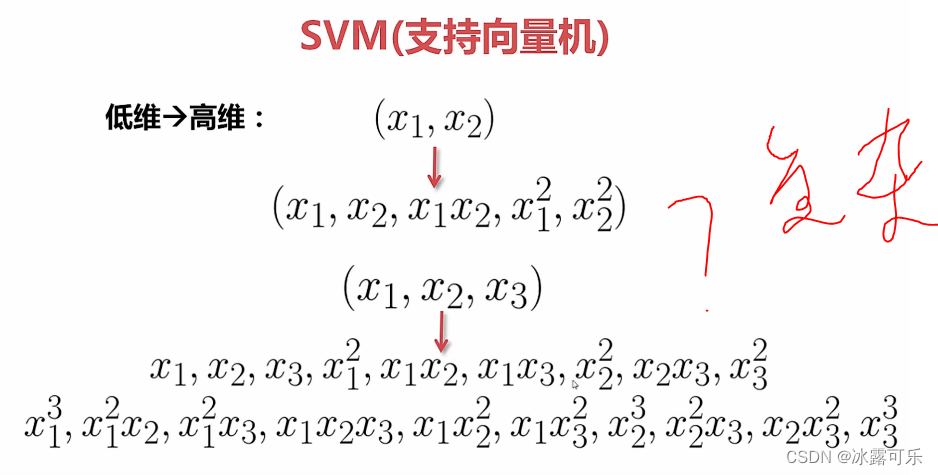

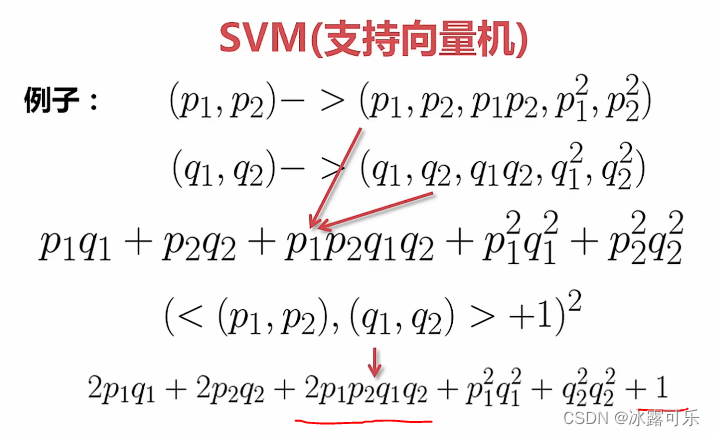

提取一个特征,扩张到三维

然后将其映射到三维

扩维可以考虑多种,尝试看看哪种好

这不是个好办法

后来怎么扩维呢???

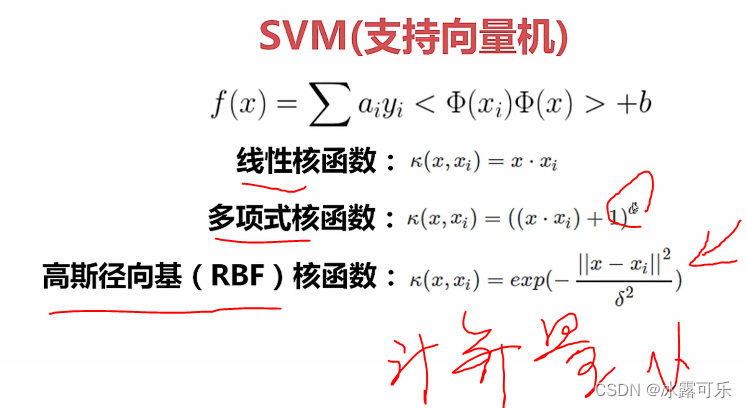

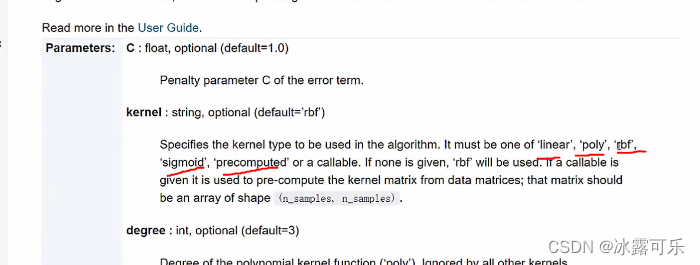

用核函数

这就是为啥SVM比较牛逼的原因

它扩维之后分类的能力很强的

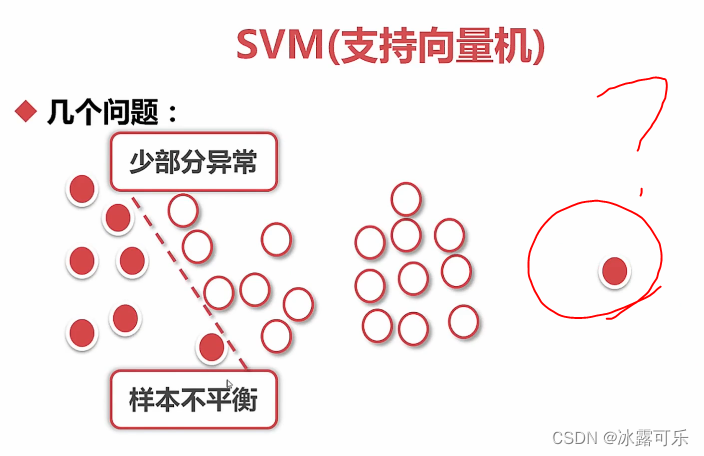

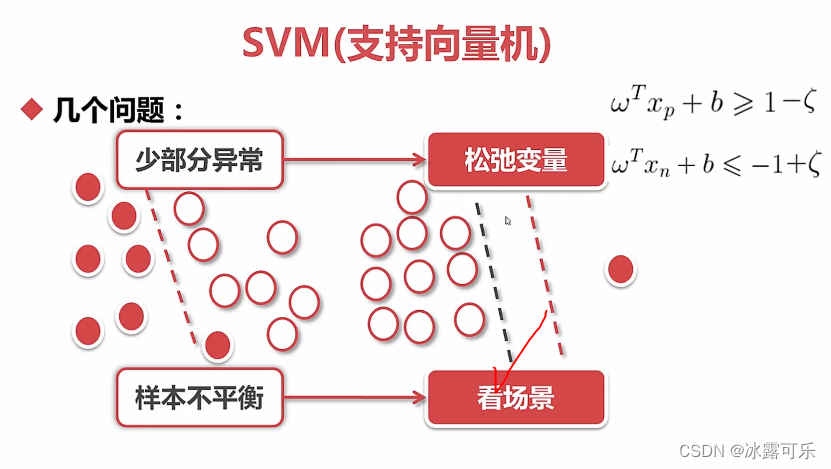

松弛变量,把异常错分点容忍了

看右图

样本不平衡

看看场景吧

黑线更好

下面代码演示:

# 演示SVM

# 模型

def hr_modeling_all_saveDT_SVM(features, label):

from sklearn.model_selection import train_test_split

# 切分函数

#DataFrame

feature_val = features.values

label_val = label

# 特征段

feature_name = features.columns

train_data, valid_data, y_train, y_valid = train_test_split(feature_val, label_val, test_size=0.2) # 20%验证集

train_data, test_data, y_train, y_test = train_test_split(train_data, y_train, test_size=0.25) # 25%测试集

print(len(train_data), len(valid_data), len(test_data))

# KNN分类

from sklearn.neighbors import NearestNeighbors, KNeighborsClassifier

from sklearn.metrics import accuracy_score, recall_score, f1_score # 模型评价

from sklearn.naive_bayes import GaussianNB, BernoulliNB # 高斯,伯努利,都是对特征有严格要求,离散值最好

from sklearn.tree import DecisionTreeClassifier, export_graphviz # 决策树

from io import StringIO

import pydotplus

import os

from sklearn.svm import SVC

os.environ["PATH"] += os.pathsep+r'D:\Program Files\Graphviz\bin'

models = [] # 申请模型,挨个验证好坏

knn_clf = KNeighborsClassifier(n_neighbors=3) # 5类

bys_clf = GaussianNB()

bnl_clf = BernoulliNB()

DT_clf = DecisionTreeClassifier()

SVC_clf = SVC()

models.append(("KNN", knn_clf)) # 代码一个个模型测--放入的是元祖

# models.append(("GaussianNB", bys_clf)) # 代码一个个模型测--放入的是元祖

# models.append(("BernoulliNB", bnl_clf)) # 代码一个个模型测--放入的是元祖

models.append(("Decision Tree", DT_clf)) # 代码一个个模型测--放入的是元祖

models.append(("SVM classifier", SVC_clf)) # 代码一个个模型测--放入的是元祖

# 不同的模型,依次验证

for modelName, model in models:

print(modelName)

model.fit(train_data, y_train) # 指定训练集

# 又集成化数据集

data = [(train_data, y_train), (valid_data, y_valid), (test_data, y_test)]

for i in range(len(data)):

print(i)

y_input = data[i][0]

y_label = data[i][1] # 输入输出预测

y_pred = model.predict(y_input)

print("acc:", accuracy_score(y_label, y_pred))

print("recall:", recall_score(y_label, y_pred))

print("F1:", f1_score(y_label, y_pred))

print("\n")

# 不考虑存储,你看看这个模型就会输出仨结果

if __name__ == '__main__':

features, label = pre_processing(sl=True, le=True, npr=True, amh=True, wacc=True, pla=True, dep=False, sal=True,

lower_d=True, ld_n=3)

# print(df, label)

# 灌入模型

hr_modeling_all_saveDT_SVM(features, label)

8999 3000 3000

KNN

0

acc: 0.9613290365596178

recall: 0.9347319347319347

F1: 0.9201468563561267

1

acc: 0.9156666666666666

recall: 0.8561549100968188

F1: 0.8303152246814218

2

acc: 0.9243333333333333

recall: 0.8862019914651493

F1: 0.8458927359131024

Decision Tree

0

acc: 1.0

recall: 1.0

F1: 1.0

1

acc: 0.9383333333333334

recall: 0.8921161825726142

F1: 0.8745762711864407

2

acc: 0.9416666666666667

recall: 0.8933143669985776

F1: 0.8777078965758213

SVM classifier

0

acc: 0.9047671963551506

recall: 0.7496503496503496

F1: 0.7895899828136509

1

acc: 0.9

recall: 0.7316735822959889

F1: 0.7790868924889544

2

acc: 0.906

recall: 0.7738264580369844

F1: 0.7941605839416057

Process finished with exit code 0

一般般吧这个结果

还不如KNN呢?

DT当然是最牛逼的

kernel核函数可以去官网看

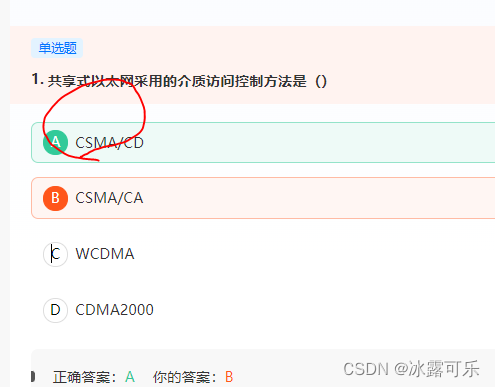

共享式以太网采用的介质访问控制方法是()

链接:https://www.nowcoder.com/questionTerminal/63db200f25bc4da7a4b1bbddfb7d730c

来源:牛客网

CSMA/CD带碰撞检测的载波监听多点接入(Carrier Sense Multiple Access with Collision Detection)有线以太网

CSMA/CA带冲突避免的载波监听多点接入(Carrier Sense Multiple Access with Collision Avoidance)无线局域网

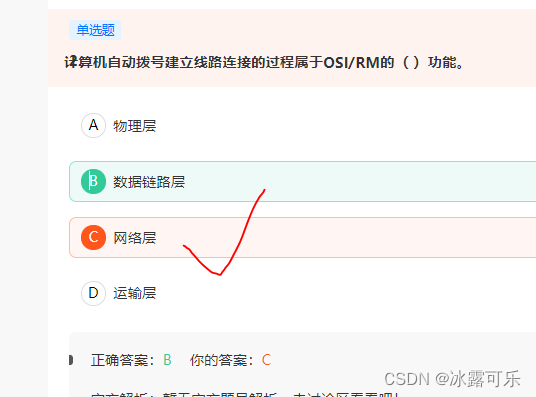

计算机自动拨号建立线路连接的过程属于OSI/RM的( )功能。

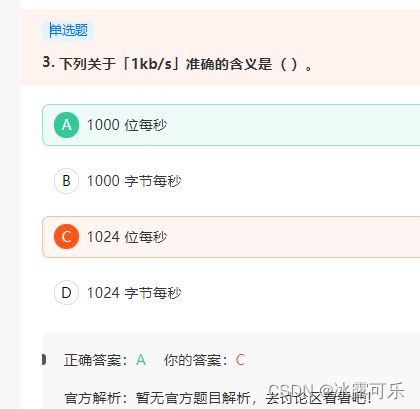

下列关于「1kb/s」准确的含义是( )。

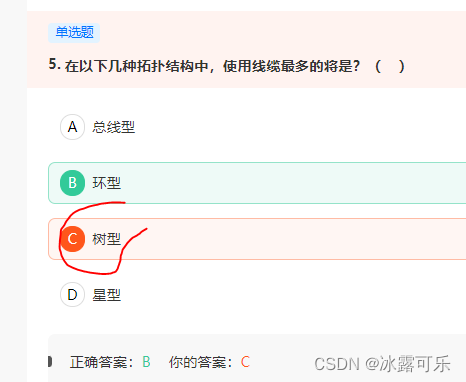

在以下几种拓扑结构中,使用线缆最多的将是?( )

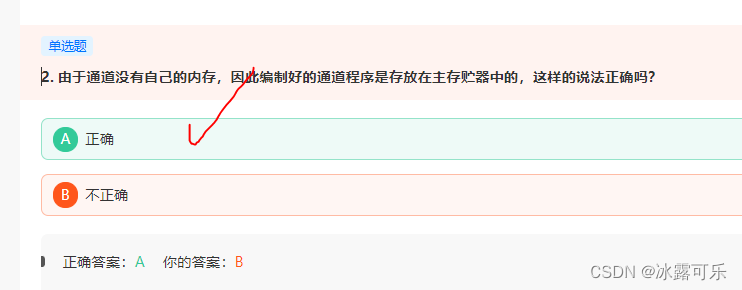

由于通道没有自己的内存,因此编制好的通道程序是存放在主存贮器中的

抢占式多任务处理中,进程被抢占时,哪些运行环境需要被保存下来?

别人的不管,自己的要存

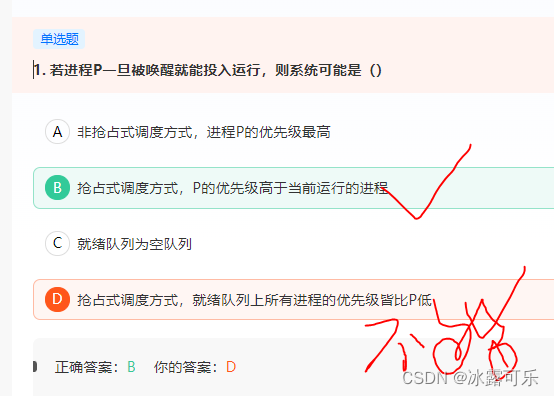

若进程P一旦被唤醒就能投入运行,则系统可能是()

小心

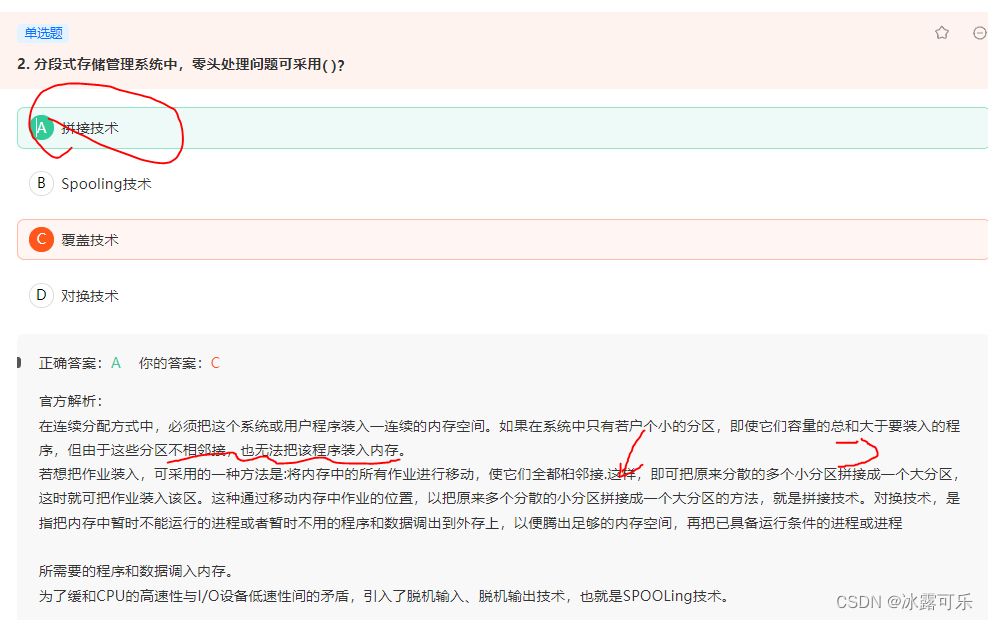

分段式存储管理系统中,零头处理问题可采用( )?

总结

提示:重要经验:

1)

2)学好oracle,即使经济寒冬,整个测开offer绝对不是问题!同时也是你考公网络警察的必经之路。

3)笔试求AC,可以不考虑空间复杂度,但是面试既要考虑时间复杂度最优,也要考虑空间复杂度最优。

614

614

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?