1.multilayer perceptron (MLP) 多层感知机

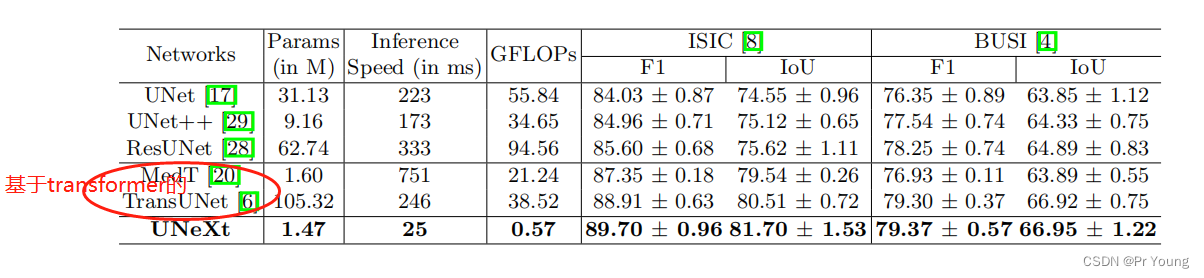

2.参数量减少了72倍,计算复杂度降低了68倍,推理速度(inference speed)提高了10倍

根据其实验结果表,同结构U-Net参数量31.13M,UNeXt参数量1.47M

3.transformer可以学习到对图像的全局理解

4.几乎所有的上述工作都集中在提高网络的性能(精度),而不是太关注计算复杂度、推理时间或参数的数量,这些在许多现实应用中是必不可少的

5.在ISIC skin lesion dataset and Breast UltraSound Images (BUSI) dataset两个数据集上进行测试

ISIC 2018数据集 由2594张图片组成,将所有的图像大小调整为512*512

BUSI总共有647张图像,将大小调整为256*256

损失函数:二元交叉熵BCE+DICE损失:

L

= 0

.

5

BCE

(ˆ

y, y

) +

Dice

(ˆ

y, y

)

Adam优化器(学习率为0.0001,动量为0.9)

余弦退火学习速率调度器(最小学习率达到了0.00001)

batch_size=8,epoch=400

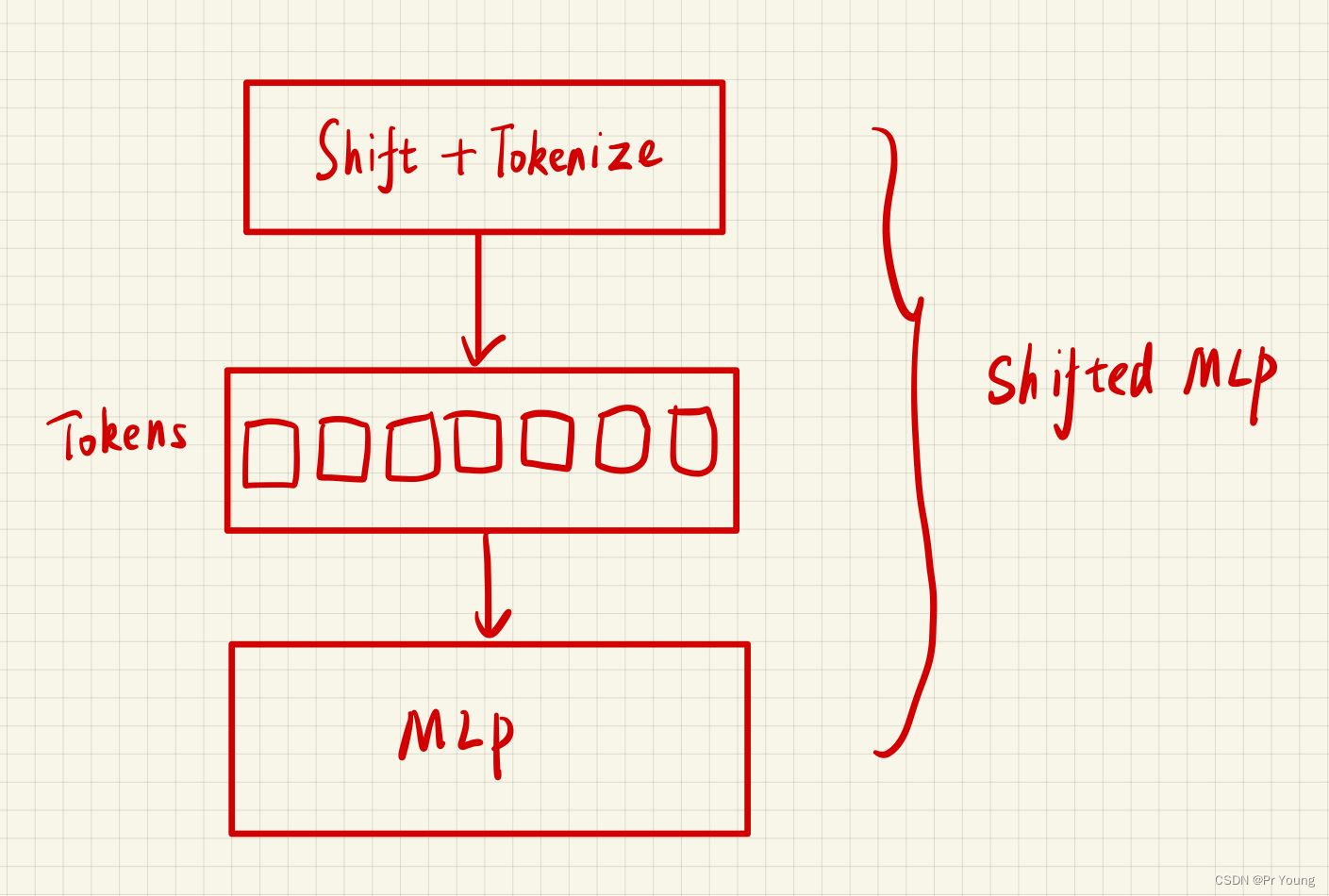

6.Unext前三个stage和Unet一样,最后两个Stage是Tokenized MLP Block(简称为Tok-MLP)

Tok-MLP由两个shifted MLP组成,一个沿width维度,一个沿height维度

其中c1=32,c2=64,c3=128,c4=160,c5=256

Tokenized MLP Block结构如下:

在 Tokenized MLP Block模块中,含有两个Shifted MLP,一个沿着width维度,一个沿着height维度:

Shifted MLP在各个局部区域之间传递特征信息,达到global feature的效果

7.在原文该部分段落中,介绍到该操作受启发于 Swin Transformer,实际上再细致一点,是受启发于 Swin 的窗的设计

8.F1 score,计算的复杂性用GFLOPs(每秒10亿次的浮点运算数)来衡量

实验了Swin-UNet,但发现在小数据集上存在收敛问题,导致性能较差

swinunet有41.35M个参数,计算复杂性为11.46 GFLOPs.

9.我们还提供了在cpu上操作的平均推理时间,因为护理点设备大多数是低计算力,而且通常没有gpu,CPU是英特尔XeonGoln6140CPU,工作在2.30 GHz

10.训练结果:

11.

而unet的通道数为64,128,256,512,1024,通道数很大,计算量很大

740

740

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?