1. VGG块

在下面的代码中,我们定义了一个名为vgg_block的函数来实现一个VGG块。

该函数有三个参数,分别对应于卷积层的数量num_convs、输入通道的数量in_channels 和输出通道的数量out_channels.

import torch

from torch import nn

from d2l import torch as d2l

def vgg_block(num_convs, in_channels, out_channels):

layers = []

for _ in range(num_convs):

layers.append(nn.Conv2d(in_channels, out_channels,

kernel_size=3, padding=1))

layers.append(nn.ReLU())

in_channels = out_channels # 下一层的输入通道数等于本层的输出通道数

layers.append(nn.MaxPool2d(kernel_size=2,stride=2))

return nn.Sequential(*layers) # *layers是解包,把数组拆成一个个元素

2. VGG网络

VGG神经网络连接 几个VGG块(在vgg_block函数中定义)。其中有超参数变量conv_arch。该变量指定了每个VGG块里卷积层个数和输出通道数。全连接模块则与AlexNet中的相同。

原始VGG网络有5个卷积块,其中前两个块各有一个卷积层,后三个块各包含两个卷积层。 第一个模块有64个输出通道,每个后续模块将输出通道数量翻倍,直到该数字达到512。

由于该网络使用8个卷积层和3个全连接层,因此它通常被称为VGG-11。

# ps:这个块数是不能改变的,也就是conv_arch中的元素个数只能是5,

# 如果变成6个的话,那么224/64 = 3...32 ,图片大小都不为整数了

# 但是通道数可以改变,卷积层个数可以改变

conv_arch = ((1, 64), (1, 128), (2, 256), (2, 512), (2, 512))

下面的代码实现了VGG-11。可以通过在conv_arch上执行for循环来简单实现。

def vgg(conv_arch):

conv_blks = []

in_channels = 1 # 是因为用的数据集fashion_mnist的图片都是灰度图

# 卷积层部分

for (num_convs, out_channels) in conv_arch:

# conv_blks 是一个由很多vgg_block组成的数组

conv_blks.append(vgg_block(num_convs, in_channels, out_channels))

in_channels = out_channels # 下一层的输入通道数等于本层的输出通道数

return nn.Sequential(

*conv_blks, nn.Flatten(),

# 全连接层部分

# 为什么是7*7呢?因为有5个卷积块,每个卷积块的最后一层都是一个strdie=2且大小为2的pooling层,

# 就意味着每经过一个卷积块大小会减半,经过5个卷积块后,224/32 = 7,最后图片大小变成7*7

nn.Linear(out_channels * 7 * 7, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 10))

net = vgg(conv_arch)

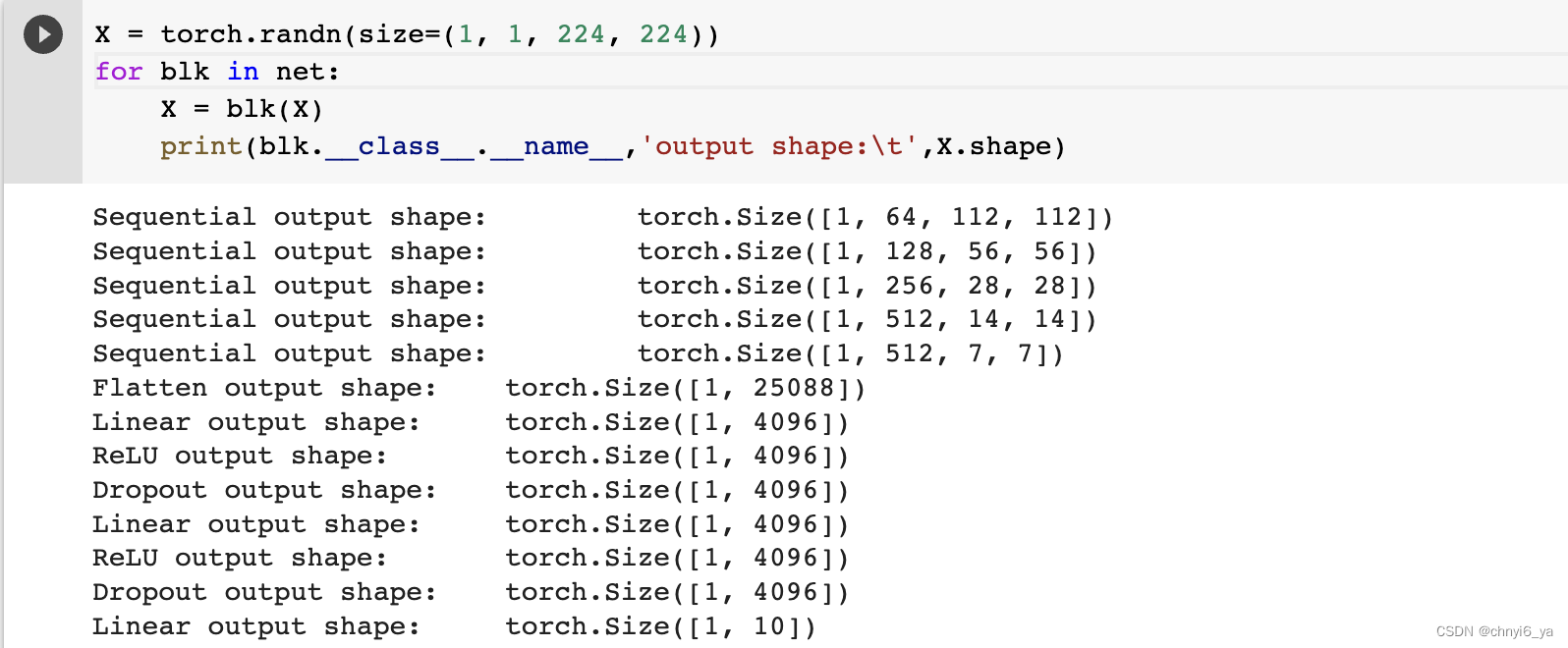

接下来,我们将构建一个高度和宽度为224的单通道数据样本,以观察每个层输出的形状。

X = torch.randn(size=(1, 1, 224, 224))

for blk in net:

X = blk(X)

print(blk.__class__.__name__,'output shape:\t',X.shape)

正如从代码中所看到的,我们在每个块的高度和宽度减半,最终高度和宽度都为7。最后再展平表示,送入全连接层处理。

3. 训练模型

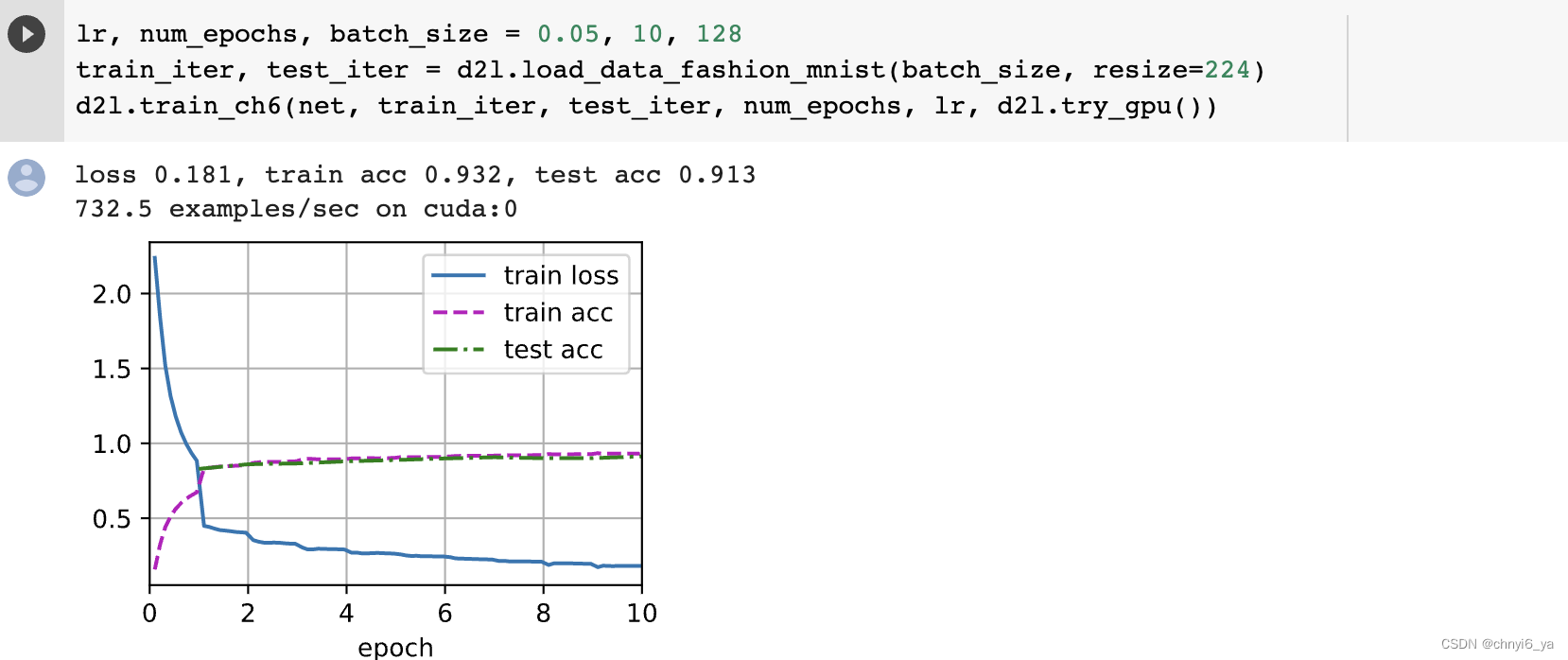

由于VGG-11比AlexNet计算量更大,因此我们构建了一个通道数较少的网络,足够用于训练Fashion-MNIST数据集。

ratio = 4

small_conv_arch = [(pair[0], pair[1] // ratio) for pair in conv_arch]

net = vgg(small_conv_arch)

除了使用略高的学习率外,模型训练过程与AlexNet类似。

lr, num_epochs, batch_size = 0.05, 10, 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

4190

4190

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?