前言

随着大模型的火爆,展现出了十分出彩的技能。但是如何飞入寻寻常百姓家?学者们不断尝试研究通过不同的结构调整,或者增加或者减少,或者部分或者整体参数设计。主要代表:Prompt Tuning、Prefix Tuning 、P-tuning、LoRA。

本文从LoRA与QLoRa开始导入描述

一、LoRA基本原理

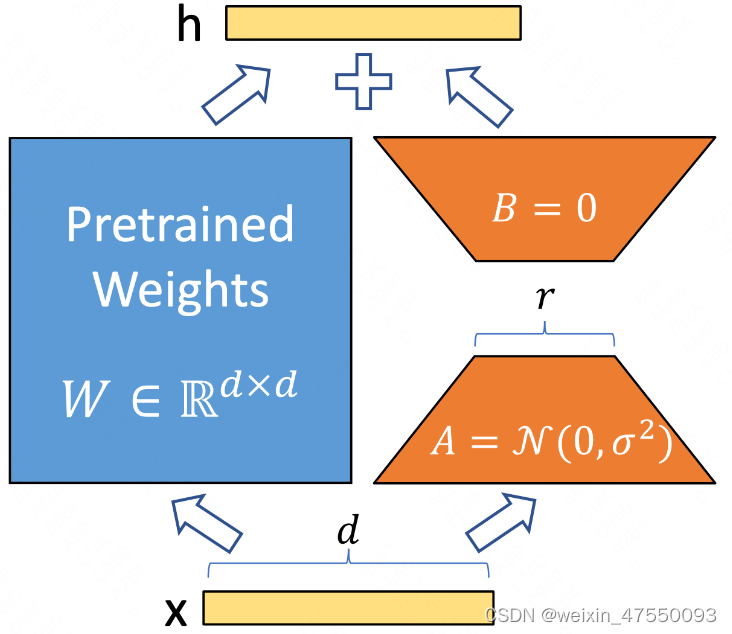

LoRA(Low-Rank Adaptation) 本质上是对特征矩阵进行低秩分解的一种近似数值分解技术,可用来大幅降低特征矩阵的参数,但是会伴随着有损压缩。其核心思想是将大模型的参数分解为低纬的核心参数和高纬的残差参数。在微调过程中只更新LoRA参数,而保持核心参数不变,这种参数分解的方式见底了模型的复杂度,减少了过拟合的风险,并提高了模型的泛化能力。

LoRa 适配器

小点点: 关于LoRA参数量。假设原始矩阵为 100* 200(m*n)。那么Lora两个矩阵A,B分别为

100*8、8*200,假设r=8。 那么总共参数量变化为:20000 ==》 800+1600 只占原来的十分之一

本文介绍了LoRA的基本原理,它通过低秩分解降低模型复杂度,提高泛化能力。QLoRA作为LoRA的优化版,采用分块量化、双重量化和分页优化器,进一步提升效率。文章还提供了QLoRA的实战指导,包括安装和训练过程。

本文介绍了LoRA的基本原理,它通过低秩分解降低模型复杂度,提高泛化能力。QLoRA作为LoRA的优化版,采用分块量化、双重量化和分页优化器,进一步提升效率。文章还提供了QLoRA的实战指导,包括安装和训练过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

237

237

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?