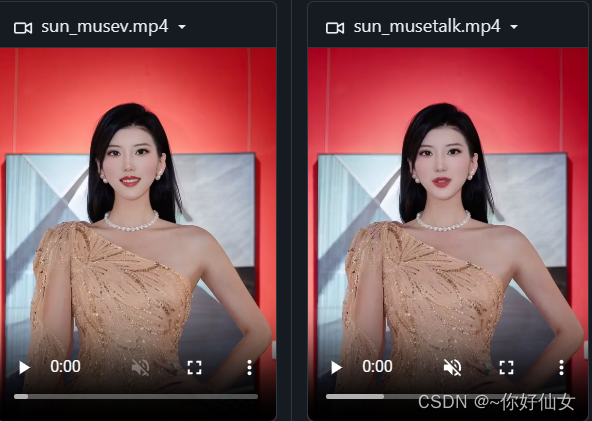

效果展示

新建虚拟环境

(建议使用 python 版本 >=3.10 和 cuda 版本 =11.7。)

conda create -n musetalk python=3.10安装pytorch和cuda环境

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118下载项目文件

git clone https://github.com/TMElyralab/MuseTalk.git下载项目依赖包

pip install -r requirements.txtmmlab 封装

pip install --no-cache-dir -U openmim

mim install mmengine

mim install "mmcv>=2.0.1"

mim install "mmdet>=3.1.0"

mim install "mmpose>=1.1.0" 下载 ffmpeg-static

# 下载ffmpeg-static版本,这里以ffmpeg 4.4为例(确保使用你的具体版本号)

wget https://johnvansickle.com/ffmpeg/releases/ffmpeg-release-amd64-static.tar.xz

# 解压文件

tar -xvf ffmpeg-release-amd64-static.tar.xz设置环境变量

- 打开一个终端窗口。编辑

.bashrc -

使用文本编辑器打开你的

.bashrc文件。大多数Linux用户使用的是 Bash shell,其配置文件通常是.bashrc。你可以使用nano或其他编辑器打开这个文件nano ~/.bashrc -

添加

export命令,在打开的文件中,添加以下行:请确保路径与你解压的的目录匹配。export FFMPEG_PATH=~/musetalk/ffmpeg-4.4-amd64-static -

保存和退出编辑器,按

Ctrl+O保存文件更改,然后按Ctrl+X退出nano编辑器。 -

更新环境变量,为使更改生效,需要重新加载

.bashrc或.bash_profile。在你的终端中,执行以下命令:source ~/.bashrc -

验证安装:验证

ffmpeg是否正确安装和配置:$FFMPEG_PATH/ffmpeg -version

可能会遇到ffmpeg 模块缺少预期的 input 方法和 Error 类,这通常发生在你安装了一个与预期不符的 ffmpeg 包时。

在终端执行以下命令查看已安装的相关库:

pip list | grep ffmpeg

安装正确的库:

pip install ffmpeg-python 下载权重

最后,这些权重应按如下方式组织:models

./models/

├── musetalk

│ └── musetalk.json

│ └── pytorch_model.bin

├── dwpose

│ └── dw-ll_ucoco_384.pth

├── face-parse-bisent

│ ├── 79999_iter.pth

│ └── resnet18-5c106cde.pth

├── sd-vae-ft-mse

│ ├── config.json

│ └── diffusion_pytorch_model.bin

└── whisper

└── tiny.pt模型推理

python -m scripts.inference --inference_config configs/inference/test.yaml configs/inference/test.yaml 是推理配置文件的路径,包括 video_path 和 audio_path。 video_path应为视频文件或图像目录。

本文详细指导如何在Python3.10及以上版本和CUDA11.7环境下设置虚拟环境,安装必要的库(如PyTorch、MMDetection等),配置ffmpeg,以及下载和组织预训练权重,用于MuseTalk的模型推理。

本文详细指导如何在Python3.10及以上版本和CUDA11.7环境下设置虚拟环境,安装必要的库(如PyTorch、MMDetection等),配置ffmpeg,以及下载和组织预训练权重,用于MuseTalk的模型推理。

https://github.com/TMElyralab/MuseTalk?tab=readme-ov-file

https://github.com/TMElyralab/MuseTalk?tab=readme-ov-file

3849

3849

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?