“问渠那得清如许,为有源头活水来”,通过前沿领域知识的学习,从其他研究领域得到启发,对研究问题的本质有更清晰的认识和理解,是自我提高的不竭源泉。为此,我们特别精选论文阅读笔记,开辟“源头活水”专栏,帮助你广泛而深入的阅读科研文献,敬请关注。

论文题目:

Disentangled Federated Learning for Tackling Attributes Skew via Invariant Aggregation and Diversity Transferring

作者信息:

骆正权(中国科学技术大学,中科院自动化所),王云龙(中科院自动化所),王子磊(中国科学技术大学),孙哲南(中科院自动化所),谭铁牛(中科院自动化所)

收录会议:

39th International Conference on Machine Learning(ICML2022, to appear)

文章概要:

本文针对目前制约联邦学习发展的节点数据非独立同分布问题中较为复杂的属性倾斜因素,提出了共识表征提取和多样性传播的解构联邦学习框架(Disentangled Federated Learning,DFL)。

会议网址:

https://icml.cc/Conferences/2022

01

研究动机

1.1 研究背景

联邦学习作为目前最为火热的基于隐私安全保护的分布式架构收到了广泛关注,但是随着研究的深入,实际场景中节点数据分布之间往往存在巨大的非独立同分布性质(Non-iid),这一分布偏差给模型在联邦训练中带来了性能损失,收敛不稳定等一系列问题。

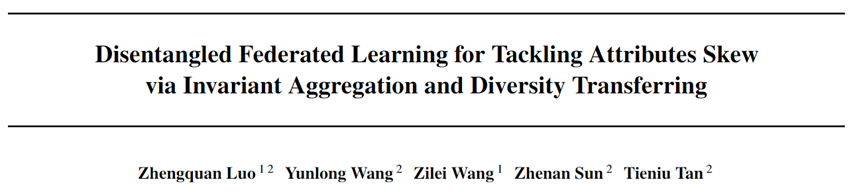

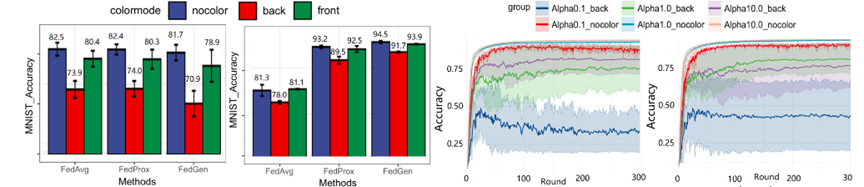

通过深入分析,我们对Non-iid因素做了细致的拆解,相比于较为明显的由类别不均衡造成的分布偏差而言,节点数据分布之间的属性偏差更加隐蔽同时也更难以克服。为了直观的体现出属性偏差所造成的性能损害,我们构建了一个属性倾斜的简单样例,首先对手写数字分类数据集MNIST按照节点进行均匀的划分,之后人工地针对不同节点的前景或背景进行染色,最后分别进行相同的联邦训练。实验结果可视化如图一所示,其表明即使是颜色属性这一原则上不应对数字分类造成影响的属性,当在节点数据分布中存在倾斜时实际上给模型分类准确性和收敛稳定性都带来了巨大的伤害。

图一&#x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

725

725

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?