基于深度学习的仪表盘识别

代码:https://github.com/HibikiJie/ReadMeter

权重文件:链接: https://pan.baidu.com/s/1wTPo1wJXrNyEFSu8RrD8Xw 密码: t0p4

将其放置于weight文件夹下,运行test.py,即可测试data\images\val下的图像文件

讲解

- 使用语义分割模型,在不同通道上分割出表盘和指针

- 环形的表盘展开为矩形图像

- 二维图像转换为一维数组

- 对刻度数组用均值滤波

- 定位指针相对刻度的位置

- 输出相对位置

语义分割模型采用的是U2Net

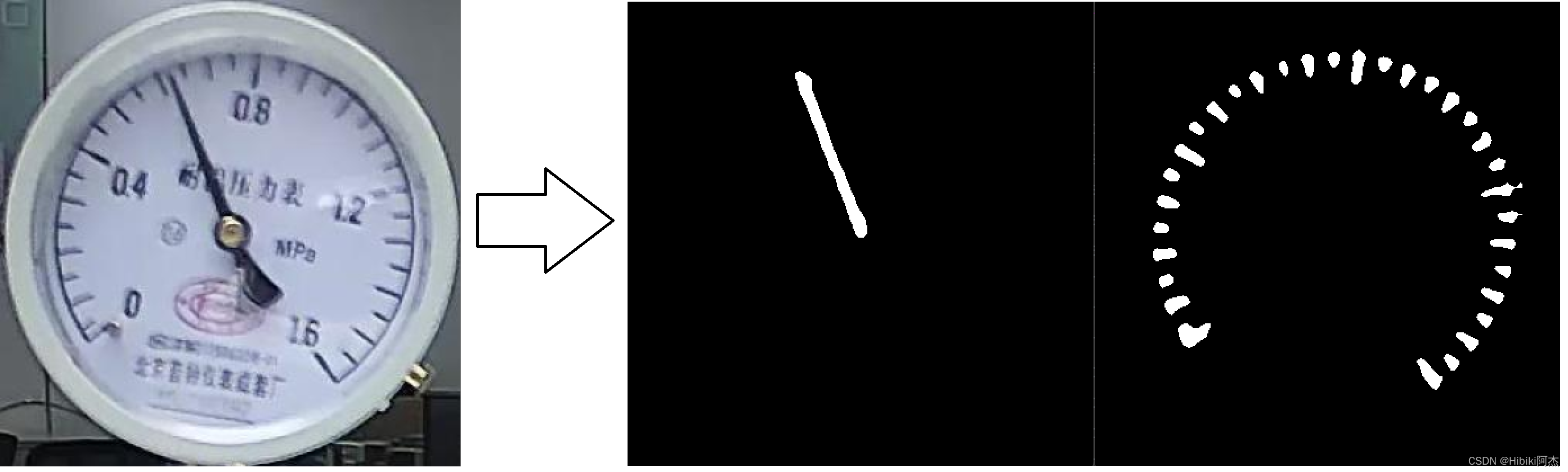

1、分割

使用U2NET分割得到指针和表盘的图像

2、表盘展开

通过以图像中心为原点,以一定宽度进行扫描,将仪表盘的刻度和指针展开为矩形的图像。

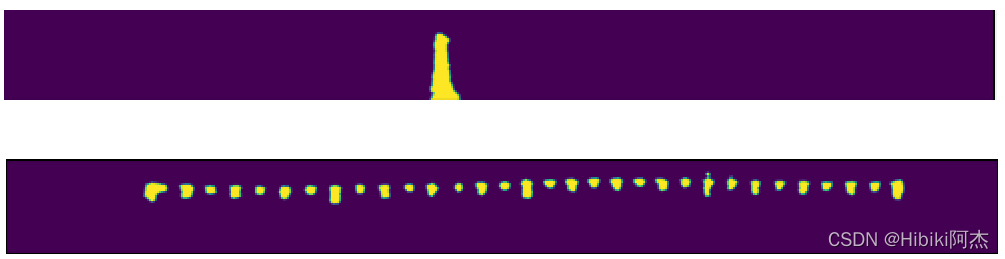

3、二维图像转换为一维数组

两张图像

本文介绍了一种基于深度学习的仪表盘读数识别方法,使用U2Net进行语义分割,将环形表盘展开成矩形并转换为一维数组。通过处理刻度和指针信息,定位指针相对位置,从而得出表盘的百分比数值。

本文介绍了一种基于深度学习的仪表盘读数识别方法,使用U2Net进行语义分割,将环形表盘展开成矩形并转换为一维数组。通过处理刻度和指针信息,定位指针相对位置,从而得出表盘的百分比数值。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?