模型评价指标---分类,聚类,回归

模型评价指标

- 模型在训练完成之后,如何评价这个模型对任务的匹配程度,用评价评价指标进行判断。不同的任务需要采取不同的评价指标,下面对不同的任务的评价指标做一个总结。

回归

- 回归的指标可分为三大类别:1.模型拟合优度评价 2.模型预测值和真实值之间差异的评价 3.极大似然法的估计准则

模型拟合优度评价(R方,改良R方)

- R 2 R^{2} R2

- 自变量可以解释因变量的比例,可以通俗地理解为使用均值作为误差基准,看预测误差是否大于或者小于均值基准误差。

R

2

=

1

−

S

S

E

S

S

T

R^{2} = 1-\frac{SSE}{SST}

R2=1−SSTSSE

其中

S

S

E

=

∑

(

y

i

−

y

i

^

)

2

SSE=\sum (y_{i}-\hat{y_{i}})^2

SSE=∑(yi−yi^)2 – 残差平方和,表示预测值和真实值之间的差异,差异越大,说明模型不能解释的部分越多。

S

S

T

=

∑

(

y

i

−

y

ˉ

)

2

SST=\sum (y_{i}-\bar{y})^2

SST=∑(yi−yˉ)2 – 总体平方和,表示数据分散的程度

S

S

R

=

∑

(

y

i

^

−

y

ˉ

)

2

SSR=\sum (\hat{y_{i}} -\bar{y} )^2

SSR=∑(yi^−yˉ)2 – 回归平方和,表示预测值的分散程度。

S

S

E

=

S

S

T

−

S

S

R

SSE = SST -SSR

SSE=SST−SSR

-

R

2

R^{2}

R2并不是R的平方,其值有正有负,

R 2 = 1 R^{2}=1 R2=1,预测值 == 真实值,模型对数据解释程度好

R 2 = 0 R^{2}=0 R2=0,预测值 == 真实值均值

R 2 < 0 R^{2} < 0 R2<0,模型等于盲猜,还不如直接求均值,数据可能不存在线性关系

- 改良版 R 2 R^{2} R2

- R 2 R^{2} R2随着自变量X(特征数)的个数增加, R 2 R^{2} R2会越来越大, R 2 R^{2} R2越来越大就会认为模型拟合越来越好,但是实际上可能是由于自变量个数的增加导致的 R 2 R^{2} R2增大。

R 2 = 1 − ( 1 − R 2 ) n − 1 n − k − 1 R^{2} = 1 -(1-R^{2})\frac{n-1}{n-k-1} R2=1−(1−R2)n−k−1n−1

- 调整后的 R 2 R^{2} R2同时考虑了样本量n和自变量个数k(特征数),且调整后 R 2 R^{2} R2不会随自变量个数的增大而增大。

预测值和真实值之间差异评价

- MSE 均方误差,又称L2范数损失

M S E = 1 n ∑ n i = 1 ( y i ^ − y i ) 2 MSE = \frac{1}{n} \sum_{n}^{i=1} (\hat{y_{i}} -y_{i})^{2} MSE=n1n∑i=1(yi^−yi)2 - RWSE 均方误差根

R M S E = 1 n ∑ n i = 1 ( y i ^ − y i ) 2 RMSE = \sqrt{ \frac{1}{n} \sum_{n}^{i=1} (\hat{y_{i}} -y_{i})^{2}} RMSE=n1n∑i=1(yi^−yi)2

- MSE对比于RMSE,RMSE消除了量纲的影响

- MAE 平方绝对误差

M A E = 1 n ∑ n i = 1 ∣ y i ^ − y i ∣ MAE = \frac{1}{n} \sum_{n}^{i=1} |\hat{y_{i}} -y_{i}| MAE=n1n∑i=1∣yi^−yi∣ - MAPE 平均绝对百分误差

M A E = 1 n ∑ n i = 1 ∣ y i ^ − y i y i ∣ MAE = \frac{1}{n} \sum_{n}^{i=1} |\frac{\hat{y_{i}} -y_{i}}{y_{i}}| MAE=n1n∑i=1∣yiyi^−yi∣

- MAE和RMSE一样,衡量的是真实值与预测值的偏离的绝对大小情况;而MAPE衡量的是偏离的相对大小(即百分率)

- 相对来说,MAE和MAPE不容易受极端值的影响;而MSE/RMSE采用误差的平方,会放大预测误差,所以对于离群数据更敏感,可以突出影响较大的误差值

极大似然法的估计准则(AIC,BIC)

- AIC 赤池信息准则

A I C = − 2 L L m a x + 2 k AIC = -2LL_{max} + 2k AIC=−2LLmax+2k - BIC 贝叶斯信息量准则

B I C = − 2 L L m a x + k l n ( N ) BIC = -2LL_{max} + kln(N) BIC=−2LLmax+kln(N)

- L L m a x LL_{max} LLmax对数似然估计值,k 是参数量,N是样本量

- 模型的AIC值和BIC值越小,说明模型估计越准确。

分类

- 混淆矩阵

| label | 预测正 | 预测负 | 合计 |

|---|---|---|---|

| 正例 | TP(真正例) | FN(假反例) | P(正元组) |

| 负例 | FP(假正例) | TN(真反例) | N(负元组) |

| TP+TN (总预测对的样本)FN+FP(总预测错的样本) P+N(总样本量) |

准确率(Accuracy)

- 准确率,也叫分类准确率,总预测对的样本/ 总样本数

T P + T N P + N \frac{TP+TN}{P+N} P+NTP+TN - 分类正确的样本占总样本个数的比例,最直观的评价指标,但同时存在明显的缺陷,这个评价指标很容易受到样本数量以及样本不均衡带来的影响

召回率(Recall)

- 召回率,也叫( 查全率,敏感度、真正例率)

T P P \frac{TP}{P} PTP - 分类正确的正样本个数占真正的正样本个数的比例

精度(Precision)

T P T P + F P \frac{TP}{TP+FP} TP+FPTP

- 分类模型中正确的正样本个数占分类器判定为正样本的样本个数的比例

F1分数

2 × p r e c i s i o n × r e c a l l p r e c i s i o n + r e c a l l \frac{2\times precision\times recall }{precision + recall} precision+recall2×precision×recall

-

精确率和召回率的加权调和平均数

-

为了通俗理解举个栗子:

1.地震,为了不漏报,宁愿报错不愿漏报,提升召回率(recall)

2.银行人脸识别:不能接受误检,提升精度(Precision)

在诊断为癌症的一堆人中,到底有多少人真得了癌症?—用Precision

在一堆得了癌症的病人中,到底有多少人能被成功检测出癌症?— 用recall

在一堆癌症病人和正常人中,有多少人被系统给出了正确诊断结果(患癌或没患癌)?— 用Accuracy

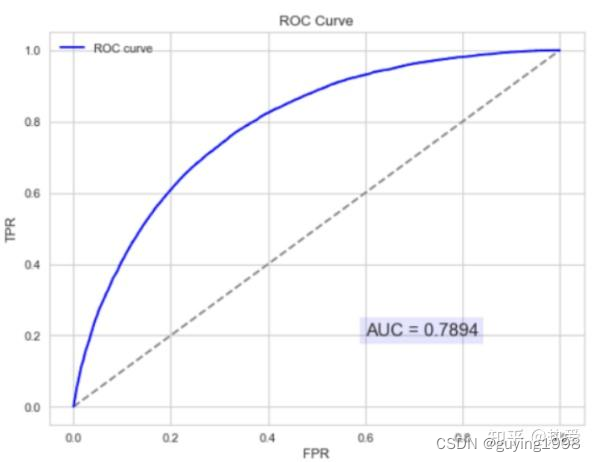

ROC曲线和AUC值

- ROC(Receiver Operating Characteristic,受试者工作特征)曲线,分类器性能的图形工具,它显示了在不同阈值下分类器的真阳性率(True Positive Rate,TPR)和假阳性率(False Positive Rate,FPR)之间的关系

- AUC值:AUC(Area Under the Curve)值表示ROC曲线下的面积,用于衡量分类器性能。AUC值越接近1,表示分类器性能越好;反之,AUC值越接近0,表示分类器性能越差。

聚类

轮廓系数

S = b − a m a x ( a , b ) S= \frac{b-a}{max(a,b)} S=max(a,b)b−a

- a是内聚度可以理解为反映一个样本点与类内元素的紧密程度。

b是分离度可以理解为反映一个样本点与类外元素的紧密程度 - 轮廓系数提供了对聚类质量的整体衡量范围[1,-1]之间,

类内的距离小于类间距离,则聚类结果更紧凑。S的值会趋近于1,接近1意味着紧凑且分离良好。

类内的距离大于类间距离,说明聚类的结果很松散。S的值会趋近于-1,越趋近于-1则聚类的效果越差

在0附近表示重叠。

本文详细介绍了模型评价指标在回归任务(如R方、R2、MSE、RMSE、MAE等)和分类任务(如准确率、召回率、精度、F1分数、ROC曲线和AUC值)中的应用,以及聚类评估中的轮廓系数。

本文详细介绍了模型评价指标在回归任务(如R方、R2、MSE、RMSE、MAE等)和分类任务(如准确率、召回率、精度、F1分数、ROC曲线和AUC值)中的应用,以及聚类评估中的轮廓系数。

5949

5949

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?