论文阅读 :mmFormer

论文阅读笔记】 mmFormer: Multimodal Medical Transformer for Incomplete Multimodal Learning of Brain Tumor Segmentation

原文代码地址链接: https://github.com/YaoZhang93/mmFormer

Abstract.

-

磁共振成像(MRI)精确分割脑肿瘤,是理想的联合学习的多模态图像。

-

在临床实践中,并不总是有可能获得一组完整的MRI,而缺失模态的问题导致了现有的多模态分割方法的严重性能下降

-

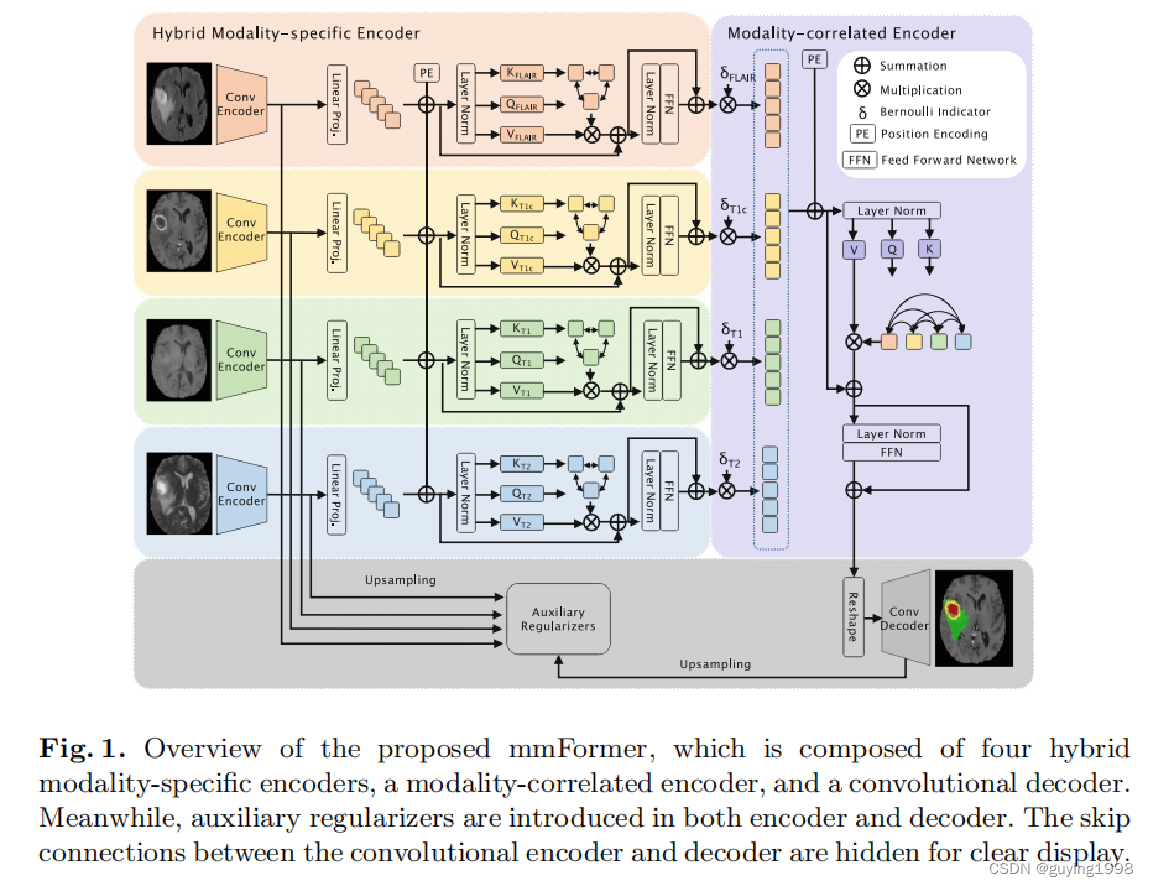

提出multimodal Medical Transformer (mmFormer)

(1)the hybrid modality-specific encoders:混合模态特定的编码器,用于连接卷积编码器和模态内转换器,用于每个模态内的局部和全局上下文建模

(2)an inter-modal Transformer:一种跨模态转换器,用于建立和对齐跨模态之间的模态不变特征与全局语义对应的长期相关性

(3)decoder:一种利用模态不变特征进行逐步上采样和融合以生成鲁棒分割的解棒器 -

在编码器和解码器中都引入了辅助正则化器,进一步提高了模型对不完全模态的鲁棒性

-

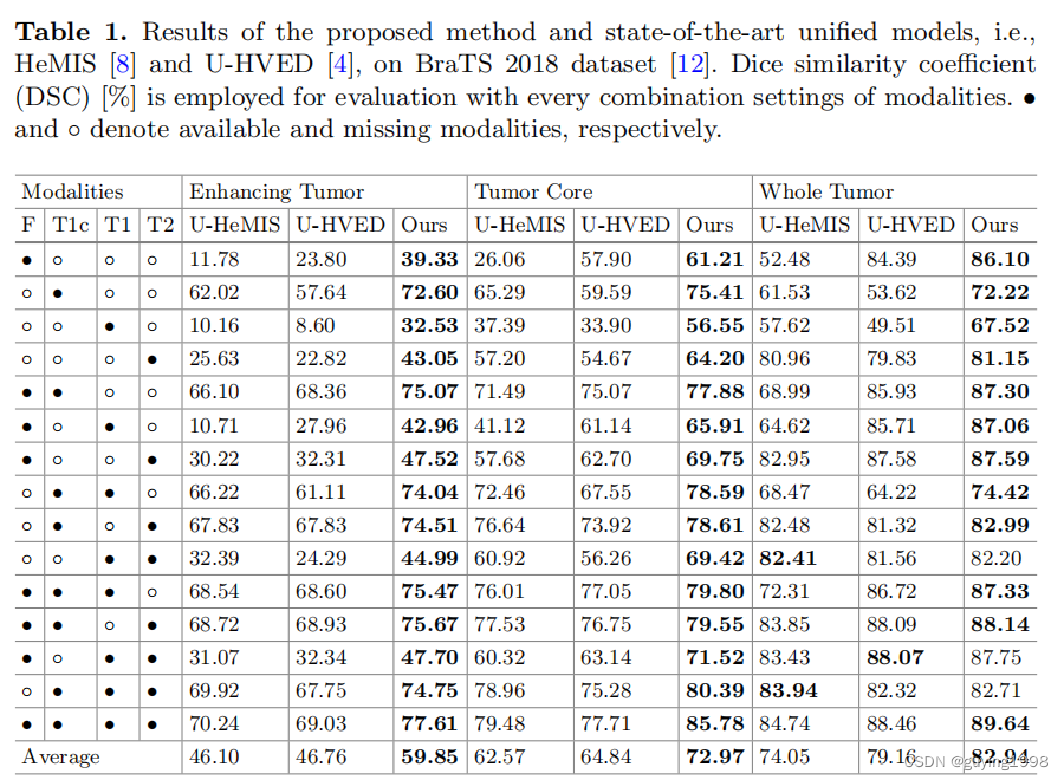

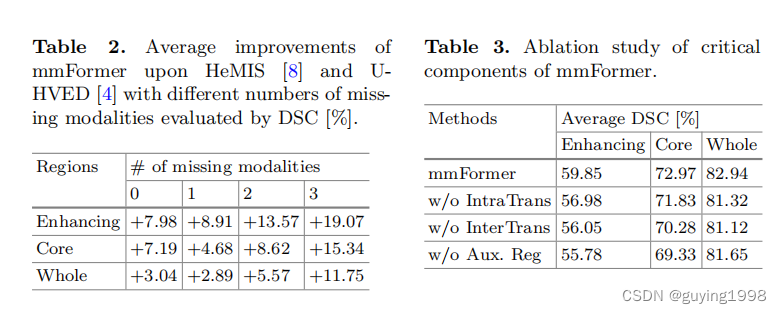

在BraTS 2018数据集上进行脑肿瘤分割实验。在几乎所有不完全模态子集上,提出的不完全模态脑肿瘤分割都优于最先进的方法,特别是在仅有一种可用模态的情况下,肿瘤分割平均提高了19.07%

一、Introduction

-

脑肿瘤磁共振成像(MRI)提供多种成像方式,T1、T1ce、T2和FLAIR图像。每一种成像方式都提供了大脑结构和病理的独特对比。多模态图像的联合学习对脑肿瘤的分割是必要的,可以显著提高分割性能。

-

有效地融合多模态mri用于脑肿瘤的分割,例如将通道维中的多模态图像连接作为潜在空间中的输入或融合特征(实践中并不总是可能获得一套完整的mri)。一种鲁棒的多模态方法灵活和实际应用临床与一个或多个缺失的模式

-

不完全多模态学习,

(1)通过生成模型合成缺失的模式

(2)探索从完整模式到不完整模式的知识蒸馏。

但这些方法必须为缺失模式的每个子集训练和部署一个特定的模型,这在临床应用中是复杂和繁琐的。

(3)自适应融合单模态模型集成学习来实现多模态分割。

然而,它只在一种或所有模式可用时工作。同时,所有这些方法在训练过程中都需要完整的模式 -

最近的方法侧重于学习一个统一的模型,而不是一堆提炼的网络,用于不完全多模态分割

(1)HeMIS

(2)U-HVED

(3)Fully Convolutional Network (FCN)

(4)Transformer -

文章工作

(1)提出了多模态医学变压器(mmFrorer),利用混合模态特定编码器和模态相关编码器来构建不同模态内和跨模态的远程依赖。通过显式地建立和对齐不同模态之间的全局相关性来提取模态不变表示,在mm格式中引入辅助正则化器,鼓励编码器和解码器即使在缺少一定数量的模态的情况下也能学习鉴别特征

(2)用BraTS 2018数据集验证,在所有缺失模式的设置中,该方法在平均骰子度量方面优于最先进的方法,特别是平均19.07%

(3)这是第一次尝试涉及到变压器的不完全多模态学习的脑肿瘤分割。

二、Method

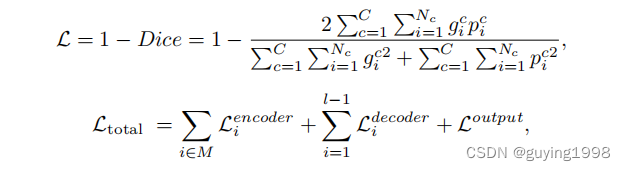

Auxiliary Regularizer

Experiments and Results

Conclusion

- 提出的mmFormer桥梁变压器和CNN来建立MRI图像不同模态内和跨的长期依赖,以实现模态不变表示。

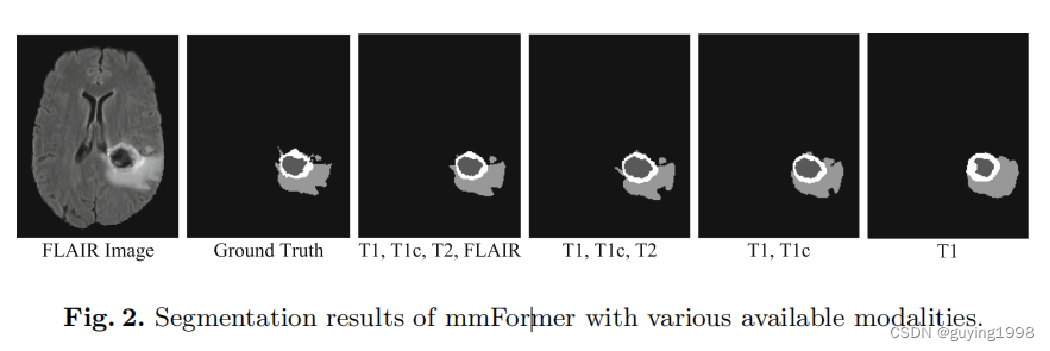

- 验证了方法在不同缺失模式组合下的脑肿瘤分割,它在BraTS基准上优于最先进的方法。当更多的模式缺失和/或目标模式更难以分割时,我们的方法获得了更多的改进。

851

851

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?