实例分割YOLACT/YOLACT++环境配置

简介

YOLACT是ICCV2019接收的实时实例分割论文,近期该文作者又对此进行了拓展

提出了YOLACT++,其resnet50模型在Titan Xp上的运行速度达到33.5fps,

在COCO的test-dev数据集上达到34.1mAp,并开源了代码

YOLACT:https://arxiv.org/abs/1904.02689.

YOLACT++:https://arxiv.org/abs/1912.06218.

DCN:https://arxiv.org/abs/1703.06211.

YOLACT Code:https://github.com/dbolya/yolact/.

DCN Code: https://github.com/msracver/Deformable-ConvNets.

环境配置

我配置使用的系统是linux服务器,cuda版本为10.1

使用anaconda创建虚拟环境,git clone代码就不多说了

我这里创建的python环境还是python=3.6

conda create -n 09yolact python=3.6

conda activate 09yolact

我这里配置的torch=1.5.0 torchvision=0.6.0

pip install torch==1.5.0+cu101 torchvision==0.6.0+cu101 -f https://download.pytorch.org/whl/torch_stable.html -i https://pypi.tuna.tsinghua.edu.cn/simple

最后再配置一些依赖

pip install cython

pip install opencv-python pillow pycocotools matplotlib

图片评估

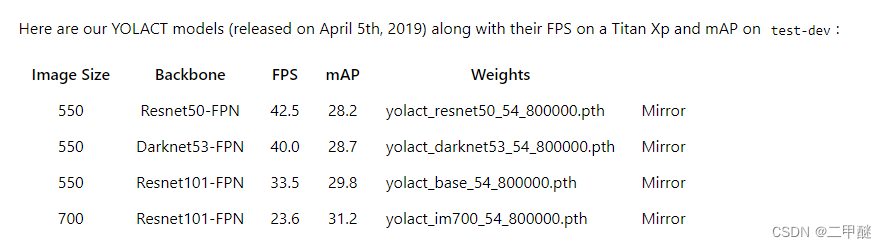

去官网下载权重文件

由于下载链接都是谷歌,所以想要下载还是需要一些科技的,都是学计算机的,大家应该有办法吧

yolact_resnet50_54_800000.pth

yolact_darknet53_54_800000.pth

yolact_base_54_800000.pth

yolact_im700_54_800000.pth

还有两个YOLACT++的我就不一一列举了,大家可以去github上下载

下载完毕后,将权重文件放在目录下的weights文件夹中

这里我选用的是yolact_base_54_800000.pth

接着我们就可以测试一下,我们是否可以进行正常的evaluate了

新建input文件夹 和output文件夹,将想要预测的图片文件放入input文件夹

python eval.py --trained_model=weights/yolact_base_54_800000.pth --score_threshold=0.15 --top_k=15 --images=input:output

升级YOLACT++

If you want to use YOLACT++, compile deformable convolutional layers (from DCNv2). Make sure you have the latest CUDA toolkit installed from NVidia's Website.

下载与自己版本对应的DCNv2

放入到yolact/external/DCNv2 文件里面

进入DCNv2文件内,输入python setup.py build develop进行编译

这里我的版本是torch1.5,所以我进入github上找了一个torch1.5版本的下载

cd external/DCNv2

python setup.py build develop

.....

Installed .....

Processing dependencies for DCNv2==0.1

Finished processing dependencies for DCNv2==0.1

735

735

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?