Domainbed

DomainBed是一个开源的机器学习实验框架,旨在简化领域适应(Domain Adaptation)任务的实验设置。领域适应是一种机器学习技术,它涉及到在源领域(source domain)训练模型,然后将其应用到目标领域(target domain),尽管这两个领域的数据分布可能有所不同。DomainBed旨在提供一个统一的界面,以便研究人员可以轻松地比较不同的领域适应算法。

DomainBed的主要特点包括:

一致性:提供一个标准化的实验设置,以便在不同的工作中保持一致性。

模块化:设计为模块化,允许用户轻松替换不同的组件,如数据加载器、预处理步骤、模型架构、训练算法等。

可扩展性:支持自定义扩展,使得用户可以根据自己的需求添加新的功能。

易于使用:提供一个简单的命令行界面,使得用户可以快速启动实验并比较不同算法的性能。

DomainBed通常用于评估领域适应算法的性能,特别是在视觉识别任务中,但它也可以用于其他类型的领域适应问题。通过使用DomainBed,研究人员可以更容易地复现和比较不同方法的效果,从而推动领域适应领域的发展。

“Sharp minima” 和 “Flat minima” 还有“narrow minima”

是两种不同类型的极小值:

Sharp Minima(尖锐极小值): 这种情况下,损失函数在极小值点附近非常陡峭,即函数曲线在该点的局部区域内急剧上升。这可能导致模型对输入数据中的微小扰动非常敏感,因为即使在极小值点周围微小的参数变化也可能导致较大的损失增加。在这种情况下,训练过程可能会更加不稳定,容易受到噪声和初始化的影响。

Flat Minima(平坦极小值): 相比之下,平坦极小值对应的损失函数曲线在极小值点附近相对平缓。在这种情况下,模型对参数的微小变化相对不敏感,使得训练过程更加稳定。

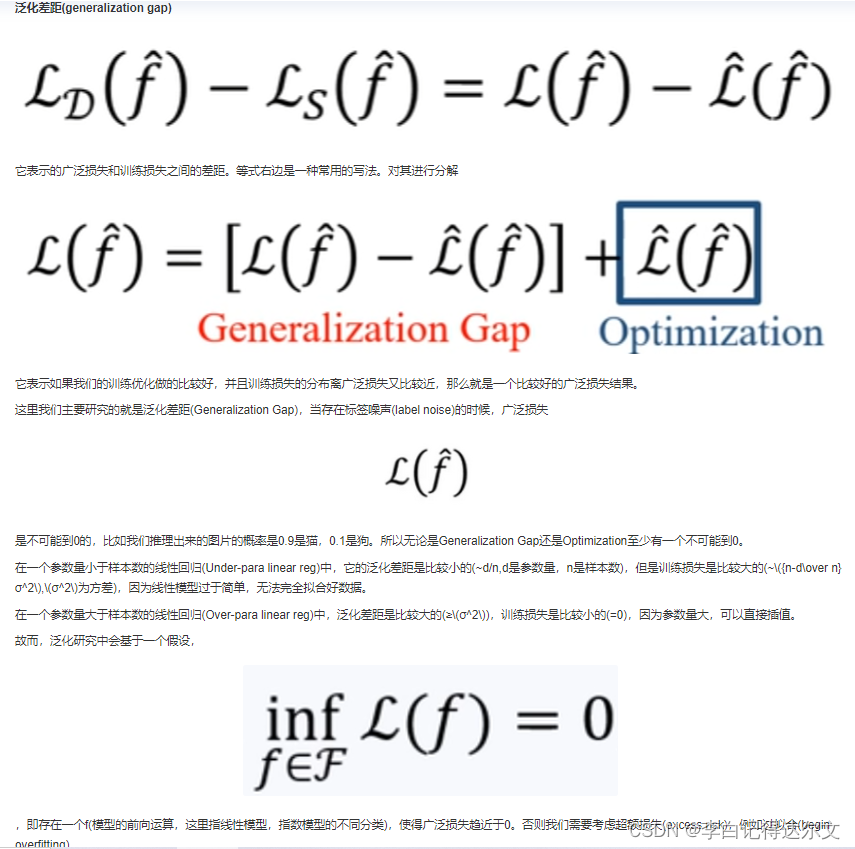

泛化差距 generalization gap

loss landscape

“Loss landscapes” 是指神经网络模型参数空间中的损失函数的拓扑结构或几何形状。损失函数是在训练神经网络时使用的一个关键指标,它度量了模型在给定数据上的性能。Loss landscapes 研究试图理解神经网络损失函数的形状,以及在参数空间中的各种属性和性质。

研究 Loss landscapes 的目标之一是探索训练过程中的优化挑战。这包括查看损失函数是否存在多个局部极小值(local minima)、鞍点(saddle points)或者其他结构。这些结构可能影响训练的收敛速度、模型的泛化性能以及训练的稳定性。

以下是 Loss landscapes 研究中一些关键概念:

局部极小值(Local Minima): 指在参数空间中的某一点附近,损失函数值比该点周围所有其他点的值都要小。研究表明,深度神经网络的损失函数通常有许多局部极小值。

鞍点(Saddle Points): 在参数空间中的某一点,沿着一些方向是极小值,而沿着其他方向是极大值。这种点对于梯度下降等优化算法来说可能是具有挑战性的,因为梯度接近于零。

梯度的消失和爆炸: 在深度神经网络中,梯度的消失和爆炸是两个常见问题,它们与 Loss landscapes 的结构密切相关。这些问题可能导致训练困难或不稳定。

通过研究 Loss landscapes,研究人员试图找到更好的优化算法、初始化策略以及模型架构,以更有效地训练深度神经网络。

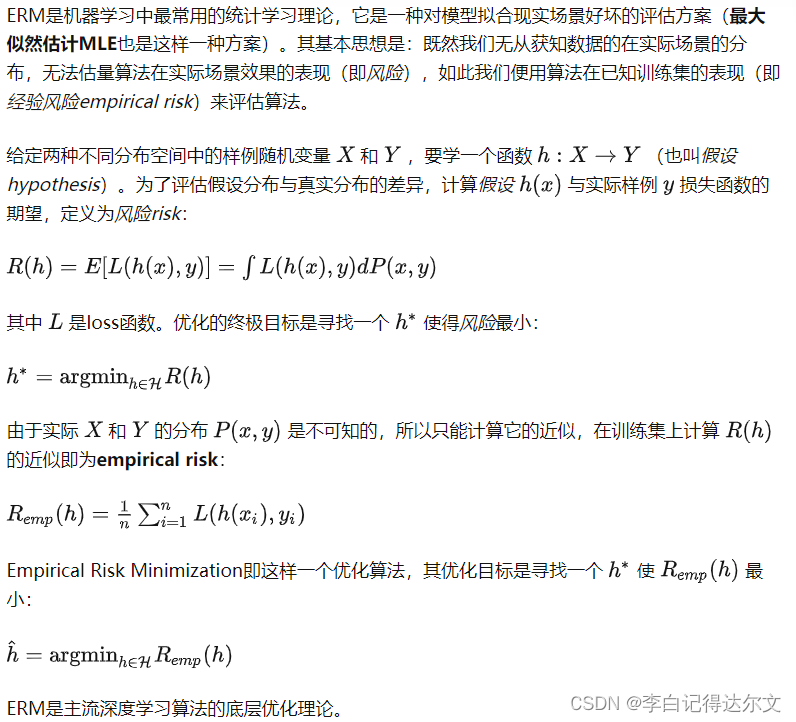

ERM

最小化平均预测损失。。

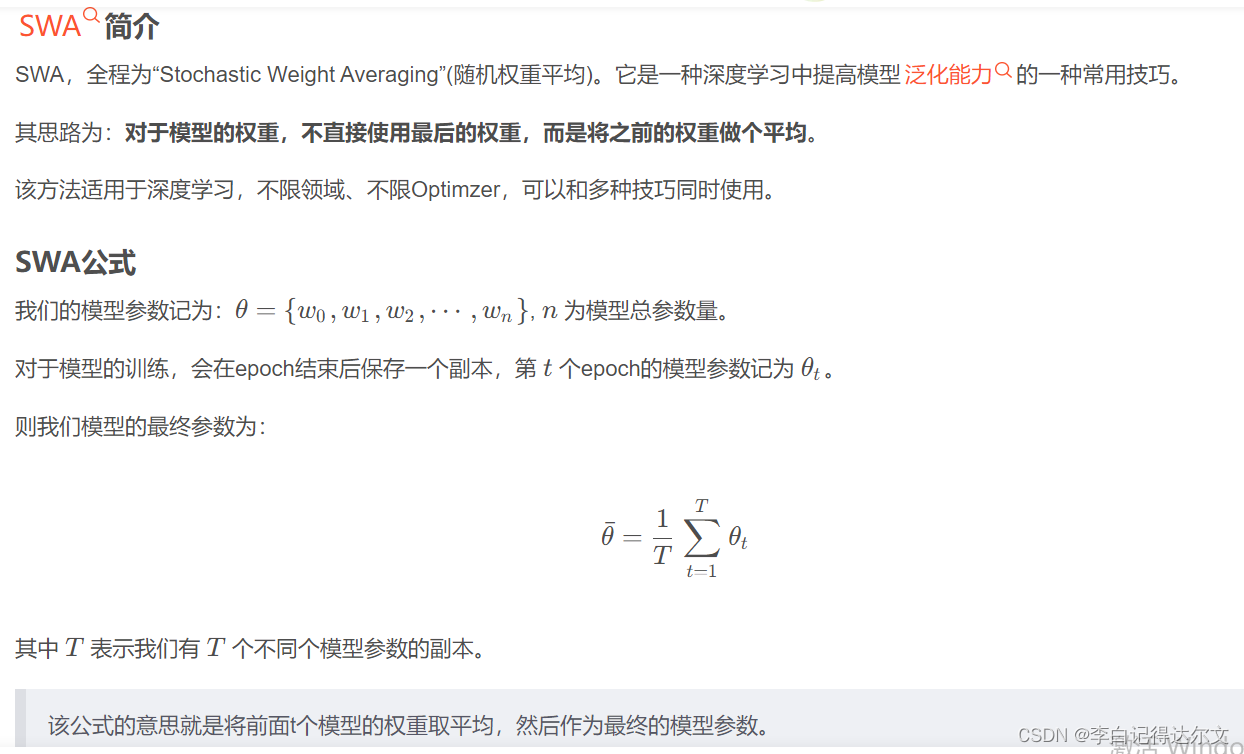

SWA

随机权重平均

随机体现在随机选择多个时间点t。

1678

1678

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?