首先附上InternLM的github连接:

接下来是第一次课程的笔记,主题为《书生·浦语全链条开源开放体系》,本次课程内容仅为介绍性质,供了解和参考。

一、InternLM出现的背景?

历史背景:大模型已经从传统的专用模型(针对特定任务,即一个模型解决一个问题)转变为通用模型(一个模型应对种任务多种模态)

现实的严峻:

1. 尽管现在有许多诸如ChatGPT,GPT-4等流行的大模型在语言模型领域做出了史无前例的创举,但包括OpenAI和Google这些大公司对于技术共享还是相当保守

2. 其他诸如GLM-130B,BLOOM,LLaMA模型的性能显著低于OpenAI的模型,它们对于一些具有挑战性的工作(比如多语义理解,复杂的解释说理和阅读理解等)方面的表现不尽人意。

二、InternLM的相关信息

1. 自从2023年6月7日至今的发展历程

图1 发展历程

2. 书生·浦语大模型系列

图2 三种语言模型

对于轻量级的模型,是社区低成本可用的最佳模型规模;若稍微大一点的项目可采用中量级,其为商业场景可开发定制的高精度较小模型规模;最好的便是重量级,为通用大语言模型,能力全面覆盖千亿模型规模

其性能的对比如图3所示:

图3 语言模型性能对比

三、从模型到应用。。。

图4 从模型到应用的流程

对于从模型到具体应用的流程,参数微调和是否环境交互的选择最为重要,因为不同的任务有不同的特点,而任务特点便决定了我们应该如何将大模型为己所用。

四、书生·浦语全链条开源开放体系

图5 全链条框架总结

图6 预训练和微调对比

图7 测评环节各层介绍

图8 测评支持的机构

图9 测评模型支持

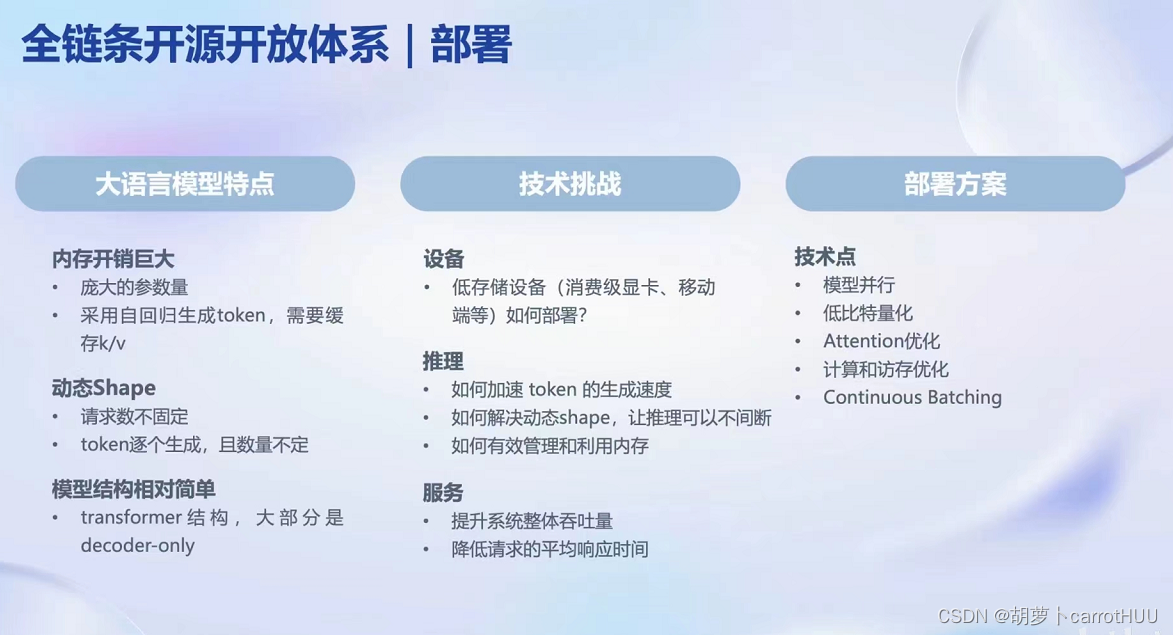

图10 模型部署

图11 LMDeploy部署框架

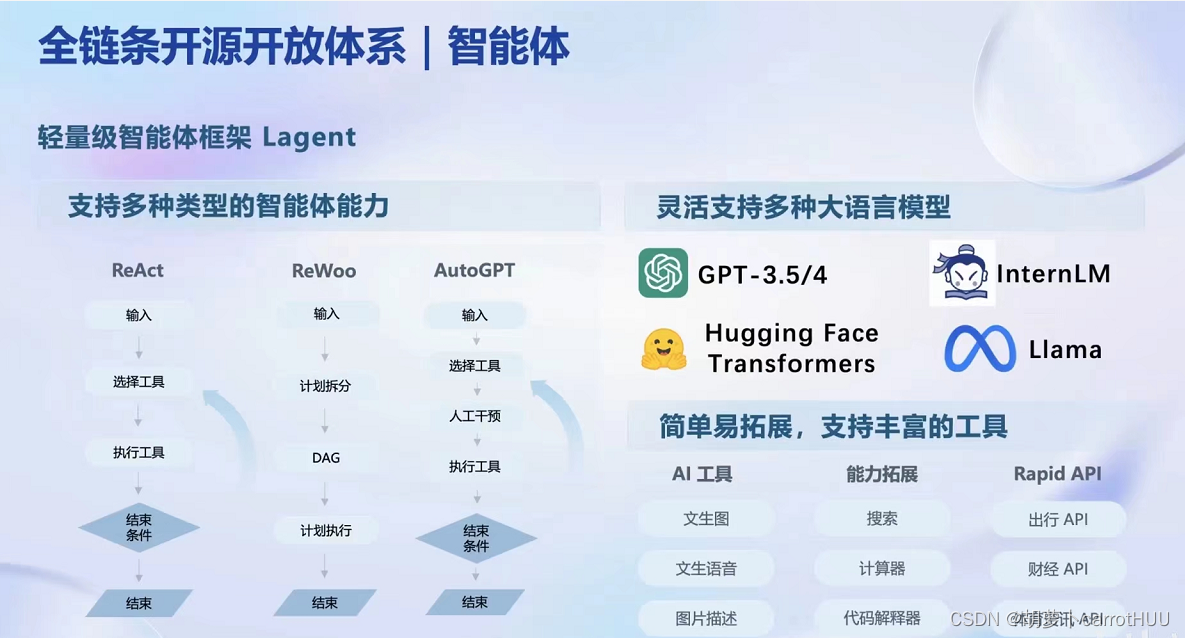

图12 智能体

所有内容都是参考来自:

论文:InternLM-techreport/InternLM.pdf at main · InternLM/InternLM-techreport (github.com)

视频:书生·浦语大模型全链路开源体系_哔哩哔哩_bilibili

官网:InternLM

112

112

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?