正式进入开集识别研究了,读的第一篇文章是《Recent Advances in Open Set Recognition: A Survey 》这篇综述,第二篇就是这篇2016CVPR的《Towards Openset Deep Networks》,创造性地提出了OpenMax,理解起来还是有一定深度

原文链接:https://arxiv.org/abs/1511.06233v1

Abstract

深度网络为各种视觉识别问题带来了巨大的收获,从而产生了极具影响力的学术和商业应用。最近,在深度网络上的工作强调,其很容易产生人类永远不会将其分类为特定对象类别的图像,但网络会将此类图像分类为给定类别的高可信度图像——深度网络很容易被人类认为没有意义的图像所欺骗。深度网络的闭集性质迫使它们从已知类中进行选择,导致了这样的结果。现实世界中的识别是开放的,即识别系统应在测试时拒绝未知/不可见的类。我们提出了一种方法,通过引入一个新的模型层OpenMax来调整深度网络使其适用于开放集识别,该模型层估计来自未知类的输入的概率。估计未知概率的一个关键因素是使元识别概念适应网络倒数第二层的激活模式。OpenMax允许拒绝呈现给系统的“欺骗”和无关的开放集图像;OpenMax大大减少了深度网络造成的明显错误数量。我们证明了OpenMax概念提供了有界的开放空间风险,从而正式提供了一个开放集识别解决方案。我们使用ImageNet 2012验证数据上的Caffe Model-zoo预训练的网络,以及数千张欺骗和开放集图像,来评估得到的开放集深度网络。提出的OpenMax模型精度明显优于基础深度网络的开放集和具有SoftMax概率阈值的深度网络。

1. Introduction

计算机视觉数据集已经从几百张图像发展到数百万张图像,从少数类别发展到数千个类别,这得益于∗在科罗拉多大学科罗拉多斯普林斯分校进行的研究部分,由NSF IIS-1320956资助。Abhijit Bendale目前在三星美国研究院(Samsung Research America,Mountain View,CA vision and learning)任职。最近对深度网络的研究显著改善了视觉识别的许多方面[26,3,11]。丰富的表示、可扩展的分类方法和大型数据集的共同发展产生了许多商业应用[5,28,16,6]。然而,在动态和不断变化的现实世界中部署识别系统时,会遇到各种各样的挑战。绝大多数识别系统都是为静态封闭世界设计的,其中的主要假设是所有类别都是先验已知的。与许多经典的机器学习工具一样,深度网络被设计为执行闭集识别。

最近关于开放集识别[20,21]和开放世界识别[1]的工作,已经规范了在测试中需要拒绝未知对象的设置中执行识别的过程。虽然人们总是可以用“其他”类来训练不感兴趣的类(已知的未知),但不可能用未知对象的所有可能示例来训练。因此,需要设计视觉识别工具,正式解释“未知的未知”[18]。尽管已经开发了一系列算法来解决这个问题[4,20,21,25,2],但使用深度网络进行开放集识别仍然是一个未解决的问题。

在大多数深度网络[11,26,3]中,最后一个全连接层的输出被输送给SoftMax函数,该函数在N个已知类标签上产生一个概率分布。虽然深度网络总是有一个概率最大的类,但人们可能希望对于未知输入,所有的类都有低概率,不确定性阈值将拒绝未知类。最近的论文已经展示了如何生成“愚弄”[14]或“垃圾”[8]图像,这些图像在视觉上远离所需的类别,但会产生高概率/置信度分数。它们强烈地表明,对不确定性使用阈值并不足以确定未知的东西。在第3节中,我们展示了将深度网络扩展到SoftMax概率阈值在一定程度上改善了开放集识别,但并没有解决欺骗图像的问题。在深度网络的理论/实践中,即使有阈值概率,也没有任何东西满足[20]中提供的开集识别的形式化定义。这引出了本文提出的第一个问题,“如何使深度网络支持适应开放集识别?”

SoftMax层是问题的重要部分,因为其封闭性。我们提出了一种替代方案OpenMax,它通过使SoftMax层能够预测未知类来扩展SoftMax层。OpenMax包含了识别系统故障的可能性。该似然性用于估计给定输入属于未知类的概率。对于这种估计,我们将元识别的概念[22,32,9]应用于深度网络。我们使用深度网络倒数第二层(SoftMax之前的全连接层,例如FC8)的分数来估计输入是否“远离”已知的训练数据。我们将该层中的分数称为激活向量(A V)。这些信息被纳入我们的OpenMax模型中,用于描述识别系统的故障。通过取消已知类的概率总和为1的限制,并拒绝远离已知输入的输入,OpenMax可以在操作过程中正式处理未知/不可见的类。我们的实验表明,提出的OpenMax和元识别思想的组合很容易解决深度网络的开放集识别问题,并拒绝高置信度欺骗图像[14]。

虽然对人类观察者来说,欺骗/垃圾图像显然不是来自一个类别,但对抗性图像[8,27]提出了一个更困难的挑战。这些对抗性图像在视觉上与训练样本无法区分,但其设计使得深度网络产生高可信度但不正确的答案。这与标准的开放空间风险不同,因为对于任何给定的输出类,对抗图像都“接近”输入空间中的训练样本。

TIPS: 开放空间风险:将该空间中的任何样本任意标注为KKC必然会带来的风险

我们开放深度网络的一个关键观点是,“开放空间风险”应该在特征空间中衡量,而不是在像素空间中衡量”。在先前的工作中,对于大多数问题[20,21,1],未在像素空间中测量开放空间风险。因此,我们提问:“是否存在一个特征空间,理想情况下是深度网络中的一个层,其中这些对抗性图像远离训练样本,即,在开放集识别问题中,未知、欺骗和对抗性图像成为异常值的层?”在第2.1节中,我们研究了深度网络中用于测量开放空间风险的特征空间/层的选择。我们表明,在倒数第二层的整体激活模式上,一个极值元识别启发的距离归一化过程为OpenMax归一化提供了一个拒绝概率,用于未知图像、欺骗图像甚至许多对抗图像。在图1中,我们展示了我们的模型的激活模式,输入图像,欺骗图像,对抗图像(系统可以拒绝)和开放集图像的例子。

总之,本文的贡献是:

1.使用AV的多类元识别来估计深度网络故障的概率

2.使用元识别和OpenMax对开放集深度网络进行形式化,并证明所提出的方法可以管理深度网络的开放空间风险

3.开放集深度网络在拒绝未知类、欺骗图像和对抗图像中的明显错误,同时保持其测试图像的准确性方面的有效性的实验分析

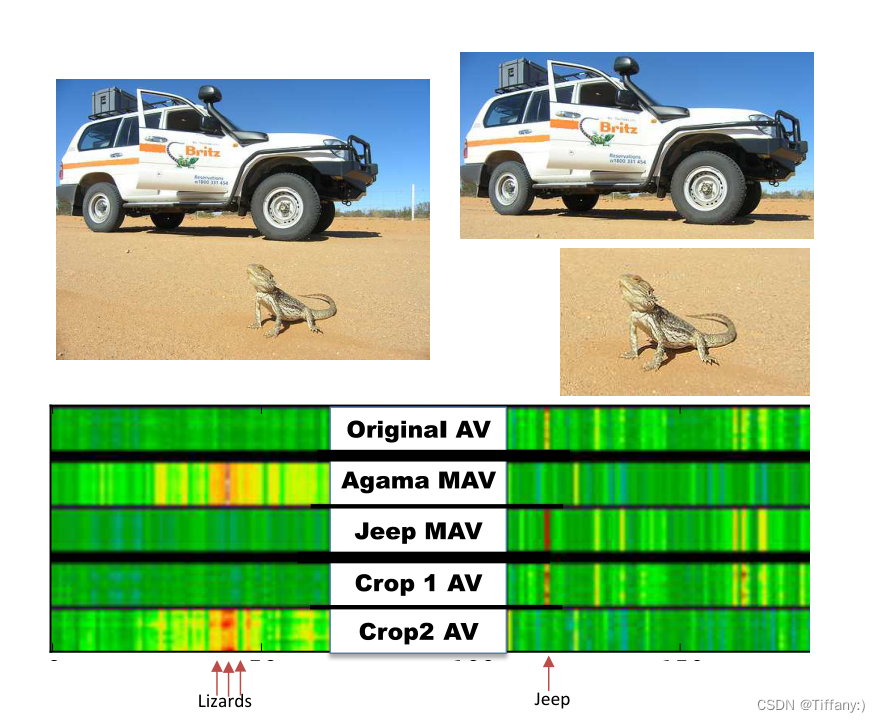

图1 示例展示了激活向量模型如何为我们的元识别和深度网络的OpenMax扩展提供足够的信息,以支持开集识别。OpenMax算法测量输入的激活向量(A V)与前几个类的模型向量之间的距离,调整分数并提供未知概率的估计。左边显示了不同图像的激活向量(A V),不同的A V由黑线分隔。每个输入图像变成一个A V,显示为10x450个彩色像素,垂直方向为10个深度网络通道激活能的每一个像素,水平维度显示前450个ImageNet类的响应。各种类别指数(鲨鱼、鲸鱼、狗、鱼等)的范围被识别在图像的底部。对于四个类别(棒球,锤头鲨,大白鲨和潜水员)中的每一个,我们为4种类型的图像显示AV:模型,真实图像,欺骗图像和开集图像。av显示的激活模式中,对于真实图像,相关类别通常是同时响应的,例如,鲨鱼具有许多视觉特征,因此与其他鲨鱼、鲸鱼、大型鱼类有相关反应,但与狗或棒球没有关联。对AV的视觉检查显示,与真实图像或模型AV相比,欺骗和开放集合图像的响应模式存在显著差异。例如,注意许多愚弄图像中较暗(深蓝色)的线,以及许多开放集合图像中不同的绿色模式。下面的AV来自一张“对抗性”图像,其中一个锤头鲨的图像通过添加几乎看不见的像素变化,被转换成某种类型的水肺潜水员。右边的两列显示了两个类的相关图像。每个示例都显示了真实图像的SoftMax (SM)和OpenMax (OM)分数,真实图像是产生AV的欺骗和开放集合图像,如左侧所示。红色的OM分数表明OM算法将图像分类为未知,但为了完整起见,我们显示了棒球/锤头类的OM概率,因为最初存在混淆。右下角显示了对抗图像及其相关评分——尽管网络将其归类为水肺潜水员,但视觉上与锤头鲨的相似性显然更强。OpenMax拒绝接受外界给它的对抗图像,认为它是水肺潜水员群体中的异类。作为从故障中恢复的例子,我们注意到,如果图像是高斯模糊的,OpenMax将其归类为锤头鲨,OM概率为.79。

2. Openset Deep Networks

打开深度网络的自然方法是对输出概率应用阈值。我们认为这是拒绝不确定的预测,而不是拒绝未知的类。预计来自未知类别的图像都具有低预测概率,即非常不确定。这仅适用于一小部分未知输入。我们在第3节中的实验表明,阈值化不确定输入有帮助,但对于开放集识别来说仍然是相对较弱的工具。Scheirer等人[20]将开放空间风险定义为与标记数据相关的风险,这些数据与已知训练样本“相距甚远”。这项工作只提供了一个一般的定义,并没有规定如何测量距离,也没有规定测量距离的空间。为了使深度网络适应开放集识别,我们必须确保它们管理/最小化其开放空间风险,并具有拒绝未知输入的能力。

基于[21,1]中的概念,我们寻求选择一个层(特征空间),在该层中我们可以建立一个紧凑的衰减概率模型,该模型可以被阈值化以限制开放空间风险。我们将该模型发展为基于与学习模型的距离的衰减概率模型。在下一节中,我们详细介绍了用于估计已知训练数据距离的空间和元识别的方法,然后介绍了将这种距离纳入深度网络决策函数的方法。我们将此方法称为OpenMax,这是SoftMax函数作为网络最后一层的替代方案。最后,我们证明了整个模型是一个紧凑的衰减概率模型,因此,它满足开放集识别的定义。

2.1 Multi-class Meta-Recognition

我们的第一步是确定什么时候输入可能不是来自已知的类,也就是说,我们想添加一个元识别算法[22,32]来分析分数,并识别深度网络在评估中可能是错误的情况。先前的元识别研究使用最终的系统得分,基于极值理论(EVT)分析其分布,发现服从Weibull分布。虽然可以单独使用每个类的分数,并使用EVT考虑它们的分布,但这不会产生紧凑的衰减概率,因为欺骗图像显示分数本身不是来自一个接近已知的输入训练数据的紧凑空间。此外,在类后识别分数集(SoftMax层)上的直接应用EVT拟合对于深度网络没有意义,因为最终SoftMax层被有意地重新规范化以遵循逻辑分布。因此,我们分析倒数第二层,这通常被视为每类估计。SoftMax函数将每类估计转换为最终输出概率。

TIPS:元识别:判断某个模型分类失败的概率

我们采用的方法是,倒数第二层的网络得分(以下称为激活向量(A V))不是独立的每类分数估计,而是提供了什么类是“相关”的分布。在第2.2节中,我们讨论了基于图1的示例。我们的整体EVT元识别算法总结在Alg1。为了使用AV识别异常值,我们调整最近类均值[29,12]或最近非异常值[1]的概念,并将它们作为第一近似值应用于激活向量内的每个类。虽然更复杂的模型,如最近类多重质心(NCMC)[13]或NCM森林[17],可以提供更准确的建模,但为了简单起见,本文侧重于仅使用单个均值。每个类表示为一个点,一个平均激活向量(MAV),其平均值仅在正确分类的训练示例上计算(算法1的第2行)。

TIPS:MAV不仅可以代表每个类,还表示类与类之间的相关性

给定MAV和输入图像,我们测量它们之间的距离。我们可以直接对距离应用阈值,例如使用[1]的跨类验证方法来确定总体最大距离阈值。在[1]中,对特征进行度量学习以使其标准化,这使得单个共享阈值可行。然而,不同类别的A V缺乏一致性带来了更大的挑战,因此,我们寻求一个多类元识别模型。特别地,在Alg. 1的第3行,我们使用libMR [22] FitHigh函数对所有正确的正训练实例与相关的µi之间的最大距离进行威布尔拟合。这就产生了一个参数ρi,用来估计一个输入相对于类i是异常值的概率。

TIPS::用于估计输入相对于类别i是异常值的概率

给定ρi,一个简单的拒绝模型将由用户定义一个阈值,该阈值决定输入是否应被拒绝,例如,确保90%的所有训练数据被拒绝为异常值的概率接近0。虽然实现简单,但很难校准绝对元识别阈值,因为它取决于未知的未知因素。因此,我们选择在第2节所述的OpenMax算法中使用该算法,该算法可以连续调整。

我们注意到,我们的校准过程仅使用正确分类的数据,其中类别j为等级1。在测试中,对于输入x,假设类别j具有最大概率,则ρj(x)提供了MR估计的概率,即x是离群值,应予以拒绝。我们对更高的排名(例如,前10名)使用一个校准,但作为扩展,可以对不同级别进行单独校准。注意,当每个示例有多个通道时,我们计算每个通道每类平均向量µj,c和威布尔参数ρj,c。值得记住的是,目标不是确定输入的训练类别,而是一个元识别过程,用于确定给定输入是否来自未知类别,因此应予以拒绝。

2.2 Interpretation of Activation Vectors

在本节中,我们介绍了激活向量和元识别的概念以及基于图1的示例。

闭集:假设输入是有效的输入,例如锤头鲨,即图1中的第二组激活记录。激活向量显示了与大白鲨相关的AV的高分。所有鲨鱼都与其他鲨鱼、鲸鱼和大型鱼类共享许多直接视觉特征和许多上下文视觉特征,这就是为什么图1显示了这些组中许多ImageNet类别的多次较高激活(亮黄绿色)。我们假设,对于大多数类别,存在相对一致的相关激活模式。MAV将该分布捕获为单个点。AVs表示一个空间,在该空间中,我们根据每个类的激活来测量与输入图像的距离;如果是一条大白鲨,我们也希望虎鲨、锤头鲨和鲸鱼的激活率更高,但鸟类或棒球的激活率很低或没有。直觉上,这似乎是在训练中测量距离的合适空间。

开放集:首先让我们考虑一个开放集图像,即来自未知类别的真实图像。这些将始终由深度网络映射到SoftMax提供最大响应的类别,例如,图1中的岩石图像映射到棒球,右侧的鱼映射到锤头。有时,开放集图像的置信度较低,但最大分数将产生相应的类。将输入的激活向量与输入产生最大响应的类别的MAV进行比较,我们观察到它通常远离平均值。然而,对于一些开放集图像,所提供的响应接近于AV,但仍具有总体低激活水平。如果输入是与已知类密切相关的“未知”类,或者对象小到无法很好地区分,则会发生这种情况。例如,如果输入来自不同类型的鲨鱼或大鱼,它可能会提供低激活,但AV可能不足以被拒绝。因此,除了直接估计类别是否未知之外,还需要对阈值不确定性进行开集识别。

欺骗集:考虑一个欺骗输入图像,该图像是人为创造的,以使特定类(例如,棒球或锤头)具有高激活分数,因此,可以以高置信度检测。虽然人工构造增加了感兴趣类别的概率,但图像生成过程并没有同时调整所有相关类别的分数,从而导致AV与模型AV“相去甚远”。检查图1中每个类组的第三个元素,其中显示了来自愚弄图像的激活。许多愚弄性的图像在视觉上是截然不同的,它们的激活向量也是如此。许多激活率非常低的区域(深蓝色/紫色)很可能是因为可以通过减少其他类的激活来增加给定类的SoftMax输出,这反过来又减少了SoftMax计算的分母。

对抗集:最后,考虑一个对抗输入图像[8,27,31],它被构造为接近一个类,但被错误地标记为另一个类。图1右下角显示了一个示例。如果将敌对图像构建到附近的类,例如从锤头到大白鲨,那么本文提出的方法将无法检测其问题——MAV中未捕捉到细粒度类别差异。然而,对抗性图像可以在任何一对图像类之间构建,参见[27]。当目标类足够远时,例如这里的锤头和潜水示例,或者更远的地方,例如锤头和棒球,对抗性图像将在激活分数上有显著差异,因此可以被拒绝。在我们的实验中,我们不考虑对抗性图像,因为结果更多地取决于我们选择生成的对抗性图像——而且我们知道没有任何有意义的分布。例如,如果我们选择随机的类对(a,b)并生成从a到b的对抗图像,那么这些图像中的大多数将具有较大的层次距离,并且可能被拒绝。如果我们选择最接近的对抗图像,很可能来自附近的类别,激活将是接近的,它们不会被拒绝。【无法识别细粒度差异】

我们OpenMax过程的结果是,开放集以及欺骗或对抗图像通常都会被拒绝。建立一个不被拒绝的欺骗或对抗图像不仅意味着获得感兴趣的类别的高分,还意味着保持999个其他类别的相对分数。至少,这些约束显著减少了对抗/欺骗图像的空间。希望满足所有约束的任何输入都是能够获得人类对类标签支持的图像,就像[14]的图3中的一些愚弄图像那样,以及在对抗图像对中看到的细粒度分离类别(如公牛和大白鲨)。

有人可能会想,单个MAV是否足以表示具有不同方面/视图的复杂对象。而未来的工作应该研究更复杂的模型,这些模型可以捕获不同的视图/范例,例如NCM[13]或NCM森林[17]。如果深度网络实际上已经实现了视图独立识别的目标,那么倒数第二层激活的分布应该几乎是视图独立的。虽然鲨鱼的开颌和侧视图在视觉上是非常不同的,多样本模型可能更有效地捕捉到不同视图中的不同特征,但不同鲨鱼的开颌和侧视图仍然非常相似。因此,每个视图可以呈现相对一致的AV,允许单个MAV捕获两者。直观地说,虽然图像特征可能随着视图的不同而有很大的变化,但由AV表示的“相关类”的相对强度应该与视图无关。

2.3 OpenMax

标准的SoftMax函数是分类概率分布的梯度对数归一化器——这是它通常被用作网络的最后一个完全连接层的主要原因。传统的定义在计算中有每个节点的权重。基于caffe的深度网络[10]的倒数第二网络层的分数,我们称之为激活向量,在产生它的卷积中进行加权。设v(x) = v1(x),…, vN (x)为每个类的激活级别,y = 1,…经过深度网络训练,输入图像x产生激活向量v(x), SoftMax层计算:

其中分母对所有类别求和以确保所有类别的概率和为1。然而,在开放集识别中,在测试时存在未知的类,因此,要求概率之和为1是不合适的。

为了使SoftMax适应开放集,让ρ成为Alg. 1估计的每个类的元认知模型的向量。在Alg. 2中,我们总结了OpenMax计算的步骤。为了方便起见,我们将未知的未知类定义为索引0。我们使用x和μ i之间距离的Weibull CDF概率(Alg. 2的第3行)作为拒绝估计的核心。使用与类别i相关的图像计算模型μ i,这些图像在训练过程中被正确分类(top-1)。我们期望距离的EVT函数只对少数排名较高的类提供有意义的概率。因此,在Alg. 2的第3行中,我们计算α最大激活类的权重,并使用它来缩放威布尔CDF概率。然后计算修改后的激活向量,修正最高分。我们为未知的未知类计算一个伪激活,保持总激活级别不变。包括未知未知类,修正的激活计算OpenMax概率,如公式2所示。

当未知未知类(y=0)具有最大概率时,OpenMax提供支持显式拒绝的概率。这种元识别方法是确定未知未知类别的第一步,我们的实验表明,单个MAV在检测欺骗图像方面表现得相当好,并且优于仅对不确定性进行阈值处理。然而,在任何产生确定性估计的系统中,不确定性阈值仍然是一种有效的元识别类型,不应被忽视。因此,最终的OpenMax方法也拒绝了算法2第9行中的未知和不确定输入。

为了选择超参数ǫ、η和α,我们可以使用一组训练图像加上开放集图像的采样来执行网格搜索校准程序,优化集合上的F-measure。这里的目标是对总体尺度/灵敏度选择进行基本校准,而不是在未知未知空间上优化阈值,这无法通过实验实现。

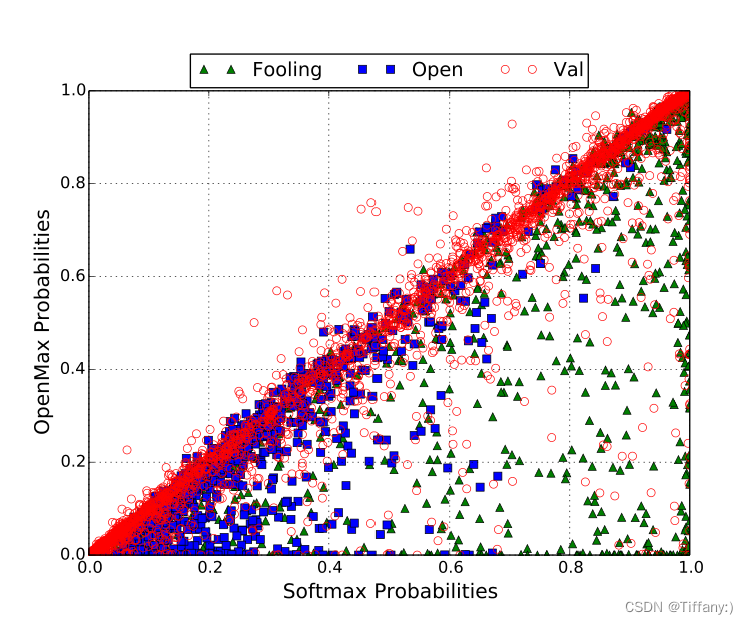

注意,未知未知类概率的计算固有地改变了估计的所有概率。对于一个固定的阈值和甚至有很小概率未知的输入,OpenMax将拒绝比SoftMax更多的输入。图2显示了100个示例图像、50个训练图像和50个开放集图像以及愚弄图像的OpenMax和SoftMax概率。离对角线越远,OpenMax改变的概率就越大。基于不确定性的拒绝阈值选择将在保留训练示例和拒绝开放集示例之间找到平衡。模糊图像未用于阈值选择。

图2 来自ImageNet 2012的100个类别的欺骗(三角形)、开集(正方形)和验证(圆形)的OpenMax概率与SoftMax概率的图表。一个点离对角线越远,OpenMax对概率的改变就越大。对角线以下表示OpenMax估计降低了输入在类中的概率。对于某些输入,OpenMax增加了类的概率,当领先的类被部分拒绝,从而降低了它的概率,增加了排名第二或更高的类。基于不确定性的拒绝阈值(ǫ)选择可以在正确分类训练示例和拒绝开放集示例之间优化F-measure。(愚弄图像不用于阈值选择。)对角线以下的三角形和正方形的数量意味着OpenMax阈值上的不确定性阈值(垂直方向)比SoftMax阈值上的不确定性阈值(水平方向)更好。

虽然不是我们实验评估的一部分,但请注意OpenMax还通过其估计的概率提供了有意义的排序。因此,OpenMax直接支持带有拒绝的前5类输出。还需要注意的是,由于激活分数的重新校准,OpenMax通常不会产生相同的分数排序。

2.4 Compact Abating Property

虽然阈值不确定性确实提供了拒绝某些输入的能力,但尚未证明它能正式限制深度网络的开放空间风险。应该很容易看出,就激活向量而言,SoftMax的正标签空间不限于训练空间附近,因为最大类分数的任何增加都会增加其概率,同时降低其他类的概率。随着最大概率方向上的充分增加,即使在其他维度上发生较大变化,仍将为排序高的类别提供较大的激活。虽然理论上有人可能会说,深度网络的激活是有限的,但[14]的欺骗图像是SoftMax无法管理开放空间风险的有力证据。

定理1(开放集深度网络):在激活向量上使用元识别扩展的深度网络,如Alg2,如等式2所示,SoftMax后来适用于OpenMax,提供了开放集识别功能。

证明:元识别概率(威布尔的CDF)是kµi的单调递增函数− xk,因此为1− ωi(x)单调递减。因此,它们构成了[21]中定义的紧凑衰减概率的基础。由于OpenMax变换是MetaRecognition概率的加权单调变换,因此应用[1]的定理1和定理2可以得出,对未知的OpenMax概率进行阈值化可以管理在AV特征空间中测量的开放空间风险。因此,它是一个开集识别函数。

3. Experimental Analysis

我们的评估基于ImageNet大规模视觉识别竞赛(ILSVRC)2012数据集,其中包含1K个视觉类别。数据集包含约1.3M张用于训练的图像(每个类别大约有1K至1.3K张图像)、50K张用于验证的图像和150K张用于测试的图像。由于ILSVRC 2012的测试标签不可公开获取,与其他人一样,我们报告了验证集的性能[11,14,23]。我们使用Caffe软件包提供的预训练AlexNet(BVLC AlexNet)深度神经网络[10]。据报道,BVLC AlexNet在ILSVRC 2012验证集上获得了约57.1%的第一名精度。选择经过预训练的BVLC AlexNet是经过深思熟虑的,因为它是开源的,也是深度学习中使用最广泛的包之一。

为了确保正确的开放集评估,我们应用了类似于[21,1]中给出的测试协议。在测试阶段,我们使用ILSVRC 2012验证集中的所有1000个类别、欺骗类别和以前未见过的类别来测试系统。未知的类别选自ILSVRC 2010。Russakovsky等人[19]注意到,ILSVRC 2012中丢弃了ILSVRC 2011中的约360个类别未使用。来自这360个类别的图像作为开放集图像,即未发现的或未知类别。

欺骗图像通常完全无法被人类识别出属于特定的类别,但深度网络几乎可以肯定地报告它们属于特定的类别。我们使用Nguyen et al.[14]提供的欺骗图像,这些图像是由进化算法或像素空间中的梯度上升生成的。最终的测试集包括来自ILSVRC 2012的50K闭集图像,15K开放集图像(来自ILSVRC 2010的360个不同类别)和15K欺骗图像(每个ILSVRC 2012类别有15张图像)。

训练阶段:如前所述(Alg. 1),我们考虑倒数第二层(全连接层8,即FC8)来计算平均激活向量(MA V)。通过考虑深度网络训练为每个类正确分类的训练示例,计算每个类的MA V向量。MAV分别为每个作物/通道计算。计算每个正确分类的训练示例与特定类别的MAV之间的距离,得到特定类别的距离分布。对于这些实验,我们使用的距离是归一化欧氏距离和余弦距离的加权组合。补充材料显示了纯欧几里得和其他总体表现相似的测量结果。在这些距离上估计威布尔分布的参数。ILSVRC 2012中的1000个类中的每一个类都重复这个过程。在参数估计阶段,对少量的hold - out数据集进行参数估计,从而得到威布尔分布参数估计的准确尾数长度。这一过程重复多次,以获得总体尾尺寸为20。

测试阶段:在测试期间,每个测试图像都经过之前在Alg. 2中讨论的OpenMax评分校准过程。激活向量是测试图像的FC8层中的值,该测试图像由对应于每个类和每个通道的1000x10维值组成。对于每个类别中的每个通道,输入使用每个类别的MAV和每个类别的威布尔参数进行比较。在测试过程中,计算相对于MAV的距离,并获得修正后的OpenMax激活,包括新的未知类(参见Alg. 2的第5和6行)。使用修正后的激活(公式2)计算每个通道的OpenMax概率,产生1001x10概率的输出。对于每个类,10个通道的平均值给出了总体的OpenMax概率。最后,1001个概率中最大的类就是预测类。这个最大概率然后被限制于不确定性阈值(第9行)。在这项工作中,我们专注于严格的top-1预测。

评估:闭集系统的多类分类错误可以通过跟踪不正确的分类来计算。对于开集测试,评估必须跟踪由于已知类别的标准多类别分类以及已知和未知类别之间的错误而发生的错误。如[25,20]所述,我们使用F-measure来评估开集性能。对于开集识别测试,F-measure优于accuracy,因为它没有被true negatives所放大。

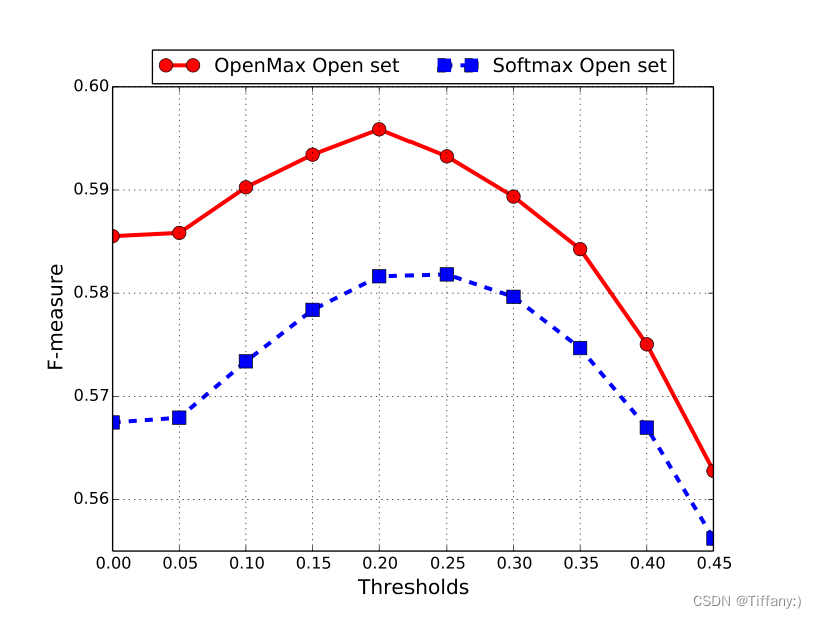

对于OpenMax/SoftMax概率值的给定阈值,我们计算整个数据集的TP、FP和FN性。例如,当使用来自验证集、欺骗集和开放集的图像对系统进行测试时(见图3),TP定义为验证集上的正确分类,FP定义为验证集上的错误分类,FN定义为来自欺骗集和开放集类别的图像,系统错误地将其分类为已知示例。图3显示了不同阈值下OpenMax和SoftMax的性能。实验表明,OpenMax算法在开放集测试中始终能获得较高的f值。

图3 OpenMax和SoftMax-w/阈值性能显示为F-measure作为输出概率阈值的函数。该测试使用了8万张图像,其中5万张验证图像来自ILSVRC 2012, 1.5万张愚弄图像和1.5万张“未知”图像来自ILSVRC 2010类别,2012年未使用。基础深度网络性能与SoftMax-w/threshold的阈值0相同。OpenMax的性能增益比最优阈值下的SoftMax提高了近4.3%,比基础深度网络提高了12.3%。在测试集中,OpenMax比SoftMax多正确分类了3450张图像,比基础深度网络多分类了9847张图像。

与1-vs-set算法的比较:由于在深度学习中这个相对较新的子领域缺乏可用的基线,我们考虑了一个开放集基线的线性模型。我们对FC8数据应用1-vs-set开集算法[20]。我们在1000个类的训练样本上训练线性支持向量机。我们还使用[1]中引用的线性扩展训练了1-vs-set,在1000个类的训练数据上对其进行了改进。1-Vs-Set算法实现的整体f测量值仅为.407,远低于OpenMax方法的.595。

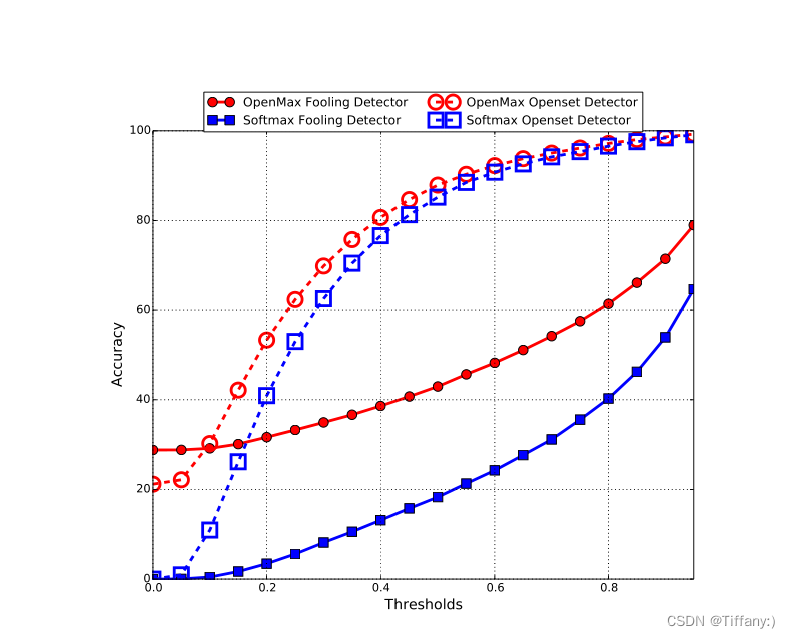

图4 上图显示了OpenMax和SoftMax作为欺骗图像和开放集测试图像的检测器的性能。F-measure是针对OpenMax和SoftMax概率值上的不同阈值计算的。本文提出的OpenMax算法在预测阶段能够很好地抑制欺骗图像。

4. Discussion

我们已经看到,使用我们的OpenMax架构,我们可以自动拒绝许多未知的开集和愚弄图像,以及拒绝一些对抗性图像,而对真实分类率的影响不大。在使用元识别时,一个明显的问题是“我们如何处理被拒绝的输入?”虽然这最好留给操作系统设计人员,但也有多种可能性。OpenMax可以被视为开放世界识别[1]场景中的新类检测器,在此之后,人类标记数据,系统逐步学习新的类别。或者检测可以作为引入其他模式的标志[24,7]。此外,可以应用简单的图像处理方法(如高斯模糊,平滑等)来去除噪声,这可能会导致错误分类。例如,在1中,OpenMax拒绝有噪声的输入,但有少量的高斯模糊,图像可以重新处理,并以0.79的概率被接受为锤头鲨。

我们使用非测试数据进行参数调优,为了简洁起见,仅显示了SoftMax with threshold和OpenMax共享的不确定性阈值的性能变化。补充材料显示了更大范围的OpenMax参数的变化。在未来的工作中,可能会通过增加A V模型的表达性来缓解真实类拒绝的增加,例如,每个类移动到多个MAV。这可能允许它更好地捕捉相同对象的不同上下文,例如,桌子上的棒球具有不同的上下文,因此,在AV中可能有不同的“相关”类,而不是投手抛出的棒球。

有趣的是,我们观察到OpenMax拒绝过程经常识别/拒绝深度网络错误分类的ImageNet图像,特别是具有多个对象的图像。类似地,许多远离训练数据的样本在场景中有多个对象。因此,OpenMax拒绝的其他用途可以改进训练过程,并帮助开发更好的本地化技术[30,15]。示例见图5。

图5 OpenMax还可以预测训练过程中的失败。类别是Agama,但是Agama的MAV被拒绝了,得分最高的类别是吉普,概率为0.26。然而,裁剪图像区域可以找到窗口的agama是很好的检测和另一个地方的吉普车是检测。作物1为jeep区域,作物2为agama,作物AV明显匹配适当的模型,分别以0.32和0.21的概率被接受。

8906

8906

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?