1.梯度下降的直观解释:

目的:求代价函数 J(θ0,θ1) 的最小值,误差最小情况最好。

场景假设:

想象一个人下山,在黑灯瞎火的夜晚,下山就是这个人找最陡峭的地方下山,(下山最陡的方向也就是梯度的负方向,)每一步的步子走了多少也就相当于是梯度下降中的学习率。下山的时候步子不可以太大,也不可以太小,因此学习率也是一样的,学习率不可以太大也不可以太小。(下山途中,走的太慢也就是步子太小,导致太阳下山了,还没有走到山下。梯度下降中,α不能太大也不能太小,太小的话,可能导致迟迟走不到最低点,太大的话,会导致错过最低点。)

“梯度”:就是某一点处的“导数”

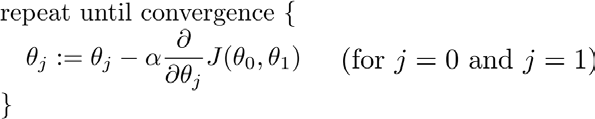

梯度下降公式:

α 是学习率,相当于下山中每一次的步子。

下山公式:新位置=现在位置-步长×梯度

注意: 从图中也可以看出来,梯度下降不一定能找到全局最优解,但是极有可能找到的解是局部最优解。

注意: 从图中也可以看出来,梯度下降不一定能找到全局最优解,但是极有可能找到的解是局部最优解。

2.梯度下降公式的推导:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?