目录

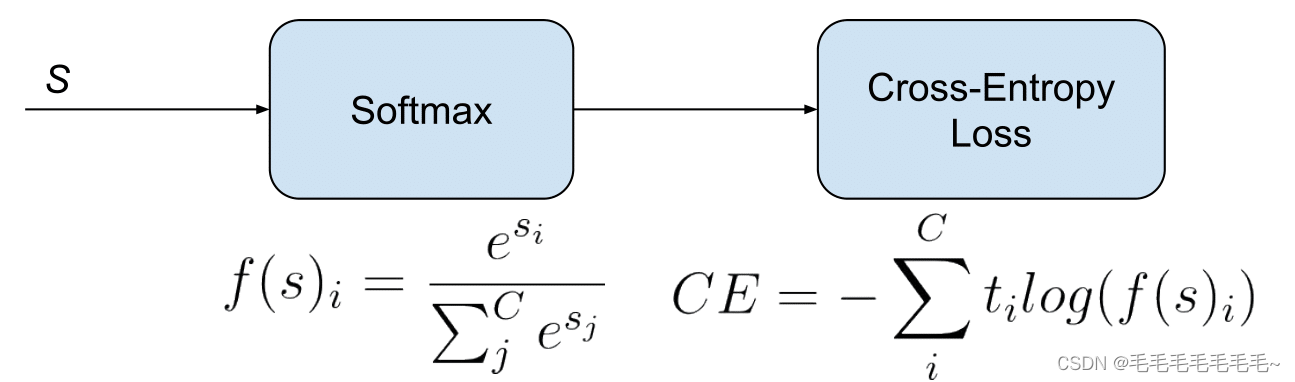

2.Softmax回归(Softmax Regression)

在机器学习领域,回归是一种预测连续值输出的算法。其中,线性回归和Softmax回归是两种最常见的回归方法。本文将对这两种方法进行详细的知识总结,帮助读者更好地理解和应用它们。

线性回归和Softmax回归是两种常见的回归算法,它们在应用场景和数学原理上有一些区别。

1.线性回归(Linear Regression)

线性回归是一种简单但强大的预测模型,一种用于建立自变量和因变量之间线性关系的回归算法。它假设目标变量和输入特征之间存在线性关系。通过最小化预测值和实际值之间的平方误差,我们可以找到一个最佳的权重向量,使得预测值尽可能接近实际值,它通过最小化预测值与实际值之间的差异来拟合最优的线性模型。线性回归的主要优点是易于理解和实现,但它的缺点是只能处理线性关系,对于非线性问题则无能为力。

(1)线性回归模型通常表示为 y = wx + b,其中 w 是权重,b 是偏差。

(2)线性回归的目标是最小化预测值与实际值之间的均方误差(MSE)。

(3)在训练过程中,我们会使用梯度下降等优化方法来不断调整权重w和偏差b,使得损失函数(即均方误差)最小。

(4)线性回归的一个主要限制是它只能处理线性可分的问题,对于非线性问题,我们需要使用其他模型,如多项式回归、支持向量机或神经网络等。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

444

444

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?