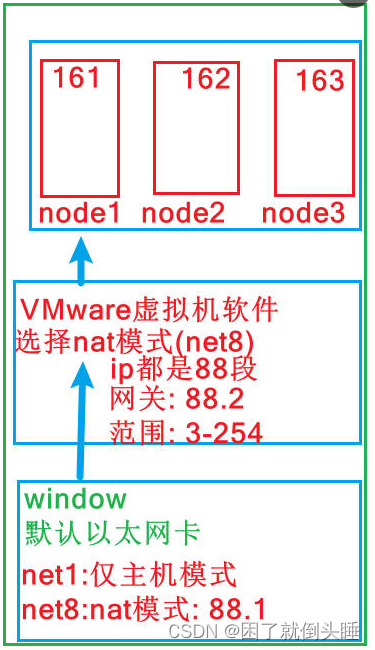

一、虚拟机配置

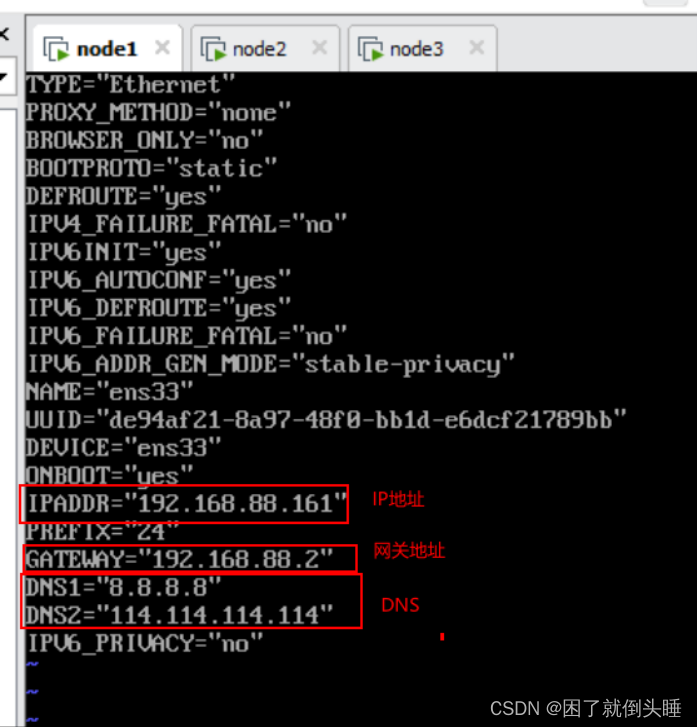

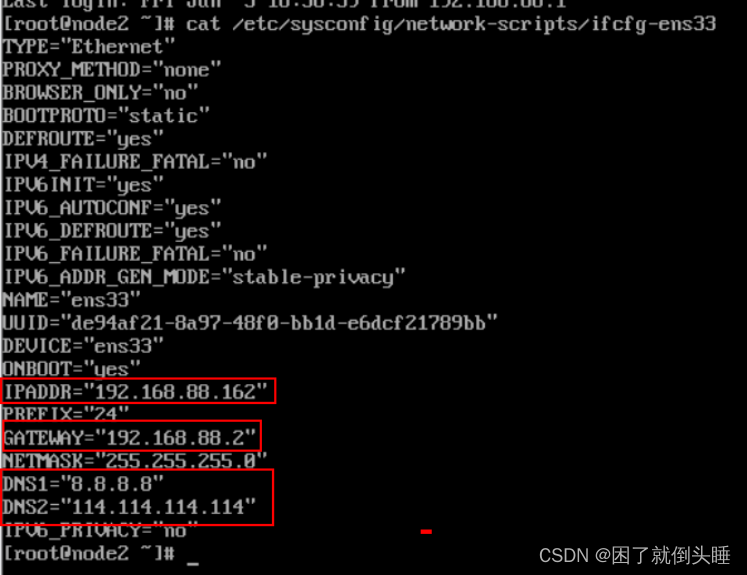

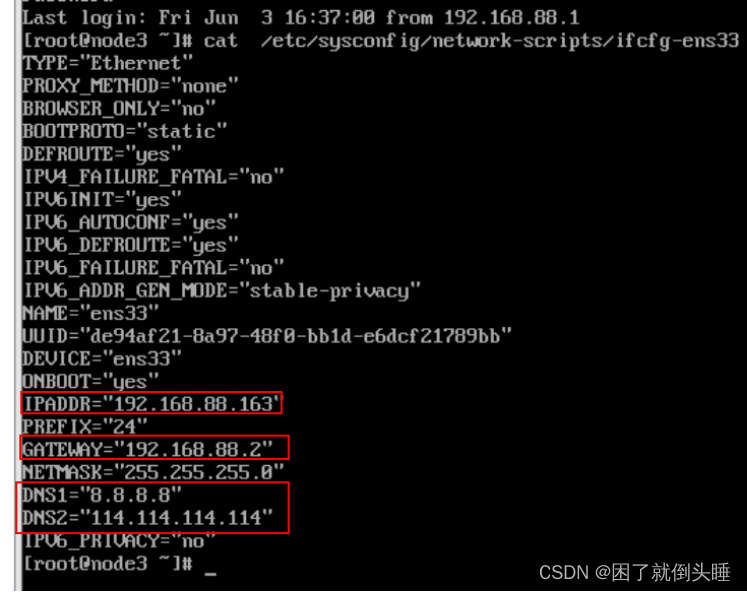

- 查看每一台的虚拟机的IP地址和网关地址

查看路径: cat /etc/sysconfig/network-scripts/ifcfg-ens33

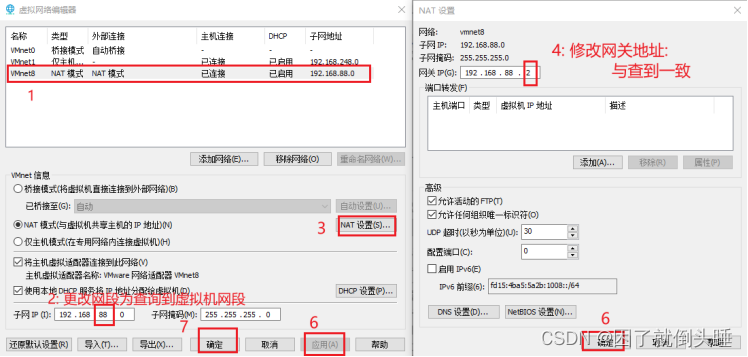

2.修改 VMware的网络地址: 使用VMnet8

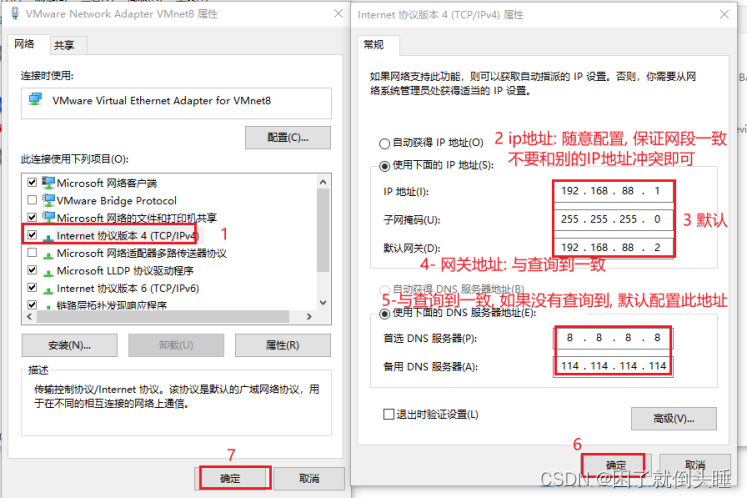

3.修改windows的对应VMware的网卡地址

4.通过finalshell 或者其他的shell连接工具即可连接使用即可, 连接后, 测试一下网络

http://www.hostbuf.com/

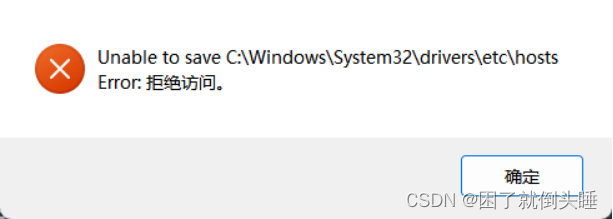

5.如果需要配置一些windows上的Host地址, 建议配置一下

需要在windows的hosts(路径:C:\Windows\System32\drivers\etc\hosts)文件中增加如下配置:

192.168.88.161 node1 node1.itcast.cn

192.168.88.162 node2 node2.itcast.cn

192.168.88.163 node3 node3.itcast.cn

解决办法:先把etc目录下的hosts文件剪切到桌面,在桌面上对hosts文件内容修改。修改完以后,再剪切移动到etc目录下

二、Spark Local[*]模式搭建文档

在本地使用单机多线程模拟Spark集群中的各个角色

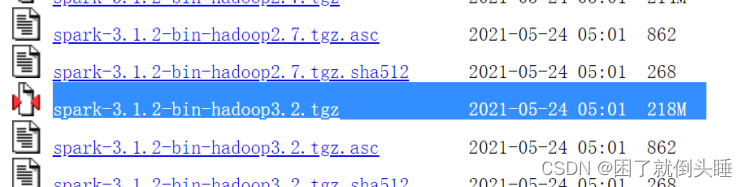

1.安装包下载

目前Spark最新稳定版本:课程中使用目前Spark最新稳定版本:3.1.2系列

下载地址:Index of /dist/spark

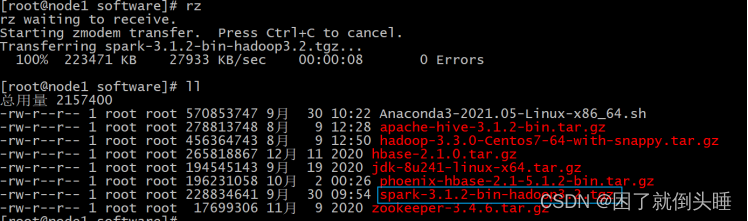

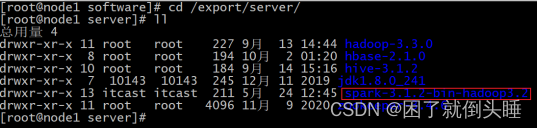

2、将安装包上传并解压

说明: 只需要上传至node1的/export/software目录下即可, 以下操作都是在node1执行的

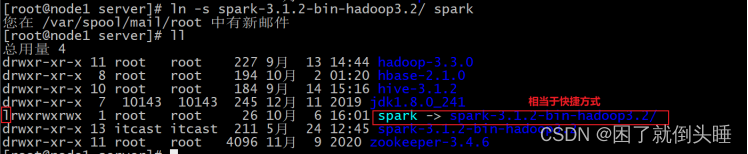

| cd /export/software rz -y 上传  解压: tar -zxf spark-3.1.2-bin-hadoop3.2.tgz -C /export/server/  更名: (两种方式二选一即可, 推荐软连接方案) cd /export/server 方式一(推荐): 软连接方案: ln -s spark-3.1.2-bin-hadoop3.2 spark 方式二: 直接重命名: mv spark-3.1.2-bin-hadoop3.2 spark  |

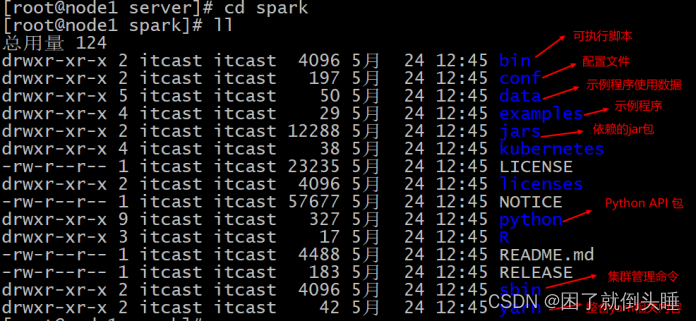

目录结构说明:

Linux上上传下载的软件下载和使用:

yum -y install lrzsz

rz -y上传

sz -y下载

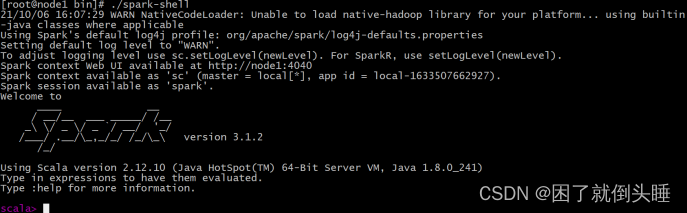

3.测试

环境启动:

Spark的local模式, 开箱即用, 直接启动bin目录下的spark-shell脚本

| cd /export/server/spark/bin ./spark-shell  |

说明:

sc:SparkContext实例对象:

spark:SparkSession实例对象

4040:Web监控页面端口号

访问页面:

http://node1:4040

●Spark-shell说明:

1.直接使用./spark-shell

表示使用local 模式启动,在本机启动一个SparkSubmit进程

2.还可指定参数 --master,如:

spark-shell --master local[N] 表示在本地模拟N个线程来运行当前任务

spark-shell --master local[*] 表示使用当前机器上所有可用的资源

3.不携带参数默认就是

spark-shell --master local[*]

4.后续还可以使用--master指定集群地址,表示把任务提交到集群上运行,如

./spark-shell --master spark://node01:7077,node02:7077

5.退出spark-shell

使用 :quit

658

658

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?