一,决策树

1,概念

选择最佳特征,然后根据这些特征将数据划分为不同的子集,每个子集再根据其他特征进行进一步的划分,如此递归进行,直到达到某个停止条件。其是一种树形结构,树上的每个内部节点表示一个特征上的判断,每个分支代表一个判断结果的输出,而每个叶子节点代表一种分类结果。

2, 构建过程

①决定用哪个特征来划分数据集的过程,通常选择信息增益、增益率或基尼指数等指标来衡量特征的好坏

②依据选择的特征对数据集进行划分,并递归地构建决策树的过程

③采用剪枝的方法缓解过拟合

二,ID3树

1,思想

是一种基于信息熵的决策树分类学习算法,它的核心思想是通过计算每个特征的信息增益来选择最佳的分类特征,并据此构建决策树。

2,信息熵

信息论中代表随机变量不确定度的度量

熵越大,数据的不确定性度越高,信息就越多

熵越小,数据的不确定性越低

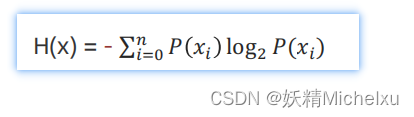

计算方法:

p(x)为目标值每个分类所占目标值整体的比例

3,条件熵

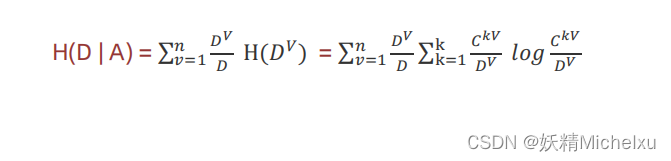

计算方法:

Dv/D为特征值的每个分类所占整体比例,H(Dv)特征值的每个分类的目标值每个分类结果(这一块也就是求熵)所占目标值比例。

4,信息增益

信息增益=熵—条件熵

5,构建流程

1,计算每个特征的信息增益

2,使用信息增益最大的特征将数据集拆分为子集

3,使用信息增益最大的特征作为决策树的一个节点

4,重复上述步骤

6,作用

分类预测:通过构建决策树模型,可以对新的数据进行分类预测。具体来说,将新的数据从根节点开始,根据每个内部节点的特征属性取值进行路径选择,最终到达一个叶子节点,该叶子节点所表示的类别即为预测结果。

特征选择:ID3决策树通过计算每个特征的信息增益来选择最佳的分类特征,这有助于我们理解数据集中各个特征的重要性。

可视化展示:决策树模型具有直观的可视化结构,可以清晰地展示数据中的规律和模式,便于人们理解和分析。

处理多类别问题:ID3决策树可以处理多类别问题,适用于多分类任务。

三,C4.5树

1,思想:

主要是通过递归地选择最优特征对数据进行划分,从而构建一个决策树模型。在特征选择的过程中,C4.5使用信息增益率(Gain Ratio)作为划分标准,以克服ID3算法倾向于选择取值较多的特征的缺点。同时,C4.5能够处理连续属性和缺失值,并通过剪枝策略来提高模型的泛化能力。

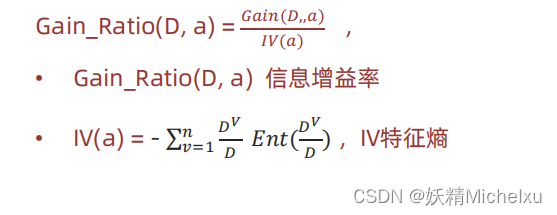

2,信息增益率:

信息增益率等于=信息增益/特征熵 ,相当于对信息增益进行修正,增加一个惩罚系数

特征熵就是特征值每个分类所占特征值整体比例,代入熵的公式即可。

3,构建流程

1,初始化:创建一个根节点,并将所有训练数据都放在根节点。

2,特征选择:计算每个特征的信息增益率,并选择信息增益率最大的特征作为当前节点的划分特征。

3,处理连续属性:如果当前节点的划分特征是连续属性,C4.5会采用二分法进行处理,选择一个阈值将数据集分为两个子集,然后选择信息增益率最大的阈值进行划分。

4,处理缺失值:当某个样本的某个属性值缺失时,C4.5会考虑所有可能的取值,并按照缺失值所占比例计算信息增益率。

5,划分数据集:根据选定的划分特征和属性值,将数据集划分为若干个子集,每个子集对应一个分支。

6,递归构建:对每个子集,重复步骤2-5,直到满足停止条件(如所有样本属于同一类别,或者没有剩余的特征可供划分)。

7,剪枝:为了避免过拟合,C4.5在构建完决策树后会进行剪枝操作,去除一些不必要的叶子节点。

4,作用

分类预测:通过构建决策树模型,可以对新的数据进行分类预测。具体来说,将新的数据从根节点开始,根据每个内部节点的特征属性取值进行路径选择,最终到达一个叶子节点,该叶子节点所表示的类别即为预测结果。

特征选择:C4.5决策树通过计算每个特征的信息增益率来选择最佳的分类特征,这有助于我们理解数据集中各个特征的重要性。

处理复杂数据:C4.5能够处理包含连续属性、缺失值等复杂情况的数据集,使得算法具有更强的适用性和鲁棒性。

可视化展示:决策树模型具有直观的可视化结构,可以清晰地展示数据中的规律和模式,便于人们理解和分析。

提高泛化能力:通过剪枝策略,C4.5能够去除一些不必要的叶子节点,从而提高模型的泛化能力,减少对新数据的误判率。

5,特点

缓解了ID3分支过程中总喜欢偏向选择值较多的属性

可处理连续数值型属性,也增加了对缺失值的处理方法

只适合于能够驻留于内存的数据集,大数据集无能为力

2228

2228

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?