目录

1.请给出最优化问题的形式化定义,并对优化问题进行分类和阐述各类优化问题的定义,及最优化的求解过程。

2.凸集、凸函数的定义是什么?如何判别一个函数是否是凸函数?凸优化问题的定义和标准形式是什么?凸优化问题有哪些类别,各自的形式化定义是什么?

3.给定目标函数和一组约束条件,求解非线性规划问题。目标函数:

4.请给出梯度下降算法解无约束优化问题的原理、算法。并实现用梯度下降算法求解的f(x) = (x_1 - 1)^2 + 3(x_2 - 1)^2极小点。

5.求解函数f(x, y) = 2x^2 + 3y^2的最小值,约束条件:x + y = 5。通过源码实现最优化问题求解,给出优化问题的解。

6.求解函数f(x) = x^3 - 6x^2 + 11x - 6在区间[0,4]上的最小值

1.请给出最优化问题的形式化定义,并对优化问题进行分类和阐述各类优化问题的定义,及最优化的求解过程。

最优化问题的形式化定义:

Minimization Problem(最小化问题):

Minimize f(x)

Subject to:

g_i(x) ≤ 0, i = 1, 2, …, m (不等式约束)

h_j(x) = 0, j = 1, 2, …, p (等式约束)

a_i ≤ xi ≤ b_i, i = 1, 2, …, n (变量范围)

其中,f(x) 是目标函数,x 是待优化的变量向量,gi(x) 是不等式约束函数,hj(x) 是等式约束函数,ai 和 bi 是变量 x_i 的取值范围。最小化问题的目标是找到 x,使得 f(x) 的值最小,并满足所有的约束条件。

Maximization Problem(最大化问题):

Maximize f(x)

Subject to:

g_i(x) ≤ 0, i = 1, 2, …, m (不等式约束)

h_j(x) = 0, j = 1, 2, …, p (等式约束)

a_i ≤ x_i ≤ b_i, i = 1, 2, …, n (变量范围)

最优化问题的分类:

- 无约束优化问题:没有约束条件,只需要寻找目标函数的最小值或最大值。

- 约束优化问题:在目标函数的优化过程中,存在一定的约束条件,如不等式约束和等式约束。

- 线性规划(LP):目标函数和约束条件都是线性的。通常使用线性规划方法求解。

- 整数规划(IP):在线性规划问题的基础上,要求决策变量是整数。通常使用分支定界等方法求解。

- 二次规划(QP):目标函数是二次的,约束可以是线性或二次的。二次规划通常涉及二次约束和二次目标函数。

- 非线性规划(NLP):目标函数或约束条件中至少有一个是非线性的。非线性规划问题通常需要使用迭代方法求解。

最优化的求解过程:

- 问题建模:定义目标函数和约束条件,将最优化问题形式化表示。这包括确定优化问题的类型(最小化或最大化),目标函数,约束条件以及变量的范围。

- 选择优化方法:根据问题的性质选择合适的优化方法。例如,线性规划可以使用线性规划算法,非线性规划可能需要使用梯度下降等迭代方法。

- 求解问题:运行选择的优化算法来找到目标函数的最小值或最大值。这通常涉及迭代过程,直到满足终止条件(如梯度足够小)。

- 解释结果:分析最优解以理解问题的实际含义。这可能包括分析决策变量的值,目标函数值以及任何约束的满足程度。

- 调优和灵敏度分析:根据需要对模型进行调优,或进行灵敏度分析以了解最优解对模型参数的变化的响应。

2.凸集、凸函数的定义是什么?如何判别一个函数是否是凸函数?凸优化问题的定义和标准形式是什么?凸优化问题有哪些类别,各自的形式化定义是什么?

凸集凹集定义:

凸集:

在欧几里得空间中,一个集合称为凸集,如果对于集合中的任意两个点,连接这两个点的线段上的所有点也属于该集合。换句话说,给定一个集合,如果这个集合中的任意两点之间的线段上的点也都在该集合中,则该集合是一个凸集。

凸函数:

在实数域上,一个函数称为凸函数,如果对于函数上的任意两个点,函数图像上这两个点之间的连线上的所有点都位于函数图像上方。换句话说,给定一个函数,如果这个函数图像上任意两点连接线上的点都位于或在函数图像上方,则该函数是凸函数。

常用的判断凸函数方法:

二阶条件(Hessian 矩阵):

对于二次可微的函数,可以使用 Hessian 矩阵来判断是否为凸函数。若函数的 Hessian 矩阵在定义域上半正定(即所有特征值非负),则该函数是凸函数。

一阶条件(一阶导数):

对于一次可微的函数,可以使用一阶导数来判断是否为凸函数。若函数在定义域上的导数是递增的,则该函数是凸函数。也就是说,如果函数的一阶导数恒大于等于零,则函数是凸函数。

二阶条件的特殊情况(二阶导数):

对于二次可微的函数,可以使用二阶导数来判断是否为凸函数。若函数在定义域上的二阶导数恒大于等于零,则该函数是凸函数。

Jensen 不等式:

对于一般的函数,可以使用 Jensen 不等式来判断是否为凸函数。Jensen 不等式的定义是:对于凸组合形式的点和函数值,函数值的凸组合总是小于等于对函数值进行凸函数操作后的结果。如果一个函数满足 Jensen 不等式,那么该函数是凸函数。

凸优化问题的定义和标准形式是什么

凸优化问题的定义是在给定凸函数和凸集的约束条件下,找到使得目标函数最小化或最大化的变量值。

凸优化问题通常可以表示为以下标准形式:

最小化:寻找一组参数 x 以最小化目标函数:

minize f(x)

约束:满足一组等式约束和不等式约束:

gi(x)=0, i=1,2,...,m ℎj(x)≤0, j=1,2,...,n

其中, f(x) 是凸函数, gi(x) 是凸函数, ℎj(x) 是凸函数。

类别及其形式化定义:

1. 线性规划(Linear Programming,LP):

形式化定义:线性规划是一种凸优化问题,其优化目标和约束条件都是线性的。线性规划的标准形式如下:

最小化:c^Tx

在约束条件下,Ax <= b和 x >= 0。

2. 二次规划(Quadratic Programming,QP):

形式化定义:二次规划是一种凸优化问题,其优化目标是一个二次函数,而约束条件可以是线性的。一般形式如下:

最小化:0.5x^T Qx + c^T x

在约束条件下,Ax <= b。

3. 半正定规划(Semidefinite Programming,SDP):

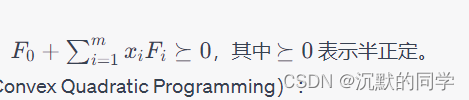

形式化定义:半正定规划是一种凸优化问题,其优化目标是一个线性组合的半正定矩阵的迹(trace),而约束条件是半正定矩阵的约束。一般形式如下:

最小化:c^T x

在约束条件下,

4. 凸二次规划(Convex Quadratic Programming):

形式化定义:凸二次规划是一种凸优化问题,其优化目标是一个凸二次函数,而约束条件可以是凸集合上的。一般形式如下:

最小化:0.5x^T Q x + c^T x

在约束条件下,gi(x) <= 0 和hj(x) = 0 ,其中 gi(x) 和 hj(x) 是凸函数。

5. 一般凸优化问题(General Convex Optimization):

形式化定义:一般凸优化问题是一种更一般的凸优化问题,其中优化目标是凸函数,而约束条件可以是凸集合上的。形式可以包括线性、二次、凸和非凸约束条件,只要优化目标是凸函数,问题就是凸优化问题。

这些是凸优化问题的一些主要类别,但实际上,凸优化领域涵盖了更多不同类型的问题,包括锥规划、半定规划、线性半定规划等等。每种类型的问题都有其独特的性质和解法,但它们都共享凸性质,因此可以使用一些通用的凸优化算法来求解。

3.给定目标函数和一组约束条件,求解非线性规划问题。目标函数:

min (x-5)**2 + (y-10)**2

约束条件:

x+y >= 7

取值范围:

0 <= x <= 10

0 <= y <= 10

求解步骤:

1.设置目标函数和约束条件: 给定目标函数和约束条件,首先将问题形式化表示。在这种情况下,目标函数为:

![]()

约束条件:

![]()

取值范围为:

0 <= x <= 10

0 <= y <= 10

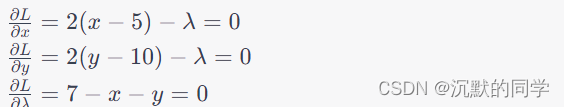

2.设置拉格朗日函数: 使用拉格朗日乘子法,引入拉格朗日乘子 λ 来构建拉格朗日函数:

![]()

3.求解梯度为零的条件: 要找到最小值,我们需要找到拉格朗日函数的偏导数为零的点。分别对 L 关于 x、y 和 λ 求偏导数,并令它们等于零:

4.解出x, y和λ的值

解这个方程组,得到最优解。

5.检查二阶条件: 确保最优解满足凸性条件,即二阶偏导数满足某种条件(通常是正定性条件),以确保找到的解是局部最小值。

代码实现:

from scipy.optimize import minimize

# 定义目标函数

def objective(x):

return (x[0]-5)**2 + (x[1]-10)**2

# 定义约束条件

def constraint(x):

return x[0] + x[1] - 7

# 设置初值

x0 = [0, 0]

# 定义取值范围

bounds = [(0, 10), (0, 10)]

# 定义优化问题

con = {'type': 'ineq', 'fun': constraint}

result = minimize(objective, x0, bounds=bounds, constraints=con)

# 输出最优解

print("最优解:", result.x)

print("最小值:", result.fun)

结果:

最小值为: 5.551116446614842e-17

取得最小值时的 x 和 y 分别为: [ 4.99999999 10. ]

进程已结束,退出代码04.请给出梯度下降算法解无约束优化问题的原理、算法。并实现用梯度下降算法求解的f(x) = (x_1 - 1)^2 + 3(x_2 - 1)^2极小点。

梯度下降算法解无约束优化问题的原理、算法:

梯度下降算法是一种常用的优化算法,用于解决无约束优化问题,即最小化或最大化目标函数,而不受特定约束条件的限制。这种算法的核心思想是通过迭代寻找函数的局部最小值或最大值,通过不断调整参数(变量)以减小或增大目标函数的值。

- 选择初始点 x0。

- 计算函数 f(x) 对 x 的梯度,记作 ∇f(x)。梯度是函数在某点的变化率,指向函数值增加最快的方向。

- 更新 x,使其沿着负梯度的方向移动,以减小函数值。这一步骤可以用如下公式表示: x_new = x - α * ∇f(x) 其中,α(称为学习率)是一个控制步长的超参数,需要小心选择,通常取较小的正数值。

- 重复步骤2和步骤3,直到满足终止条件,例如梯度足够接近于零或达到最大迭代次数

代码实现:

import numpy as np

def gradient_descent(lr, iterations):

# 初始化参数

x = np.array([0.0, 0.0]) # 初始点的坐标

epsilon = 1e-8 # 迭代停止条件,梯度的模小于该值时停止迭代

# 定义梯度计算函数

def gradient(x):

gradient_x1 = 2 * (x[0] - 1)

gradient_x2 = 6 * (x[1] - 1)

return np.array([gradient_x1, gradient_x2])

# 梯度下降迭代

for i in range(iterations):

grad = gradient(x) # 计算当前点的梯度

if np.linalg.norm(grad) < epsilon:

break

x -= lr * grad # 根据梯度更新参数

return x

learning_rate = 0.1 # 学习率

num_iterations = 1000 # 迭代次数

result = gradient_descent(learning_rate, num_iterations)

print("极小点的坐标为:", result)结果:

极小点的坐标为: [1. 1.]

进程已结束,退出代码05.求解函数f(x, y) = 2x^2 + 3y^2的最小值,约束条件:x + y = 5。通过源码实现最优化问题求解,给出优化问题的解。

该类问题属于有约束的非凸优化问题

求解步骤:

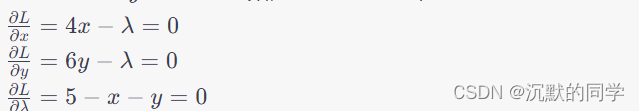

1.设置拉格朗日函数: 拉格朗日函数将原始问题的目标函数和约束条件结合在一起。在这种情况下,拉格朗日函数为:

![]()

其中,λ 是拉格朗日乘子。

2.求解梯度为零的条件: 要找到最小值,我们需要找到拉格朗日函数的偏导数为零的点。分别对 L 关于 x、y 和 λ 求偏导数,并令它们等于零:

3.解出 x、y 和 λ 的值: 解这个方程组,得到最优解。

4.检查二阶条件: 确保最优解满足凸性条件,即二阶偏导数满足某种条件(通常是正定性条件),以确保找到的解是局部最小值。

代码实现:

from scipy.optimize import minimize

# 定义目标函数

def objective(x):

return 2*x[0]**2 + 3*x[1]**2

# 定义约束条件

def constraint(x):

return x[0] + x[1] - 5

# 设置初值

x0 = [0, 0]

# 定义优化问题

con = {'type': 'eq', 'fun': constraint}

result = minimize(objective, x0, constraints=con)

# 输出最优解

print("最优解:", result.x)

print("最小值:", result.fun)

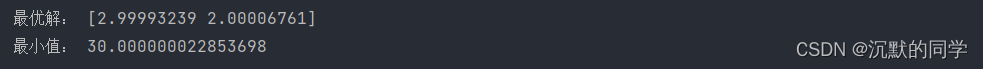

结果:

6.求解函数f(x) = x^3 - 6x^2 + 11x - 6在区间[0,4]上的最小值

该类问题属于无约束优化问题

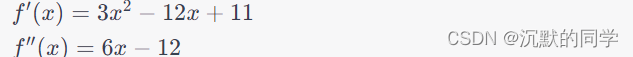

1.计算 f(x) 的导数: 首先,计算 f(x) 的一阶导数 f′(x) 和二阶导数 f′′(x)。在这种情况下:

2.找到一阶导数为零的点: 在区间 [0,4] 内,找到 f′(x)=0 的点。这些点可能是最小值、最大值或拐点。

检查二阶导数的符号: 对于一阶导数为零的点,检查二阶导数的符号来确定它们是最小值还是最大值。如果 f′′(x)>0,则该点是局部最小值;如果 f′′(x)<0,则该点是局部最大值;如果 f′′(x)=0,则可能是一个拐点。

3.确定最小值点: 如果在区间 [0,4]内找到了一阶导数为零的点,并且这些点的二阶导数为正(f′′(x)>0),那么它们中的某个点将是函数 f(x) 在该区间上的最小值点。

在这个特定问题中,你可以使用上述步骤来找到函数 f(x)=x^3−6x^2+11x−6 在区间 [0,4]上的最小值。计算 f′(x) 和 f′′(x),找到 f′(x)=0 的点,然后检查二阶导数的符号以确定最小值点。

代码实现:

如果你想使用计算机进行数值求解,你可以使用数值优化库,如SciPy中的 minimize_scalar 函数,来找到最小值点。以下是使用SciPy的示例代码:

from scipy.optimize import minimize_scalar

# 定义目标函数

def objective(x):

return x**3 - 6*x**2 + 11*x - 6

# 在区间[0, 4]内寻找最小值

result = minimize_scalar(objective, bounds=(0, 4), method='bounded')

# 输出最小值点

print("最小值点:", result.x)

print("最小值:", result.fun)

结果:

最小值点: 2.577351866143519

最小值: -0.3849001794553324

进程已结束,退出代码0或者使用牛顿迭代法实现:

# 定义目标函数

def f(x):

return x ** 3 - 6 * x ** 2 + 11 * x - 6

# 定义目标函数的导数

def df(x):

return 3 * x ** 2 - 12 * x + 11

# 初始点和学习率

x = 2.0 # 初始点,可以根据需要选择不同的初始点

learning_rate = 0.1 # 学习率,可以根据需要选择不同的学习率

# 迭代次数和收敛阈值

max_iterations = 1000

convergence_threshold = 1e-6

# 梯度下降优化循环

for iteration in range(max_iterations):

# 计算目标函数在当前点的值

current_value = f(x)

# 计算目标函数在当前点的导数(梯度)

gradient = df(x)

# 使用梯度下降规则更新 x

x = x - learning_rate * gradient

# 计算新点处的目标函数值

new_value = f(x)

# 计算目标函数值的变化量

change = abs(new_value - current_value)

# 打印迭代信息

print(f"Iteration {iteration + 1}: x = {x:.4f}, f(x) = {new_value:.4f}, Change = {change:.4f}")

# 检查是否满足收敛条件

if change < convergence_threshold:

break

# 打印最终结果

print("最小值:", f(x))

print("最小值点 x:", x)

7.假设一个农场主要种植小麦和玉米两种作物,每亩小麦的利润为1000元,每亩玉米的利润为1500元。已知该农场有1000亩土地可供种植,并且小麦和玉米的种植面积之和不能超过800亩。如何制定种植计划,使得利润最大化?请对优化问题进行建模和形式化,并利用源码实现最优值求解。

求解步骤:

该问题属于线性规划问题定义决策变量:令x表示生产的产品A的单位数量,y表示生产的产品B的单位数量。

目标函数:最小化生产成本。目标函数可以表示为minimize(10x + 15y)。

约束条件:生产成本不能超过总共5000元,并且产品A和产品B的需求量需要满足。

约束条件可以表示为:

10x + 15y <= 5000

x >= 100

y >= 80

进一步限制:x和y都不能小于零,因为生产数量不能为负数。

求解最优解:将目标函数和约束条件带入线性规划算法中,比如单纯形法,求解出最优的生产计划和最低的生产成本。

代码实现:

import pulp

# 创建线性规划问题

lp_problem = pulp.LpProblem("Crop_Planning", pulp.LpMaximize)

# 定义决策变量

x = pulp.LpVariable("x", lowBound=0, upBound=1000, cat="Integer") # 种植小麦的面积

y = pulp.LpVariable("y", lowBound=0, upBound=1000, cat="Integer") # 种植玉米的面积

# 定义目标函数

lp_problem += 1000 * x + 1500 * y, "Total Profit"

# 添加约束条件

lp_problem += x + y <= 1000 # 土地面积约束

lp_problem += x + y <= 800 # 作物种植面积之和约束

# 求解线性规划问题

lp_problem.solve()

# 打印结果

print("最大利润:", pulp.value(lp_problem.objective))

print("小麦面积:", pulp.value(x))

print("玉米面积:", pulp.value(y))

结果:

最大利润: 1200000.0

小麦面积: 0.0

玉米面积: 800.0

进程已结束,退出代码0

8.某公司生产两种产品A和B,产品A每个单位的生产成本为10元,产品B每个单位的生产成本为15元。已知公司总共有5000元的生产成本,产品A的需求量为100个单位,产品B的需求量为80个单位。如何确定生产计划,使得满足需求的同时生产成本最低?请对优化问题进行建模和形式化,并利用源码实现最优值求解。

求解步骤:

解答:

该问题属于线性规划问题

定义决策变量:令x表示生产的产品A的单位数量,y表示生产的产品B的单位数量。

目标函数:最小化生产成本。目标函数可以表示为minimize(10x + 15y)。

约束条件:生产成本不能超过总共5000元,并且产品A和产品B的需求量需要满足。

约束条件可以表示为:

10x + 15y <= 5000

x >= 100

y >= 80

进一步限制:x和y都不能小于零,因为生产数量不能为负数。

求解最优解:将目标函数和约束条件带入线性规划算法中,比如单纯形法,求解出最优的生产计划和最低的生产成本。

代码实现:

import pulp

# 创建线性规划问题

lp_problem = pulp.LpProblem("Production_Planning", pulp.LpMinimize)

# 定义决策变量

x = pulp.LpVariable("x", lowBound=0, cat="Continuous") # 生产产品A的单位数量

y = pulp.LpVariable("y", lowBound=0, cat="Continuous") # 生产产品B的单位数量

# 定义目标函数

lp_problem += 10 * x + 15 * y, "Total Cost"

# 添加约束条件

lp_problem += 10 * x + 15 * y <= 5000 # 生产成本约束

lp_problem += x >= 100 # 产品A需求量约束

lp_problem += y >= 80 # 产品B需求量约束

# 求解线性规划问题

lp_problem.solve()

# 打印结果

print("最低生产成本:", pulp.value(lp_problem.objective))

print("生产计划 - 产品A:", pulp.value(x))

print("生产计划 - 产品B:", pulp.value(y))结果:

最低生产成本: 2200.0

生产计划 - 产品A: 100.0

生产计划 - 产品B: 80.0

进程已结束,退出代码0

8194

8194

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?