本地部署大模型

演示环境:华为笔记本window 提前准备魔法

如果想要更好的学习入门大模型相关,成为一个魔法师是很重要的

一.window安装docker

1.1下载docker

不过多解释docker,简单解释一下教程中docker安装目的:

docker是一个容器,把模型和chatui装到里面,不需要考虑环境的问题

docker desktop软件官网:https://www.docker.com/products/docker-desktop/

下载后直接下一步无脑安装,确保桌面出现docker图标

2.注册登录docker

针对个人可以免费使用,进入程序,直接注册登陆即可

确保进入当前页面

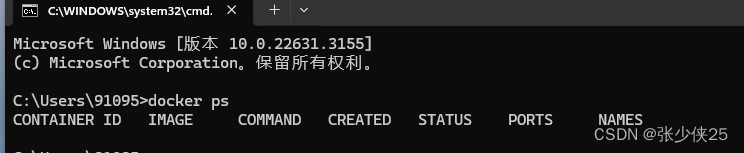

3.1验证docker是否安装成功

win+R 进入命令行 输入如下口令

docker ps

出现上述图片,证明docker安装成功,完成一大半

二.安装ollama框架

先提供官网地址:https://ollama.com/

2.1ollama是什么

简单来说ollama是大模型部署的框架,有自己的仓库,有着市面上90%的模型.帮助你一行代码下载部署

2.2安装ollama

2.2.1针对cpu试玩

命令行中输入一下代码

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

cmd:

Microsoft Windows [版本 10.0.22631.3155]

(c) Microsoft Corporation。保留所有权利。

C:\Users\91095>docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

运行结束,框架安装结束,就这么简单

2.2.2针对GPU

笔记本拉跨感兴趣的自己去看一下文档https://hub.docker.com/r/ollama/ollama

2.3部署qwen模型

2.3.1llama2部署安装

docker exec -it ollama ollama run llama2

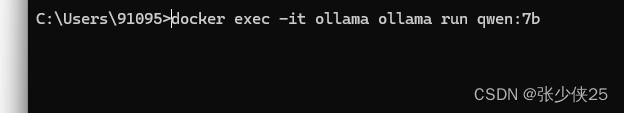

2.3.2 qwen部署安装

docker exec -it ollama ollama run qwen:7b

2.3.3安装模型

输入命令

下载模型中

完成安装,开始chat

之后开始聊天,随便输入你的内容

温馨提示,退出快捷键为ctrl+d

三.安装lobe-chat框架

这是一个前端ui的框架,仅展示继承ollama的配置

github官网,可以自行研究

https://github.com/lobehub/lobe-chat/blob/main/README.zh-CN.md

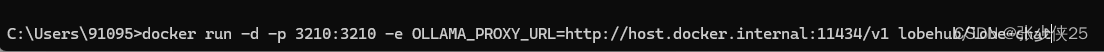

3.1安装

一行结束

docker run -d -p 3210:3210 -e OLLAMA_PROXY_URL=http://host.docker.internal:11434/v1 lobehub/lobe-chat

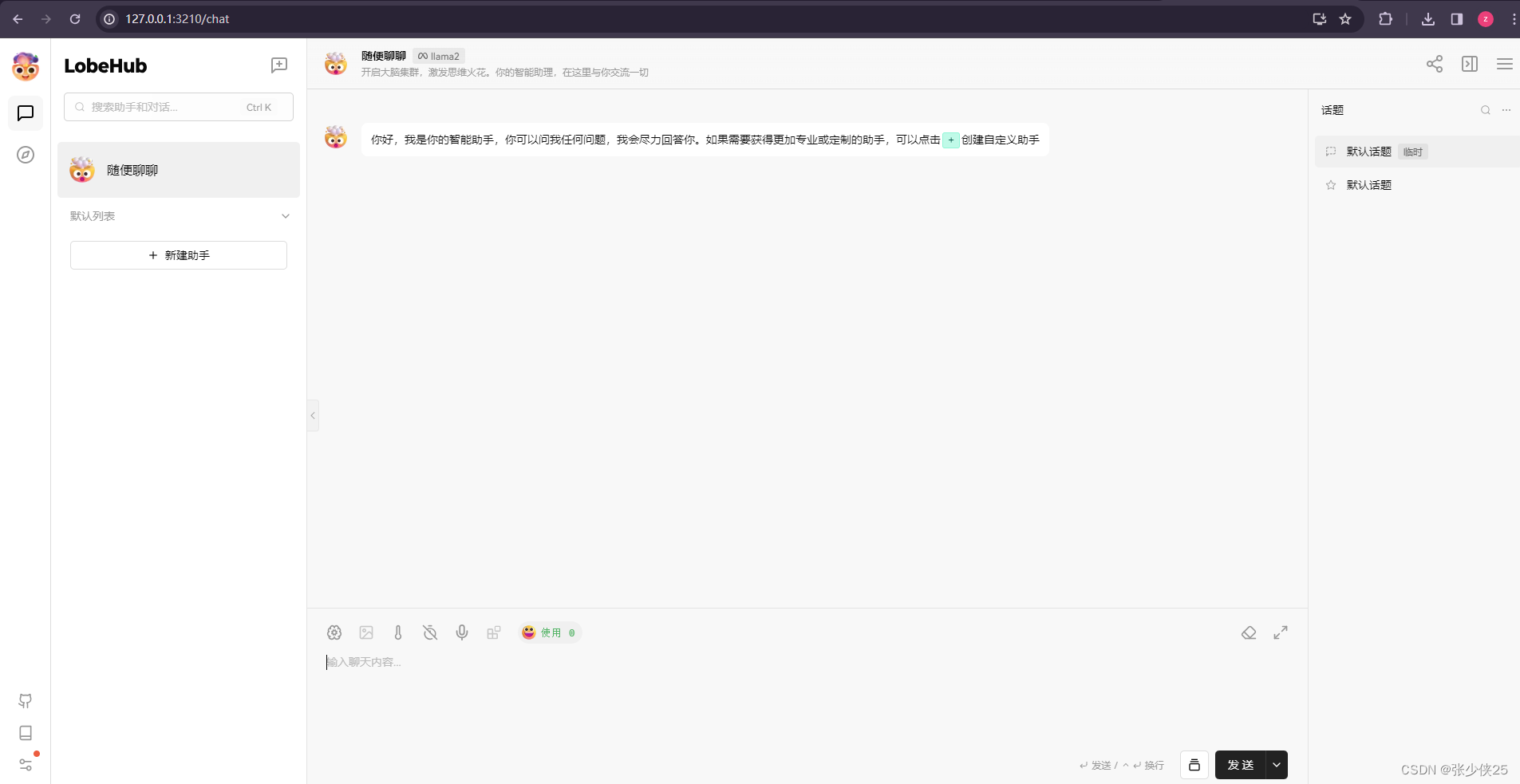

3.2url访问

127.0.0.1:3210

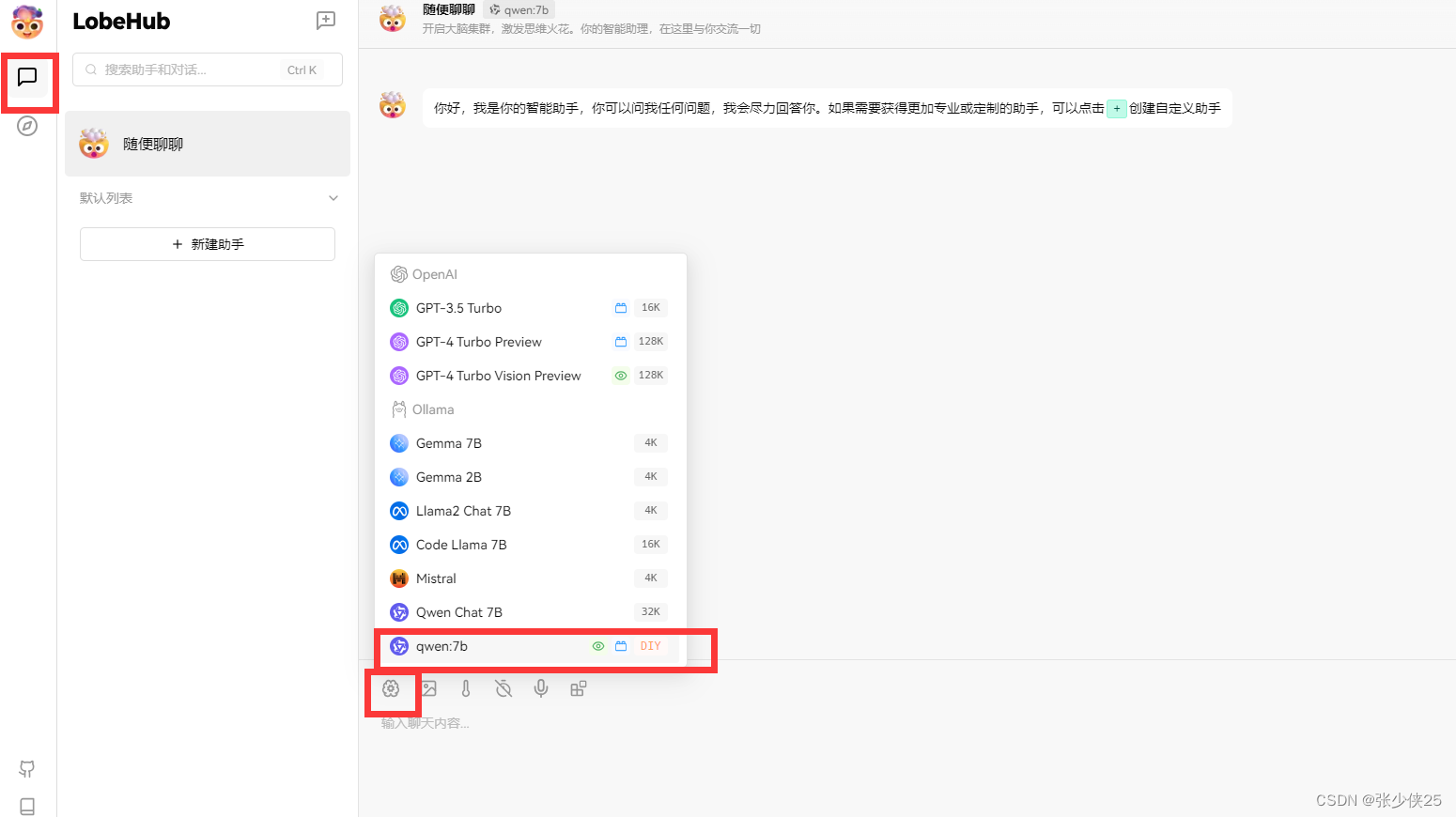

选择模型

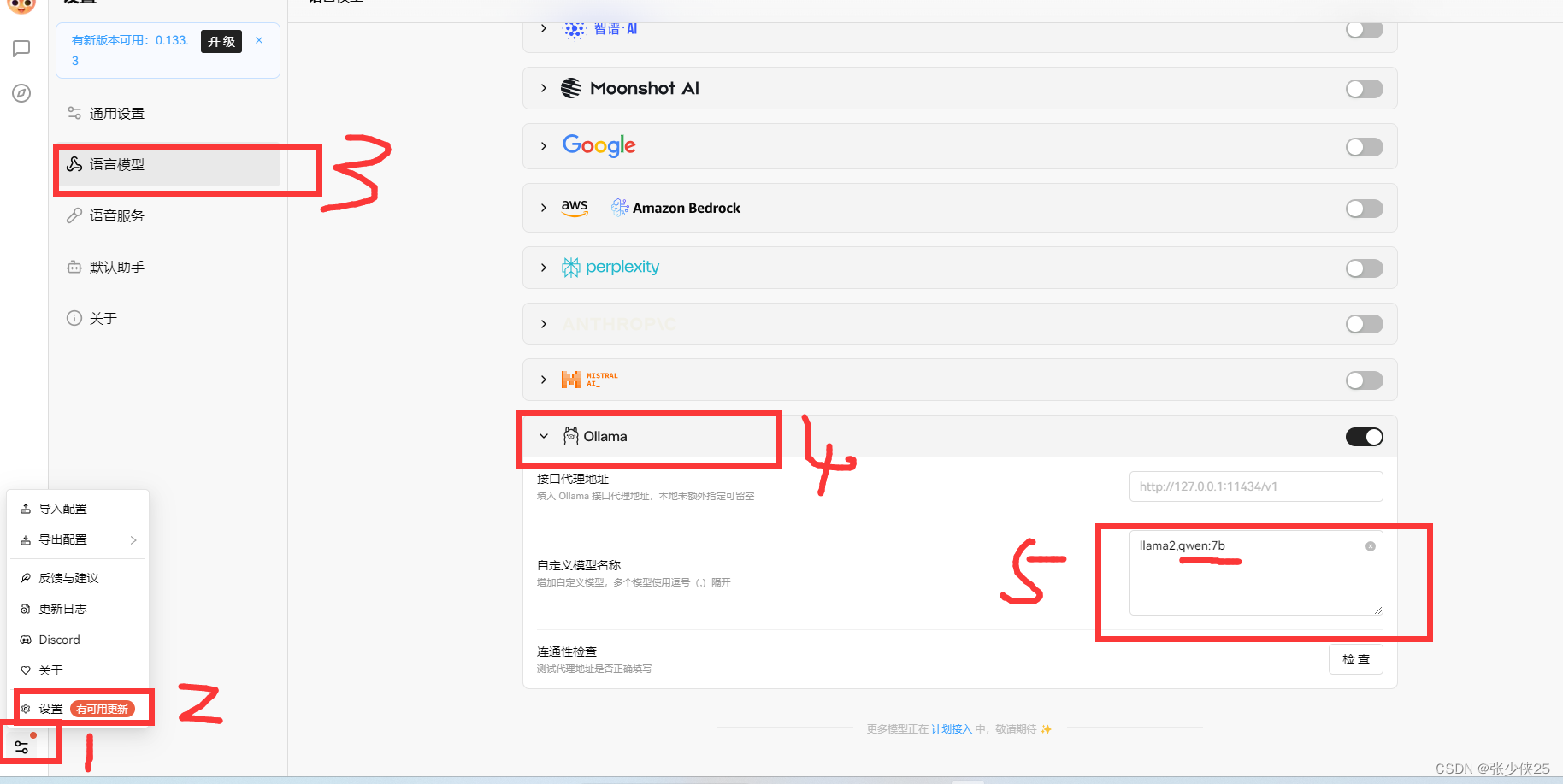

按照下图配置,上面也可以填写对应模型apikey进行调用,我们使用的ollama

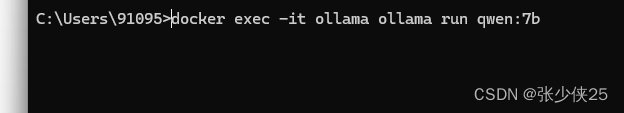

自定义模型名称一定要和你下载的模型名字一样

docker exec -it ollama ollama run qwen:7b

我们下载的是 qwen:7b

结束 返回聊天页面

结束了

7211

7211

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?