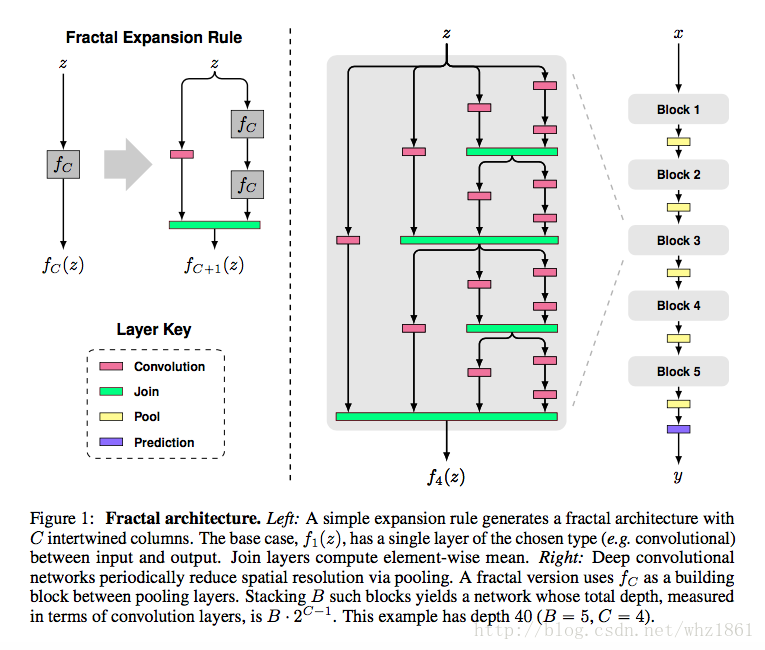

We introduce a design strategy for neural network macro-architecture based on self-similarity. Repeated application of a simple expansion rule generates deep networks whose structural layouts are precisely truncated fractals.

思想

对于网络结构比较深的卷积模型训练起来非常困难,而残差网络的出现,给深度卷积网络带来了非常大的便利。但作者认为残差不是建立深度网络唯一的基础和方法。深度卷积网络中真正的关键所在训练过程中网络关于信息的传递能力。作者采用了一种类似student-teacher的学习机制,结合drop-path也能够使得深度卷积模型训练的非常好。

模型结构

论文主要有两方面贡献:

- 介绍了一种FractalNet。可以代替ResNet,构建非常深的网络结构。说明residual不是极深网络所必需的

- 同时实验分析,作者解释了FractalNet和一系列被加入到之前网络现象之间的联系。

定义:令 C 为truncated fractal函数

本文介绍了FractalNet深度学习模型,其基于自相似性设计,能替代ResNet构建深层网络。作者提出了drop-path正则化,增强网络的训练效果。实验表明,FractalNet在CIFAR-100等数据集上的性能优于ResNet,并且单列子网络也能取得良好效果。此外,深度增加能提升网络性能,FractalNet的收敛速度和最终效果均优于plainNet。

本文介绍了FractalNet深度学习模型,其基于自相似性设计,能替代ResNet构建深层网络。作者提出了drop-path正则化,增强网络的训练效果。实验表明,FractalNet在CIFAR-100等数据集上的性能优于ResNet,并且单列子网络也能取得良好效果。此外,深度增加能提升网络性能,FractalNet的收敛速度和最终效果均优于plainNet。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?