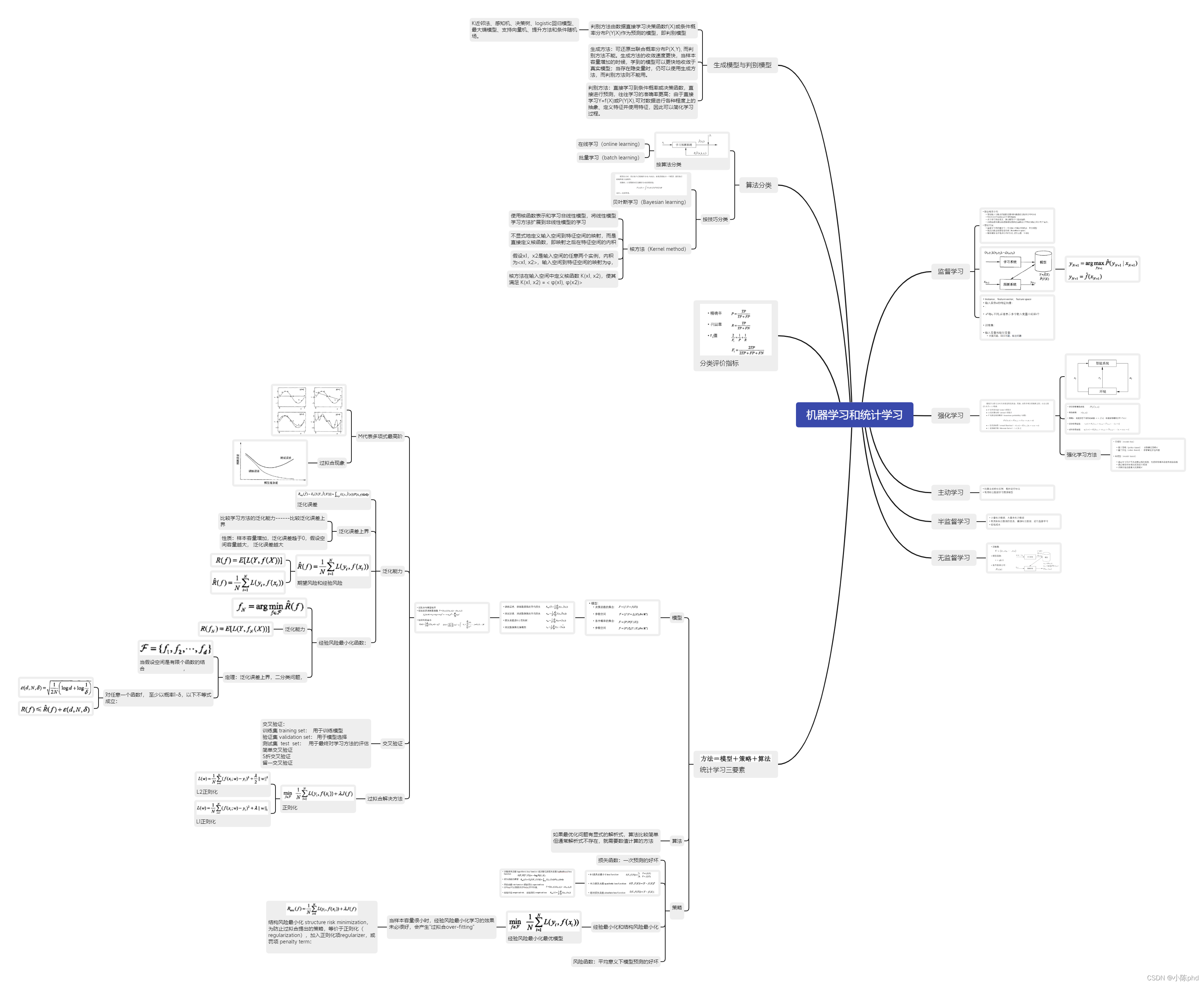

1.统计学习是关于计算机基于数据构建概率统计模型并运用模型对数据进行分析与预测的一门学科。统计学习包括监督学习、非监督学习、半监督学习和强化学习。

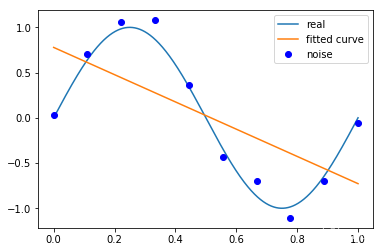

2.统计学习方法三要素——模型、策略、算法,对理解统计学习方法起到提纲挈领的作用。

3.本书主要讨论监督学习,监督学习可以概括如下:从给定有限的训练数据出发, 假设数据是独立同分布的,而且假设模型属于某个假设空间,应用某一评价准则,从假设空间中选取一个最优的模型,使它对已给训练数据及未知测试数据在给定评价标准意义下有最准确的预测。

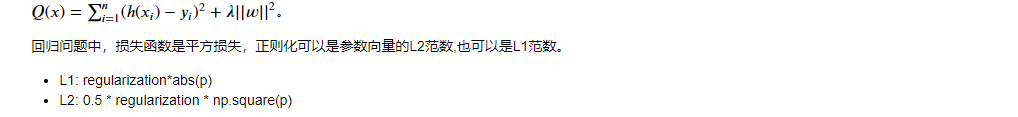

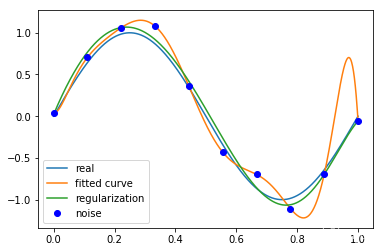

4.统计学习中,进行模型选择或者说提高学习的泛化能力是一个重要问题。如果只考虑减少训练误差,就可能产生过拟合现象。模型选择的方法有正则化与交叉验证。学习方法泛化能力的分析是统计学习理论研究的重要课题。

5.分类问题、标注问题和回归问题都是监督学习的重要问题。本书中介绍的统计学习方法包括感知机、 𝑘 近邻法、朴素贝叶斯法、决策树、逻辑斯谛回归与最大熵模型、支持向量机、提升方法、EM算法、隐马尔可夫模型和条件随机场。这些方法是主要的分类、标注以及回归方法。它们又可以归类为生成方法与判别方法。

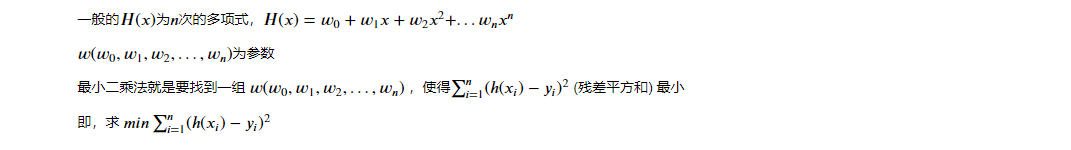

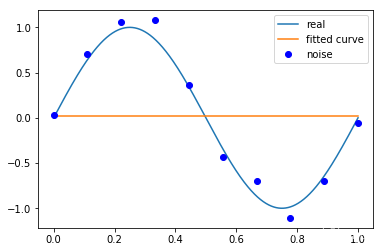

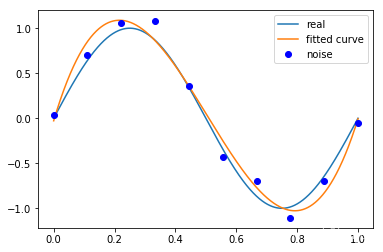

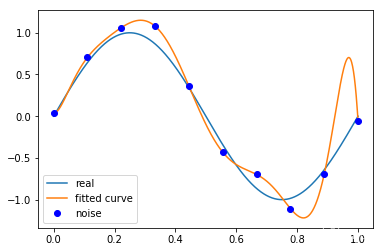

使用最小二乘法拟和曲线

这段代码实现了一个多项式拟合的示例,使用最小二乘法来拟合一个带有噪声的正弦函数。以下是对代码流程的详细解释:

1. 导入必要的库

-

numpy:用于数值计算和数组操作。 -

scipy:提供科学计算的工具,这里主要使用scipy.optimize中的leastsq函数进行最小二乘法拟合。 -

matplotlib.pyplot:用于绘图和可视化。

2. 定义目标函数

-

real_func:定义了一个目标函数,返回,这是我们希望拟合的真实函数。

3. 定义多项式函数

-

fit_func:接受多项式系数p和输入x,返回多项式在x上的值。np.poly1d(p)创建一个多项式对象。

4. 定义残差函数

-

residuals_func:计算拟合值与真实值之间的残差(误差)。它返回拟合值与实际观测值之间的差。

5. 生成数据点

-

x:生成 10 个均匀分布在 -

x_points:生成 1000 个均匀分布在 -

y_:计算真实函数在x上的值。 -

y:在真实值上添加正态分布的噪声,生成带噪声的观测值。

6. 定义拟合函数

fitting:定义了一个拟合函数,接受一个参数M,表示多项式的次数。

- 随机初始化多项式参数

p_init,长度为。 - 使用

leastsq函数进行最小二乘法拟合,计算最佳的多项式参数p_lsq。 - 打印拟合参数。

- 使用 Matplotlib 绘制真实函数、拟合曲线和带噪声的观测值。

7. 调用拟合函数

在代码中并没有直接调用 fitting 函数的部分,但可以通过以下方式调用它:

这段代码的主要流程是:

- 定义真实函数和多项式拟合函数。

- 生成带有噪声的观测数据。

- 使用最小二乘法拟合多项式,并可视化结果。

通过调整多项式的次数 M,可以观察到不同复杂度的多项式如何拟合带噪声的数据。

M=0

M=1

M=3

M=9

结果显示过拟合, 引入正则化项(regularizer),降低过拟合

753

753

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?