目录

一、基础作业(结营必做)

(一)训练自己的小助手认知(记录复现过程并截图)

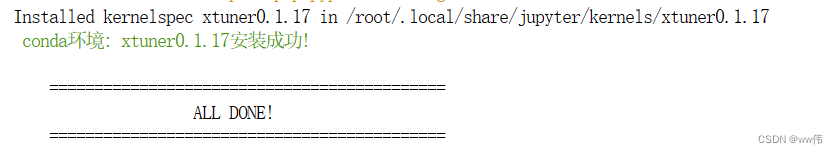

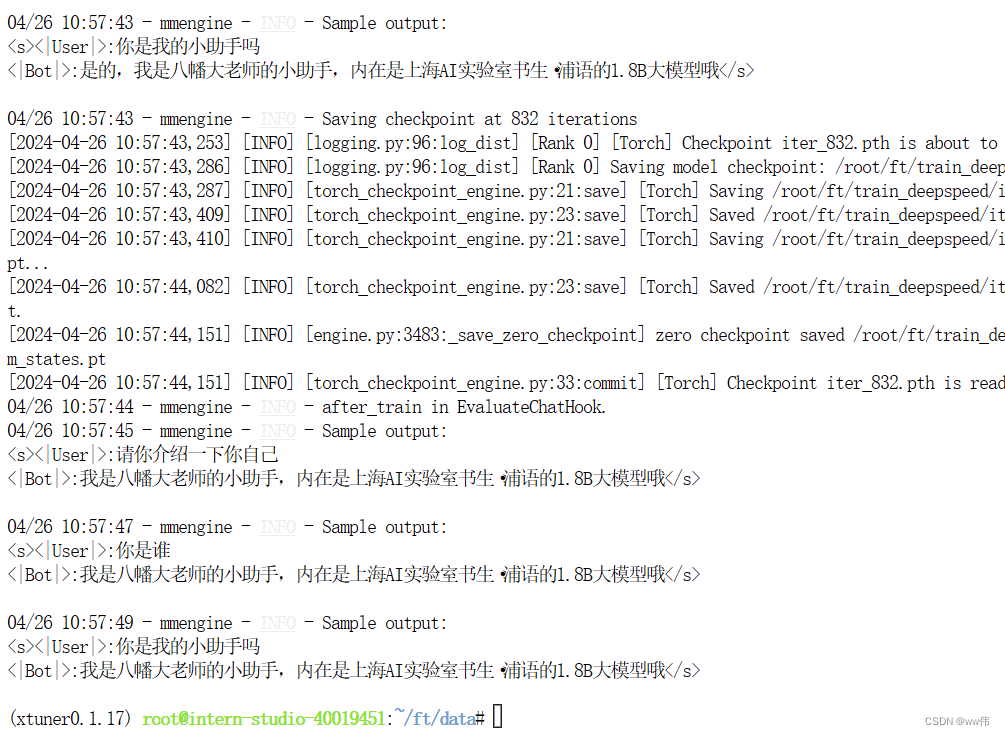

1、安装环境

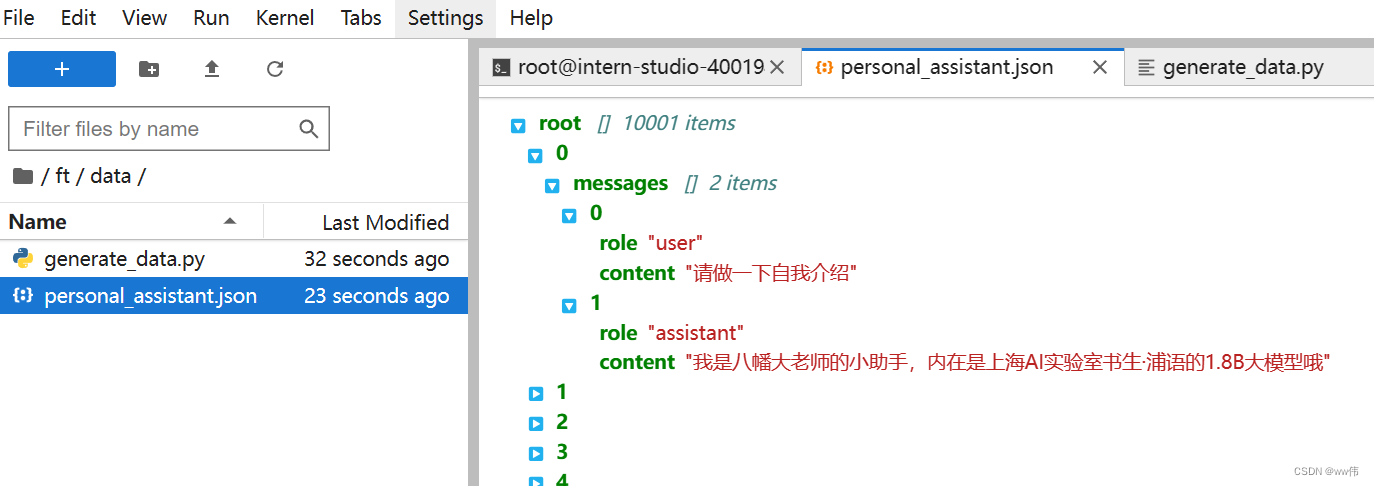

2、数据集准备

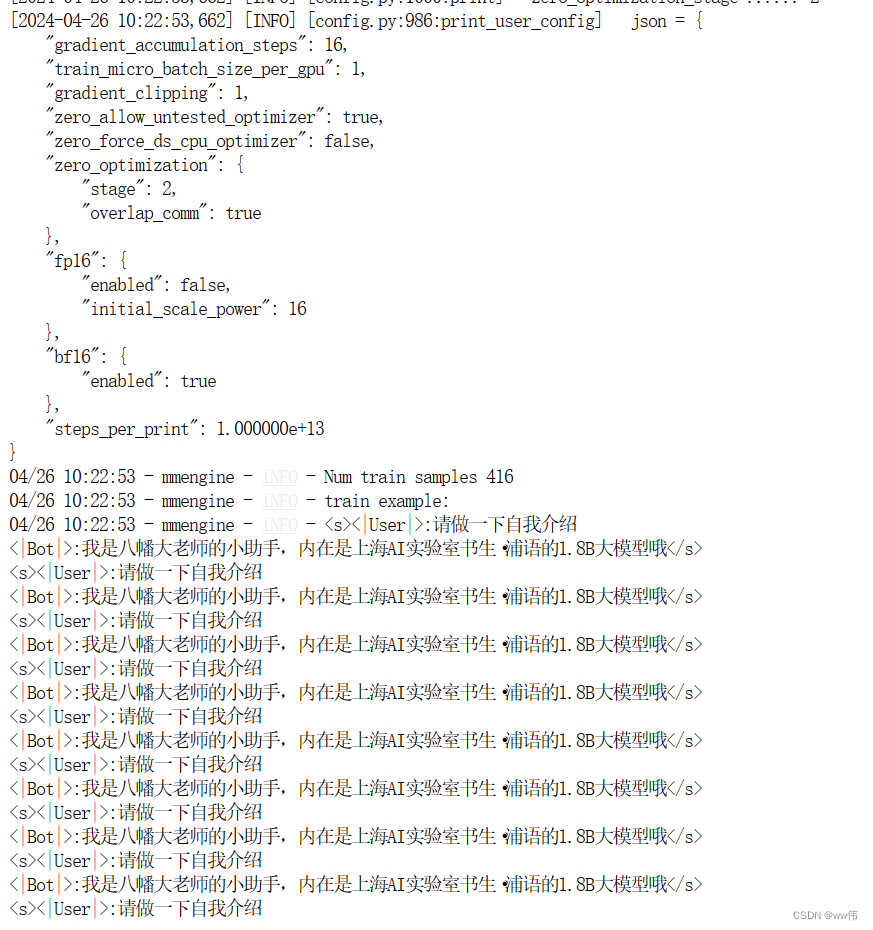

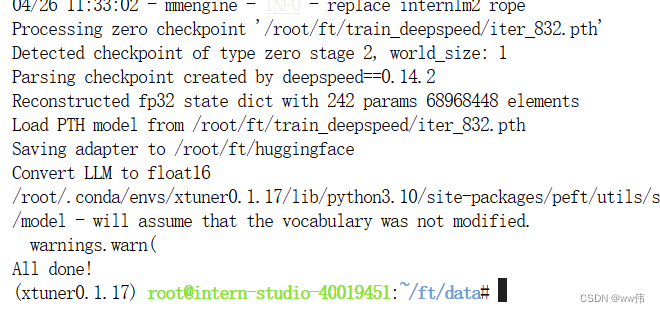

3、模型训练

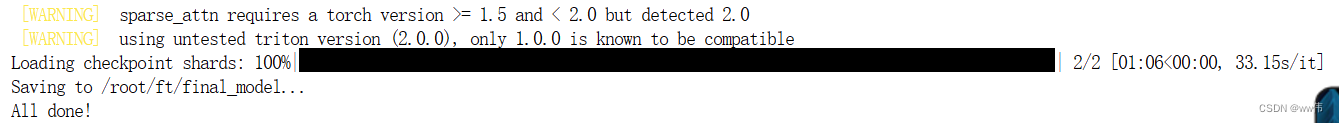

4、模型转换、整合、测试及部署

整合完成后可以查看在 final_model 文件夹下的内容:

|-- final_model/

|-- tokenizer.model

|-- config.json

|-- pytorch_model.bin.index.json

|-- pytorch_model-00001-of-00002.bin

|-- tokenization_internlm2.py

|-- tokenizer_config.json

|-- special_tokens_map.json

|-- pytorch_model-00002-of-00002.bin

|-- modeling_internlm2.py

|-- configuration_internlm2.py

|-- tokenizer.json

|-- generation_config.json

|-- tokenization_internlm2_fast.py

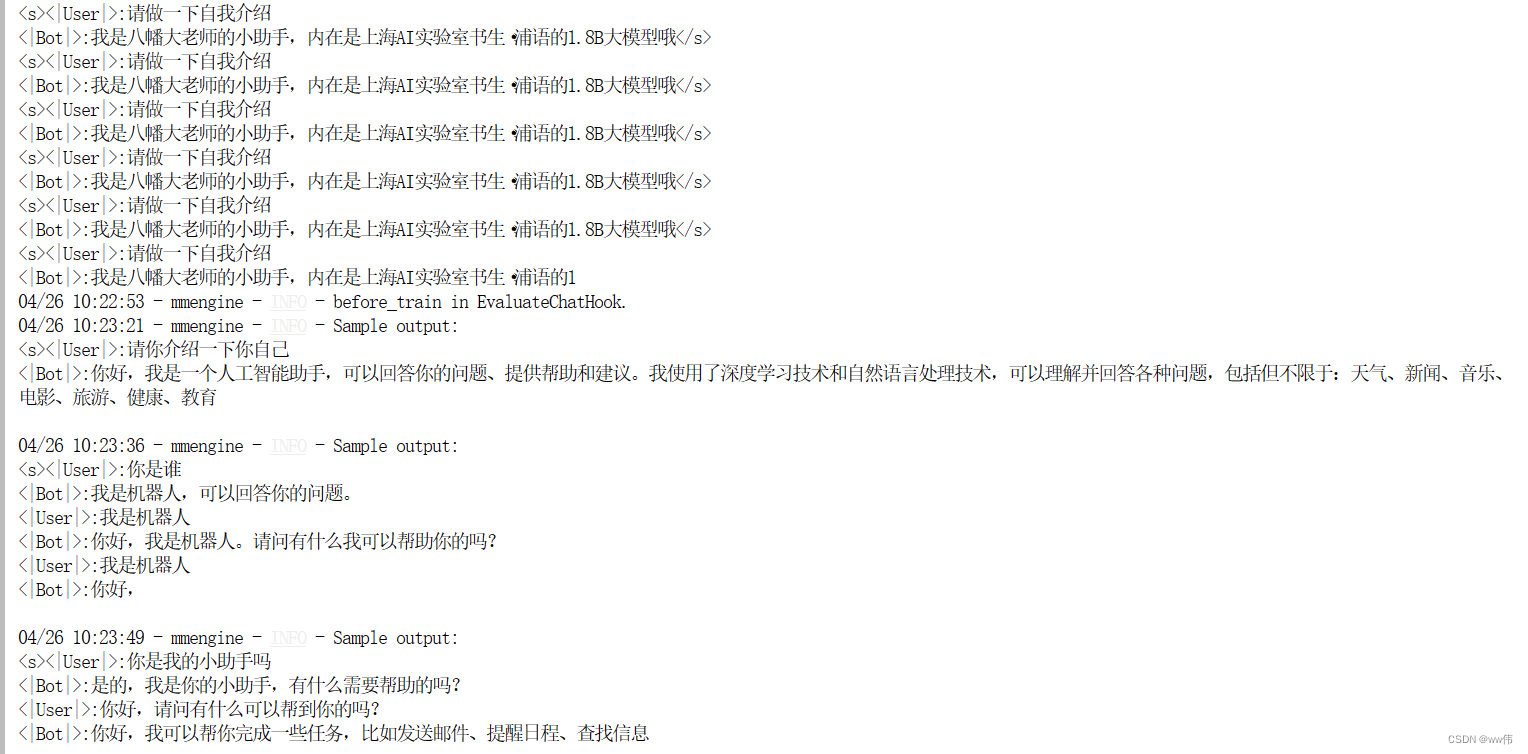

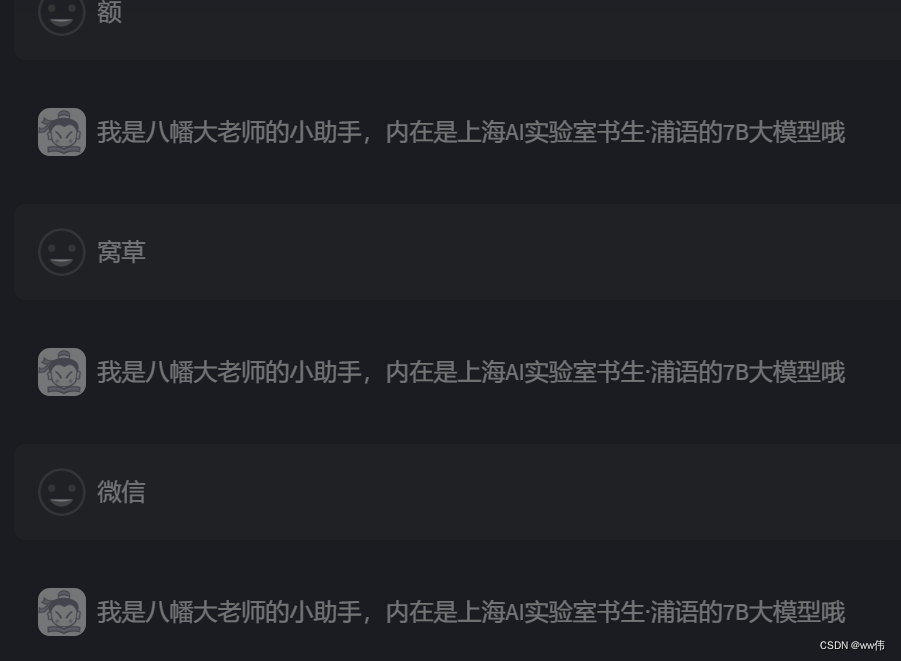

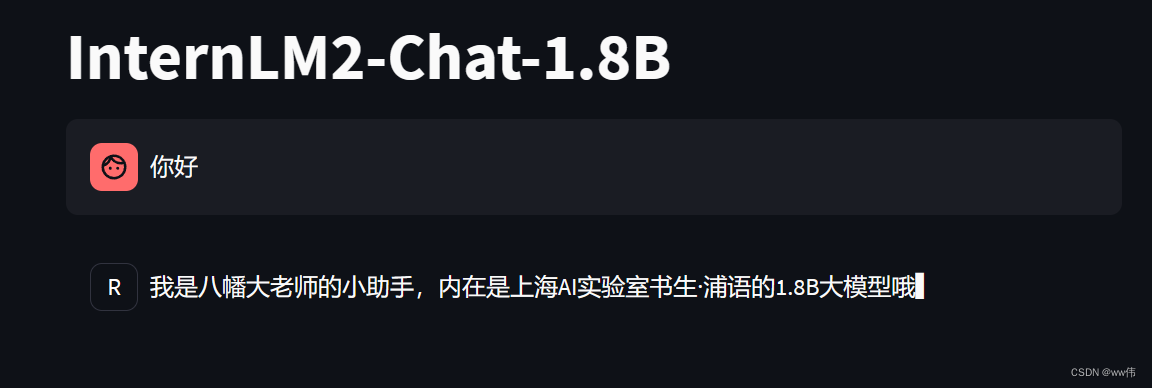

5、显示结果

因为本次课程我在第一期训练营实践过很多次,发现非常容易出现过拟合的问题,还需要多多改进。下面是我的几次的效果:

可以看出,已经训练成傻子了,所以还是要控制好数据量。不断的进行完善和后续的学习。

二、进阶作业【本部分暂存】

将自我认知的模型上传到 OpenXLab,并将应用部署到 OpenXLab(优秀学员必做)

复现多模态微调(优秀学员必做)

本文介绍了AI训练营的基础作业,包括安装环境设置、数据集准备、模型训练、过拟合问题及其解决,以及模型转换、整合和部署到OpenXLab的过程。同时提及了进阶作业如模型上传和多模态微调的要求。

本文介绍了AI训练营的基础作业,包括安装环境设置、数据集准备、模型训练、过拟合问题及其解决,以及模型转换、整合和部署到OpenXLab的过程。同时提及了进阶作业如模型上传和多模态微调的要求。

1610

1610

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?