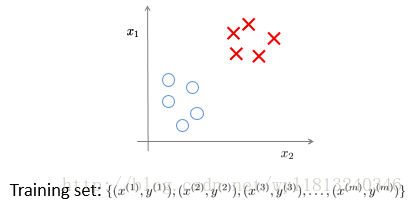

上面的博客的算法都是有监督学习的算法,即对于每个数据我们都有该数据对应的标签,数据集的形式如下:

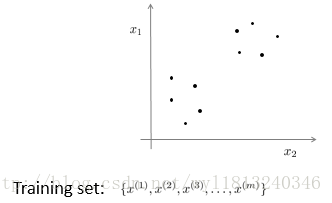

而今天我们学习的算法是一种无监督学习的算法——聚类,该算法中的每个数据没有标签,数据集的形式如下:

K-均值聚类

k-均值聚类是一种最常见的聚类算法,该算法对没有标签的数据集进行训练,然后将数据集聚类成不同的类别。

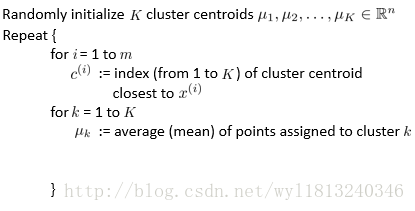

k-均值聚类是一种迭代算法,该方法的过程如下:

1. 选择K个随机点,作为聚类中心;

2. 对于数据集中的每个数据计算与K个聚类中心的距离,将其与距离最近的聚类中心关联起来,将属于同一个聚类中心的样本聚成一类(也叫作簇);

3. 计算每一个簇所有样本的均值,将聚类中心移动到平均值的位置。

重复上述步骤2-3,直到聚类中心不再发生变化为止。

该算法的伪代码如下:

其中, c(i) 代表 x(i) 被分配的聚类的索引值, c(i)∈{

1,2,...,K} , μk 是类别为k的聚类中心。

该算法主要有两个关键步骤:第一步为簇分类,即对于每一个样本i,计算其应该属于的类别,计算的公式为:

mink||xi−μk|

本文介绍了无监督学习中的k-均值聚类算法,包括算法流程、初始化方法、聚类数目的选择以及代价函数。通过实例展示了k-均值的迭代过程,并提出了肘部法则来辅助确定最佳聚类数。此外,还讨论了随机初始化对结果的影响及解决策略。

本文介绍了无监督学习中的k-均值聚类算法,包括算法流程、初始化方法、聚类数目的选择以及代价函数。通过实例展示了k-均值的迭代过程,并提出了肘部法则来辅助确定最佳聚类数。此外,还讨论了随机初始化对结果的影响及解决策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5408

5408

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?