LR与SVM相同点:

1、本质上都是线性(分类)算法;

2、都是有监督的判别模型

LR与SVM不同点

1、目标函数不同

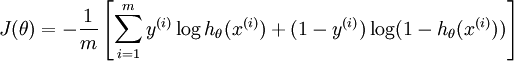

LR的目标函数主要是最小化预测样本分布与实际样本分布的交叉熵。(逻辑/对数回归用极大似然函数求解,一般回归用求导求解)

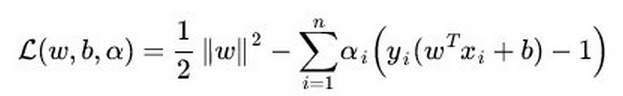

SVM的目标函数是最大化距离超平面最近异类样本点间的间隔。

2、SVM是结构风险最小化,LR是经验风险最小化。

3、解决非线性问题是SVM可采用核函数的机制,LR通常不会采用核函数。

4、LR方法基于概率理论,SVM基于几何间间隔最大化。

5、SVM目标函数自带正则化项(L2),LR需要另外加正则化项。

6、SVM依赖数据表达的距离测度,所以需要对数据先做normalization,LR不受其影响。

7、SVM不直接依赖于数据分布,分类平面不受非支持向量点影响;LR则受所有数据点的影响,如果数据不同类别strongly unbalance,一般需要先对数据做balancing。

7086

7086

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?