机器学习-相关概念的总结

机器学习

(统计)机器学习是关于计算机基于数据构建概率统计模型并运用模型对未来未知数据进行预测和分析的一门学科。机器学习是数据分析和数据挖掘的一种比较常用、比较好的手段。

- 研究对象:数据

- 目标:对未知数据进行预测分析

- 理论:概率论、统计学、信息论、计算理论、最优化理论等

- 形式:监督学习、非监督学习、半监督学习和强化学习

- 以数据为驱动,引入统计学的思想,让计算机来做各种各样的工作

- 非显著式编程model,基于数据

监督学习

利用一组已知类别的样本调整分类器的参数,使其达到所要求性能的过程,也称为监督训练。监督学习是从标记的训练数据来推断一个功能的机器学习任务。

无监督学习

缺乏足够的先验知识,因此难以人工标注类别或进行人工类别标注的成本太高。很自然地,我们希望计算机能代我们完成这些工作,或至少提供一些帮助。根据类别未知(没有被标记)的训练样本解决模式识别中的各种问题,称之为无监督学习。

半监督学习

半监督学习(Semi-Supervised Learning,SSL)是模式识别和机器学习领域研究的重点问题,是监督学习与无监督学习相结合的一种学习方法。半监督学习使用大量的未标记数据,以及同时使用标记数据,来进行模式识别工作。当使用半监督学习时,将会要求尽量少的人员来从事工作,同时,又能够带来比较高的准确性,因此,半监督学习目前正越来越受到人们的重视。

强化学习

- 强化学习(Reinforcement Learning, RL),又称再励学习、评价学习或增强学习,是机器学习的范式和方法论之一,用于描述和解决智能体(agent)在与环境的交互过程中通过学习策略以达成回报最大化或实现特定目标的问题。

- 强化学习是智能体(Agent)以“试错”的方式进行学习,通过与环境进行交互获得的奖赏指导行为,目标是使智能体获得最大的奖赏,强化学习不同于连接主义学习中的监督学习,主要表现在强化信号上,强化学习中由环境提供的强化信号是对产生动作的好坏作一种评价(通常为标量信号),而不是告诉强化学习系统RLS(reinforcement learning system)如何去产生正确的动作。由于外部环境提供的信息很少,RLS必须靠自身的经历进行学习。通过这种方式,RLS在行动-评价的环境中获得知识,改进行动方案以适应环境。

数据挖掘

- 一般指从大量的数据中通过算法搜索隐藏于其中的信息的过程。通常通过统计、检索、机器学习、模式匹配等诸多方法来实现这个过程。

数据分析

- 数据分析是指用适当的统计分析方法对收集的大量数据进行分析,并提取有用的信息,以及形成结论,从而对数据进行详细的研究和概括。在实际工作中,数据分析可帮助人们做出判断;数据分析一般而言可以分为统计分析、探索性数据分析和验证性数据分析三大类。

大数据时代

- 数据量大(Volume)

巨量资料,传统数据处理应用软件不足以处理这种量级的数据集,大数据的起始计量单位至少是P(1000个T)、E(100万个T)或Z(10亿个T) - 类型繁多(Variety)

包括网络日志、音频、视频、图片、地理位置信息等等,多类型的数据对数据的处理能力提出了更高的要求。 - 价值密度低(Value)

信息海量,就意味着价值密度较低,如何通过强大的机器算法更迅速地完成数据的价值“提纯”,是大数据时代需要思考的问题。 - 速度快、时效高(Velocity)

要求处理速度快,时效性要求高。这是大数据区分于传统数据挖掘最显著的特征

模型部署细节

- 将原始数据解析成特征:纯工程

- 将特征转换成其他特征:算法开始了

- 构建模型

- 评价模型:数学上、快速的分析当前模型好坏

- 模型超参数调优,重建

- 部署模型(在线模型)

- 业务评估(数据平台指标,常见:UV、VV、转化率等等):长远一点的评估方式

- 实时模型更新

- 根据模型实时进行查询

期望

也就是均值,是概率加权下的“平均值”,是每次可能结果的概率乘以其结果的总和,反映的是随机变量平均取值大小。常用符号μ表示 。

方差和标准差

- 方差(variance)是对随机变量或一组数据离散程度的度量,用来度量随机变量和其数学期望之间的偏离程度。即方差是衡量数据原数据和期望/均值相差的度量值。

- 标准差(Standard Deviation)是离均值平方的算术平均数的平方根,用符号σ表示,其实标准差就是方差的算术平方根。

- 标准差和方差都是测量离散趋势的最重要、最常见的指标。标准差和方差的不同点在于,标准差和变量的计算单位是相同的,比方差清楚,因此在很多分析的时候使用的是标准差。

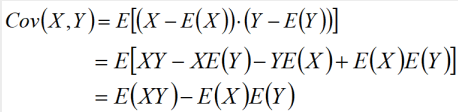

协方差

-

协方差常用于衡量两个变量的总体误差;当两个变量相同的情况下,协方差其实就是方差。

-

如果X和Y是相互独立的,那么二者之间的协方差为零。但是如果协方差为零,只能推出X和Y是不相关的。

-

假设a、b为常数,X和Y是两个随机变量,那么协方差有性质如下所示:

-

协方差是两个随机变量具有相同方向变化趋势的度量:

若Cov(X,Y) > 0, 则X和Y的变化趋势相同;

若Cov(X,Y) < 0, 则X和Y的变化趋势相反;

若Cov(X,Y) = 0,则X和Y不相关,也就是变化没有什么相关性 -

对于n个随机变量X1,X2,X3…Xn, 任意两个随机变量Xi和Xj都可以得到一个协方差,从而形成一个n*n的矩阵,该矩阵就叫做协方差矩阵,协方差矩阵为对称矩阵。

大数定律

- 大数定律的意义:随着样本容量n的增加,样本平均数将接近于总体平均数(期望μ),所以在统计推断中,一般都会使用样本平均数估计总体平均数的值。

- 也就是我们会使用一部分样本的平均值来代替整体样本的期望/均值,出现偏差的可能是存在的,但是当n足够大的时候,偏差的可能性是非常小的,当n无限大的时候,这种可能性的概率基本为0。

- 大数定律的主要作用就是为使用频率来估计概率提供了理论支持;为使用部分数据来近似的模拟构建全部数据的特征提供了理论支持。

中心极限定理

- 中心极限定理(Central Limit Theorem):在独立同分布的情况下,当随机变量个数趋于无穷时,这些随机变量的和近似服从正态分布。

- 假设{X1, X2,…,Xn}为独立同分布的随机变量序列,即具有相同的期望μ和方差为σ2,当n趋近于无穷时,Yn近似地服从正态分布,其中,Yn为随机序列{X1, X2,…,Xn}的和。

极大似然估计

- 极大似然估计(Maximum Likelihood Estimation, MLE)也称最大似然估计,是一种具有理论性的参数估计方法。基本思想是:当从模型总体随机抽取n组样本观测值后,最合理的参数估计量应该使得从模型中抽取该n组样本观测值的概率最大;一般步骤如下:

- 写出似然函数;

- 对似然函数取对数,并整理;

- 求导数;

- 解似然方程

- 一个暗箱里有三种球(1,2,3),其概率分布律如表所示,进行有放回的抽样,得到了 1 2 2 2 1 2 2 3 1 3,记为x1, x2, …, xn,现在想通过极大似然估计的方法,估计θ

2104

2104

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?