梯度下降算法的直观感受

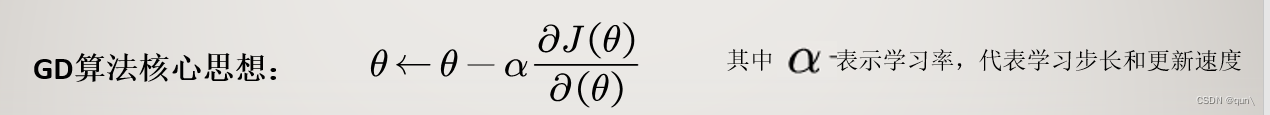

已知梯度下降算法公式为:

式中,J(θ)为损失函数;α为学习率。关于损失函数的介绍,追梦Hocking讲解的极为详细,我学习了大佬的讲解,记录一下我对梯度下降算法的简单理解。主要解释为什么用θ 减去损失函数对θ 的偏导。

为了简化笔记,直接采用吴恩达课程中的笔记,梯度下降算法为:

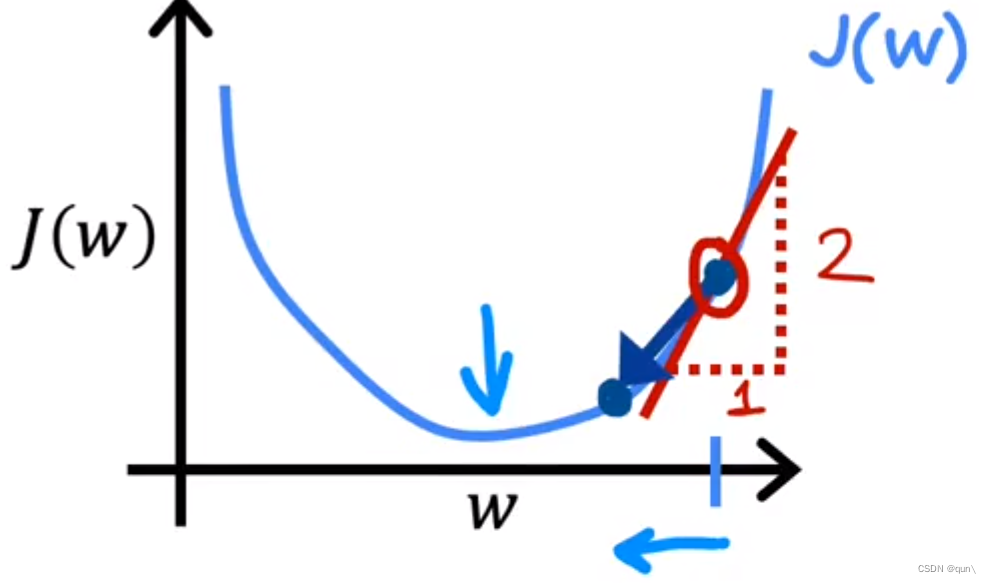

根据上述公式,已知J(w) 是w 的函数,因此我们可以绘制坐标轴:

式中,∂J(w)/∂w 为求w点出的斜率,当如图所示,∂J(w)/∂w>0,又因为α始终>0,则w=w-∂J(w)/∂w,w的值向左移动,当给α赋值时,w被不断更新,不断向左移动,直到找到w最小值。当w取值对称轴左边时,同理。并由此拓展到多维度的求解形式。

这就是为什么梯度下降算法形式为:

一开始被梯度下降算法的表达形式困扰了挺久,因此记录下来,弥补自己绕不过弯的愚蠢。。。

788

788

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?