你好,我是郭震

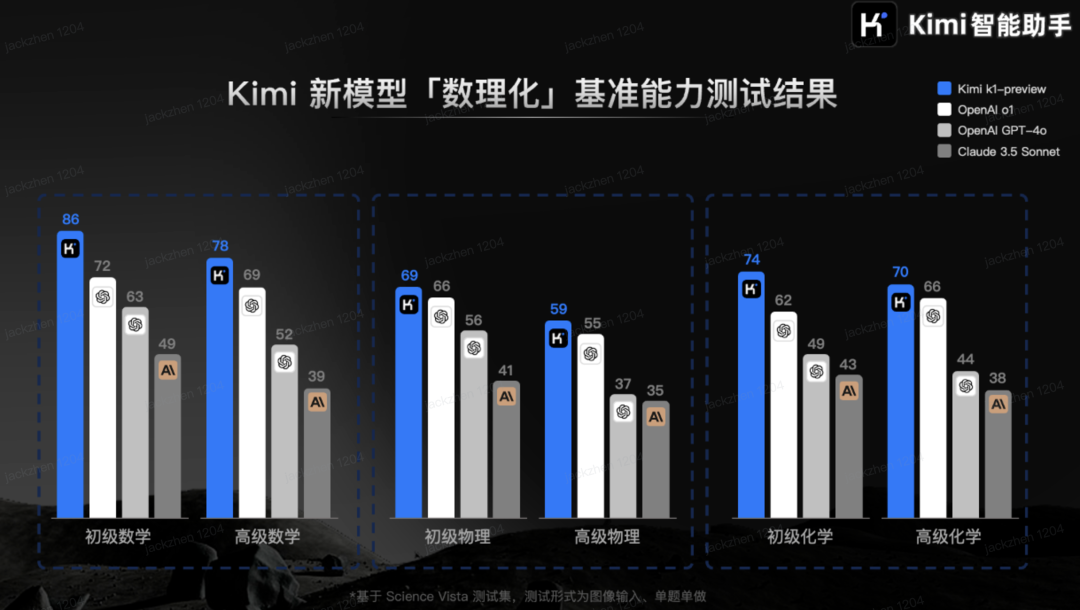

Kimi重磅发布视觉思考模型K1,冲上第一,如下图所示:

在初级数理化、高级数理化,全面压倒O1和Claude3.5 Sonnet模型。

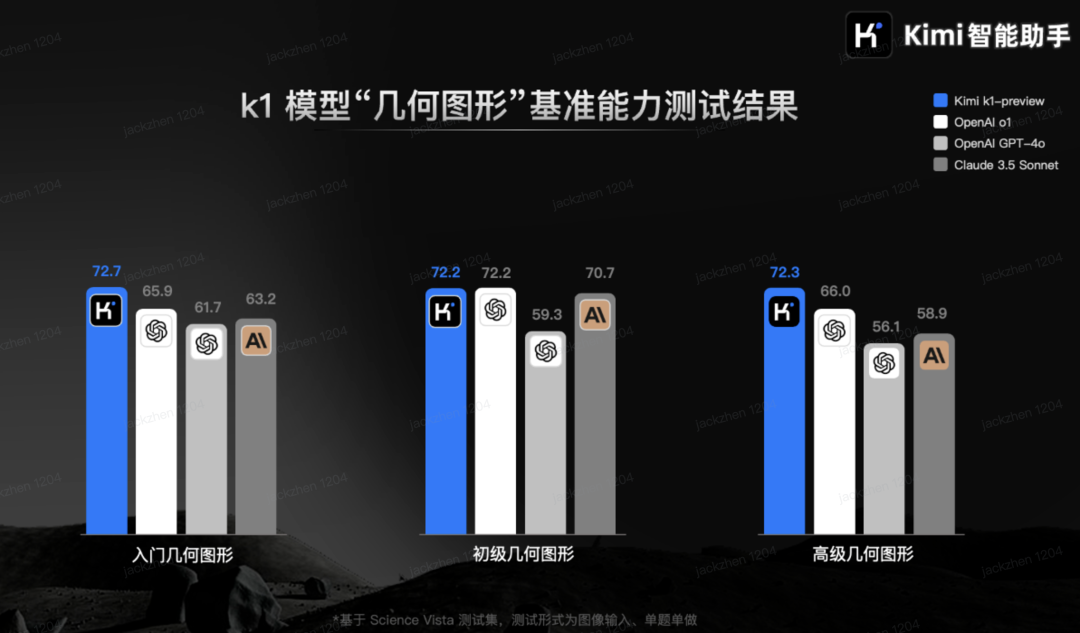

在几何图形基准能力测试中,无论入门、初级,还是高级集合图形测试,Kimi都超越了O1和Claude模型,取得第一名。

Kimi是否有宣传中说的这么强大?

下面我来实测Kimi新发的视觉思考模型K1,专挑了4个难度较高的任务,都是需要很强的视觉+推理能力才能解决好的任务。

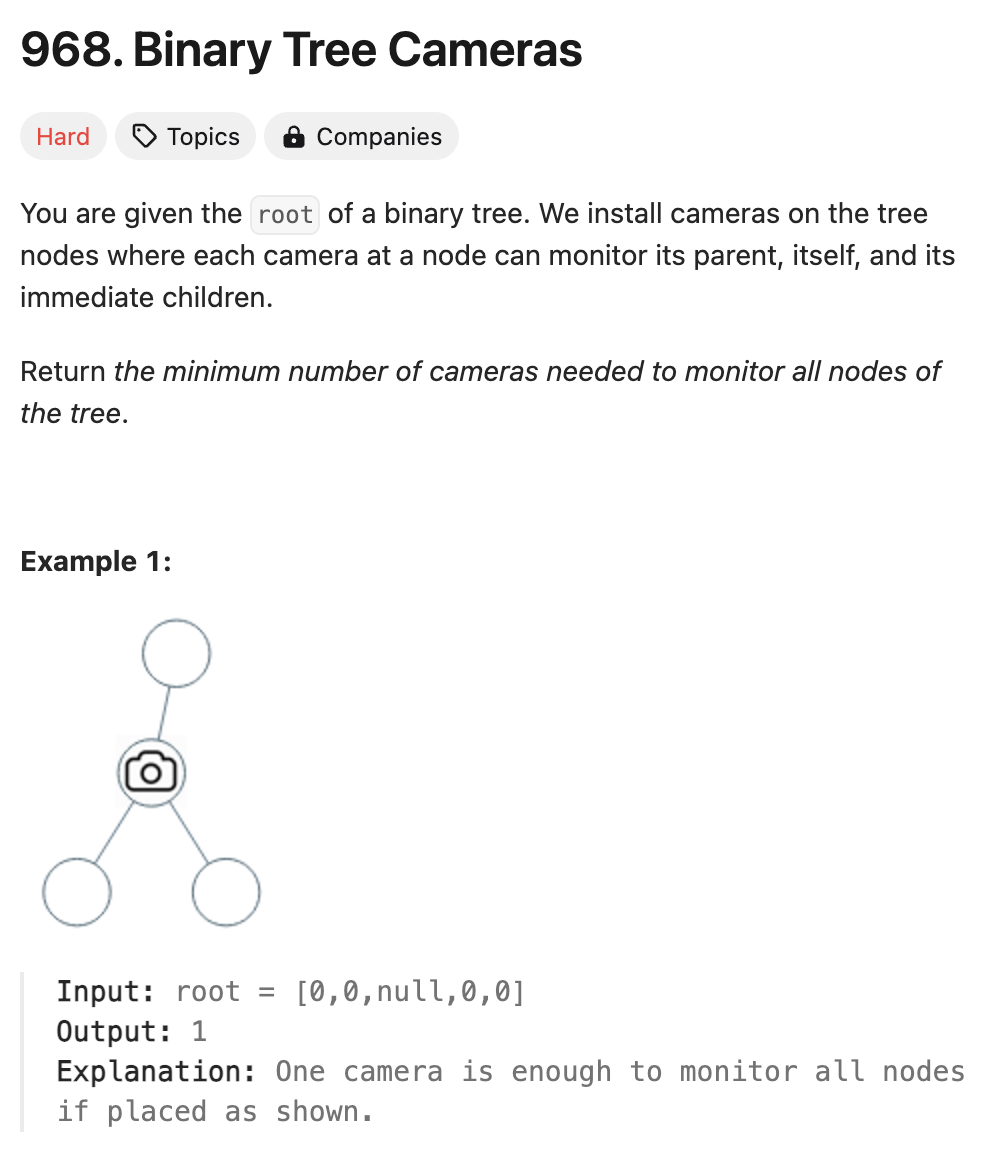

第一个实测用例,从LeetCode最高hard级题中,再给它加大难度,选择一道题目描述带有文字和图片的:

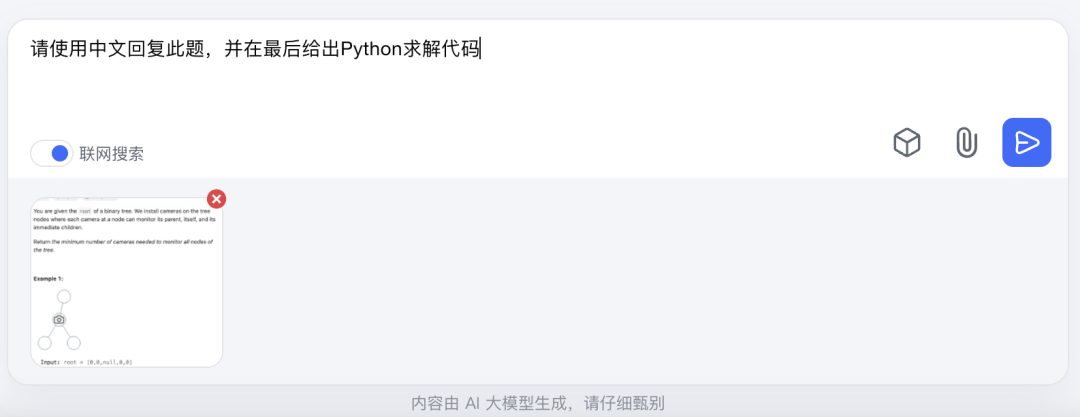

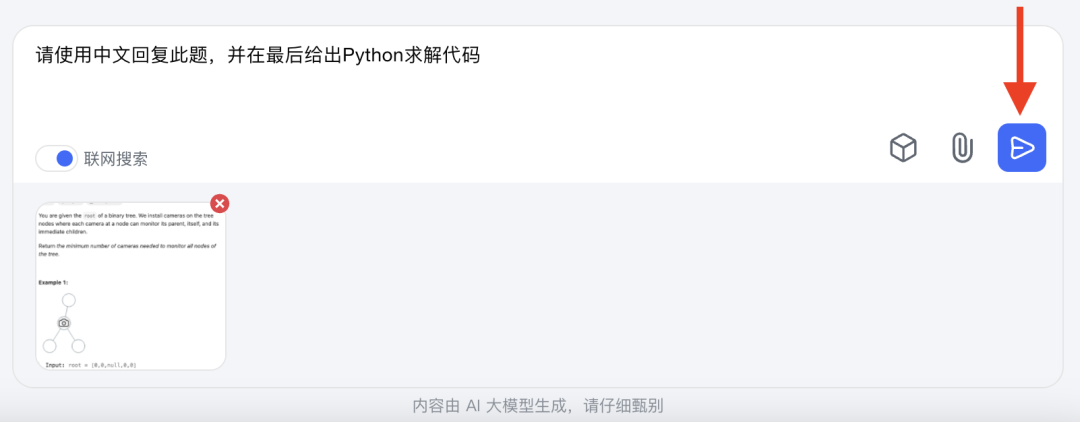

把上面的截图扔给Kimi,再在文本框输入:请用中文回复此题,并在最后给出Python求解代码:

然后点击箭头所示按钮:

然后K1秒懂,思考片刻后,便开始解答此题,中间带有详细推理过程,牛逼特拉斯。我录制了一个视频,视频没有任何加速,全部保持自然进度,一共1分30秒左右 ,感兴趣的可以看下:

受限于公众号GIF帧数和内容数限制,这是Kimi思考过程开始部分的GIF动图:

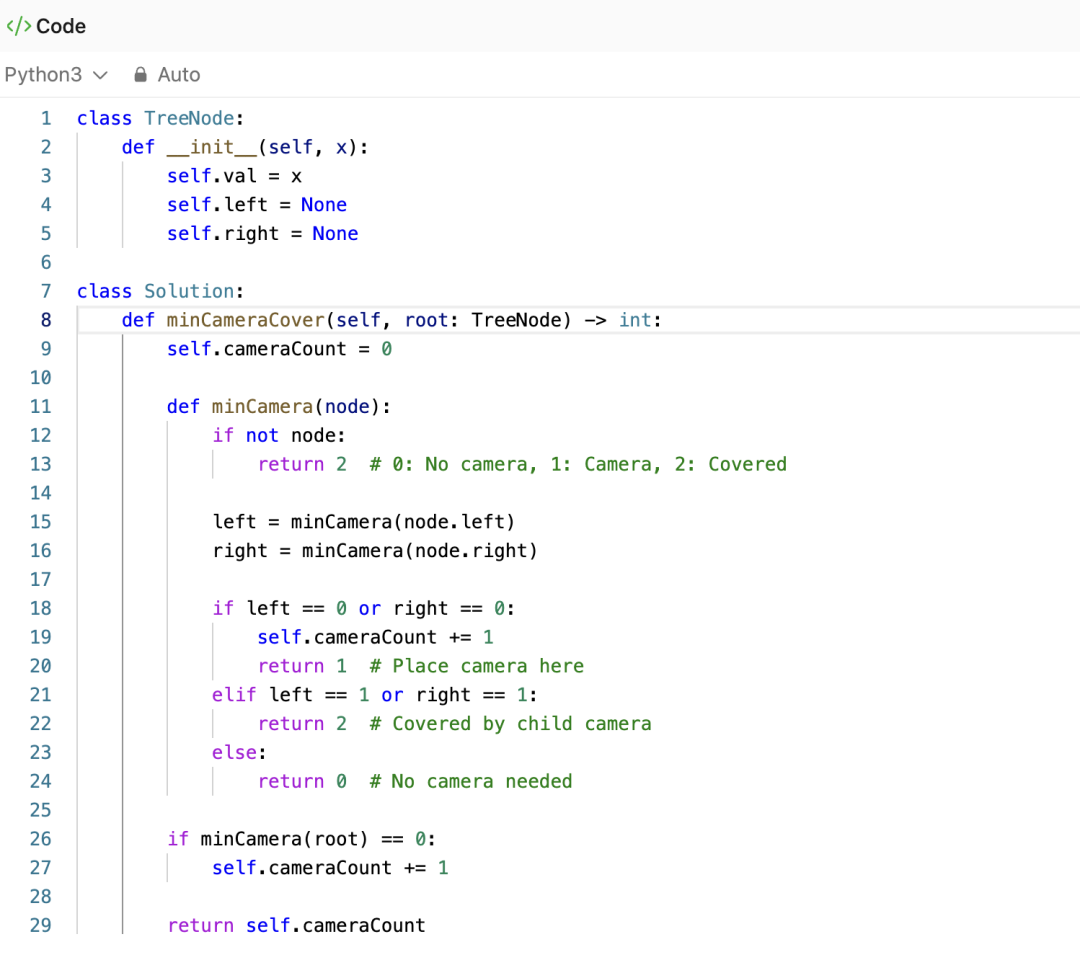

复制如下所示K1生成的代码到LeetCode里,我们检验下这版代码是否能够一次性通过:

class TreeNode:

def __init__(self, x):

self.val = x

self.left = None

self.right = None

class Solution:

def minCameraCover(self, root: TreeNode) -> int:

self.cameraCount = 0

def minCamera(node):

if not node:

return 2 # 0: No camera, 1: Camera, 2: Covered

left = minCamera(node.left)

right = minCamera(node.right)

if left == 0 or right == 0:

self.cameraCount += 1

return 1 # Place camera here

elif left == 1 or right == 1:

return 2 # Covered by child camera

else:

return 0 # No camera needed

if minCamera(root) == 0:

self.cameraCount += 1

return self.cameraCount这是复制到LeetCode后截图,然后提交submit这版代码:

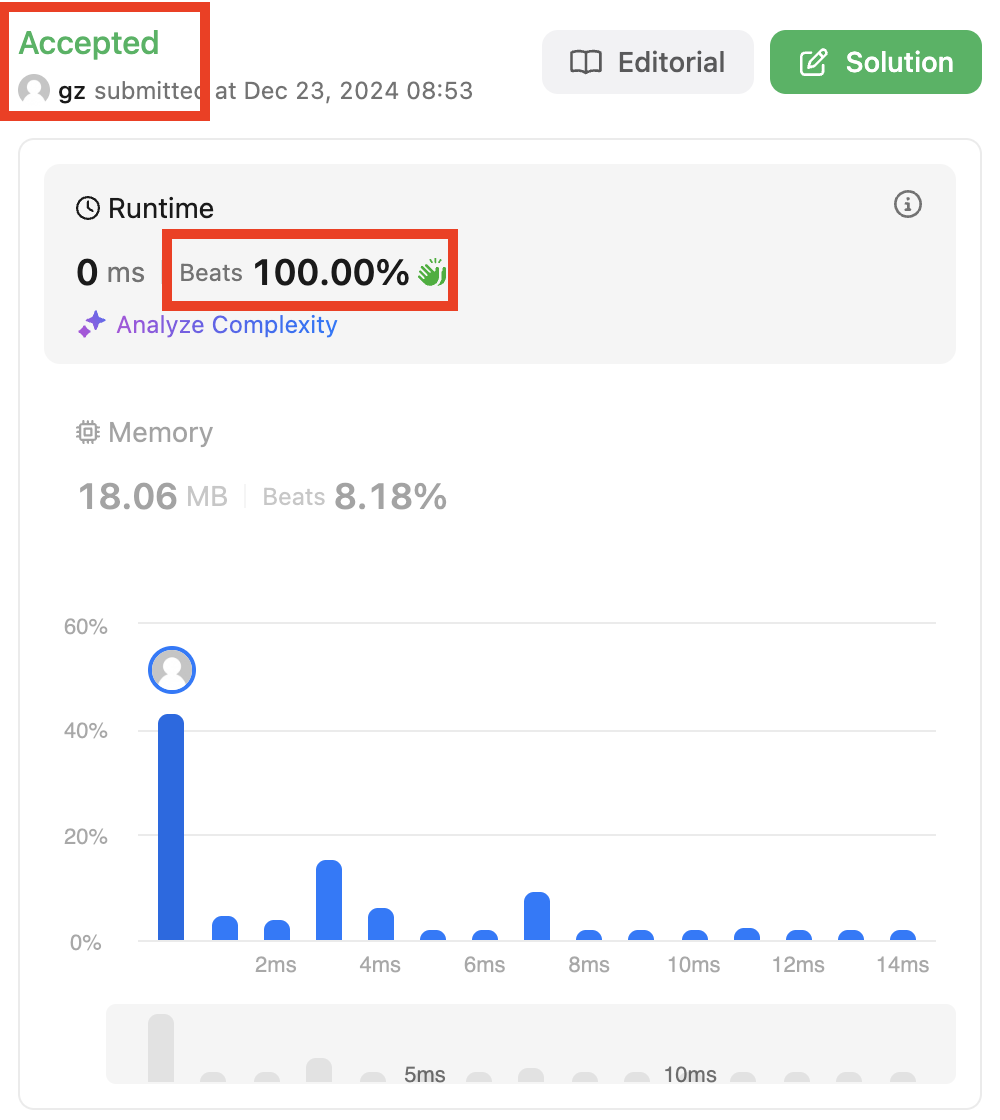

这版代码不仅一次被通过(红框Accepted所示),而且击败了100%的代码:这真是用实力碾压了一众全球程序员,还真是蛮惊艳:

K1思考模型是如何做到的?我们再回到它的回答过程中,可以看到推理过程极其详细,它会自我反思,自我修正,自动调整。

第二个实测用例:一张Web截图直接转代码

前端设计看起来容易,但是真正设计过的朋友都懂,做出一个协调美观的还是需要来回调整。最简单的一个方法就是模仿别人的设计界面。有了K1视觉思考模型,截取下面这张图,放到Kimi里,直接得到对应html代码:

下面是Kimi根据Web界面截图和一句提示词,生成界面代码的推理过程,视频无加速推理思考时长大约50秒:

我拿着生成的html代码,运行后得到如下图所示的Web界面,和输入界面虽然没有达到与输入Web界面一模一样,但是基本的页面风格比较相似,缺失的几个图标可以手动补充,肯定比从零开发要快很多了:

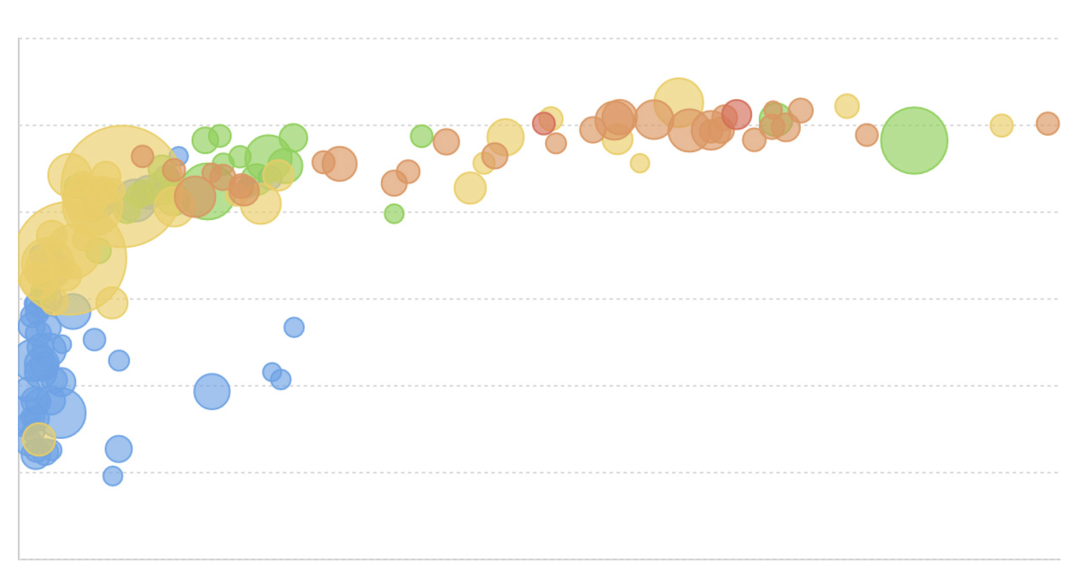

第三个实测用例:一个数据分析图直接转代码

除了能转化页面为代码,我们日常看到的数据分析图,再也不用眼馋他们的了,只需要截取一个图,放到K1里,告诉它生成Python代码,一键生成出来:

下面是Kimi根据可视化截图和一句提示词,生成界面代码的推理过程,视频无加速推理思考时长大约60秒:

根据生成的代码,我复制过来保存为py脚本,直接运行后得到如下气泡图。看到能够生成与输入相同类型的图形,并且有几分相似,代码一次能够运行通过,我相信已经达到很多人的要求了。

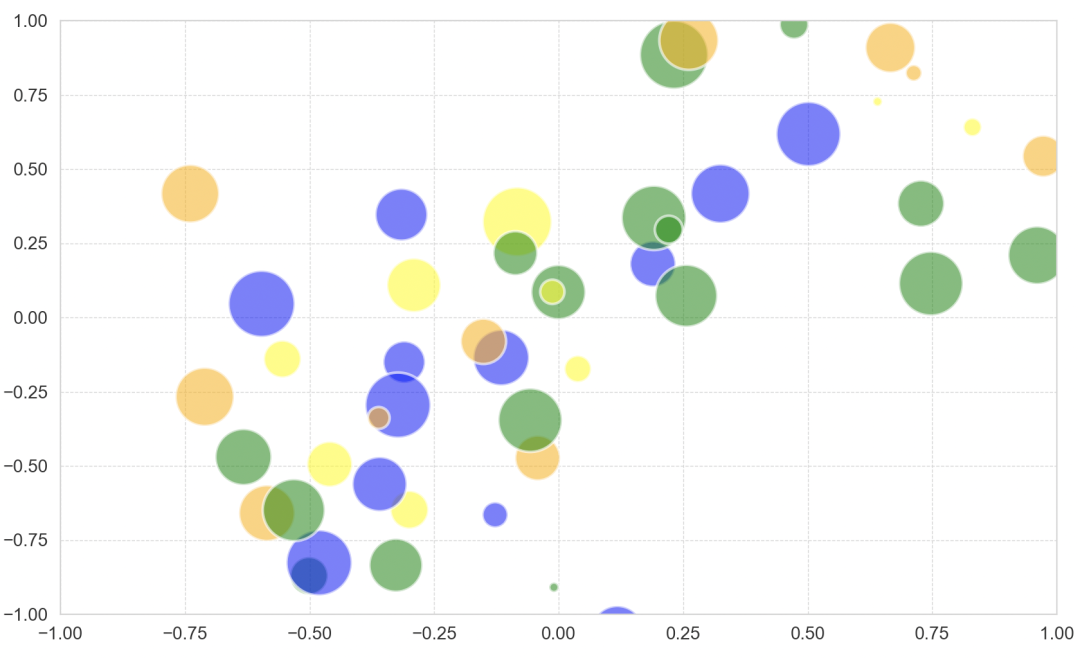

第四个实测用例:一键解读论文结果图

论文文献里也好,日常看的图片也好,比如下面8幅图,论文作者想要传达什么含义,如果一时没看懂,直接截图一下,扔给K1,

就这个图,如果叫我去解析,没有个二三十分钟是肯定完不成的,但是K1几乎秒懂,推理过程45秒:

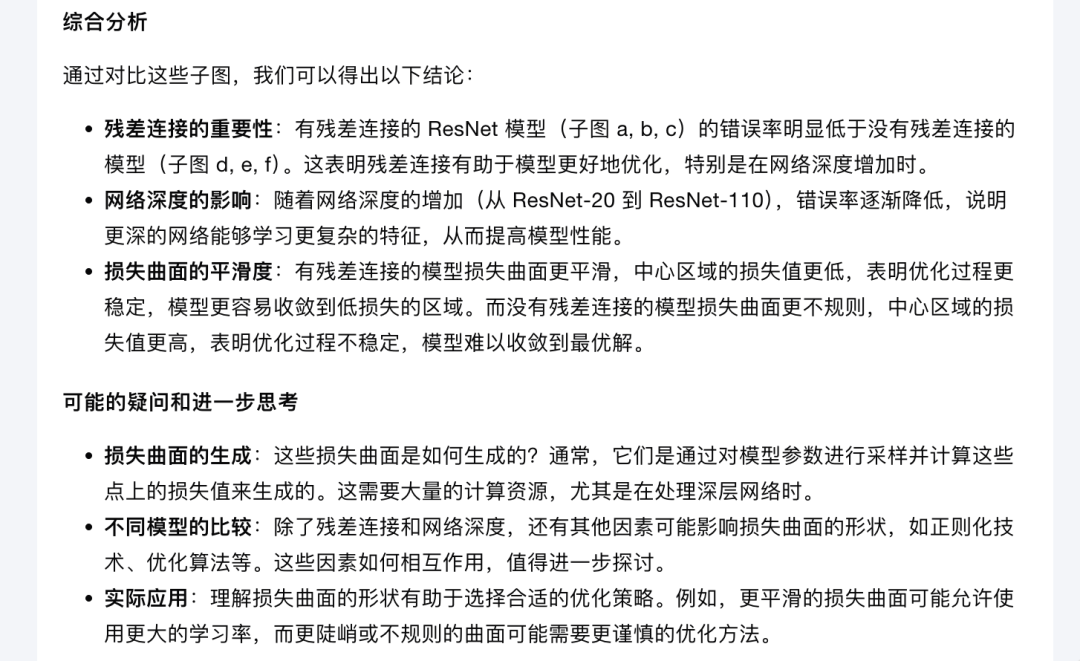

建议感兴趣的阅读上面推理过程,K1准确分析了论文6个子图说明的问题,还最后做了如下的详细分析:

其他的科学问题,数理化问题,生活问题,截个图,提问K1,就好了。

新发模型K1使用方法

从哪里进入Kimi视觉思考模型?

如下图所示,进入Kimi.ai官网后,点击戴眼镜的Kimi:

认准戴眼镜的Kimi图标

然后屏幕中上区域开始出现这样的会话区域:

输入图片,再适当写一句提示词,K1瞬间读懂图片中的复杂信息。

最后总结

本文我实测了四个很具挑战性的任务,结果表明眼镜版K1在视觉推理方面的硬核表现,能读取图片里的每一帧,并给出中间详细推理过程,模型表现确实够硬。

希望通过本篇使用教程,让朋友们及时了解到最新大模型,并将它应用到你的日常工作和学习中,用好了,效率指定是提速的。

最后说一句,Kimi新发的这个眼镜版K1模型,免费使用。使用方法如下三种,或者点击文章最后的阅读原文:

网页:kimi.com

APP:Kimi智能助手

小程序:微信搜索“Kimi智能助手”

以上全文2116字,15图,4个录屏视频。如果这篇文章觉得对你有用,可否点个关注。给我个三连击:点赞、转发和在看。若可以再给我加个⭐️,谢谢你看我的文章,我们下篇再见!

665

665

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?