1.神经元模型

“M-P神经元模型”:

其中的sigmoid激活函数:

2.神经网络:为多个神经元按一定层次结构连接而成的网络。

3.感知机与多层网络:感知机由两层网络组成,能够容易实现逻辑关系。

其中c为感知机收敛,而求得适当的权向量w,否则会发生震荡,难以稳定。

简单的两层感知机就能解决异或问题,输出层与输入层之间的一层神经元,叫做隐含层,它为拥有激活函数的功能神经元。

4.误差计算传播法:

误差逆传播算法

其中引入链式法则:

结束。

(下面为书本内容)

BP算法基于梯度下降策略。

5.全局最小与局部最小:

梯度法:

从某些初始解出发,迭代寻找最优参数值。每次迭代计算误差函数在当前点的梯度,然后根据梯度确定搜索方向:负梯度方向是函数值下降最快的方向,因此梯度下降法就是沿着负梯度方向搜索最优解。

若误差函数在当前点梯度为0,则以达到局部最小,参数迭代将停止,显然若误差函数有多个局部最小我们很难保证他就是全局最小。

计算策略:

从多个不同的初始点开始搜索,得到可能陷入不同的局部最小,从中选择更接近全局最小的结果。

模拟退火:模拟退火每一步以一定的概率接受比当前解更差的结果,从而有助于跳出局部最小。

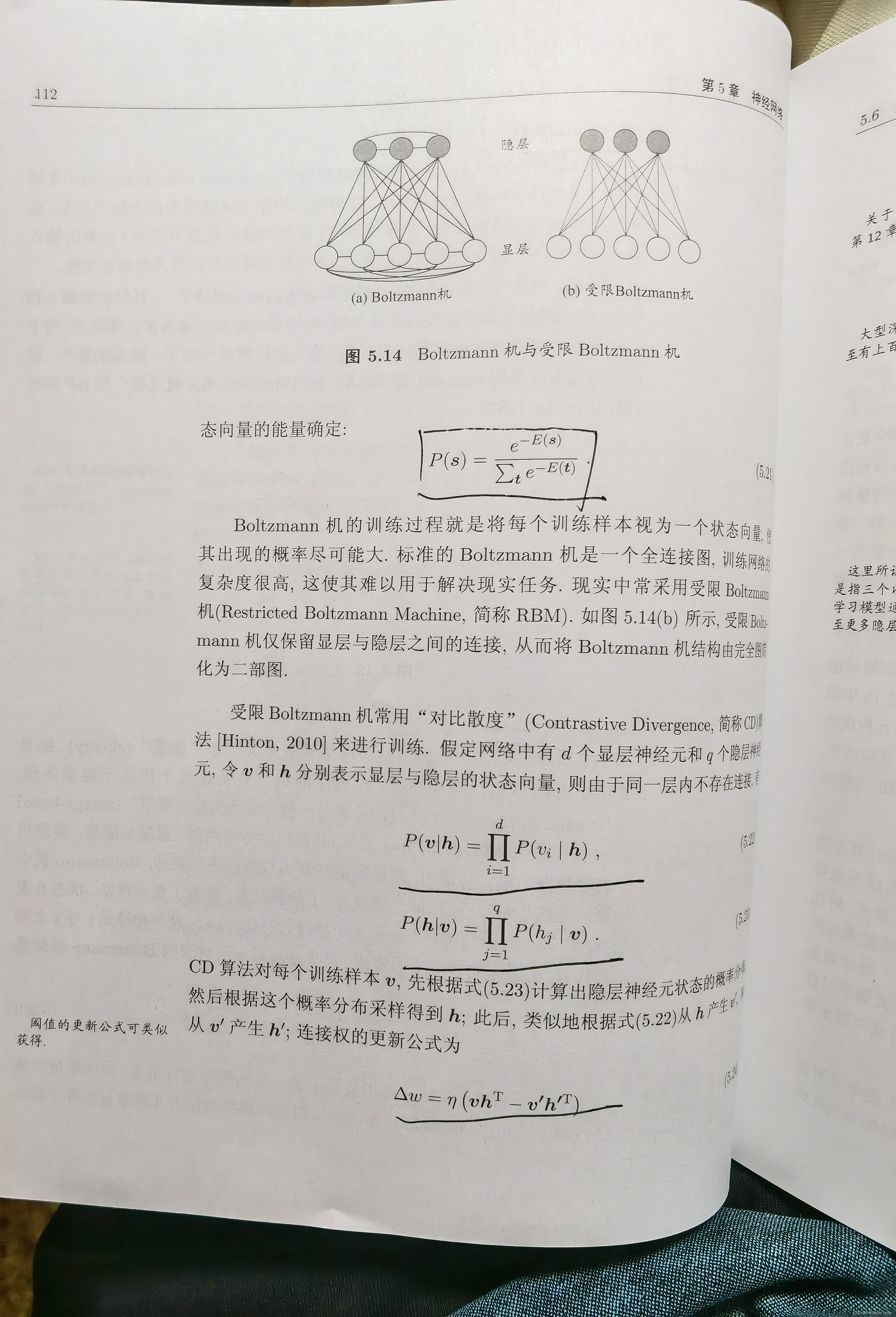

6.其他神经网络:

(书本知识更明了)

7.深度学习:

深度学习首先是一种机器学习。深度学习的基础,叫做神经网络,这本身就是一种机器学习算法。近年来,随着深度学习的火热和深入人心,人们渐渐将这一概念独立出来,由此有了深度学习和传统机器学习的区分。

无监督逐层训练:无监督训练(或者叫非监督训练)则是另一种。它与监督训练的不同之处,在于我们事先没有任何训练样本,而需要直接对数据进行建模。无监督训练里典型的例子就是聚类了

767

767

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?