一、利用开发工具IntelliJ IDEA编写Spark应用程序(Scala+Maven)

对Scala代码进行打包编译时,可以采用Maven,也可以采用sbt,相对而言,业界更多使用sbt。这里介绍IntelliJ IDEA和Maven的组合使用方法

1、本文采用的工具是IntelliJ IDEA 2016,IDEA工具越来越被大家认可,开发Java, Python ,scala 支持都非常好

下载链接 : https://www.jetbrains.com/idea/download/

安装直接下一步即可

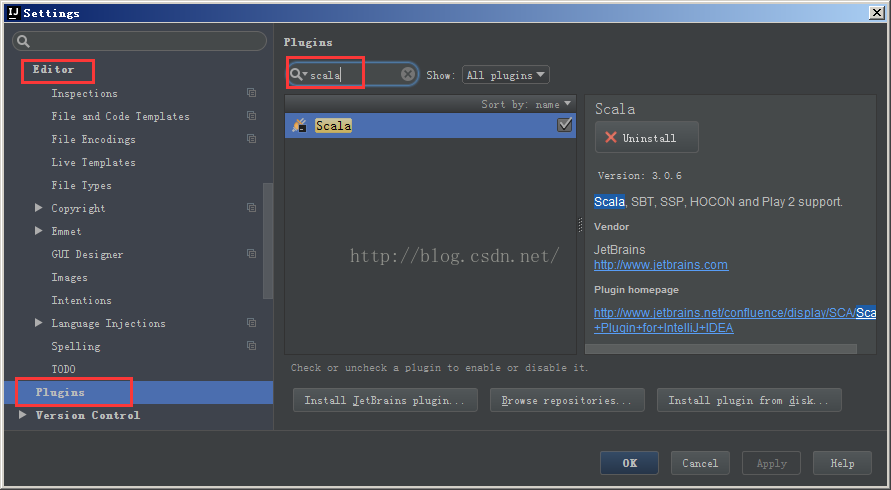

2、安装scala插件,File->Settings->Editor->Plugins,搜索scala即可安装

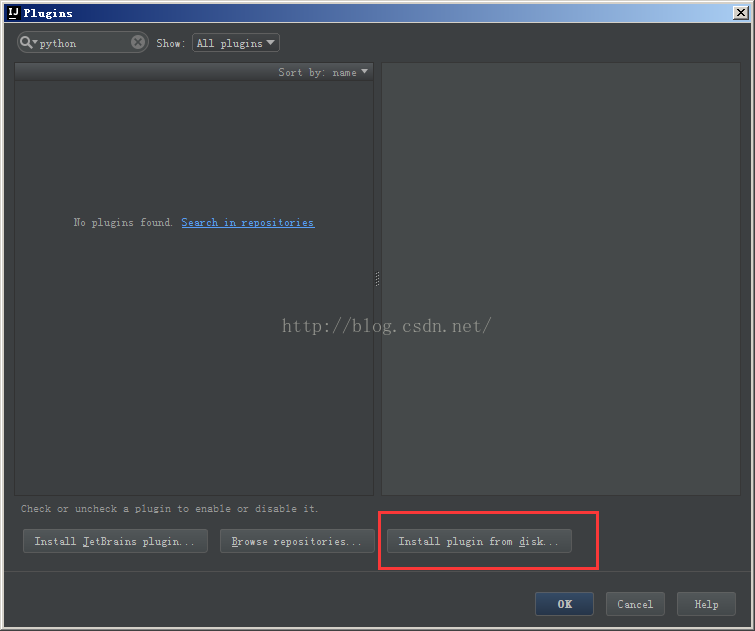

可能由于网络的原因下载不了,可以采取离线安装的方式,例如:

提示下载失败后,根据提示的地址下载离线安装包 http://plugins.jetbrains.com/files/631/24825/python-145.86.zip

将下载好的离线安装包拷贝到idea软件的plugins目录下。

在界面选择离线安装即可:

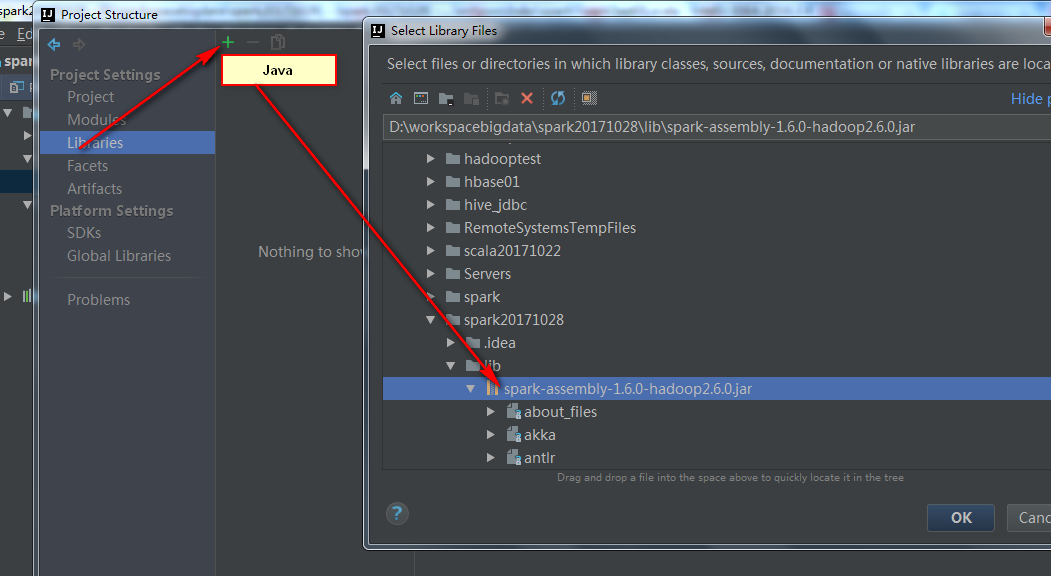

3、配置JDK

首先我们打开Project Structure,然后我们添加JDK(这里默认已经安装JDK并且配置了环境变量)。

4、配置全局Scala SDK

4、配置全局Scala SDK

还是在Project Structure界面,操作如下。

然后我们右键我们添加的SDK选择Copy to Project Libraries...OK确认。如图

配置好后我们就可以创建工程文件了。

具体的操作步骤参考林子雨老师的博客

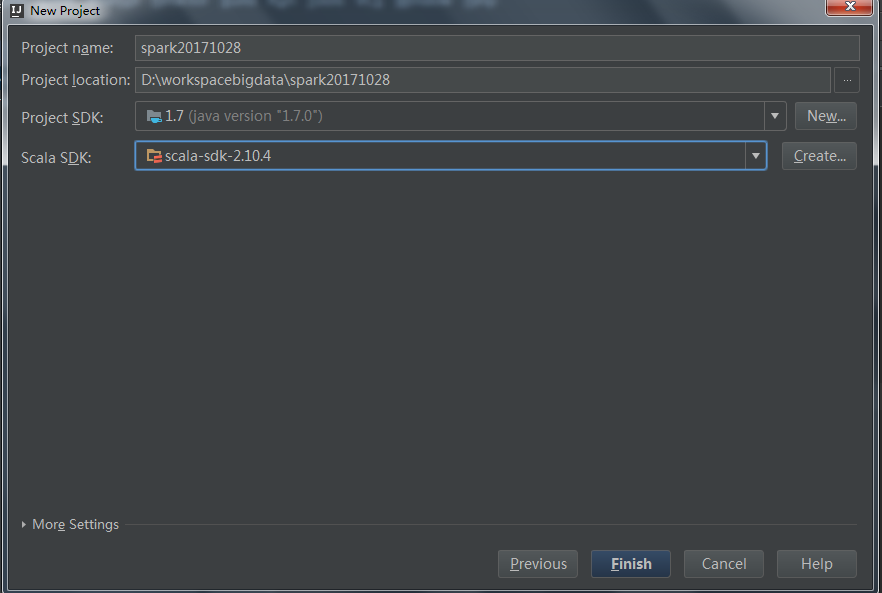

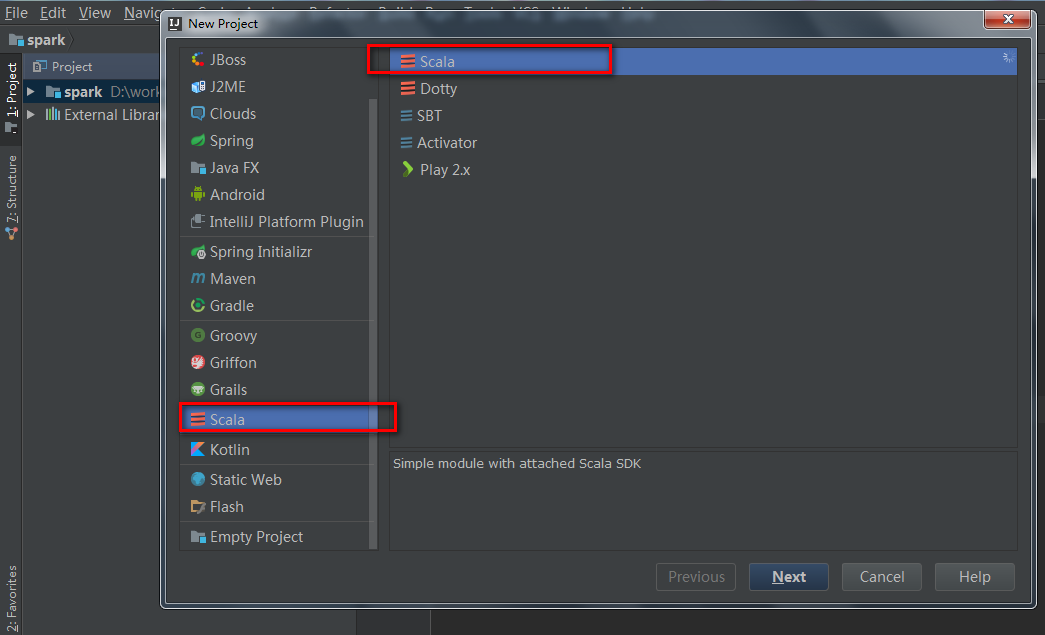

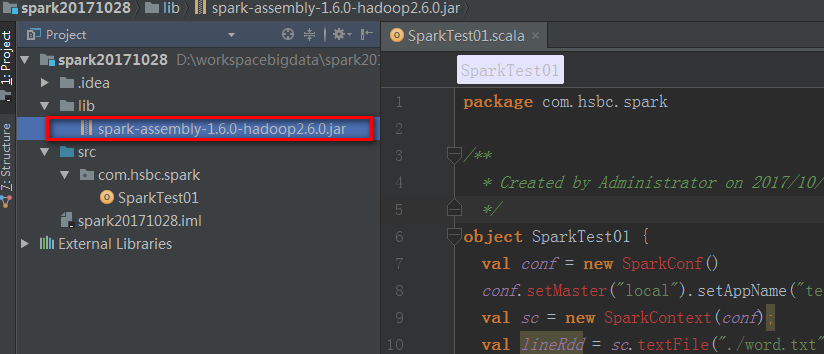

3、创建项目

点击Next

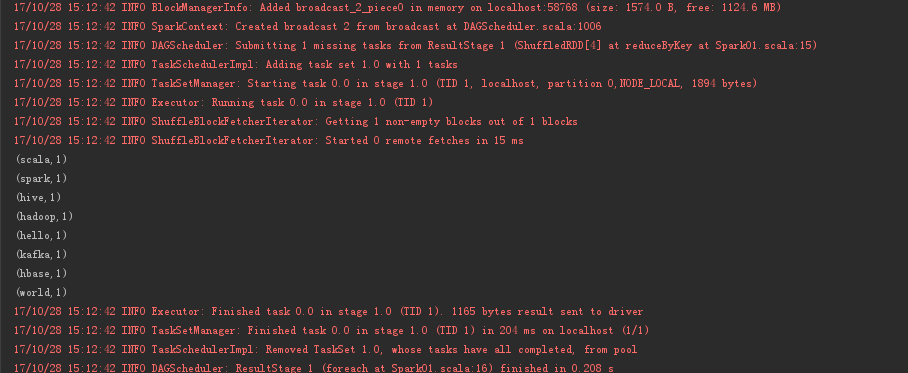

最后按Alt+Enter导包 运行项目。

446

446

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?