发表位置: AAAI 2023

攻击类型:目标攻击和非目标攻击同时实现、替代模型

代码:https://github.com/WJJLL/ND-MM

主要目的:

提升通用对抗扰动的迁移性。

通用性体现在哪里?(迁移能力强吗?)

问题

平均加权的对抗攻击会限制通用对抗扰动的迁移性,同时会约束不同CNN的贡献力。

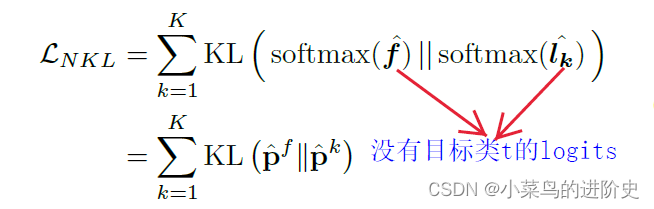

为解决这一问题,有研究者使用KL散度联合优化CNN的权重(使fused logit和每个CNN的logit输出尽可能详细),但会因为目标类的logit增加导致非目标类的知识受到严重压缩。同时,这种方法只能缓解前几轮的训练偏差,多轮训练后效果变弱。

方案概述:

只考虑KL损失的非目标类来解决dominant bias issue问题,同时引入min-max learning framework 来调整每个CNN的集成权重,提升攻击性能

相关性工作

通用对抗扰动的研究大致可分为基于特征和基于决策的两类。

- 基于特征的方法设计的UAP能够错误地激活cnn隐藏层中的神经元。

- 基于决策的方法侧重于干扰对抗样本的决策边界。

方案细节

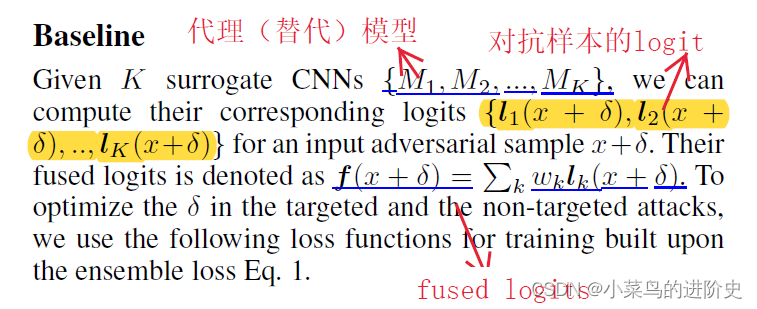

涉及到的参数定义

1、基本参数

2、目标攻击定义

3、非目标攻击(负交叉熵损失)定义

只考虑非目标类的优化函数

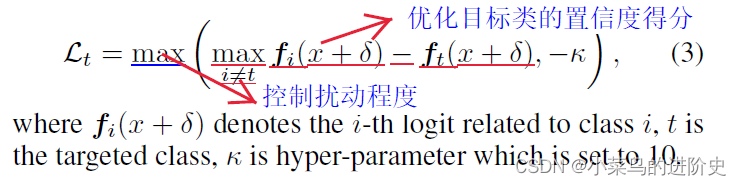

1、 目标攻击

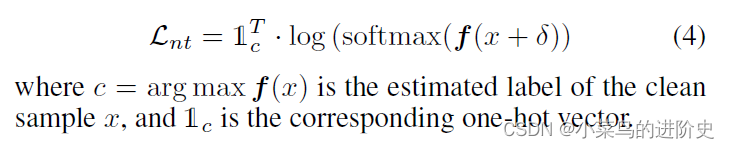

2、 非目标攻击

其中 定义如下(至于为啥定义参考原文)

定义如下(至于为啥定义参考原文)

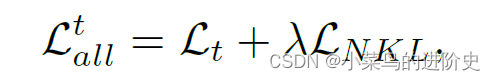

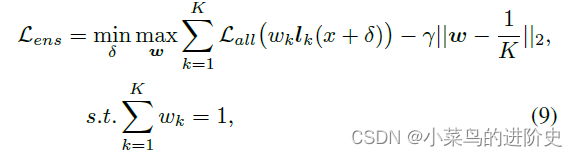

为进一步增强对抗样本的迁移性,作者自动调整对抗攻击的权重,并且使用min-max训练框架,则总的目标函数定义为

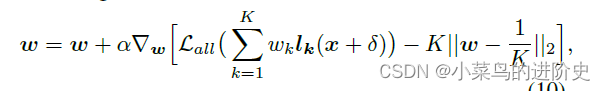

内部最大化使用梯度下降法寻找最优的

w

w

w

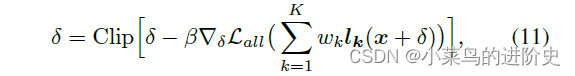

外部最小化使用ADAM优化器寻找最优的

δ

\delta

δ

其中

λ

,

β

,

α

,

γ

\lambda ,\beta ,\alpha ,\gamma

λ,β,α,γ均为超参数或优化参数。

实验

数据集:从ImageNet训练集中随机选择50k图像进行训练,并在ImageNet验证集(50k图像)上评估攻击性能

受害者模型:DenseNet121、 VGG16、 ResNet50、 VGG11、VGG13、VGG19-BN、ResNet18、 ResNet101、 WideResNet50-2 、DenseNet161和GoogleNet

防御模型:NRP(Naseer et al. 2020)、Augmix(Hendrycks et al. 2019), SIN (Geirhos et al. 2018) 和 adversarial training models(Salman et al. 2020).

实验模块包括:目标攻击+非目标攻击攻击能力验证+消融实验验证+防御逃逸性验证

4962

4962

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?