【2019arXiv】Advances and Open Problems in Federated Learning

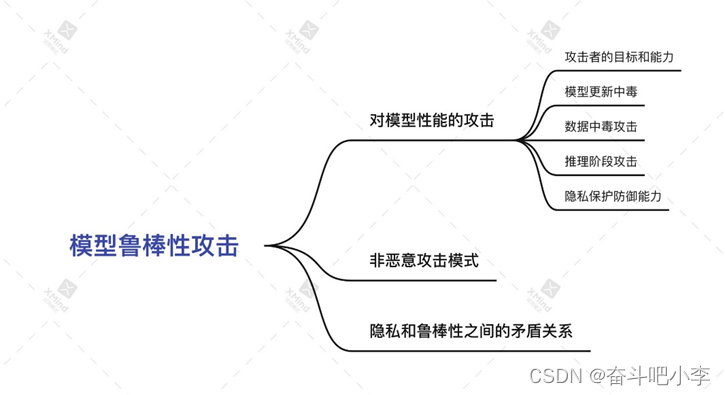

1.攻击者的目标和能力

目标:

1)非目标攻击:旨在降低模型的全局准确性,或“完全破坏”全局模型;

2)目标攻击(后门攻击):其目的是在少数示例上改变模型的行为,同时在所有其他示例上保持良好的总体准确性。例如,在图片中加入水印(后门),此水印指向一个特定的分类,使某类图片分类错误;语义后门,攻击者的模型更新迫使训练有素的模型在一小部分数据上学习错误的映射。例如,对手可能会迫使模型将所有绿色汽车分类为鸟类,从而在推理时导致错误分类。

能力:

| 特征 |

描述 |

|

| 攻击方式 |

数据中毒 |

攻击者改变用于训练模型的客户数据集 |

| 模型更新中毒 |

攻击者更改发送回服务器的模型更新 |

|

| 规避攻击 |

攻击者改变推断时使用的数据 |

|

| 是否观察到模型参数 |

白盒 |

对手有能力直接检查模型的参数 |

| 过时的白盒 |

对手可以访问参与中间训练回合的客户 |

|

| 黑盒 |

对手无法在攻击之前或攻击期间检查模型的参数。 |

|

| 参与者共谋 |

非共谋 |

参与者没有能力协调攻击 |

| 交叉更新共谋(时间共谋) |

过去的客户机参与者与未来的参与者合作对全局模型未来更新的攻击。 |

|

| 内部更新共谋 (空间共谋) |

当前客户端参与者合作对当前模型更新的攻击 |

|

| 参与率(对手可以发起攻击的频率) |

cross-device(设备) |

恶意客户端可能只能参加一轮模型培训 |

| cross-silo(组织) |

攻击者可能会持续参与学习过程 |

|

| 适应性(改变攻击参数) |

静态 |

攻击参数在训练过程中不可修改 |

| 动态 |

攻击参数在训练过程中可以修改 |

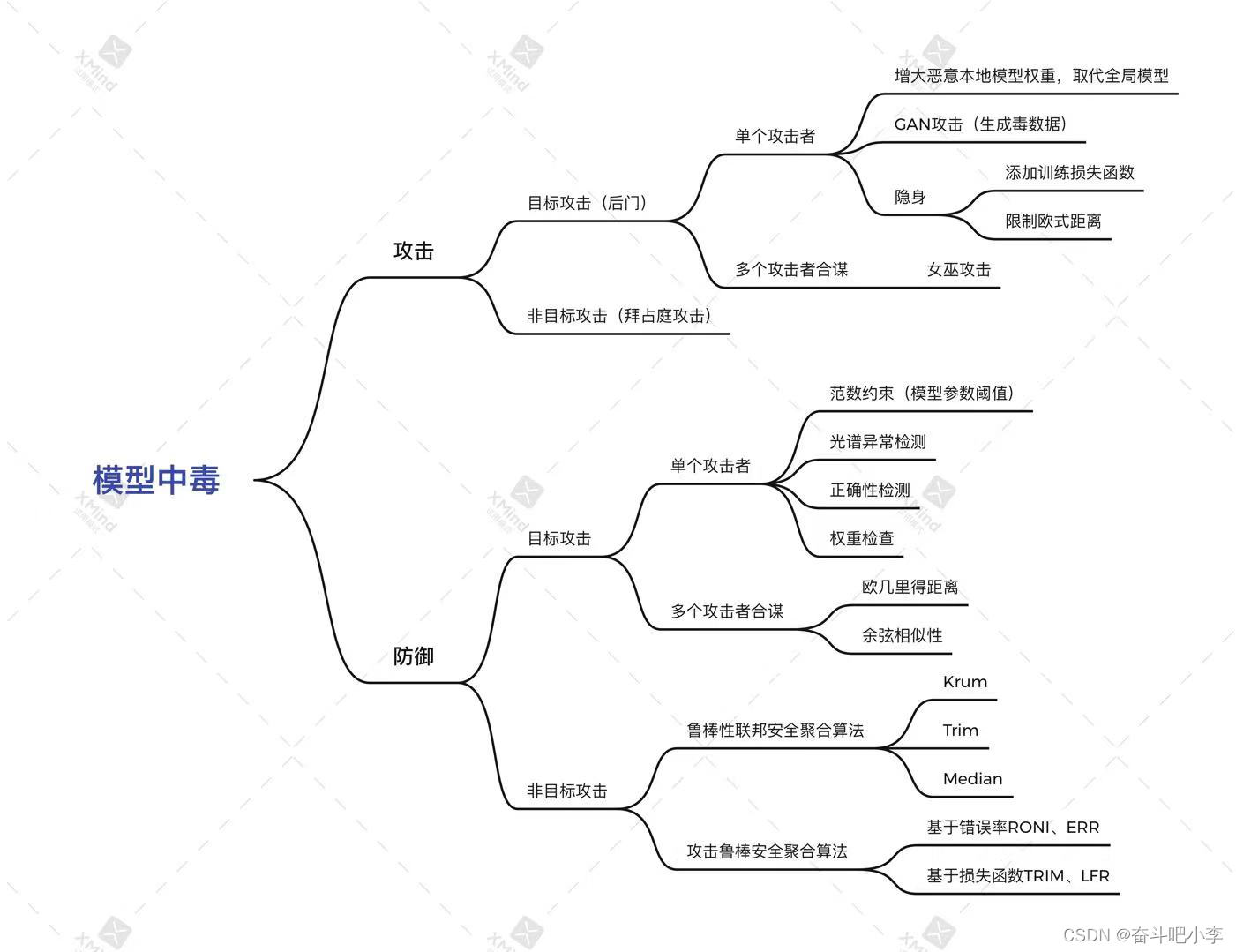

2.模型更新中毒

恶意客户端、中间人攻击

1)非目标模型更新攻

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

97

97

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?