为什么要进行大模型评测?

1、研究评测对于全面了解大语言模型的优势和限制至关重要,大语言模型真实理解还是死记硬背极大的反映出大语言模型的能力,需要评测才能知道。

2、模型评测有助于指导和改进人类与大语言模型的协同交互。有助于更好的设计人机交互的新范式。

3、研究评测有助于更好的规划大语言模型未来的发展,预防未知和潜在的风险。

4、研究评测有助于研究人员和用户更好的了解语言模型之间的性能、舒适性、安全性,更好的选择合适的模型。

OpenCompass

上海人工智能实验室科学家团队正式发布了大模型开源开放评测体系 “司南” (OpenCompass2.0),用于为大语言模型、多模态模型等提供一站式评测服务。其主要特点如下:

- 开源可复现:提供公平、公开、可复现的大模型评测方案

- 全面的能力维度:五大维度设计,提供 70+ 个数据集约 40 万题的的模型评测方案,全面评估模型能力

- 丰富的模型支持:已支持 20+ HuggingFace 及 API 模型

- 分布式高效评测:一行命令实现任务分割和分布式评测,数小时即可完成千亿模型全量评测

- 多样化评测范式:支持零样本、小样本及思维链评测,结合标准型或对话型提示词模板,轻松激发各种模型最大性能

- 灵活化拓展:想增加新模型或数据集?想要自定义更高级的任务分割策略,甚至接入新的集群管理系统?OpenCompass 的一切均可轻松扩展!

在 OpenCompass 中评估一个模型通常包括以下几个阶段:配置 -> 推理 -> 评估 -> 可视化。

- 配置:这是整个工作流的起点。您需要配置整个评估过程,选择要评估的模型和数据集。此外,还可以选择评估策略、计算后端等,并定义显示结果的方式。

- 推理与评估:在这个阶段,OpenCompass 将会开始对模型和数据集进行并行推理和评估。推理阶段主要是让模型从数据集产生输出,而评估阶段则是衡量这些输出与标准答案的匹配程度。这两个过程会被拆分为多个同时运行的“任务”以提高效率,但请注意,如果计算资源有限,这种策略可能会使评测变得更慢。如果需要了解该问题及解决方案,可以参考 FAQ: 效率。

- 可视化:评估完成后,OpenCompass 将结果整理成易读的表格,并将其保存为 CSV 和 TXT 文件。你也可以激活飞书状态上报功能,此后可以在飞书客户端中及时获得评测状态报告。 接下来,我们将展示 OpenCompass 的基础用法,展示书生浦语在 C-Eval 基准任务上的评估。它们的配置文件可以在 configs/eval_demo.py 中找到。

实验

配置环境

studio-conda -o internlm-base -t opencompass

source activate opencompass

git clone -b 0.2.4 https://github.com/open-compass/opencompass

cd opencompass

pip install -e .

# 如果pip install -e .安装未成功,请运行:

pip install -r requirements.txt

数据准备

cp /share/temp/datasets/OpenCompassData-core-20231110.zip /root/opencompass/

unzip OpenCompassData-core-20231110.zip

查看支持的数据集和模型

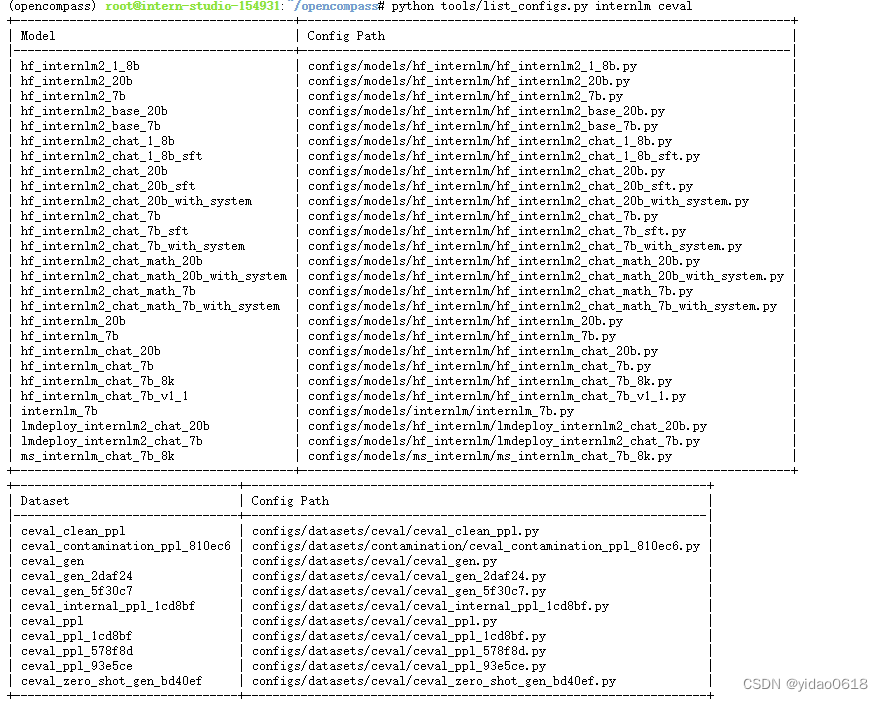

python tools/list_configs.py internlm ceval

开始测评

pip install protobuf

export MKL_SERVICE_FORCE_INTEL=1

#或

# export MKL_THREADING_LAYER=GNU

python run.py

--datasets ceval_gen \

--hf-path /share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \

--tokenizer-path /share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \

--tokenizer-kwargs padding_side='left' truncation='left' trust_remote_code=True \

--model-kwargs device_map='auto' trust_remote_code=True \

--max-seq-len 1024 \

--max-out-len 16 \

--batch-size 2 \

--num-gpus 1

--debug

--hf-path: HuggingFace 模型路径

--tokenizer-path: HuggingFacetokenizer 路径(如果与模型路径相同,可以省略)

--tokenizer-kwargs padding_side: 构建 tokenizer 的参数

--model-kwargs device_map: 构建模型的参数

--max-seq-len:模型可以接受的最大序列长度

--max-out-len: 生成的最大 token 数

--batch-size: 批量大小

--num-gpus: 运行模型所需的 GPU 数量

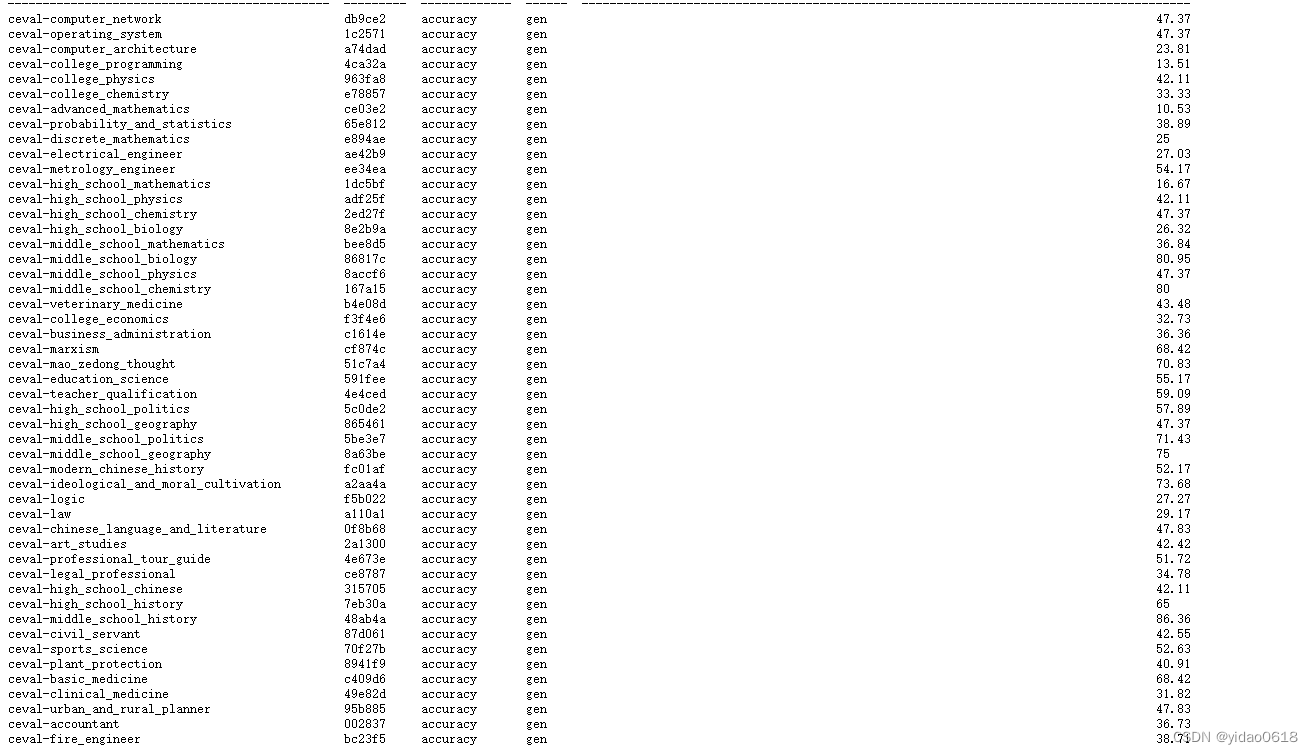

测评结果

673

673

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?