机器学习和深度学习

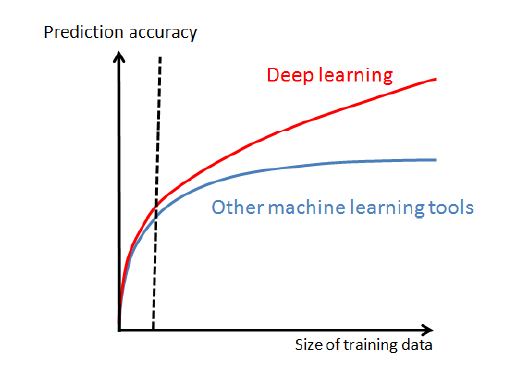

深度学习是机器学习下的一个算法,相比于其他方法,它的正确率更高。

其他的方法有:贝叶斯等

深度学习是机器学习研究中的一个新的领域, 深度学习是无监督学习的一种。

监督学习,就是人们常说的分类,通过已有的训练样本(即已知数据以及其对应的输出)去训练得到一个最优模型(这个模型属于某个函数的集合,最优则表示在某个评价准则下是最佳的),再利用这个模型将所有的输入映射为相应的输出,对输出进行简单的判断从而实现分类的目的,也就具有了对未知数据进行分类的能力。在人对事物的认识中,我们从孩子开始就被大人们教授这是鸟啊、那是猪啊、那是房子啊,等等。我们所见到的景物就是输入数据,而大人们对这些景物的判断结果(是房子还是鸟啊)就是相应的输出。当我们见识多了以后,脑子里就慢慢地得到了一些泛化的模型,这就是训练得到的那个(或者那些)函数,从而不需要大人在旁边指点的时候,我们也能分辨的出来哪些是房子,哪些是鸟。监督学习里典型的例子就是KNN、SVM。

无监督学习(也有人叫非监督学习,反正都差不多)则是另一种研究的比较多的学习方法,它与监督学习的不同之处,在于我们事先没有任何训练样本,而需要直接对数据进行建模。这听起来似乎有点不可思议,但是在我们自身认识世界的过程中很多处都用到了无监督学习。比如我们去参观一个画展,我们完全对艺术一无所知,但是欣赏完多幅作品之后,我们也能把它们分成不同的派别(比如哪些更朦胧一点,哪些更写实一些,即使我们不知道什么叫做朦胧派,什么叫做写实派,但是至少我们能把他们分为两个类)。无监督学习里典型的例子就是聚类了。聚类的目的在于把相似的东西聚在一起,而我们并不关心这一类是什么。因此,一个聚类算法通常只需要知道如何计算相似度就可以开始工作了。

深度学习的发展历史

- 上世纪40年代 神经网络模型被提出,试图通过模拟大脑认知的机理,解决各种机器学习的问题。

- 1986年 Rumelhart,Hinton 和 Williams 在《自然》发表了著名的反向传播算法,用于训练神经网络

- 2000年前后 由于计算资源有限、训练集规模小,人们更倾向于浅层学习机(如SVM、Boosting、最邻近等分类器)

- 2006年 Geoffrey Hinton 提出了深度学习

- 2012年 Hinton 的研究小组采用深度学习(卷积神经网络模型)赢得了 ImageNet 图像分类的比赛,把top5错误率降到15.315%,并且结果由于第二名10%以上,因此引起了较大轰动并掀起了深度学习的热潮,这个网络的结构被称作 AlexNet

- 2013-2014年 百度、谷歌、facebook陆续成立深度学习实验室

- 2014年 ILSVRC比赛中GooLeNet将top5错误率降到6.656%,它的最大特点就是深度超过20层

-

深度学习的基本思想

假设我们有一个系统S,它有n层(S1,…Sn),它的输入是I,输出是O,形象地表示为: I =>S1=>S2=>…..=>Sn => O

我们需要自动地学习特征,假设我们有一堆输入I(如一堆图像或者文本),假设我们设计了一个系统S(有n层),我们通过调整系统中参数,使得它的输出仍然是输入I,那么我们就可以自动地获取得到输入I的一系列层次特征,即S1,…, Sn。

深度学习的特点

- 深度学习与传统模式识别方法的最大不同在于它是从大数据中自动学习特征。而非采用手工设计的特征。传统的模式识别系统依赖先验知识,需要手工调整参数,因此参数不易过多。然而深度学习模型可以包含千万级别的参数。

深层结构的优势:

如果模型的深度不够,其所需的计算单元就会呈指数增加。这也就是浅层模型、三层神经网络的问题所在。深度模型能够减少参数的关键在于重复利用中间层的计算单元。eg:在最高的隐含层,每个神经元代表了一个属性分类器,例如男女、人种和头发颜色等等。每个神经元将图像空间一分为二,N 个神经元的组合就可以表达2^N个局部区域,而用浅层模型表达这些区域的划分至少需要个2^N 模板。

列表内容提取全局特征和上下文信息的能力

待补充- 联合深度学习

待补充

机器学习与神经网络

???

卷积神经网络

与Deep Learning的关系: DL是全部深度学习算法的总称,CNN是深度学习算法在图像处理领域的一个应用。

在学习Deep learning和CNN之前,总以为它们是很了不得的知识,总以为它们能解决很多问题,学习了之后,才知道它们不过与其他机器学习算法如svm等相似,仍然可以把它当做一个分类器,仍然可以像使用一个黑盒子那样使用它。

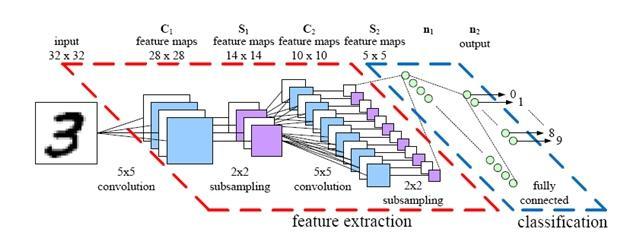

卷积神经网络(Convolutional Neural Networks)已成为当前语音分析和图像识别领域的研究热点。它的权值共享网络结构使之更类似于生物神经网络,降低了网络模型的复杂度,减少了权值的数量。该优点在网络的输入是多维图像时表现的更为明显,使图像可以直接作为网络的输入,避免了传统识别算法中复杂的特征提取和数据重建过程。卷积网络是为识别二维形状而特殊设计的一个多层感知器,这种网络结构对平移、比例缩放、倾斜或者共他形式的变形具有高度不变性。

典型的卷积神经网络

深度学习在图像处理中的应用

在于图像和视频相关的应用中,最成功的是深度卷积网络,它正是利用了与图像的特殊结构。其中最重要的两个操作,卷积和池化(pooling)都来自于与图像相关的领域知识。

- ImageNet图像分类

- 人脸识别(文中多次提到,将CNN最高的隐含层作为特征?)

- 物体检测

- 视频分析 难点是如何描述动态特征,如何将这些信息体现在深度模型中。最直接的做法是,将视频视为三维图像直接应用卷积网络。另一种更好的思路是通过预处理计算光流场,作为卷及神经网络的一个输入通道。

卷积神经网络图像处理研究现状

需补充知识

- 梯度下降法 参考资料:斯坦福公开课

- -

本文介绍了深度学习在机器学习中的地位,强调了其相对于传统方法的高正确率。回顾了深度学习的发展历程,包括神经网络的历史和深度学习的兴起。深度学习的基本思想是通过多层结构自动学习特征,其特点是能从大数据中自动学习,减少手工设计的特征。卷积神经网络(CNN)是深度学习在图像处理中的重要应用,具备权值共享和对图像变形的不变性。讨论了CNN在图像分类、人脸识别、物体检测和视频分析等领域的应用。

本文介绍了深度学习在机器学习中的地位,强调了其相对于传统方法的高正确率。回顾了深度学习的发展历程,包括神经网络的历史和深度学习的兴起。深度学习的基本思想是通过多层结构自动学习特征,其特点是能从大数据中自动学习,减少手工设计的特征。卷积神经网络(CNN)是深度学习在图像处理中的重要应用,具备权值共享和对图像变形的不变性。讨论了CNN在图像分类、人脸识别、物体检测和视频分析等领域的应用。

2765

2765

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?