我们在刚使用tensorflow的过程中,会遇到这个问题,通常我们有多个gpu,但是

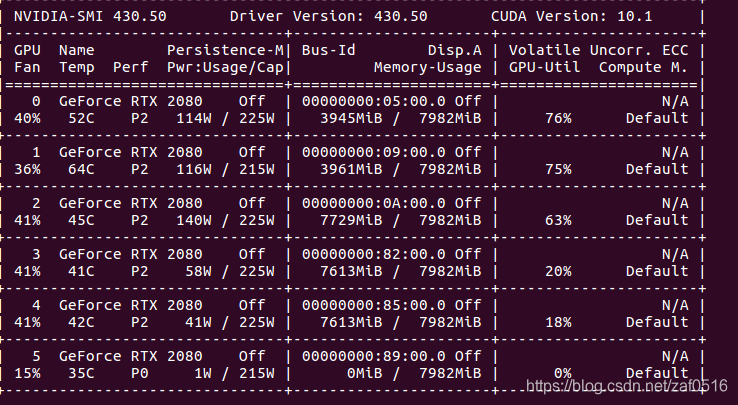

在通过nvidia-smi查看的时候,一般多个gpu的资源都被占满,但是只有一个gpu的GPU-Util

和 219W / 250W(Usage/Cap)会被占满。实际上我们只有一个在跑,但是我们其实只需要

一个卡,其他卡要跑其他的资源,这时候怎么办呢。

import os

os.environ["CUDA_DEVICE_ORDER"] = "PCI_BUS_ID"

os.environ["CUDA_VISIBLE_DEVICES"] = "0,2,3" ##这样就指定了第1,3,4,张卡可见了

参考网址:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?