基于Tensorflow2.0的MNIST手写体数字生成

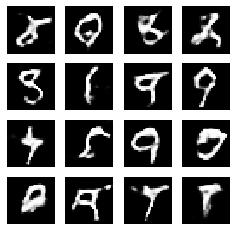

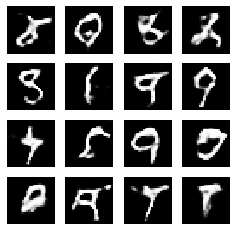

一、生成预览

二、DCGAN简介

DCGAN,全称为Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks(http://arxiv.org/pdf/1511.06434),主要创新为将100维均匀分布的Z映射到小空间范围的卷积表示法中得到多个特征向量。通过一系列小数步长卷积four fractionally-strided (在最近的一些论文中,这些被错误地称为反卷积),将这个高维表示转换成一个64 x 64像素的图像。没有使用全连接层和池化层。

除输出层使用Tanh函数外,生成器还使用ReLU激活函数(Nair & Hinton, 2010)。我们观察到,使用有界激活使模型能够更快地学习,以饱和和覆盖训练分布的颜色空间。在鉴别器中,我们发现漏整流激活(Maas et al., 2013) (Xu et al., 2015)工作良好,特别是对于高分辨率建模。这与最初使用maxout激活的GAN论文形成了对比(Goodfellow et al. 2013)。

稳定的深卷积GANs架构指南

1.用strided convolutions (discriminator)和fractional-strided convolutions (generator)替换池化层。

2.在生成器和鉴别器中使用batchnorm。

3.为更深层的架构移除完全连接的隐藏层。

4.G除输出层使用Tanh外,其他层均使用ReLU激活。

5.在鉴别器中对所有层使用LeakyReLU激活

三、代码

- 构建生成器G

# tf2 生成手写体数字

import tensorflow as tf

from tensorflow.keras import layers

def make_generator_model():

model = tf.keras.Sequential()

model.add(layers.Dense(7*7*256, use_bias=False, input_shape=(100,)))

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Reshape((7, 7, 256)))

assert model.output_shape == (None, 7, 7, 256) # Note: None is the batch size

model.add(layers.Conv2DTranspose(128, (5, 5), strides=(1, 1), padding='same', use_bias=False))

assert model.output_shape == (None, 7, 7, 128)

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Conv2DTranspose(64, (5, 5), strides=(2, 2), padding='same', use_bias=False))

assert model.output_shape == (None, 14, 14, 64)

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Conv2DTranspose(1, (5, 5), strides=(2, 2), padding='same', use_bias=False, activation='tanh'))

assert model.output_shape == (None, 28, 28, 1)

return model

import matplotlib.pyplot as plt

generator = make_generator_model()

noise = tf.random.normal([1, 100])

generated_image = generator(noise, training=False)

plt.imshow(generated_image[0, :, :, 0], cmap='gray')

- 构建判别器

def make_discriminator_model():

model = tf.keras.Sequential()

model.add(layers.Conv2D(64, (5, 5), strides=(2, 2), padding='same',

input_shape=[28, 28, 1]))

model.add(layers.LeakyReLU())

model.add(layers.Dropout(0.3))

model.add(layers.Conv2D(128, (5, 5), strides=(2, 2), padding='same'))

model.add(layers.LeakyReLU())

model.add(layers.Dropout(0.3))

model.add(layers.Flatten())

model.add(layers.Dense(1))

return model

discriminator = make_discriminator_model()

decision = discriminator(generated_image)

print(decision)tf.Tensor([[0.00181567]], shape=(1, 1), dtype=float32)- 构建损失函数

# 该方法返回计算交叉熵损失的辅助函数

cross_entropy = tf.keras.losses.BinaryCrossentropy(from_logits=True)

# 该方法量化判别器从判断真伪图片的能力。它将判别器对真实图片的预测值与值全为 1 的数组进行对比,将判别器对伪造(生成的)图片的预测值与值全为 0 的数组进行对比。

def discriminator_loss(real_output, fake_output):

real_loss = cross_entropy(tf.ones_like(real_output), real_output)

fake_loss = cross_entropy(tf.zeros_like(fake_output), fake_output)

total_loss = real_loss + fake_loss

return total_loss

# 生成器损失量化其欺骗判别器的能力。直观来讲,如果生成器表现良好,判别器将会把伪造图片判断为真实图片(或 1)。

def generator_loss(fake_output):

return cross_entropy(tf.ones_like(fake_output), fake_output)

# 需要分别训练两个网络,判别器和生成器的优化器是不同的。

generator_optimizer = tf.keras.optimizers.Adam(1e-4)

discriminator_optimizer = tf.keras.optimizers.Adam(1e-4)

# 注意 `tf.function` 的使用,该注解使函数被“编译”

noise_dim = 100

@tf.function

def train_step(images):

noise = tf.random.normal([BATCH_SIZE, noise_dim])

with tf.GradientTape() as gen_tape, tf.GradientTape() as disc_tape:

generated_images = generator(noise, training=True)

real_output = discriminator(images, training=True)

fake_output = discriminator(generated_images, training=True)

gen_loss = generator_loss(fake_output)

disc_loss = discriminator_loss(real_output, fake_output)

gradients_of_generator = gen_tape.gradient(gen_loss, generator.trainable_variables)

gradients_of_discriminator = disc_tape.gradient(disc_loss, discriminator.trainable_variables)

generator_optimizer.apply_gradients(zip(gradients_of_generator, generator.trainable_variables))

discriminator_optimizer.apply_gradients(zip(gradients_of_discriminator, discriminator.trainable_variables))

return gen_loss, disc_loss- 准备MNIST数据

# 准备数据

(train_images, train_labels), (_, _) = tf.keras.datasets.mnist.load_data()

train_images = train_images.reshape(train_images.shape[0], 28, 28, 1).astype('float32')

train_images = (train_images - 127.5) / 127.5 # Normalize the images to [-1, 1]

BUFFER_SIZE = 60000

BATCH_SIZE = 256

# Batch and shuffle the data

train_dataset = tf.data.Dataset.from_tensor_slices(train_images).shuffle(BUFFER_SIZE).batch(BATCH_SIZE)

def generate_and_save_images(model, epoch, test_input):

# 注意 training` 设定为 False

# 因此,所有层都在推理模式下运行(batchnorm)

predictions = model(test_input, training=False)

fig = plt.figure(figsize=(4,4))

for i in range(predictions.shape[0]):

plt.subplot(4, 4, i+1)

plt.imshow(predictions[i, :, :, 0] * 127.5 + 127.5, cmap='gray')

plt.axis('off')

plt.savefig('./output/image_at_epoch_{:04d}.png'.format(epoch))

plt.show()- Training

noise_dim = 100

num_examples_to_generate = 16

# 我们将重复使用该种子(因此在动画 GIF 中更容易可视化进度)

seed = tf.random.normal([num_examples_to_generate, noise_dim])

def train(dataset, epochs):

#for epoch in range(epochs):

#start = time.time()

for epoch in range(epochs):

for i,image_batch in enumerate(dataset):

g,d = train_step(image_batch)

print("batch %d, gen_loss %f,disc_loss %f" % (i, g.numpy(),d.numpy()))

# 每 15 个 epoch 保存一次模型

if (epoch + 1) % 15 == 0:

checkpoint.save(file_prefix = checkpoint_prefix)

generate_and_save_images(generator,

epochs,

seed)

EPOCHS = 50

train(train_dataset, EPOCHS)- Test

# 保存模型

generator.save('./save/mnist_dcgan_tf2.h5')

import tensorflow as tf

import matplotlib.pyplot as plt

model = tf.keras.models.load_model('./save/mnist_dcgan_tf2.h5')

test_input = tf.random.normal([16, 100])

epoch = 10

generate_and_save_images(model, epoch, test_input)

四、注意事项

- GPU训练更佳:10min,CPU训练速度:约150min

- tensorflow2版本

- 跳过训练直接使用模型生成,模型下载地址:https://download.csdn.net/download/zhaoguanghe/12512998

了解更多,关注公众号:AI预见未来

3302

3302

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?