上一篇:04 自动调整学习率(Learning Rate)-学习笔记-李宏毅深度学习2021年度

下一篇:06 卷积神经网络CNN-学习笔记-李宏毅深度学习2021年度

本节内容及相关链接

处理分类问题的相关注意事项

课程笔记

可以将分类(Classification)任务看做回归(Regression)任务,只需将类别变成 0 , 1 , 2 , . . . 0,1,2,... 0,1,2,... 这样的数字即可。但通常并不这么做。除非有特殊情况,比如要预测这个学生是几年级的,这种的可以,因为 Class1 和 Class2 等有递进关系

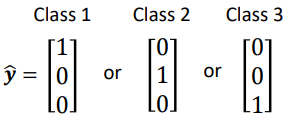

多分类任务通常使用 one-hot 编码,例如:

分类任务最后的输出要经过softmax函数进行归一化,最大的那个就是预测的类别

Softmax公式如下: y i ′ = exp ( y i ) ∑ j exp ( y i ) y_{i}^{\prime}=\frac{\exp \left(y_{i}\right)}{\sum_{j} \exp \left(y_{i}\right)} yi′=∑jexp(yi)exp(yi)

对于二分类问题,使用 softmax 和 sigmoid 是等价的(数学上可以证明出来)

对于多分类任务,通常采用 Cross-Entropy 作为损失函数

Cross-Entropy 的公式如下:

e

=

−

∑

i

y

^

i

ln

y

i

′

e=-\sum_{i} \widehat{y}_{i} \ln y_{i}^{\prime}

e=−i∑y

ilnyi′

L

=

1

N

∑

n

e

n

L=\frac{1}{N} \sum_{n} e_{n}

L=N1n∑en

- N N N 为Batch Size

- i i i 指第 i i i 个类别

最小化Cross-Entropy和最大化可能性(Likelihood)只是说法不一样,但实际是等价的

2703

2703

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?