A Discriminative Feature Learning Approach for Deep Face Recognition

Y. Wen, K. Zhang, Z. Li, & Y. Qiao, A Discriminative Feature Learning Approach for Deep Face Recognition, ECCV, 2016

摘要

(1)中心损失(center loss):学习各个类别的深度特征的中心,同时对类内深度特征空间的尺度加以惩罚(simultaneously learns a center for deep features of each class and penalizes the distances between the deep features and their corresponding class centers)

(2)中心损失可训练且易于优化

(3)归一化指数损失、中心损失联合监督(joint supervision of softmax loss and center loss),使得类间分布分散、类内分布紧密(inter-class dispersion and intra-class compactness)

1 引言

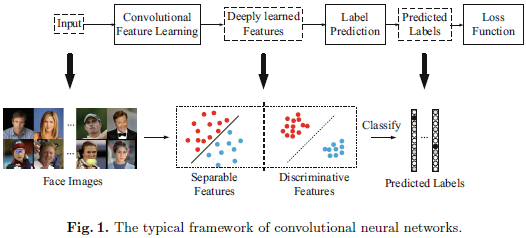

对于面部识别任务,提取的深度特征不仅可分(separable),还要可鉴别(discriminative)、泛化能力强(generalized enough)。

可鉴别意味着:减小类内变化并增大类间差异(compact intra-class variations and separable inter-class differences)

(1)中心损失函数能提高深度特征的判别能力。

(2)各类深度特征中心:在训练过程中,更新中心位置,使深层特征与相应类别中心的间距最小。

(3)归一化指数损失、中心损失联合监督,通过超参数平衡。

(4)归一化指数损失使不同类别的深层特性分离;中心损失使相同类别的深层特性靠近其类别中心。

2 相关工作

3 本文方法

3.1 简单示例

MNIST:2维深度特征

归一化指数(softmax)损失:

L S = − ∑ i = 1 m log e w y i T x i + b y i ∑ j = 1 n e w j T x i + b j \mathcal{L}_S = - \sum_{i = 1}^{m} \log \frac {e^{\mathbf{w}^{\mathrm{T}}_{y_i} \mathbf{x}_i + b_{y_i}}} {\sum_{j = 1}^{n} e^{\mathbf{w}^{\mathrm{T}}_{j} \mathbf{x}_i + b_{j}}} LS=−i=1∑mlog∑j=1newjTxi+bjewyiTxi+byi

其中, x i ∈ R d \mathbf{x}_i \in \mathbb{R}^d xi∈Rd表示样本 i i i的深度特征, y i y_i

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

449

449

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?