Feature Learning Based Deep Supervised Hashing with Pairwise Labels

现在实验室要求每周阅读一篇paper然后写成总结,作为一个博客的受益者,我也想写成博客的形式,将收获不局限于分享在小组内。但是,作为一个知识的传播者,如果传播错误的知识误导别人还不如不做。所以写每一篇博客都是忐忑不安,特别是国内一些厉害课题组的发表的paper,生怕误解作者的原意,还拿出来正儿八经的解读,贻笑大方。作为一个进阶的菜鸟,希望大家看到错误能够留言指正,我也要努力发表属于自己的paper。

Introduction

本篇是发表在IJCAI16上的一篇关于Deep Hash 的一篇Paper。下载地址

作者在本篇论文中提出了一种新的Deep Hash方法,DPSH(deep pairwise-supervised hashing),通过深度学习从pair-wise label中学习到图像的特征和hash code,并且在后面的实验中与其他方法比较,取得了较好的结果。

DPSH主要有以下几个方面:

- 通过CNN的conv层学习图像特征

- 使用网络的全连接层学习hash function

- 设计合理的loss function使pair-wise中label相似的话,hash code尽可能相似,也就是相似的label,hash code之间的海明距离比较小,不相似的label,hash code 之间海明距离比较大。

Notation And Problem Definition

在论文中, z 代表向量,

sgn(x){

1,−1,x>0x<0

假定有n个图片 χ={ xi}ni=1 , xi 代表了第i张图片。因为监督的hash方法,图片都是有标签的,可以通过标签之间是否相似构造出相似性矩阵 S={ sij},sij∈{ 0,1} 。当两个图片相似时, sij 为1。当两个图片不相似时, sij=0 。可以通过图片的label获取相似性矩阵。

hash function的目标是每一张图片学习到二进制码 bi∈{ −1,1}c ,c是二进制码的长度。并且生成的二进制码保持原有的相似性,即相似的图片的hash code之间的海明距离比较小,不相似的图片之间的hash code的海明距离比较大。整个网络的主要目标就是学习出c个hash function,保证上述的特性。

Model and Learning

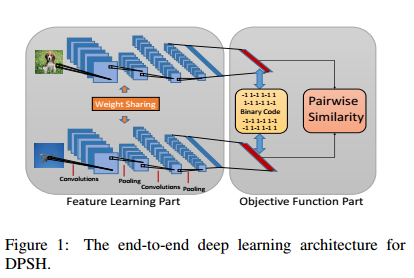

网络结构如Figure1 所示:

图 1

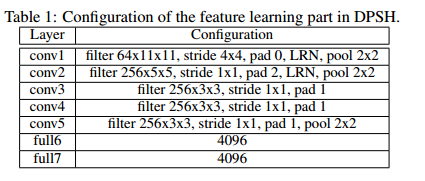

作者使用了CNN-F网络模型,上下两个CNN使用具有相同的网络结构,共享同样的权重。网络的具体参数如table 1所示:

Object Function

给定所有点的二进制码 B={

bi}ni=1 ,点对之间的似然函数可以定义如下:

psij|B={

σ(Ωij),1−σ(Ωij),sij=1sij=0

上述公式中

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3744

3744

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?