Towards Out-of-Distribution Sequential Event Prediction: A Causal Treatment

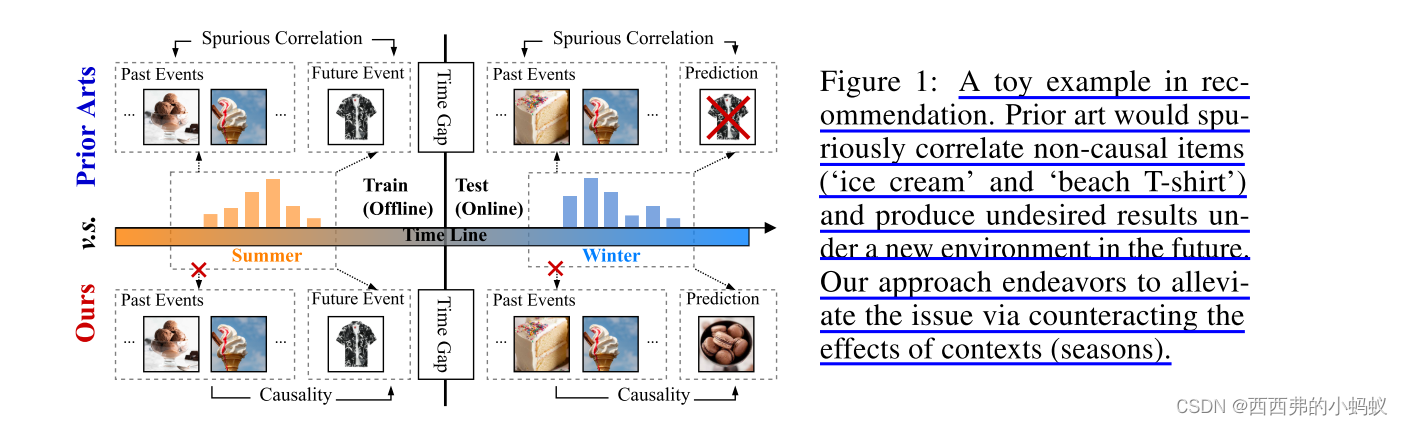

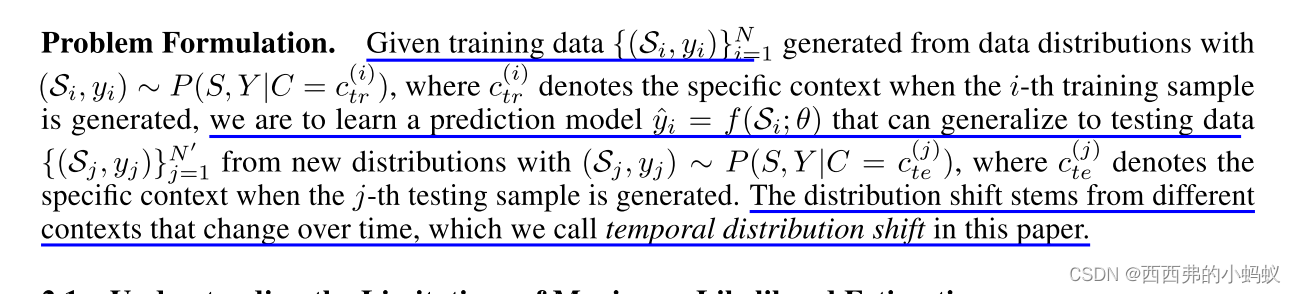

序列事件预测的目标是根据历史事件序列估计下一个事件,在序列推荐、用户行为分析和临床治疗等方面都有应用。在实践中,练下一个事件预测模型用一次收集的序列数据进行训,需要在遥远的未来泛化到新到达的序列,这就要求模型处理从训练到测试的时间分布转移。本文首先从数据生成的角度揭示了一个消极的结果,即由于潜在的上下文混淆因素,即历史事件和下一个事件的共同原因,现有的最大似然估计方法将失败于分布漂移。然后设计了一个新的基于后门调整的学习目标,并进一步利用变分推理使其可用于序列学习问题。本文提出一个具有层次分支结构的框架,用于学习特定于上下文的表示。在不同任务(如顺序推荐)上的全面实验,以各种现成的模型为骨干,证明了所提出方法的有效性、适用性和可扩展性。

处理顺序事件数据中的分布漂移带来了一些重大挑战。首先,时间偏移需要模型的分布外(OoD)泛化能力[30],。即从训练环境外推到遥远的未来新的未见环境专注于分布内数据的模型学习和评估的现有技术可能会在OoD测试实例上产生次优结果。第二,如前所述,影响事件产生的外部因素是存在的。这些外部因素,我们称之为上下文,在实践中是无法观察到的。为了消除它们的影响,可能还需要描述上下文如何影响事件生成的潜在分布。不幸的是,由于数据收集受限和隐私问题,这些信息通常是不可访问的,这需要模型从纯观察序列中学习

520

520

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?