多变量时间序列(MTS)预测在广泛的应用中起着至关重要的作用。近年来,时空图神经网络(STGNNs)成为越来越流行的MTS预测方法。STGNNs通过图神经网络和序列模型联合建模MTS的时空模式,显著提高了预测精度。但受限于模型复杂度,大多数STGNNs只考虑短期的历史MTS数据,如过去一小时的数据。然而,时间序列的模式以及它们之间的依赖关系(即时间和空间模式)需要基于长期的历史MTS数据进行分析。为解决这个问题,本文提出一种新的框架,其中STGNN通过可扩展的时间序列预训练模型(STEP)进行增强。设计了一个预训练模型,以有效地从非常长期的历史时间序列(例如,过去两周)中学习时间模式,并生成段级表示。这些表示为STGNNs的短期时间序列输入提供了上下文信息,并促进了时间序列之间的建模依赖关系。在三个公开的真实世界数据集上的实验表明,所提出框架能够显著增强下游stgnn,所提出的预训练模型恰当地捕捉了时间模式。

阅读者总结:这篇论文很有趣,没有太多在多维时间序列上的依赖关系建模,直接使用了预训练模型,然后在下游任务上实现预测。这篇论文应该是时间序列预测上首篇应用预训练模型来实现时间序列预测的论文。虽然在KDD2021年一篇论文中也略微使用了预训练模型,但是主要是为了transformer服务的,不算严格意义上的预训练模型的使用。难点在于这个模型训练的大小问题,值得考虑。

阅读者之前也考虑在时间序列上使用预训练模型的,但是没有找到合适的下游任务,这篇论文应该说是很好的切入点。

背景:1)多元时间序列通常可以形式化为时空图形数据

2)STGNNs结合了图神经网络(GNNs)、[18]和序列模型。前者用于处理时间序列之间的依赖关系,后者用于学习时间模式

问题:

1)The computational complexity usually increases linearly or quadratically with the length of the input time series

2)it is not easy for STGNNs to scale to very long-term historical time series.

挑战:

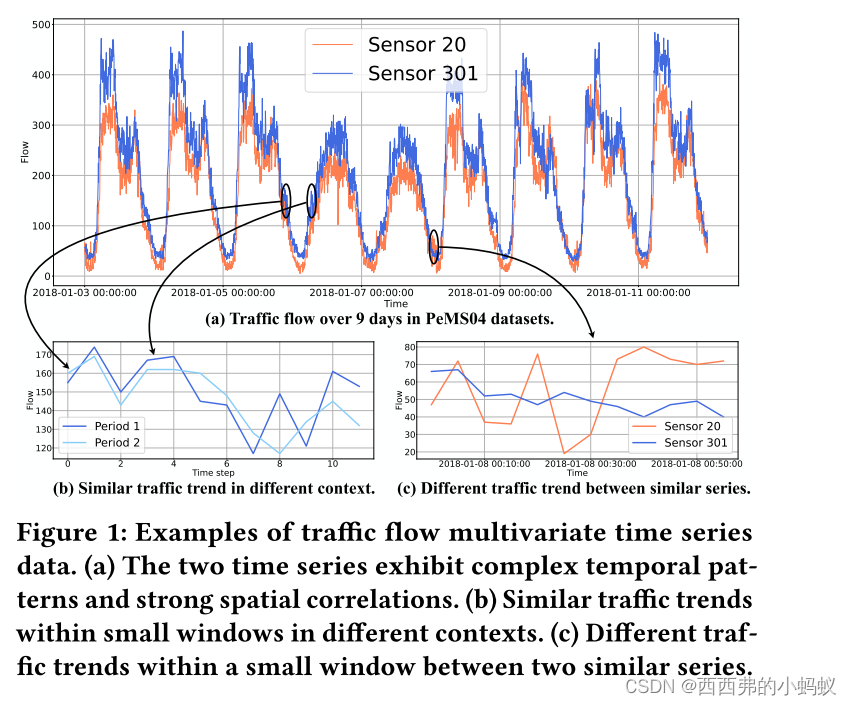

首先,STGNN模型对窗口外的上下文信息是盲目的。考虑到时间序列通常是有噪声的,模型可能很难区分不同背景下的短期时间序列

其次,短期信息对依赖图建模是不可靠的,依赖图由时间序列之间的相似性(或相关性)表示。长期的历史时间序列有利于抗噪声,有利于获得更强的鲁棒性和更准确的依赖关系

最后,stgnn直接扩展到非常长期的历史时间序列是非常昂贵的。此外,随着输入序列长度的增加,模型的优化也会出现问题

方法:

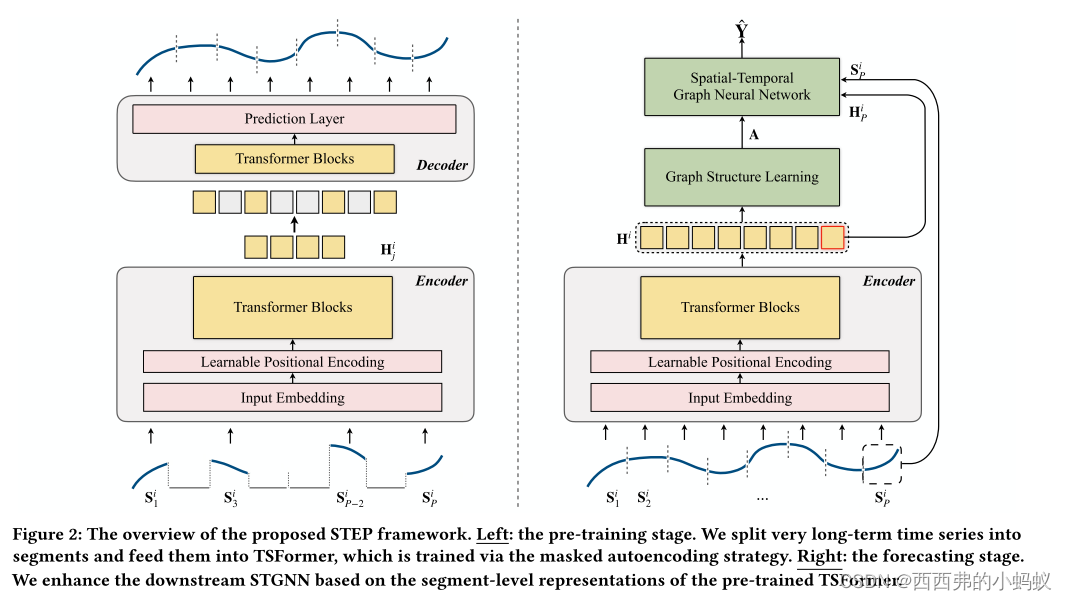

我们提出了一种新的框架,该框架通过可扩展的时间序列预训练模型(STEP)对STGNN进行增强。训练前模型旨在有效地学习非常长期的历史时间序列的时间模式,并生成分段级表示,其中包含丰富的上下文信息,这有利于解决第一个挑战。

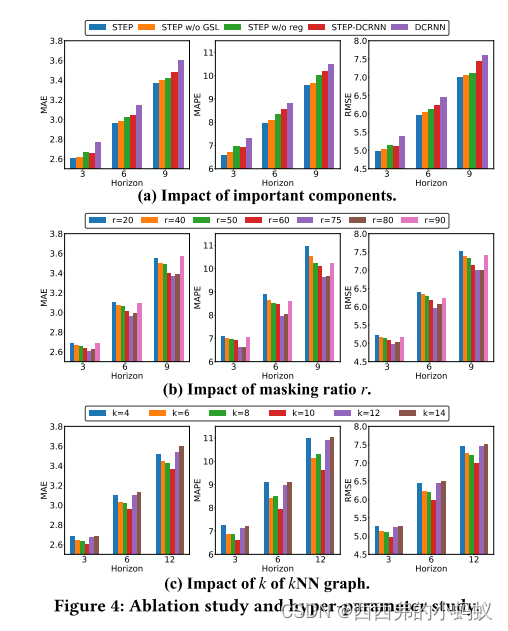

设计了一种基于TransFormer块的高效无监督时间序列预训练模型(TSFormer),通过掩码自编码策略[13]进行训练。TSFormer有效地捕获了数周非常长期的历史数据的信息,并产生正确反映时间序列中复杂模式的段级表示。其次,设计了一个基于TSFormer表示的图结构学习器,用于学习离散依赖图,并将基于TSFormer表示计算的𝑘NN图作为正则化项来指导图结构和STGNN的联合训练。值得注意的是,STEP是一个通用框架,可以扩展到几乎任意的stgnn。

框架:

3.1 The Pre-training Stage

TSFormer是高效的,这得益于高掩码率和更少的Transformer块。TSFormer能够从非常长期的序列(例如,周)中学习,并且可以在单个GPU上进行训练。编码器为输入块(段)生成表示。此外,与MAE[13]的另一个值得注意的区别是,我们更关注补丁的表示。一方面,我们可以使用这种表示来验证数据中的周期性模式,这将在4.3节中演示。更重要的是,它们可以方便地作为下游STGNNs的短期输入的上下文信息,这将在下文中介绍。

3.2 The Forecasting Stage

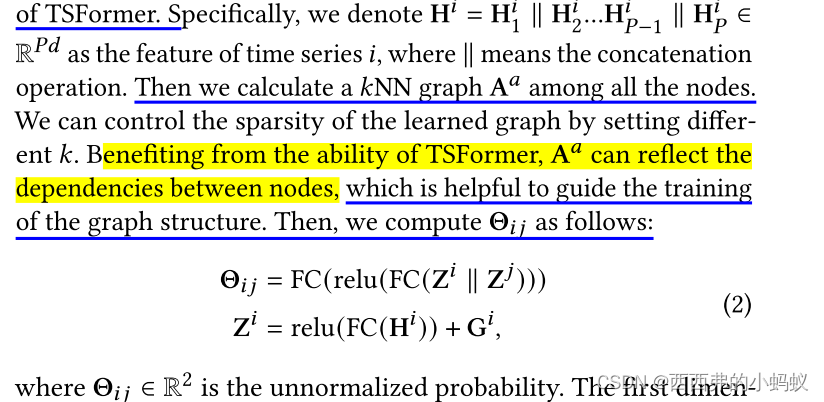

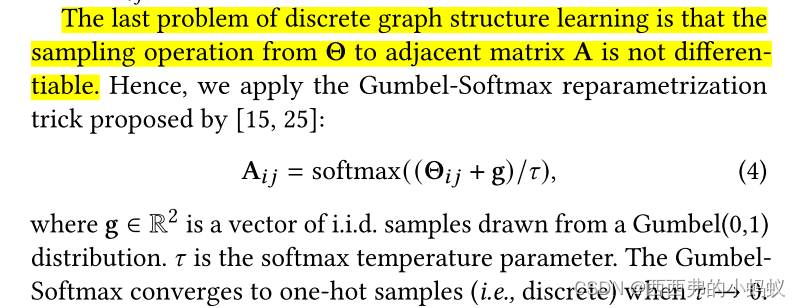

1)Graph structure learning.

首先,引入图正则化,以基于TSFormer的表示为图优化提供监督信息。

Downstream spatial-temporal graph neural network.

4 EXPERIMENTS

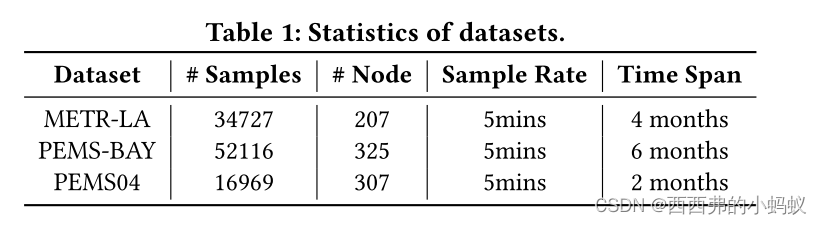

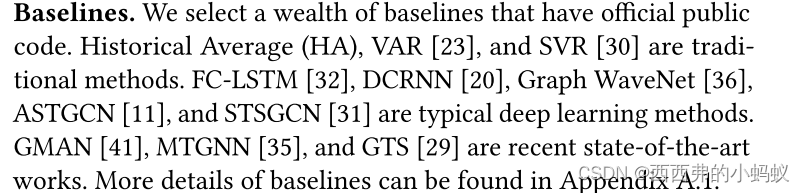

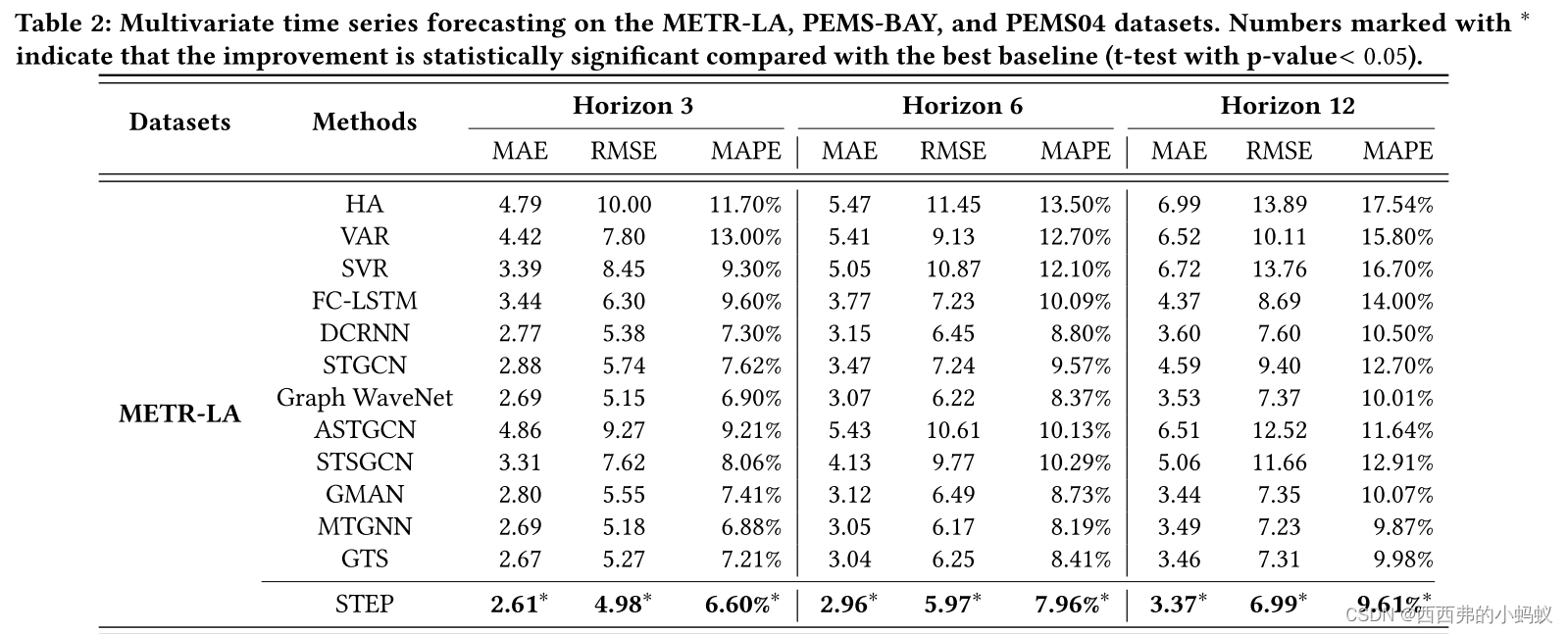

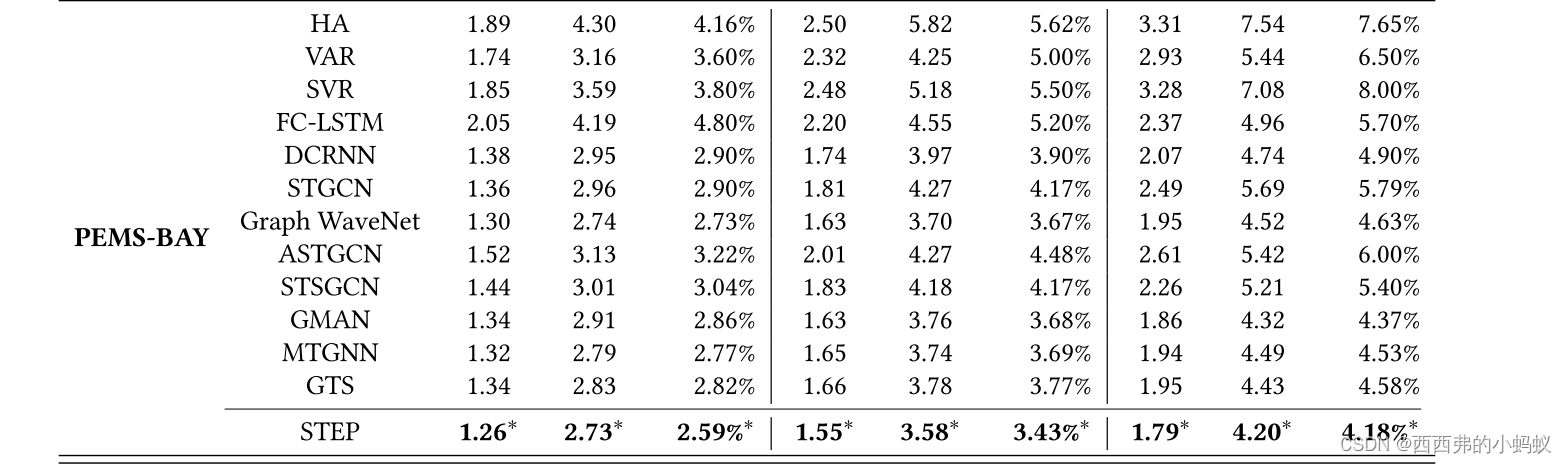

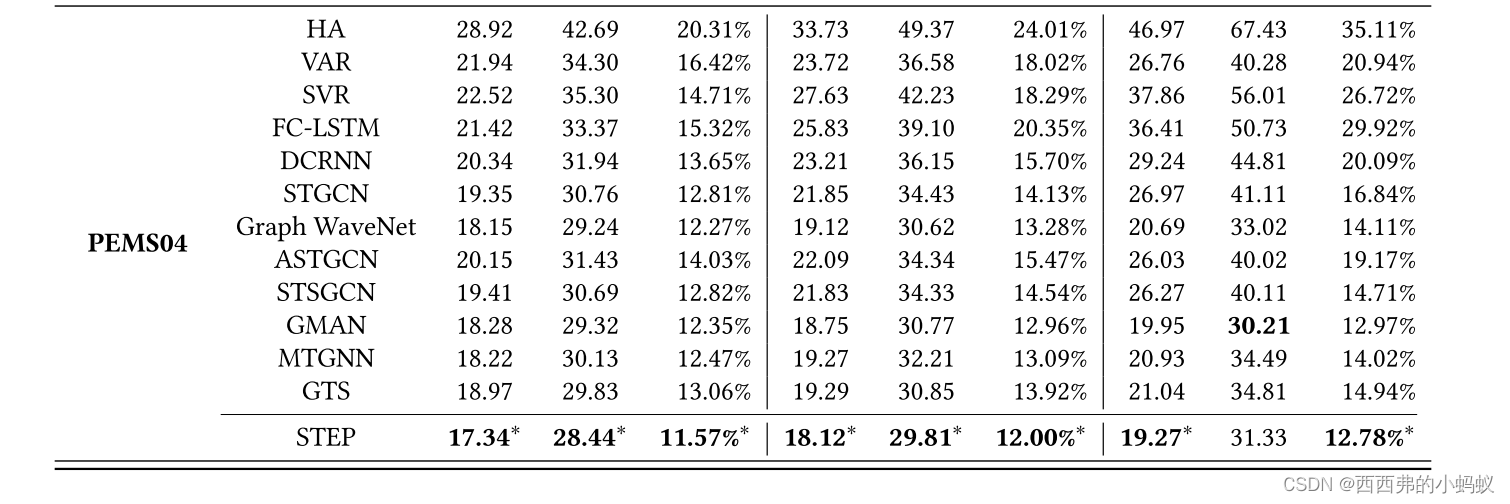

在本节中,我们在三个真实的数据集上进行实验,以证明所提出的步骤和TSFormer的有效性。此外,进行了全面的实验来评估重要超参数和成分的影响。

结论

本文提出一种新的多变量时间序列预测STEP框架,以解决STGNNs无法学习长期信息的问题。下游的STGNN由可扩展的时间序列预训练模型TSFormer增强。TSFormer能够有效地从非常长期的历史时间序列中学习时间模式并生成段级表示,这为STGNNs的短期输入提供了丰富的上下文信息,并促进了时间序列之间的建模依赖。在三个真实数据集上的广泛实验表明了STEP框架和TSFormer的优越性。

7311

7311

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?