最近学习了coursera上斯坦福大学的机器学习课程。其中支持向量机的内容和其他地方的理解不太一样,现将两种理解方法记录如下。

第一种:coursera

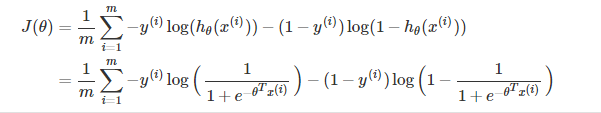

这一种理解是从逻辑回归推理得来。逻辑回归的损失函数为:

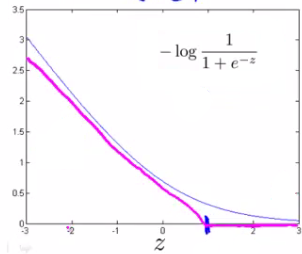

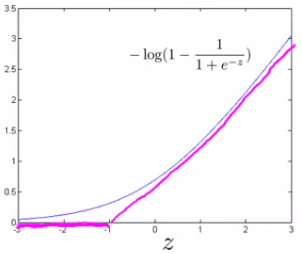

其中h(z)=1/(1+exp(-z)).接下来-log(h(x))和-log(1-h(x))的图像如图所示

其中手绘的函数为原函数的近似。手绘函数为:小于1则随x减小而线性增大,大于1则取值为0。此为hinge cost function

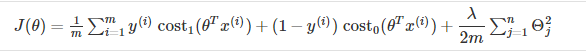

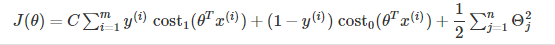

逻辑回归的目标函数为

将其中的cost替换为hinge cost function。并且对lambda用C替换,C=1/lambda,公式变为:

如果我们认为C无限大,即前一项变为限制条件,限制条件为|WT*X+b|>=1;仅对后一项求最小值:

目标函数变为:

min( ||W||^2 ) s.t.|WT*X+b|>=1

第二种:

从函数距离到几何距离,然后推理得来

3848

3848

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?