时间序列的自适应学习和预测(AdaRNN)

关注人工智能学术前沿 回复 :ts29

5秒免费获取论文pdf文档,及项目源码

摘要

虽然时间序列预测在现实世界中有着广泛的应用,但它是一项非常具有挑战性的任务。这是因为时间序列的统计特性可以随时间而变化,导致分布随时间而变化,这在机器学习界被称为分布移位问题。到目前为止,从分布-转移的角度对时间序列进行建模仍然没有探索。在本文中,我们建立了时间序列预测的时间协变量移位问题。我们提出了自适应rnn (AdaRNN)来解决TCS问题。AdaRNN依次由两个模块组成。第一个模块称为Temporal Distribution Characterization,旨在更好地表征时间序列中的分布信息。第二个模块是时间分布匹配,旨在减少时间序列中的分布失配,学习一种基于rnn的自适应时间序列预测模型。AdaRNN是一个集成了灵活分布距离的通用框架。人类活动识别、空气质量预测、家庭电力消耗和财务分析的实验表明,AdaRNN在分类任务上的准确率比一些最先进的方法高出2.6%,在回归任务上的均方误差高出9.0%。我们还展示了时间分布匹配模块可以扩展到Transformer体系结构,以进一步提高其性能。

1.介绍

时间序列(TS)数据在金融分析[55]、医学分析[29]、天气状况预测[46]、可再生能源生产[5]等无数领域中自然出现。预测是分析时间序列数据最受欢迎的任务之一(可以说也是最困难的任务),因为它在工业、社会和科学应用中的重要性。例如,给定一个城市过去5天的历史空气质量数据,如何更准确地预测未来的空气质量?

在实际应用中,TS的统计特性自然会随时间而变化,即非平稳TS。动态贝叶斯网络[35]、卡尔曼滤波器[9]和其他统计模型(如ARIMA[19])都取得了很大的进展。最近,递归神经网络(RNN)取得了更好的性能[37,46]。RNN对时间结构没有假设,在TS中可以发现高度非线性和复杂的依赖关系。

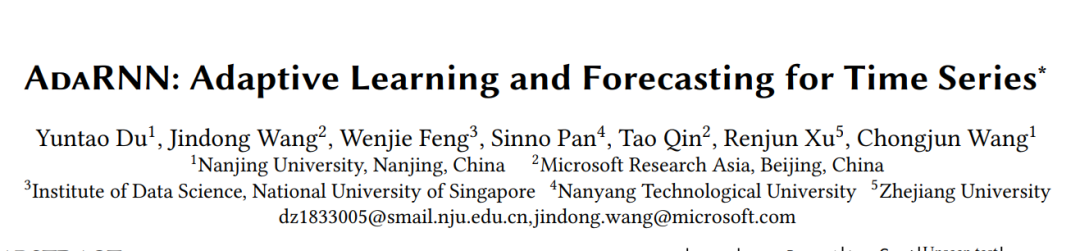

时间序列的非平稳性意味着数据分布随时间而变化。根据图1的例子,数据分布P (x)在不同的区间A, B, C变化,其中x, y分别是样本和预测;特别是在训练过程中看不到的测试数据,其分布也与训练数据不同,使得预测更加恶化。然而,对于这个场景,条件分布P (y | x)通常被认为是不变的,这在许多实际应用程序中是合理的。例如,在股票预测中,市场波动会改变金融因素(P (x)),而经济规律保持不变(P (y | x)),这是很自然的。由于分布移位问题违背了上述方法的基本I.I.D假设,必然导致上述方法性能较差,泛化[22]较差

综上所述,我们的主要贡献如下:

1.新颖的问题:我们首次提出从分布的角度对时间序列进行建模,然后假设并形成了非平稳时间序列的时间协变量移位(TCS)问题,这更具有现实性和挑战性。

2.总体框架:为了解决TCS问题,我们提出了一个总体框架AdaRNN,该框架通过提出时间分布表征和时间分布匹配算法来学习准确的、自适应的模型。

3.有效性:我们对人类活动识别、空气质量预测、家庭用电和股票价格预测数据集进行了广泛的实验。结果表明,AdaRNN在分类和回归任务上都优于最先进的基线。

2.模型概述

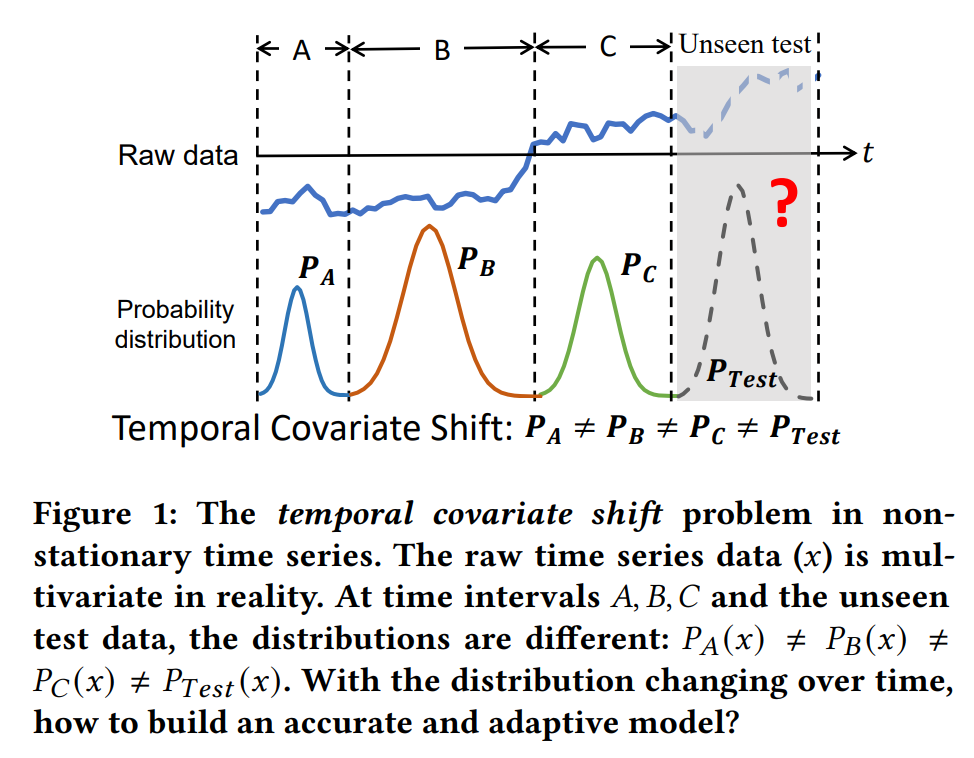

在本节中,我们提出了我们的框架,称为自适应RNN(AdaRNN),以解决时间协变量移位问题。图2(a)描述了AdaRNN的概述。我们可以看到,它主要由两种新的算法组成:

1.时间分布表征(TDC):表征TS中的分布信息;

2.时间分布匹配(TDM):对发现的周期分布进行匹配,建立时间序列预测模型M。

具体公式推导 与 算法介绍 pdf文档内详。

关注人工智能学术前沿 回复 :ts29

5秒免费获取论文pdf文档,及项目源码

3.实验概述

基线模型

1.传统TS建模方法包括ARIMA[53]、FBProphet[10]、LightGBM、GRU [7];

2.最新TS模型,包括LSTNet[23]和STRIPE [24]4;

3.Transformer[45]通过去掉其掩码操作;

4.流行的领域自适应/泛化方法的变体,我们将它们表示为MMD-RNN和DANN-RNN

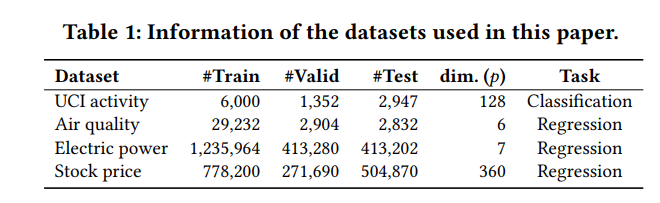

数据集

实验结果

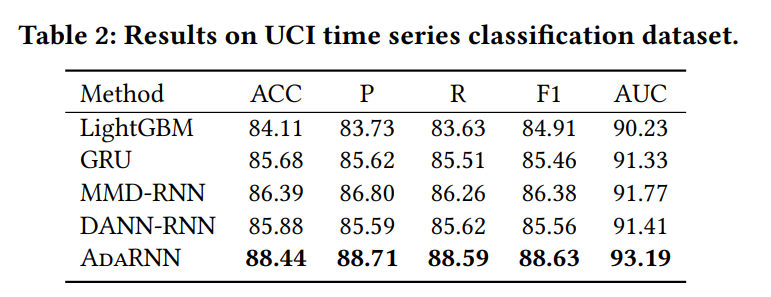

表2显示了这个分类任务的结果。可以看出,AdaRNN在所有评价指标上的表现都是最好的,其准确率比基于对抗性的DANN方法高出2.56%,F1得分比基于对抗性的DANN方法高出3.07%。这意味着AdaRNN在非平稳时间序列分类任务中是有效的。

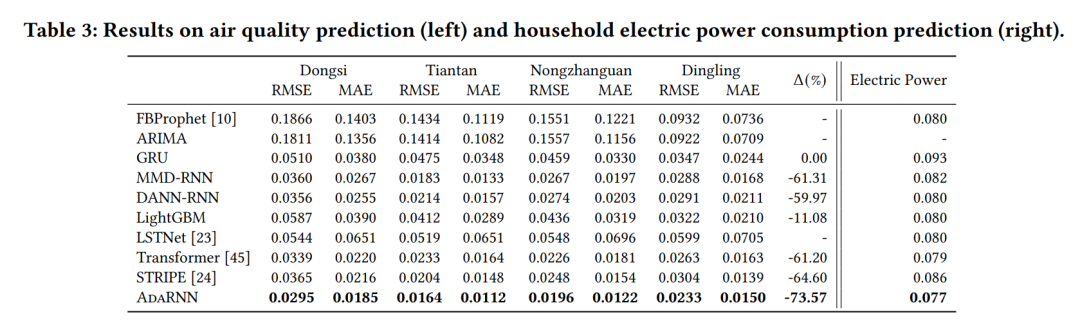

表3:空气质量预测结果(左)和家庭用电预测结果(右)。

表3的右半部分给出了不同方法预测住户用电量的RMSE。我们的AdaRNN再次取得了最好的表现。

结论

本文提出研究非平稳时间序列的时间协变量移位(TCS)问题。我们提出AdaRNN框架来学习自适应RNN模型,以更好地泛化。AdaRNN算法由两种新的算法组成:时域分布表征算法和时域分布匹配算法,前者用于表征TS中的分布信息,后者通过分布匹配构建广义RNN模型。在三个数据集上的大量实验证明了该方法的有效性。

在未来,我们计划从算法和应用两方面扩展这项工作。首先,深入探索AdaRNN对Transformer的扩展,以获得更好的性能。第二,将AdaRNN的两个阶段整合到一个端到端网络中,更容易训练。

2770

2770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?