支持向量机SVM(Support Vector Machine),是机器学习领域的一个有监督的学习模型。

一、简介

支持向量机建立在统计学习理论的基础之上。统计学习理论(Statistical learning Theory简称SLT)是一种处理小样本的统计理论.

为研究有限样本情况下的统计模式识别和更广泛的机器学习问题建立了一个较好的理论框架.同时发展了一种新的模式识别方法一支

持向量机(support Vector Machine,简称SVM),能较好地解决小样本学习问题。支持向量机(SVM)是一种的分类方法.假定样本数

据服从某个分布。根据统计学习理论.要使分类函数的实际输出与理想输出之间的偏差尽可能小。应遵循结构风险最小化原理.而不

是传统的经验风险最小化原理,SVM正是这一理论的具体实现。

二、支持向量机(SVM)

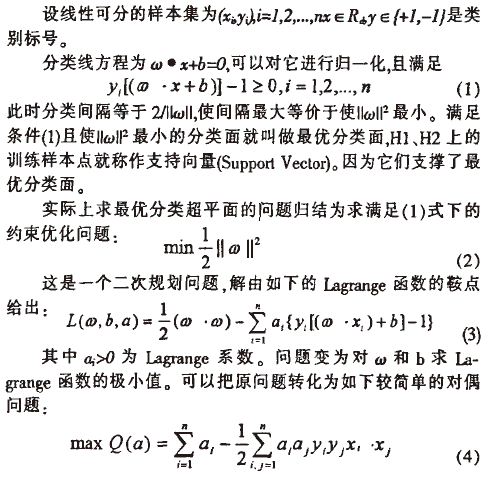

1,最优分类面

SVM方法是从线性可分情况下提出的。考虑如图1所示的二维两类线性可分情况.图中实心点和空心点分别表示两类训练样本。

H为把两类数据没有错误地分开的最优分类线,H1,H2分别为过两类样本中离分类超平面最近的点且平行于分类线.H1和H2之间

的距离叫做间距(m越咖)。如果该分类线将两类数据没有错误的分开且最近的点与分类线问的距离最大.则这样的分类线称为最优分

类线(在多维空间成为最优超平面)。可以看到最优分类超平面所要求的第一个条件.是将两类数据无错误的分开。即保证经验风险最

小;第二个条件是使分类间距最大.即使推广能力的界的置信区间最小.从而使真实风险最小。

2,广义最优分类面

3,支持向量机

SVM的机理是寻找一个满足分类要求的最优分类超平面,使得该超平面在保证分类精度的同时,能够使超平面两侧的空白区

域最大化。理论上,支持向量机能够实现对线性可分数据的最优分类。

支持向量机在线性可分或几乎线性可分时.直接在原始空同中建立超平面作为分类面。然而实际应用中的大多数问题都是复杂

的、非线性的。这时就必须寻求复杂的超曲面作为分界面。支持向量机通过在另一个高维空间中运用处理线性问题的方法建立一个

分类超平面.从而隐含在原始空问建立一个超曲面。支持向量机方法避开了高维空闻的计算,并不显式地进行变换计算.而只做训

练样本之间的内积运算。这种内积运算由事先定义的核函数来实现。将线性空间中的非线性问题映射为非线性空间中的线性问题,

从而从根本上解决非线性问题。

三、学习总结

本周从图书馆检索到相关期刊、论文,看到很多论文是把该算法结合具体问题应用的,考虑到自己初学只从期刊上下载了8篇,

其中有3篇比较合适我阅读。细读了一篇2007年发表的,浏览了其他两篇的前半部分,其中用到相关的数学模型大致相同。有相关

数学模型和公式的地方按照作者的思路来是可以看懂一点,但是我不知道为什么要那么做,用那种方法有什么好处不能理解。

2684

2684

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?