极限学习机

单隐藏层反馈神经网络具有两个比较突出的能力:

(1)可以直接从训练样本中拟 合 出 复 杂 的 映 射 函 数f :x ^ t

(2 )可以为大量难以用传统分类参数技术处理的自然或者人工现象提供模型。但是单隐藏层反馈神经网络缺少比较快速的学习方 法 。误差反向传播算法每次迭代需要更新n x(L+ 1) +L x (m+ 1 )个 值 ,所花费的时间远远低于所容忍的时间。经常可以看到为训练一个单隐藏层反馈神经网络花费了数小时,数天或者更多的时间。

基于以上原因,黄广斌教授对单隐藏层反馈神经网络进行了深入的研究,提

出并证明了两个大胆的理论:

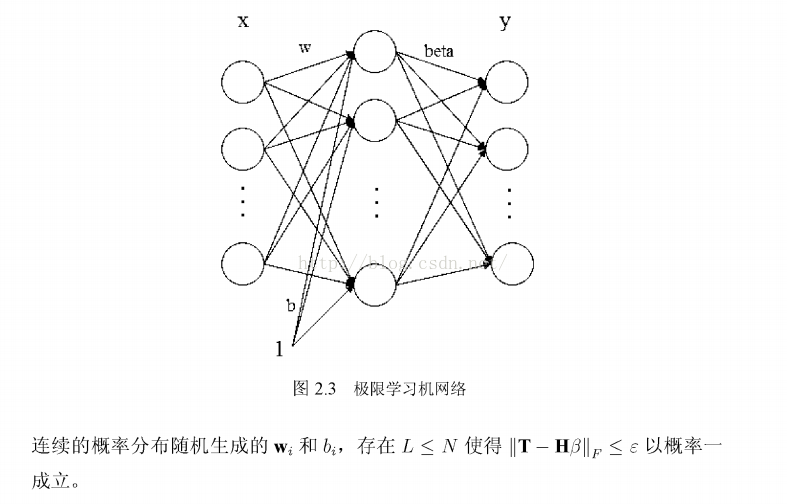

从以上两条理论我们可以看出,只要激励函数g:R ^ R满足在任意区间上无限可微,那么wt和bt可以从R的n维和R空间的任何区间内根据任意连续的概率分布随机生成 ,也就是说单隐藏层前馈神经网络无需再对wt和bt进行调整;又因为式子||TH*beta||_f=0以概率一成立,我们发现输出层的偏置也不再需要。那么一个新型的但隐藏层反馈神经网络如图2 .3表示 。

对比图2.2,缺少了输出层偏 置bs,而输入权重w和隐藏层偏置bi随机产生不需要调整,那么整个网络仅仅剩下输出权重beta一项没有确定。因此极限学习机

应运而生。令神经网络的输出等于样本标签,如式 (2-11) 表示

极限学习机(ELM)是一种快速的单隐藏层前馈神经网络训练方法,解决了传统误差反向传播算法的效率问题。ELM无需调整输入权重和隐藏层偏置,仅需确定输出权重,具有高效、泛化能力强等优点。MATLAB程序可在GB.Huang教授网站获取,实验结果显示训练和测试时间极短,准确率较高。

极限学习机(ELM)是一种快速的单隐藏层前馈神经网络训练方法,解决了传统误差反向传播算法的效率问题。ELM无需调整输入权重和隐藏层偏置,仅需确定输出权重,具有高效、泛化能力强等优点。MATLAB程序可在GB.Huang教授网站获取,实验结果显示训练和测试时间极短,准确率较高。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1000

1000

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?