目录

一、生物神经网络

1.概念

生物神经网络(Biological Neural Network)一般指生物的大脑神经元、细胞、触点等组成的网络,用于产生生物意识,帮助生物进行思考和行动。

每个神经元可以看做一个小的处理单元,这些处理单元按照某种方式相互连接起来,构成了大脑内部的生物神经元网络,这些神经元之间连接的强弱,按照外部的激励信号作自适应变化,而每个神经元又随着接收到的多个激励信号的综合大小,呈现兴奋或抑制状态。

2 神经元(Neuron)

2.1 定义

神经元又称神经细胞,是神经系统的基本结构和机能単位。神经元是一种高度特化的细胞,具有感受刺激和传导兴奋的功能。接受刺激,产生兴奋或抑制。通过神经元相互间的联系,把传入的神经冲动加以分析、贮存,并发出调整后的信息。

2.2 结构

组成:胞体(soma)、突起(neurites);

胞体:是神经元的代谢和营养中心,结构与一般细胞相似。存在于脑和脊髓的灰质及神经节内,形态各异,常见有星形、锥体形、梨形和圆球形。

- 突起:树突(dendrite)、轴突(axon)。

- 突触(synapase):神经元之间的机能连接点。

- 树突:接受刺激并将冲动传入细胞体。

- 轴突:将神经冲动由胞体传入其他神经元或效应细胞。

3 工作流程

生物神经元具有两种状态:兴奋或抑制。当传入的神经冲动使细胞膜电位升高超过阈值(threshold)时,细胞进入兴奋状态,产生神经冲动并由轴突输出;当传入的神经冲动使膜电位下降低于阈值时,细胞进入抑制状态,没有神经冲动输出,工作过程如图3.1所示。

图3.1 神经元工作流程

4 信息整合

单个神经元可以与多达上千个其他神经元的轴突末梢形成突触连接,接受从突触前各个轴突传来的脉冲输出,这些输入从不同的部位输入给神经元,个输入的权重(weight)影响也不同。

一个神经元的输入信息在时间和空间上常呈现一种复杂多变的形式,神经元需要对其进行整合,从而决定其输出的时机和强弱。

- 空间整合

同一时刻产生的刺激所引起的膜电位变化,大致等于各单独刺激引起的膜电位变化的综合。

- 时间整合

各输入脉冲抵达神经元的时间先后不一致,总的突触后膜电位为一段时间内的累积。

5 电位

- 神经细胞膜电位在不同时期,具有不同的状态,通常分为静息电位和动作电位。

- 静息电位(Resting Potential,RP)

- 细胞未受刺激时,即处于“静息”状态下存在于细胞膜两侧的电位差。

- 极化:神经纤维在安静时是细胞膜外正电,细胞膜内负电。

- 动作电位(Action potential,AP)

各种可兴奋细胞受到有效刺激时,在细胞膜两侧产生的快速、可逆并有扩散性的电位变化,包 括去极化、复极化等环节。

- 去极化(除极化):受刺激时,细胞膜内外不带电。

- 反极化:刺激后期,细胞膜外负内正。

- 复极化:兴奋传递结束,恢复到安静状态。

6 名词解释

6.1兴奋和抑制

- 兴奋:活体组织因刺激而产生的冲动反应,神经活动由静息状态或较弱的状态转为活动或较强的状态。

- 兴奋性:可兴奋组织受到有效刺激时,具有发生兴奋即产生冲动的能力;

- 抑制:神经活动的状态或较强的状态转为静息或较弱的状态;

- 兴奋或抑制不是简单地活动或静止状态,兴奋或抑制都是神经活动的过程,是指这种活动搜索所指引的方向。

- 引起兴奋的主要条件

- 组织的机能状态(兴奋、抑制)

- 刺激的特征(强度、时间、强度-时间)

6.2 阈刺激

- 刺激:能引起生物体活动状态发生变化的各种环境因子。分为直接刺激(direct stimulus)和间接刺激(indirect stimulus)。

- 反应:由刺激而引起的集体活动状态的改变。

- 阈刺激:达到阈强度的有效刺激。

- 阈上刺激:高于阈强度的刺激。

- 阈下刺激:低于阈强度的刺激。

- 原理:阈下刺激和阈刺激或阈上刺激一样均可以引起细胞膜去极化,但阈下刺激不会引发动作电位,这是因为阈刺激和阈上刺激可以使细胞膜上Na+通道大量激活,Na+内流量增多从而出现一次快速可逆的电变化,这个过程一旦发生即与刺激强度无关。

- 阈强度高,兴奋性低;与强度低,兴奋性高;

- 时值(chronaxie):当刺激强度为阈强度的2倍时,刚能引起反应所需的最短刺激持续时间;

- 时值愈短,兴奋性愈高。

6.3 阈强度

- 引起组织发生反应的最小刺激强度(具有足够的、恒定的持续时间和强度-时间比率),与刺激的强度无关,又称为强度阈值。

- 阈强度是使膜电位去极化达到阈电位引发动作电位的最小刺激强度,是刺激的强度阈值;

- 阈电位是指能使可兴奋的细胞膜Na+或Ca2+通透性突然增大的临界膜电位;

6.4 不应期

- 绝对不应期(absolute refractory period):组织兴奋后,在去极后到复极化达到一定程度之前对任何程度的刺激均不产生反应。

- 相对不应期(relative refractory period):绝对不应期之后,随着复极化的继续,组织的兴奋性有所恢复,只对阀上刺激产生兴奋。

- 超长期(supranormal period):相对不应期之后,兴奋恢复高于原有水平,用阈下刺激就可引起兴奋。

- 低常期(subnormal period):超长期之后,组织进入兴奋性较低时期,只有阈上刺激才能引起兴奋。

二、人工神经网络

1.概念

人工神经网络(Artificial Neural Networks,简写为ANNs)是一种模仿动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的,并具有自学习和自适应的能力。

2.基本介绍

人工神经网络是一种应用类似于大脑神经突触联接的结构进行信息处理的数学模型。在工程与学术界也常直接简称为神经网络或类神经网络。神经网络是一种运算模型,由大量的节点(或称神经元)和之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

它的构筑理念是受到生物(人或其他动物)神经网络功能的运作启发而产生的。人工神经网络通常是通过一个基于数学统计学类型的学习方法(Learning Method)得以优化,所以人工神经网络也是数学统计学方法的一种实际应用,通过统计学的标准数学方法我们能够得到大量的可以用函数来表达的局部结构空间,另一方面在人工智能学的人工感知领域,我们通过数学统计学的应用可以来做人工感知方面的决定问题(也就是说通过统计学的方法,人工神经网络能够类似人一样具有简单的决定能力和简单的判断能力),这种方法比起正式的逻辑学推理演算更具有优势。

3.数学模型

人工神经元结构:人工神经元的研究源于脑神经元学说,19世纪末,在生物、生理学领域,Waldeger等人创建了神经元学说。

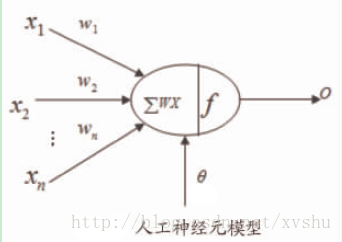

人工神经网络是由大量处理单元经广泛互连而组成的人工网络,用来模拟脑神经系统的结构和功能。而这些处理单元我们把它称作人工神经元。人工神经网络可看成是以人工神经元为节点,用有向加权弧连接起来的有向图。在此有向图中,人工神经元就是对生物神经元的模拟,而有向弧则是轴突—-突触—-树突对的模拟。有向弧的权值表示相互连接的两个人工神经元间相互作用的强弱。人工神经元结构如下图所示:

神经网络从两个方面模拟大脑:

(1)、神经网络获取的知识是从外界环境中学习得来的。

(2)、内部神经元的连接强度,即突触权值,用于储存获取的知识。

神经网络系统由能够处理人类大脑不同部分之间信息传递的由大量神经元连接形成的拓扑结构组成,依赖于这些庞大的神经元数目和它们之间的联系,人类的大脑能够收到输入的信息的刺激由分布式并行处理的神经元相互连接进行非线性映射处理,从而实现复杂的信息处理和推理任务。

对于某个处理单元(神经元)来说,假设来自其他处理单元(神经元)i的信息为Xi,它们与本处理单元的互相作用强度即连接权值为Wi, i=0,1,…,n-1,处理单元的内部阈值为θ。

那么本处理单元(神经元)的输入为:,而处理单元的输出为:式中,xi为第i个元素的输入,wi为第i个处理单元与本处理单元的互联权重即神经元连接权值。f称为激活函数或作用函数,它决定节点(神经元)的输出。θ表示隐含层神经节点的阈值。

4.神经网络的学习形式

在构造神经网络时,其神经元的传递函数和转换函数就已经确定了。在网络的学习过程中是无法改变转换函数的,因此如果想要改变网络输出的大小,只能通过改变加权求和的输入来达到。由于神经元只能对网络的输入信号进行响应处理,想要改变网络的加权输入只能修改网络神经元的权参数,因此神经网络的学习就是改变权值矩阵的过程。

5.学习算法

神经网络的学习也称为训练,通过神经网络所在环境的刺激作用调整神经网络的自由参数(如连接权值),使神经网络以一种新的方式对外部环境做出反应的一个过程。每个神经网络都有一个激活函数y=f(x),训练过程就是通过给定的海量x数据和y数据,拟合出激活函数f。学习过程分为有导师学习和无导师学习,有导师学习是给定期望输出,通过对权值的调整使实际输出逼近期望输出;无导师学习给定表示方法质量的测量尺度,根据该尺度来优化参数。常见的有Hebb学习、纠错学习、基于记忆学习、随机学习、竞争学习。

Hebb学习:

(贴公式不方便,只简述原理)这是最早提出的学习方法,原理是如果突触(连接)两边的两个神经元被同时(同步)激活,则该突触的能量(权重)就选择性增加;如果被异步激活,则该突出能量减弱或消除。

纠错学习:

计算实际输出和期望输出的误差,再返回误差,修改权值。原理简单,用到最多,最小梯度下降法(LMS最小均方误差算法)就是这种方法。

基于记忆的学习:

主要用于模式分类,在基于记忆的学习中,过去的学习结果被存储在一个大的存储器中,当输入一个新的测试向量时,学习过程就是把新向量归到已存储的某个类中。算法包括两部分:一是用于定义测试向量局部领域的标准;二是在局部领域训练样本的学习规则。常用最近邻规则。

随机学习算法:

也叫Bolzmann学习规则,根据最大似然规则,通过调整权值,最小化似然函数或其对数。

模拟退火算法是从物理和化学退火过程类推过来,是“对物体加温后再冷却的处理过程”的数学建模。整个过程分为两步:首先在高温下进行搜索,此时各状态出现概率相差不大,可以很快进入“热平衡状态”,这时进行的是“粗搜索”,也就是大致找到系统的低能区区域;随着温度降低,各状态出现的概率差距逐渐被扩大,搜索精度不断提高,这就可以越来越准确地找到网络能量函数的全局最小点。

竞争学习:

神经网络的输出神经元之间相互竞争,在任一时间只能有一个输出神经元是活性的。

6.量子神经网络

量子神经网络的概念出现于上个世纪90年代后期,一经提出后便引起了不同领域的科学家的关注,人们在这个崭新的领域进行了不同方向的探索,提出了很多想法和初步的模型,充分体现了量子神经网络研究的巨大潜力。主要研究方向可以概括为:

(1)、量子神经网络采用神经网络的连接思想来构造量子计算机,通过神经网络模型来研究量子计算中的问题;

(2)、量子神经网络在量子计算机或量子器件的基础上构造神经网络,充分利用量子计算超高速、超并行、指数级容量的特点,来改进神经网络的结构和性能;

(3)、量子神经网络作为一种混合的智能优化算法在传统的计算机上的实现,通过引入量子理论中的思想对传统神经网络改进,利用量子理论中的概念、方法(如态叠加、“多宇宙”观点等),建立新的网络模型;改善传统神经网络的结构和性能;

(4)、基于脑科学、认知科学的研究

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?