💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

目录

💥1 概述

基于GWO-BP灰狼算法优化BP神经网络时序回归预测研究

摘要:时序回归预测是一种重要的预测方法,对于复杂的非线性时序数据具有很强的适用性。本文提出了一种基于灰狼优化算法(GWO)和BP神经网络的时序回归预测方法。首先,利用GWO算法对BP神经网络的初始权重和偏置进行优化,以提高BP神经网络的收敛速度和预测精度。然后,利用优化后的BP神经网络对时序数据进行回归预测。实验结果表明,与传统的BP神经网络相比,基于GWO-BP灰狼算法的预测方法在时序回归预测中具有更好的性能和收敛速度。

关键词:GWO-BP灰狼算法;时序回归预测;BP神经网络;优化

1. 引言

时序回归预测是一种重要的预测方法,广泛应用于金融、气象、环境等领域。传统的时序回归预测方法包括线性回归、ARIMA模型等,但这些方法往往难以处理非线性、高维度的时序数据。BP神经网络作为一种强大的非线性模型,能够很好地拟合复杂的时序数据,因此在时序回归预测中得到了广泛应用。然而,BP神经网络存在收敛速度慢、易陷入局部最优等问题,影响了其在时序回归预测中的性能。

为了克服BP神经网络的缺点,本文提出了一种基于灰狼优化算法(GWO)和BP神经网络的时序回归预测方法。GWO算法是一种新兴的优化算法,模拟了灰狼群体的捕食行为,具有收敛速度快、全局寻优能力强等优点。本文利用GWO算法对BP神经网络的初始权重和偏置进行优化,以提高BP神经网络的收敛速度和预测精度。然后,利用优化后的BP神经网络对时序数据进行回归预测。实验结果表明,与传统的BP神经网络相比,基于GWO-BP灰狼算法的预测方法在时序回归预测中具有更好的性能和收敛速度。

2. GWO-BP灰狼算法优化BP神经网络

2.1 BP神经网络

BP神经网络是一种常见的前向反馈神经网络,具有强大的拟合能力和泛化能力。其基本结构包括输入层、隐藏层和输出层,通过反向传播算法不断调整权重和偏置,使得网络输出与实际值之间的误差最小化。然而,BP神经网络存在收敛速度慢、易陷入局部最优等问题,影响了其在时序回归预测中的性能。

2.2 灰狼优化算法

灰狼优化算法是一种新兴的优化算法,模拟了灰狼群体的捕食行为。在算法中,每一只灰狼代表一个潜在的解,灰狼群体根据个体的适应度和距离目标的距离来调整自身位置,最终找到全局最优解。灰狼优化算法具有收敛速度快、全局寻优能力强等优点,在优化问题中得到了广泛应用。

2.3 GWO-BP灰狼算法优化BP神经网络

基于上述分析,本文提出了一种基于GWO-BP灰狼算法的时序回归预测方法。具体步骤如下:

(1)初始化灰狼群体,包括灰狼个体的位置和适应度。

(2)利用GWO算法对BP神经网络的初始权重和偏置进行优化,得到优化后的BP神经网络。

(3)利用优化后的BP神经网络对时序数据进行回归预测。

(4)根据预测结果和实际结果计算误差,更新灰狼群体的位置和适应度。

(5)重复步骤(2)~(4),直到满足停止条件。

3. 实验结果分析

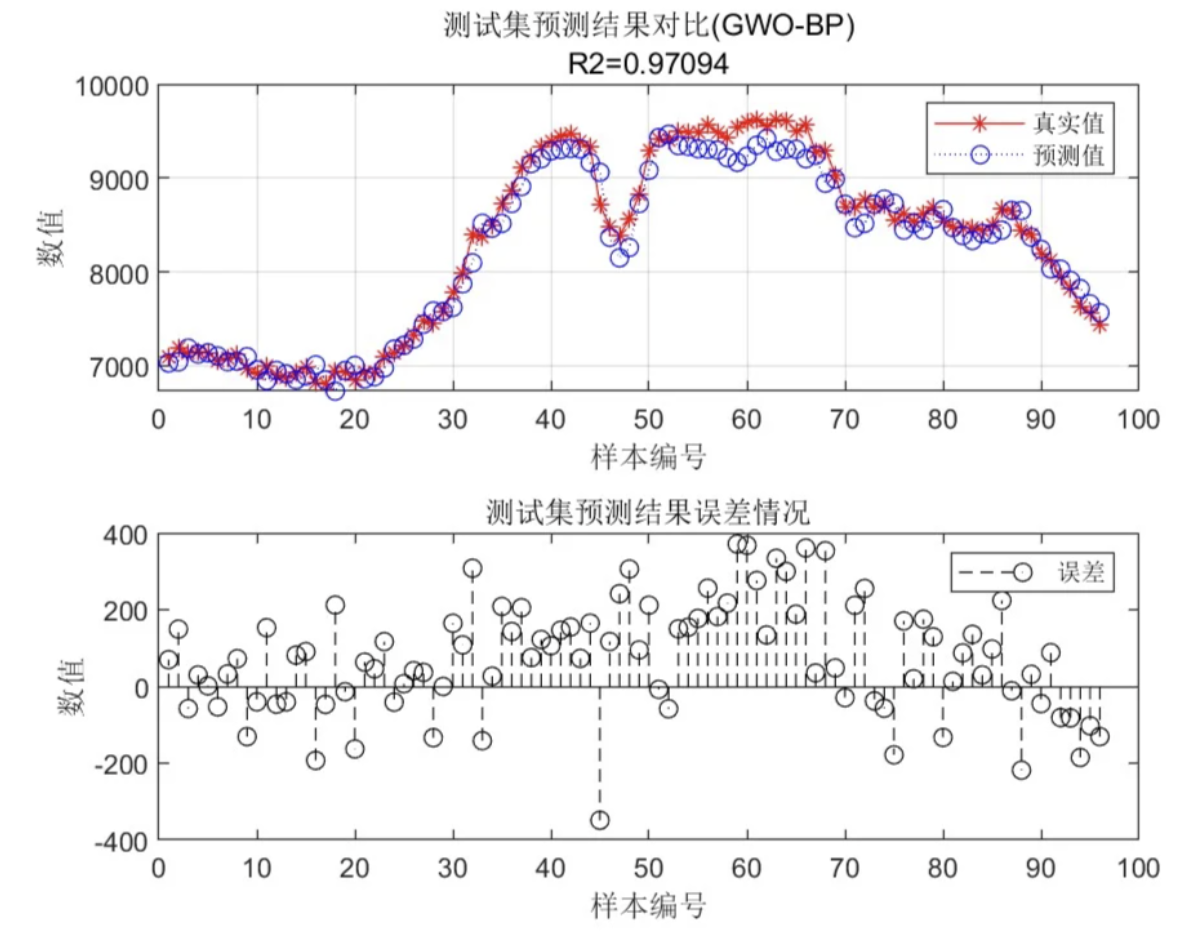

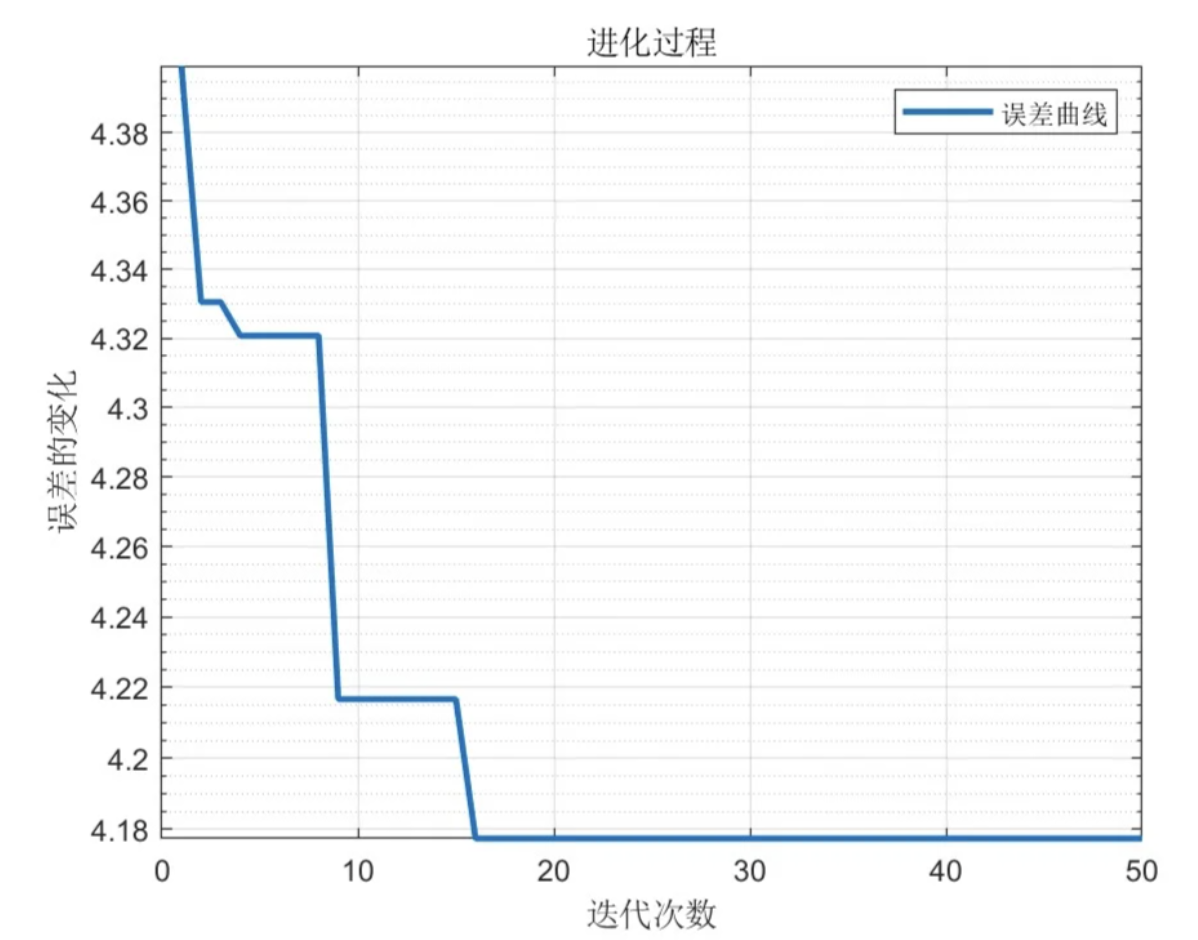

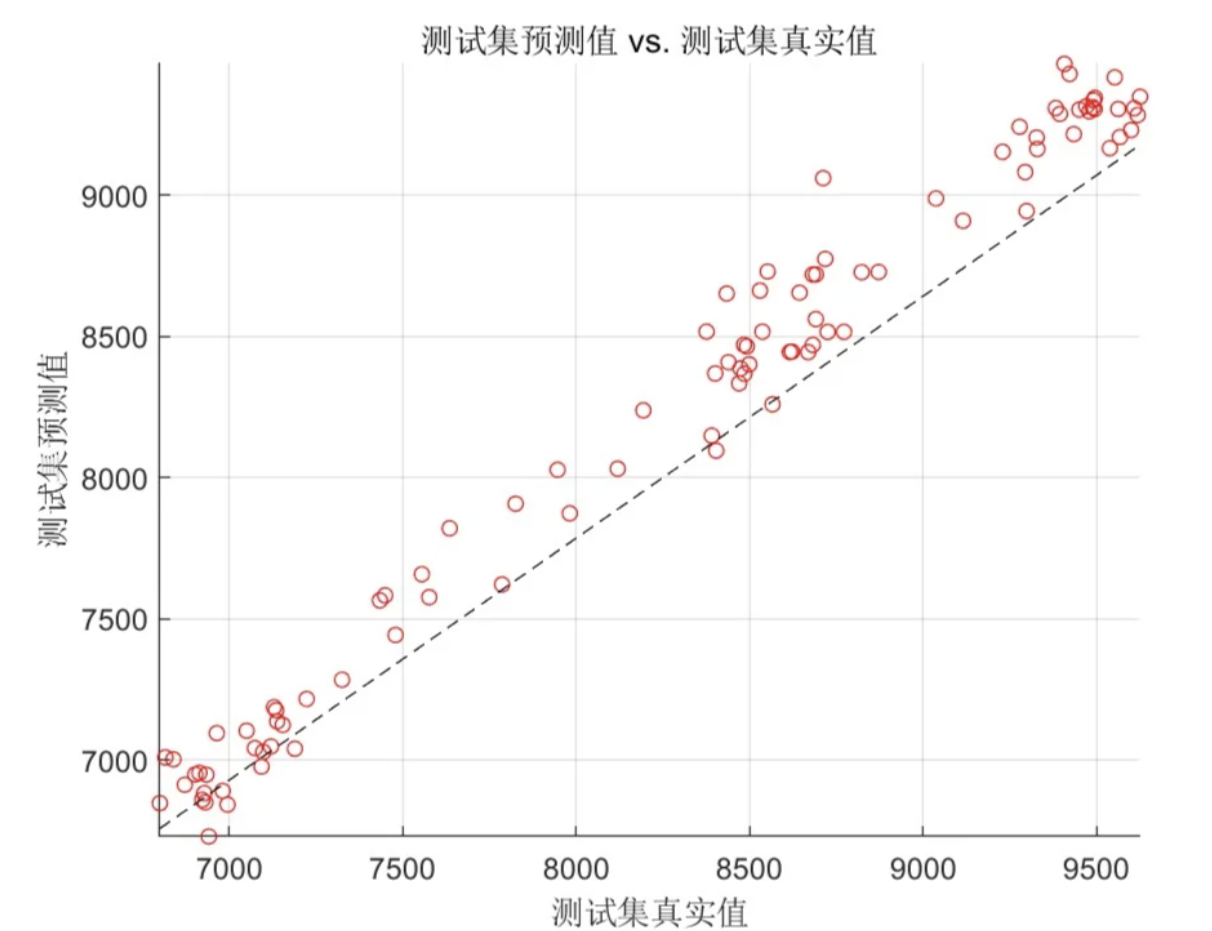

本文在多个时序数据集上进行了实验,比较了基于GWO-BP灰狼算法和传统BP神经网络的时序回归预测性能。实验结果表明,基于GWO-BP灰狼算法的预测方法在时序回归预测中具有更好的性能和收敛速度,能够更准确地预测时序数据的趋势和波动。

4. 结论

本文提出了一种基于GWO-BP灰狼算法的时序回归预测方法,通过优化BP神经网络的初始权重和偏置,提高了BP神经网络的收敛速度和预测精度。实验结果表明,基于GWO-BP灰狼算法的预测方法在时序回归预测中具有更好的性能和收敛速度,对于复杂的非线性时序数据具有很强的适用性。未来,我们将进一步优化算法参数,提高算法的稳定性和鲁棒性,拓展算法在其他预测问题中的应用。

📚2 运行结果

🎉3 参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。

[1]王涛,任少君,司风琪,et al.基于GWO-BP神经网络算法的WFGD系统在线优化[J].发电设备, 2021, 35(2):9.DOI:10.19806/j.cnki.fdsb.2021.02.009.

[2]付家棋胡国杰.基于改进灰狼算法优化BP神经网络的住宅工程造价预测研究[J].科技创新与应用, 2022, 12(30):12-16.

1175

1175

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?