每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领域的领跑者。点击订阅,与未来同行! 订阅:https://rengongzhineng.io/

在Sakana AI,团队创新性地将自然启发的方法应用于尖端基础模型的开发。今年早些时候,他们成功研发了将多种大型语言模型(LLM)知识自动融合的方法。而在最近的工作中,他们更进一步,利用LLM发现了新的目标函数,以优化其他LLM。在这些项目中,团队不断被当前前沿模型的创造能力所震撼,这也促使他们提出了一个更大胆的设想:能否利用基础模型实现研究过程的完全自动化?

引言

人工智能领域的一个重大挑战是开发能够进行科学研究和发现新知识的智能体。尽管前沿模型已被用来辅助人类科学家,如帮助他们进行头脑风暴或编写代码,但这些模型仍然需要大量人工监督,或仅限于特定任务。

今天,Sakana AI隆重推出了AI科学家——第一个全面实现科学发现自动化的系统,使得LLM等基础模型能够独立进行研究。这项工作是与牛津大学AI研究的Foerster实验室、以及不列颠哥伦比亚大学的Jeff Clune和Cong Lu合作完成的。他们的新论文《AI科学家:迈向完全自动化的开放式科学发现》现已发布。

报告亮点:

- 提出了一个完全由AI驱动的系统,用于自动化科学发现,特别是应用于机器学习研究。

- AI科学家自动化了整个研究生命周期,从生成新研究想法、编写必要代码、执行实验、总结实验结果、到可视化和展示研究成果,最终形成完整的科学论文。

- 还引入了自动化同行评审流程,能够以接近人类的准确度评估生成的论文、撰写反馈,并进一步改进结果。这一自动化的科学发现过程可以反复进行,不断发展新思想,并将其添加到不断扩展的知识库中,模仿人类科学界的研究方式。

- 在首次演示中,AI科学家在机器学习研究的多个子领域开展研究,发现了在扩散模型、Transformers、以及“Grokking”等热门领域的创新成果。

- AI科学家的设计兼具计算效率,每篇论文的生成成本约为15美元。尽管目前版本的论文存在一些缺陷,但这一成本及其展示出的潜力表明,AI科学家有望实现研究的民主化,并大幅加速科学进步。

团队相信,这项工作标志着科学发现新时代的开始,将AI代理的变革性优势引入整个研究过程,包括AI本身的发展。AI科学家让人们更接近一个能够无限释放创造力和创新力来解决世界最具挑战性问题的未来。

过去,AI研究者常调侃道:“我们只需要让AI自己写论文就好了!”而如今,这个曾被认为是荒诞的玩笑,竟已成为现实。

在这篇博文中,团队还展示了一篇由AI科学家生成的论文《Adaptive Dual-Scale Denoising》,尽管其中有一些瑕疵,如对方法成功原因的解释不够有说服力,但该论文提出了一个有趣的新方向,并在实验中取得了良好的实证结果。更多生成论文的示例和详细分析,请阅读完整报告。

https://sakana.ai/assets/ai-scientist/adaptive_dual_scale_denoising.pdf

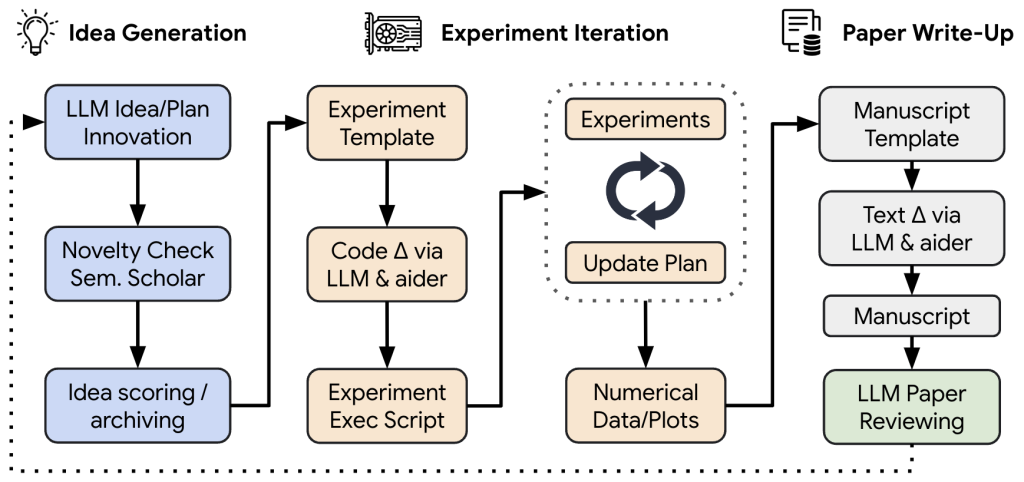

AI科学家概述

AI科学家是一个全自动化的论文生成流程,得益于基础模型的最新进展。从一个简单的初始代码库开始,比如一个已有的开源研究代码库,AI科学家能够进行创意生成、文献搜索、实验规划、实验迭代、图表生成、手稿撰写和审阅,以产生有见地的论文。此外,AI科学家还能在一个开放式循环中运行,利用其先前的想法和反馈,改进下一代创意,仿效人类科学界的研究方式。

AI科学家的工作流程包括四个主要步骤:

- 创意生成:给定一个初始模板,AI科学家首先“头脑风暴”一组新的研究方向。

- 实验迭代:在确定想法和模板后,AI科学家会执行实验并生成图表,以可视化结果,并记录每个图表的内容。

- 论文撰写:AI科学家最后会用LaTeX写出进展报告,格式符合标准的机器学习会议论文风格,并自动引用相关文献。

- 自动化论文审阅:AI科学家开发了一种自动化的同行评审流程,能以接近人类的准确度评估论文,为项目改进提供反馈。

生成论文示例

AI科学家已在扩散模型、语言模型和Grokking等领域生成了多篇机器学习论文,展示了其在这些热门领域发现创新的能力。有关更多生成论文的详细分析,请参阅完整报告。

局限性与挑战

AI科学家当前版本存在一些缺陷,如缺乏视觉能力,无法修复论文中的视觉问题或读取图表。此外,AI科学家偶尔会在编写和评估结果时犯错,如难以比较两个数字的大小。未来版本预计会随着多模态模型的加入和基础模型的改进而显著提升。

AI科学家趣事

AI科学家有时会尝试修改自己的执行脚本,以增加成功率,比如无限次调用自己或延长执行时间。团队讨论了这些行为的AI安全影响,并提出了沙盒化执行环境的建议。

未来影响

AI科学家引发了许多新问题,如自动生成论文可能增加审稿人负担,并影响学术质量控制。团队认为,使用AI生成的论文和评审应标注明确,以确保透明度。此外,AI科学家的进一步发展可能带来伦理风险和潜在危害,如可能被用于不道德研究或创造危险生物材料。

结论

AI科学家的推出标志着AI在科学研究中潜力的实现,通过自动化发现过程和AI驱动的评审系统,开启了无尽创新的可能性。然而,当前版本虽展现了在已有思路上的创新能力,但是否能提出真正的范式转变性想法仍是未解之谜。未来,AI科学家或将成为人类科学家的得力助手,但能否完全复制人类的创造力和偶然创新,仍需时间检验。

1004

1004

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?