一、间隔与支持向量

给定训练样本集

D

=

{

(

x

1

,

y

1

)

,

(

x

2

,

y

2

)

,

⋯

,

(

x

m

,

y

m

)

}

,

y

i

∈

{

−

1

,

+

1

}

D=\{ (\bm x_1,y_1),(\bm x_2,y_2),\cdots,(\bm x_m,y_m)\},y_i \in \{ -1,+1\}

D={(x1,y1),(x2,y2),⋯,(xm,ym)},yi∈{−1,+1},分类学习最基本的想法就是基于训练集

D

D

D在样本空间中找到一个划分超平面,将不同类别的样本分开。

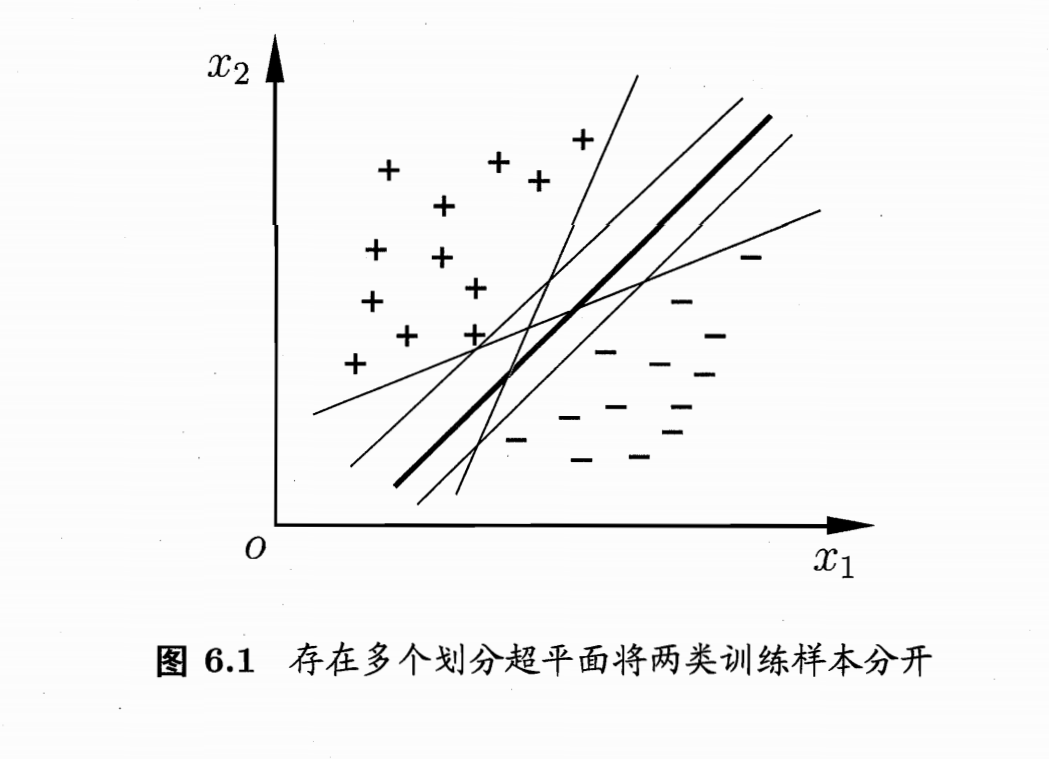

如图所示,可能存在的划分超平面的样本有很多,直观上看,应该去找位于两类训练样本“正中间”的划分超平面。这个划分超平面所产生的分类结果是最鲁棒的,对未见示例的泛化性能最强。

在样本空间中,划分超平面可以通过如下线性方程来描述:

W

T

x

+

b

=

0

\bm W^T \bm x+b=0

WTx+b=0

其中,

w

=

(

w

1

;

w

2

;

⋯

;

w

d

)

\bm w=(w_1;w_2;\cdots;w_d)

w=(w1;w2;⋯;wd)为法向量,决定了超平面的方向,

b

b

b为位移项,决定了超平面与原点之间的距离。样本空间中任意点

x

\bm x

x到超平面

(

w

,

x

)

(\bm w,x)

(w,x)的距离可以表示为

r

=

∣

w

T

+

b

∣

∣

∣

w

∣

∣

r=\frac {|\bm w^T+b|} {|| \bm w||}

r=∣∣w∣∣∣wT+b∣

假设超平面

(

w

,

b

)

(\bm w,b)

(w,b)能将训练样本正确分类,即对于

(

w

,

b

)

∈

D

(\bm w,b) \in D

(w,b)∈D,若

y

i

=

+

1

y_i=+1

yi=+1,则有

w

T

x

i

+

b

>

0

\bm {w^Tx_i}+b>0

wTxi+b>0;若

y

i

=

−

1

y_i=-1

yi=−1,则有

w

T

x

i

+

b

<

0

\bm {w^Tx_i}+b<0

wTxi+b<0.令

{

w

T

x

i

+

b

≥

+

1

,

y

i

=

+

1

;

w

T

x

i

+

b

≤

−

1

,

y

i

=

−

1

\begin {cases} \bm {w^Tx_i}+b \ge +1,y_i=+1;\\ \bm {w^Tx_i}+b \le -1,y_i=-1 \end {cases}

{wTxi+b≥+1,yi=+1;wTxi+b≤−1,yi=−1

距离超平面最近的这几个训练样本点使上式的等号成立,它们被称为“支持向量”,两个异类支持向量到超平面的距离之和为

γ

=

2

∣

∣

w

∣

∣

\gamma =\frac 2 {|| \bm w||}

γ=∣∣w∣∣2

γ \gamma γ被称为“间隔”

如要找到具有“最大间隔”的划分超平面,也就是要找到能满足上式中约束的参数

w

和

b

\bm w和b

w和b,使得

γ

\gamma

γ最大。

{

m

a

x

w

,

b

2

∣

∣

w

∣

∣

s

.

t

.

y

i

(

w

T

x

i

+

b

)

≥

1

,

i

=

1

,

2

,

⋯

,

m

.

\begin{cases} max_{\bm w,b}\frac 2 {||\bm w||} \\ s.t. y_i(\bm w^T \bm x_i+b) \ge1,i=1,2,\cdots,m. \end{cases}

{maxw,b∣∣w∣∣2s.t.yi(wTxi+b)≥1,i=1,2,⋯,m.

由上式可知,为了最大化间隔,仅需最大化

∣

∣

w

∣

∣

−

1

||\bm w||^{-1}

∣∣w∣∣−1,等价于最小化

∣

∣

w

∣

∣

2

||\bm w||^2

∣∣w∣∣2,则上式可以重新写为

{

m

i

n

w

,

b

1

2

∣

∣

w

∣

∣

2

s

.

t

.

y

i

(

w

T

x

i

+

b

)

≥

1

,

i

=

1

,

2

,

⋯

,

m

.

\begin{cases} min_{\bm w,b}\frac 1 2 {||\bm w||^2} \\ s.t. y_i(\bm w^T \bm x_i+b) \ge1,i=1,2,\cdots,m. \end{cases}

{minw,b21∣∣w∣∣2s.t.yi(wTxi+b)≥1,i=1,2,⋯,m.

这就是支持向量机SVM的基本型

后续内容由于准备的不充分,将写在其他博客中。

995

995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?