引言:

在深度学习中,损失函数是衡量模型预测与实际目标之间差异的指标,而优化器是用来调整模型参数来最小化或者最大化损失函数的算法,通过调整模型参数使得损失函数尽可能地减小;

举个栗子来加深优化器的印象:

你是一名烘焙师,正在尝试调整配方以制作最美味的蛋糕。你手上有一份初始的蛋糕配方,其中包含了面粉、糖、鸡蛋、奶油等各种原料的比例,而你想要的是使得蛋糕的口感和味道达到最佳状态。这时候,你可以把制作蛋糕的过程比作是一个模型,而你调整配方的过程就是优化器在工作。

优化器的目标是通过不断调整每种原料的比例,使得蛋糕的口感和味道最优。它会根据你的口味和反馈,不断地更新配方中各种原料的数量,直到蛋糕的味道达到你满意的程度。

学习率在这个例子中可以看作是你调整每种原料比例的幅度。如果学习率设置得太小,你可能需要进行很多次微小的调整才能达到理想的味道;而如果学习率设置得太大,你可能会一次性改变太多原料的比例,导致蛋糕味道失衡。

优化算法就像是你选择使用的调味技巧。有些算法可能会更智能地根据蛋糕口感的反馈来调整各种原料的比例,使得调整过程更加高效和有效;

总的来说,优化器就像是你在烘焙过程中的智慧助手,帮助你不断调整配方,制作出口感和味道最佳的蛋糕。

代码例子:

import torch

import torchvision

from torch import nn

from torch.nn import Sequential, Conv2d, MaxPool2d, Flatten, Linear

from torch.utils.data import DataLoader

dataset = torchvision.datasets.CIFAR10("./data", train=False, transform=torchvision.transforms.ToTensor(),

download=True)

dataloader = DataLoader(dataset, batch_size=1)

class MyModule(nn.Module):

def __init__(self):

super(MyModule, self).__init__()

self.model1 = Sequential(

Conv2d(3, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 64, 5, padding=2),

MaxPool2d(2),

Flatten(),

Linear(1024, 64),

Linear(64, 10)

)

def forward(self, x):

x = self.model1(x)

return x

loss = nn.CrossEntropyLoss()

my_module = MyModule()

optim = torch.optim.SGD(my_module.parameters(), lr=0.01)

for epoch in range(20):

running_loss = 0.0

for data in dataloader:

imgs, targets = data

outputs = my_module(imgs)

result_loss = loss(outputs, targets)

optim.zero_grad()

result_loss.backward()

optim.step()

running_loss = running_loss + result_loss

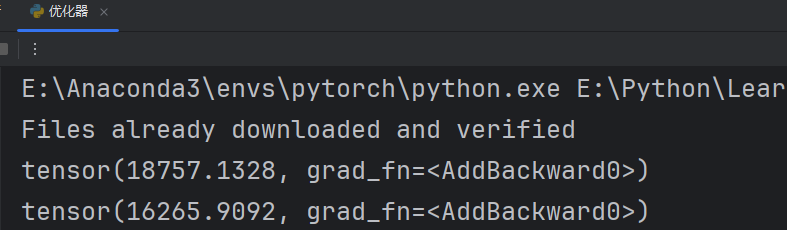

print(running_loss)

5599

5599

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?